Proceso de Solicitud

Para usar la API de Finalización de Chat de Claude, primero puedes ir a la página de API de Finalización de Chat de Claude y hacer clic en el botón “Acquire” para obtener las credenciales necesarias para la solicitud: Si aún no has iniciado sesión o registrado, serás redirigido automáticamente a la página de inicio de sesión que te invita a registrarte e iniciar sesión. Después de registrarte e iniciar sesión, serás redirigido automáticamente a la página actual.

En la primera solicitud, se te otorgará un crédito gratuito, lo que te permitirá usar esta API de forma gratuita.

Si aún no has iniciado sesión o registrado, serás redirigido automáticamente a la página de inicio de sesión que te invita a registrarte e iniciar sesión. Después de registrarte e iniciar sesión, serás redirigido automáticamente a la página actual.

En la primera solicitud, se te otorgará un crédito gratuito, lo que te permitirá usar esta API de forma gratuita.

Uso Básico

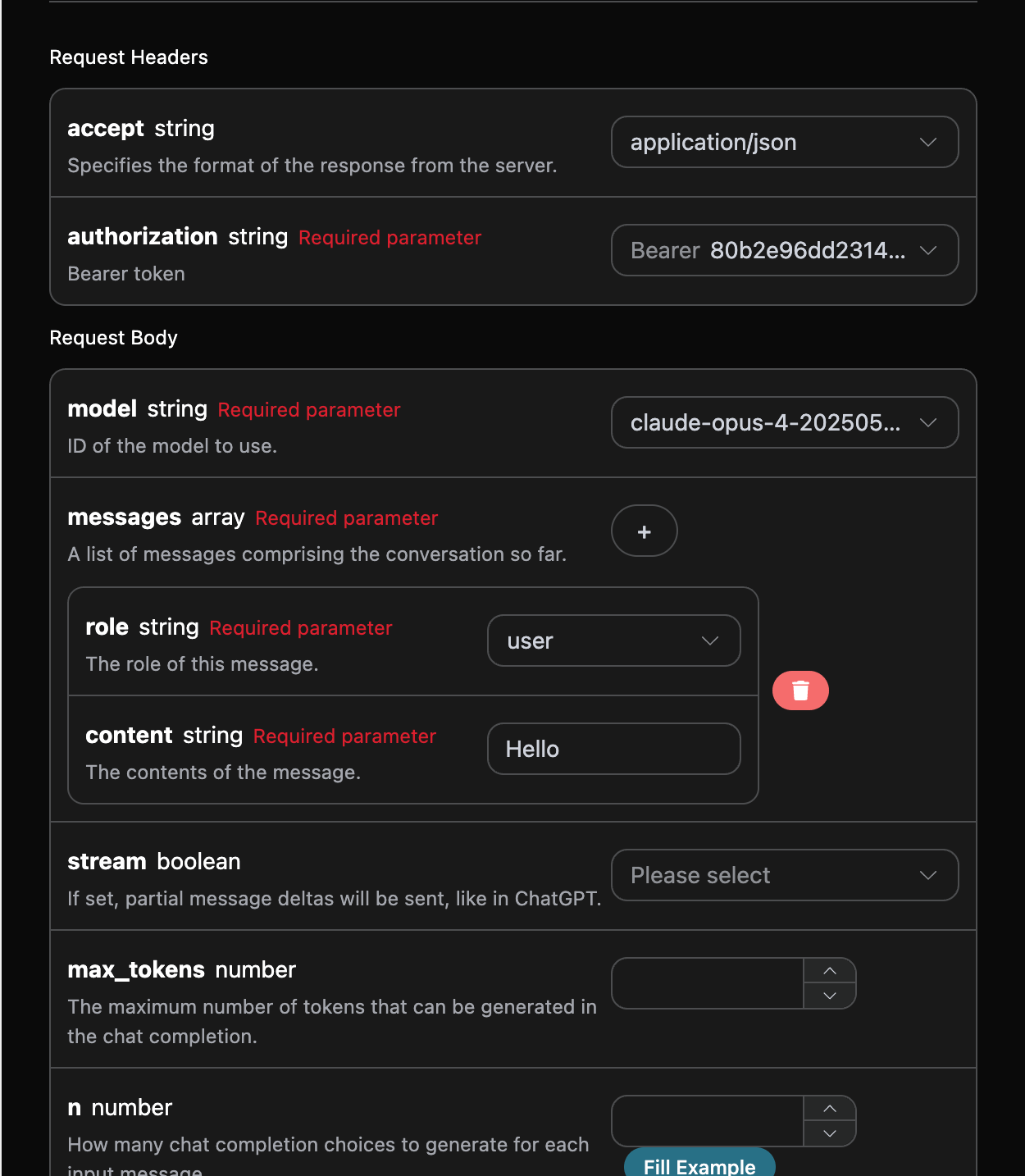

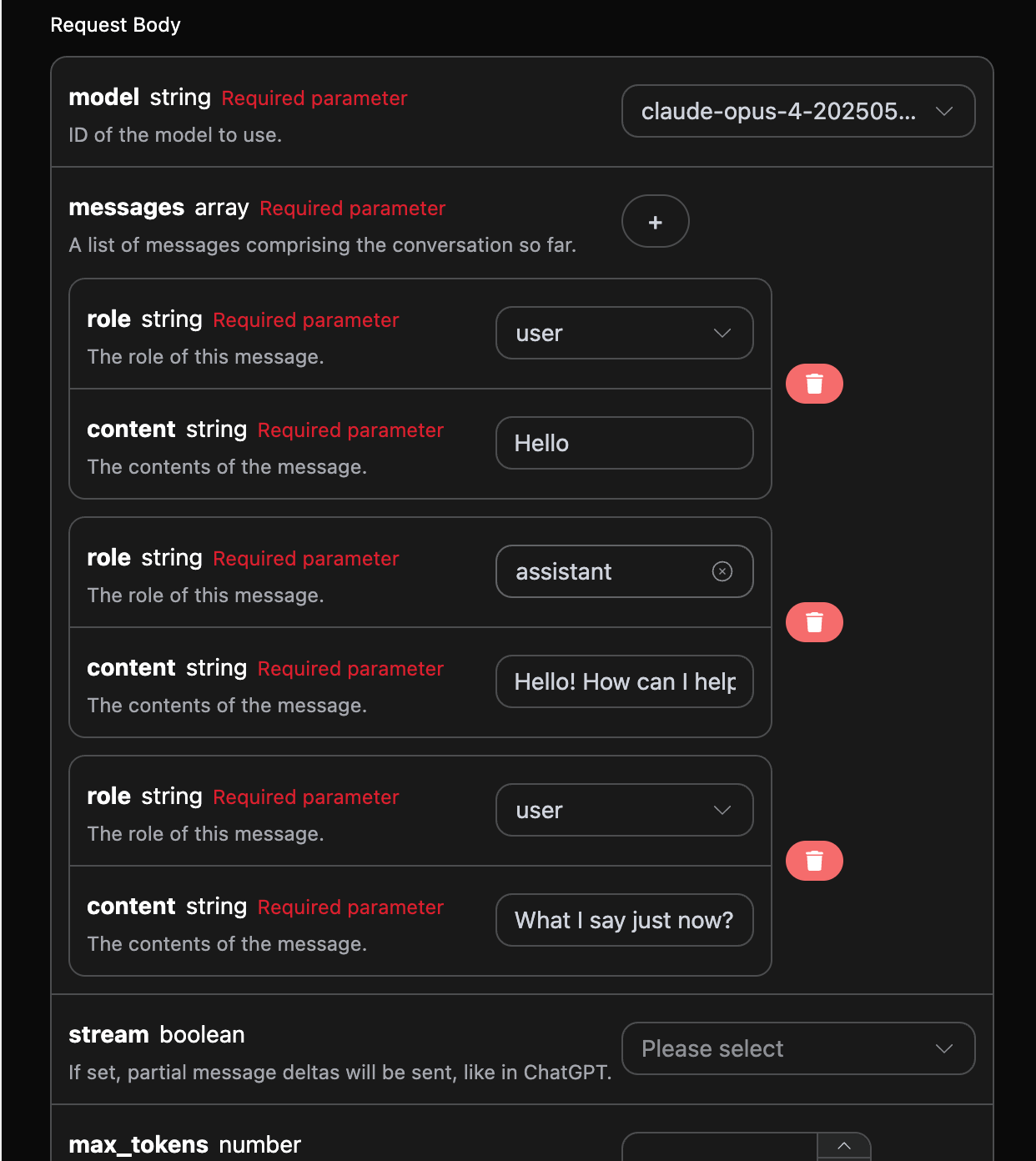

A continuación, puedes completar el contenido correspondiente en la interfaz, como se muestra en la imagen:

authorization, que puedes seleccionar directamente en la lista desplegable. El otro parámetro es model, que es la categoría del modelo de Claude que elegimos usar; aquí tenemos principalmente 20 modelos, y puedes ver los detalles en los modelos que proporcionamos. El último parámetro es messages, que es un array de las palabras clave que ingresamos; es un array que permite subir múltiples palabras clave a la vez, cada una de las cuales contiene role y content, donde role indica el rol del preguntador, y hemos proporcionado tres identidades: user, assistant, system. El otro content es el contenido específico de nuestra pregunta.

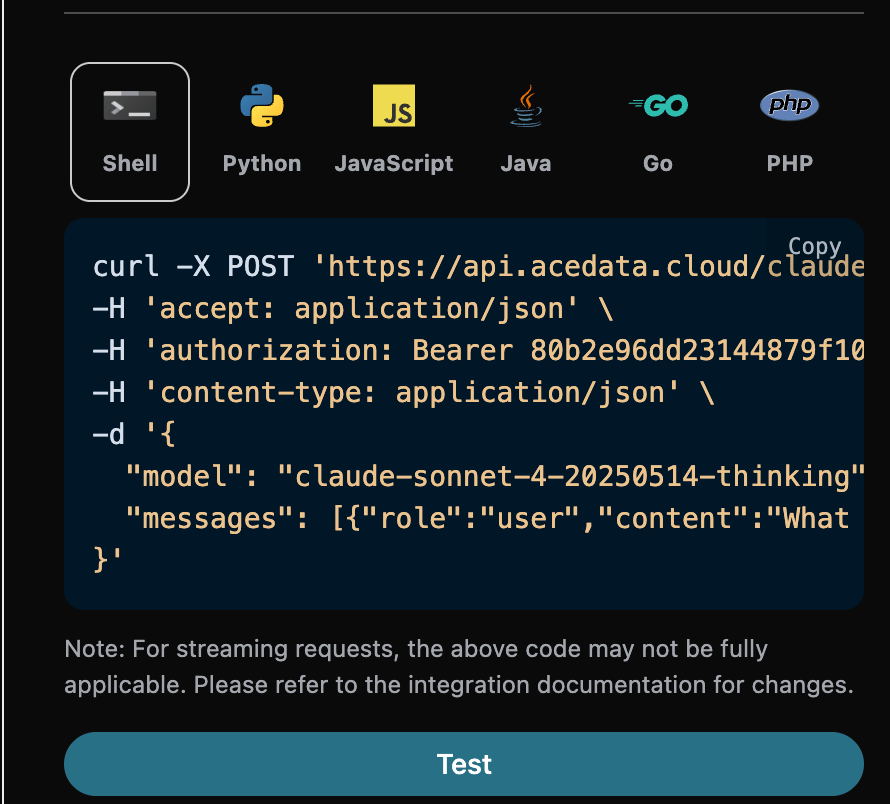

También puedes notar que a la derecha hay un código de llamada correspondiente que puedes copiar y ejecutar directamente, o puedes hacer clic en el botón “Try” para realizar pruebas.

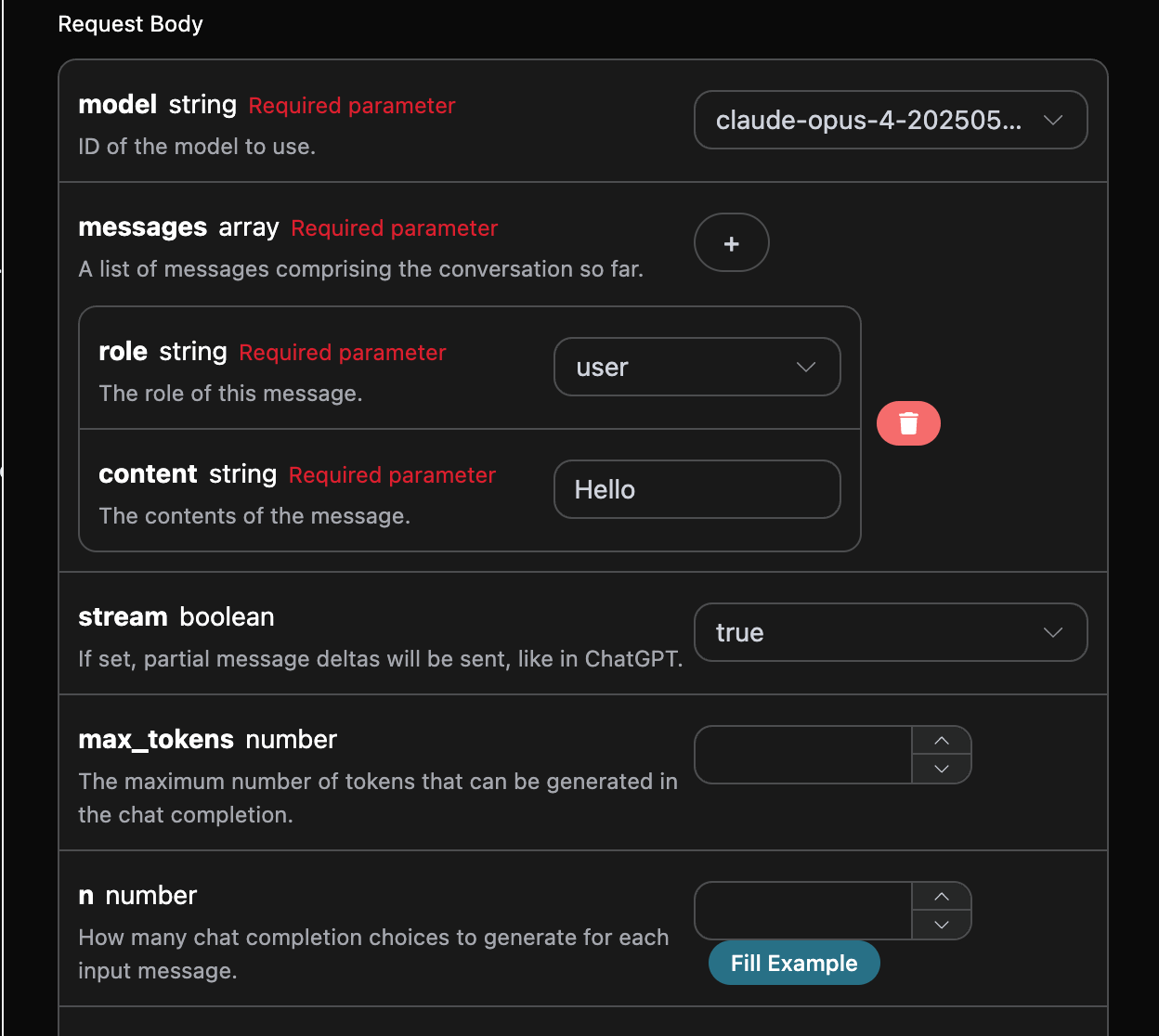

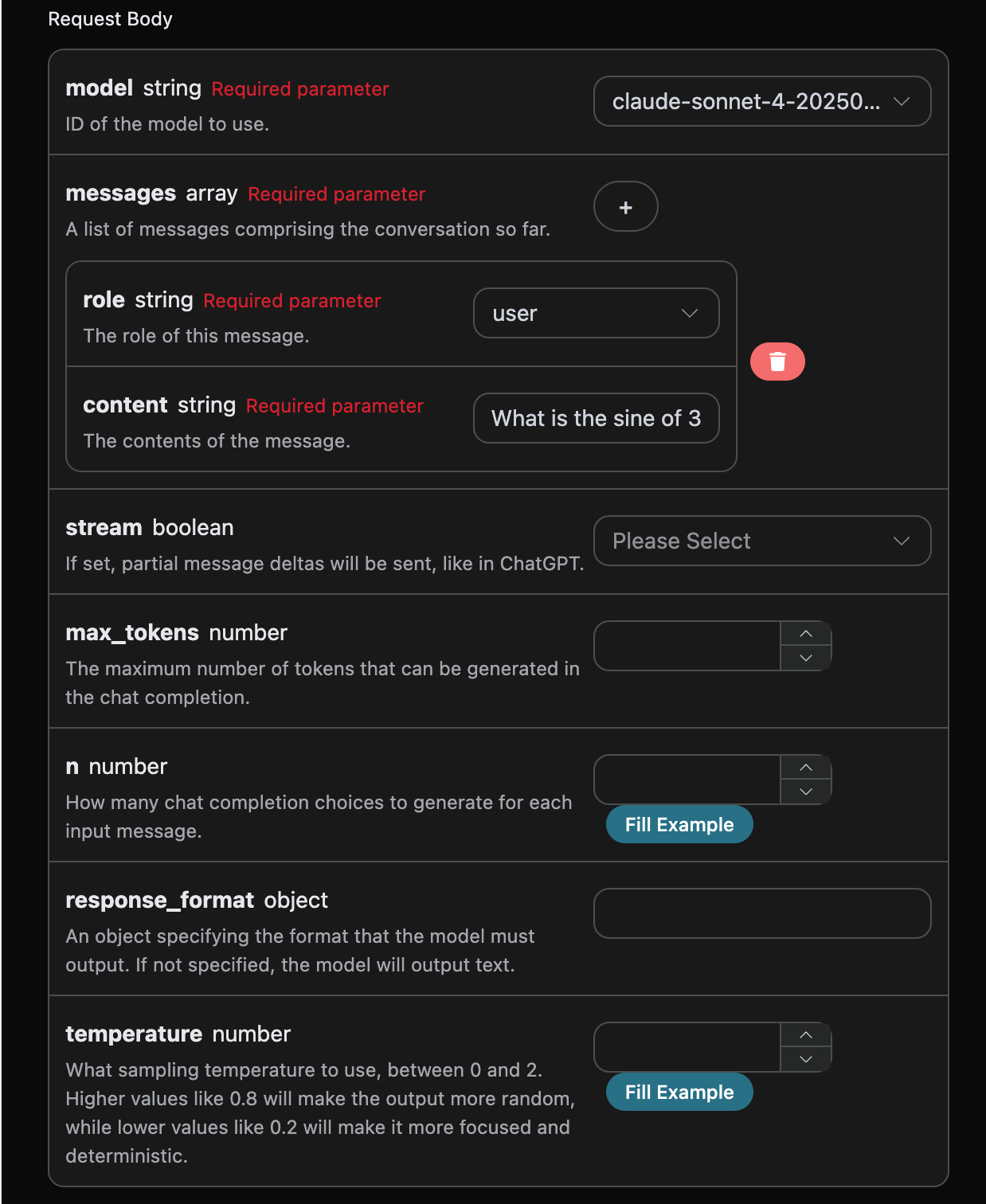

Parámetros opcionales comunes:

max_tokens: limita el número máximo de tokens en una sola respuesta.temperature: aleatoriedad en la generación, entre 0-2, cuanto mayor sea el valor, más disperso será.n: cuántas respuestas candidatas generar a la vez.response_format: configuración del formato de respuesta.

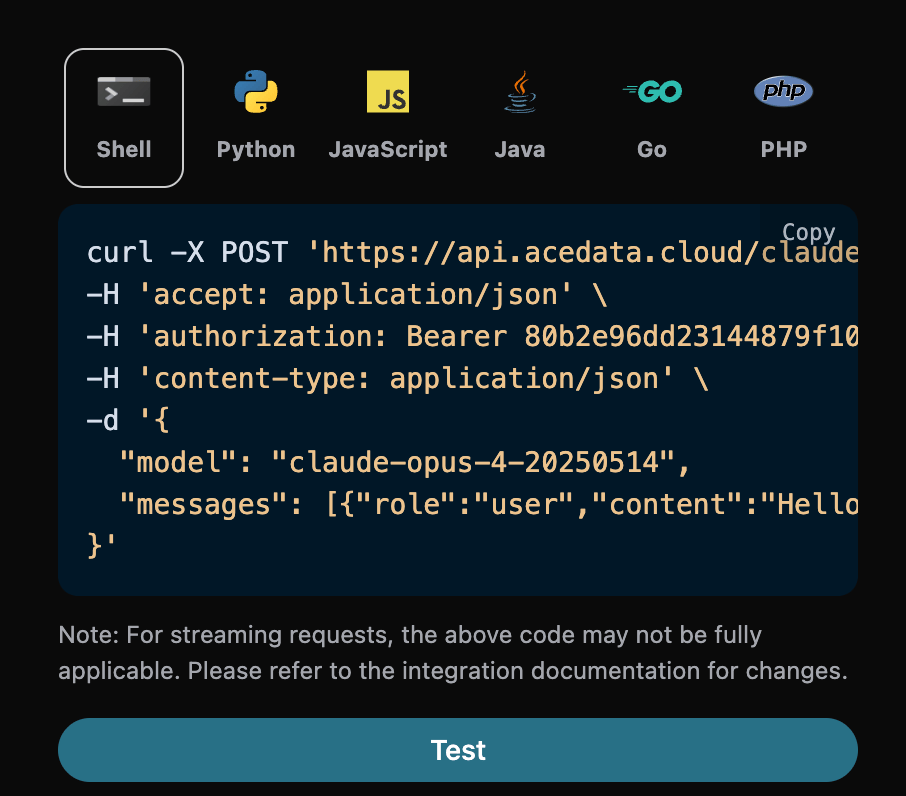

id, el ID de la tarea de conversación generada, utilizado para identificar de manera única esta tarea de conversación.model, el modelo de Claude seleccionado.choices, la información de respuesta que Claude proporciona para las palabras clave.usage: estadísticas sobre el uso de tokens para esta pregunta y respuesta.

choices se incluye la información de respuesta de Claude, donde choices contiene la información específica de la respuesta de Claude, como se puede ver en la imagen.

content dentro de choices contiene el contenido específico de la respuesta de Claude.

Respuesta en Flujo

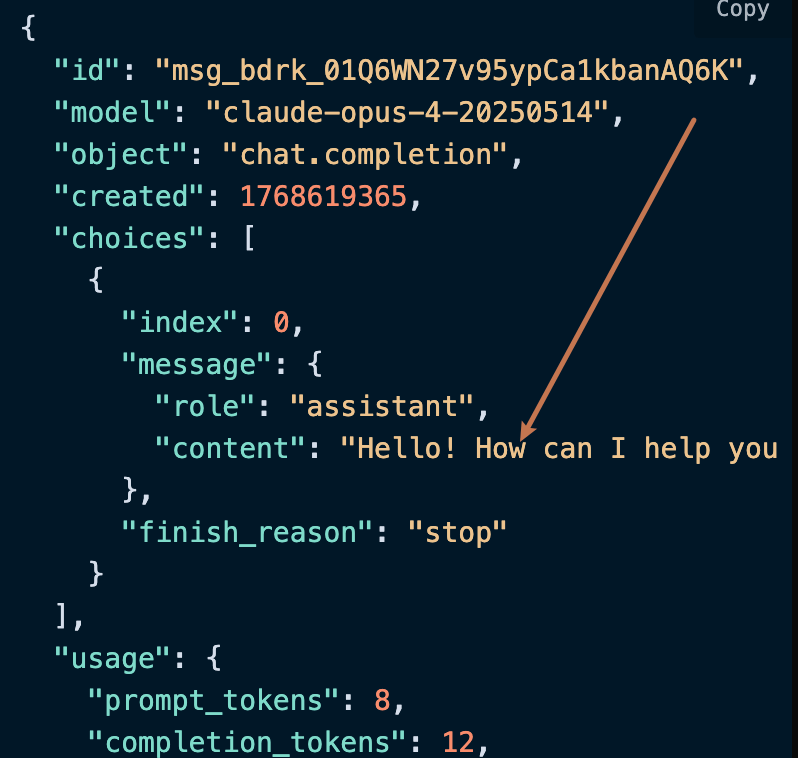

Esta interfaz también admite respuestas en flujo, lo cual es muy útil para la integración en páginas web, ya que permite mostrar el contenido palabra por palabra. Si deseas que la respuesta se devuelva en flujo, puedes cambiar el parámetrostream en el encabezado de la solicitud a true.

El cambio se muestra en la imagen, pero el código de llamada necesita tener los cambios correspondientes para admitir respuestas en flujo.

stream a true, la API devolverá los datos JSON correspondientes línea por línea, y a nivel de código, necesitaremos hacer los cambios necesarios para obtener los resultados línea por línea.

Código de ejemplo de llamada en Python:

data, donde data contiene las choices, que son el contenido de la respuesta más reciente, consistente con el contenido introducido anteriormente. choices es el contenido de respuesta nuevo, que puede ser integrado en su sistema según los resultados. Al mismo tiempo, el final de la respuesta en flujo se determina según el contenido de data; si el contenido es [DONE], significa que la respuesta en flujo ha terminado por completo. El resultado de data devuelto tiene varios campos, que se describen a continuación:

id, el ID que genera esta tarea de conversación, utilizado para identificar de manera única esta tarea de conversación.model, el modelo seleccionado del sitio web de Claude.choices, la información de respuesta que Claude proporciona en respuesta a la consulta.

Diálogo en múltiples rondas

Si desea integrar la función de diálogo en múltiples rondas, necesita cargar múltiples consultas en el campomessages, ejemplos específicos de múltiples consultas se muestran en la imagen a continuación:

choices 包含的信息与基本使用的内容是一致的,这个包含了 Claude 针对多个对话进行回复的具体内容,这样就可以根据多个对话内容来回答对应的问题了。

深度思考模型

claude-opus-4-20250514-thinking 和 claude-sonnet-4-20250514-thinking 模型与其它模型不同,它可以根据提问词来进行深度思考来回答,并且将思考过程的结果返回给你,本文将通过一个具体示例来演示深度思考功能,接下来就可以在 Claude Chat Completion API 界面上填写对应的内容,如图所示:

choices 里面的回答信息是经过深度思考后得到的,并且也给出了相关的思考过程内容,其中在content中reasoning_content表示模型的思考过程。choices 里面的回答信息是要通过 markdown 语法进行渲染,这样才能获得最佳的体验,最后这也体现出我们模型的联网功能的强大优势。

视觉模型

claude-sonnet-4-20250514 是 Claude 开发的多模态大型语言模型,它在 claude-4 的基础上增加了视觉理解能力。这个模型可以同时处理文本和图像输入,实现了跨模态的理解和生成。 使用 claude-sonnet-4-20250514 模型的文本处理是与上文的基本使用内容一致的,下面将简要介绍一下如果使用模型的图像处理能力。 使用 claude-sonnet-4-20250514 模型的图像处理能力主要是通过在原有的content 内容基础上添加一个 type 字段,通过该字段可以知道上传的是文本还是图片,从而使用 claude-sonnet-4-20250514 模型的图像处理能力,下面主要讲述采用 Curl 和 Python 俩种方式来调用该功能。

- Curl 脚本方式

- Python 脚本方式

Manejo de errores

Al llamar a la API, si se encuentra con un error, la API devolverá el código de error y la información correspondiente. Por ejemplo:400 token_mismatched: Solicitud incorrecta, posiblemente debido a parámetros faltantes o inválidos.400 api_not_implemented: Solicitud incorrecta, posiblemente debido a parámetros faltantes o inválidos.401 invalid_token: No autorizado, token de autorización inválido o faltante.429 too_many_requests: Demasiadas solicitudes, ha superado el límite de tasa.500 api_error: Error interno del servidor, algo salió mal en el servidor.