messages. Para completar un diálogo continuo, necesitamos transmitir todo el historial de contexto y también manejar el problema de los tokens que exceden el límite.

La API de preguntas y respuestas de AceDataCloud ha optimizado esta situación, manteniendo la efectividad de las respuestas, encapsulando la implementación del diálogo continuo, de modo que no es necesario preocuparse por la transmisión de los mensajes ni por el problema de los tokens que exceden el límite (la API lo maneja automáticamente internamente). También ofrece funciones para consultar y modificar diálogos, lo que simplifica enormemente la integración.

Este documento presentará la descripción de la integración de la API de preguntas y respuestas de AI.

Proceso de Solicitud

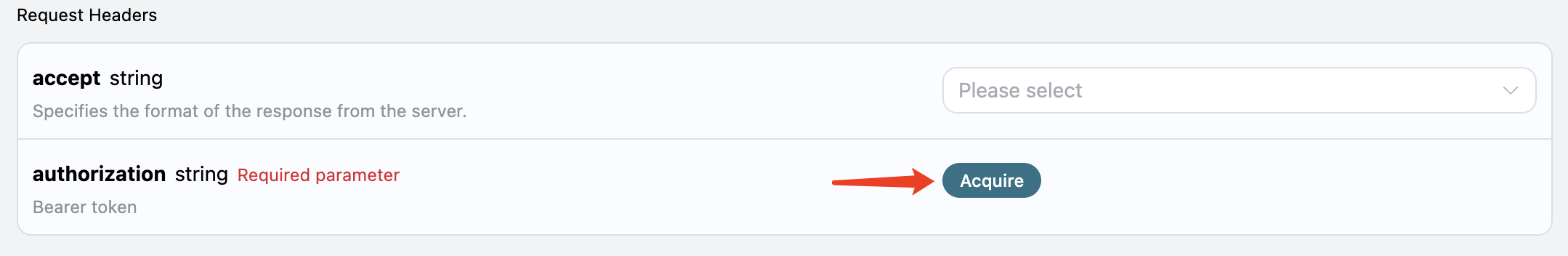

Para usar la API, primero debe ir a la página correspondiente de la API de preguntas y respuestas de AI para solicitar el servicio correspondiente. Una vez en la página, haga clic en el botón “Acquire”, como se muestra en la imagen: Si aún no ha iniciado sesión o registrado, será redirigido automáticamente a la página de inicio de sesión que lo invita a registrarse e iniciar sesión. Después de registrarse e iniciar sesión, será redirigido automáticamente a la página actual.

En la primera solicitud, se le otorgará un crédito gratuito que le permitirá usar la API sin costo.

Si aún no ha iniciado sesión o registrado, será redirigido automáticamente a la página de inicio de sesión que lo invita a registrarse e iniciar sesión. Después de registrarse e iniciar sesión, será redirigido automáticamente a la página actual.

En la primera solicitud, se le otorgará un crédito gratuito que le permitirá usar la API sin costo.

Uso Básico

Primero, comprenda la forma básica de uso, que consiste en ingresar una pregunta y obtener una respuesta. Solo necesita transmitir un campoquestion y especificar el modelo correspondiente.

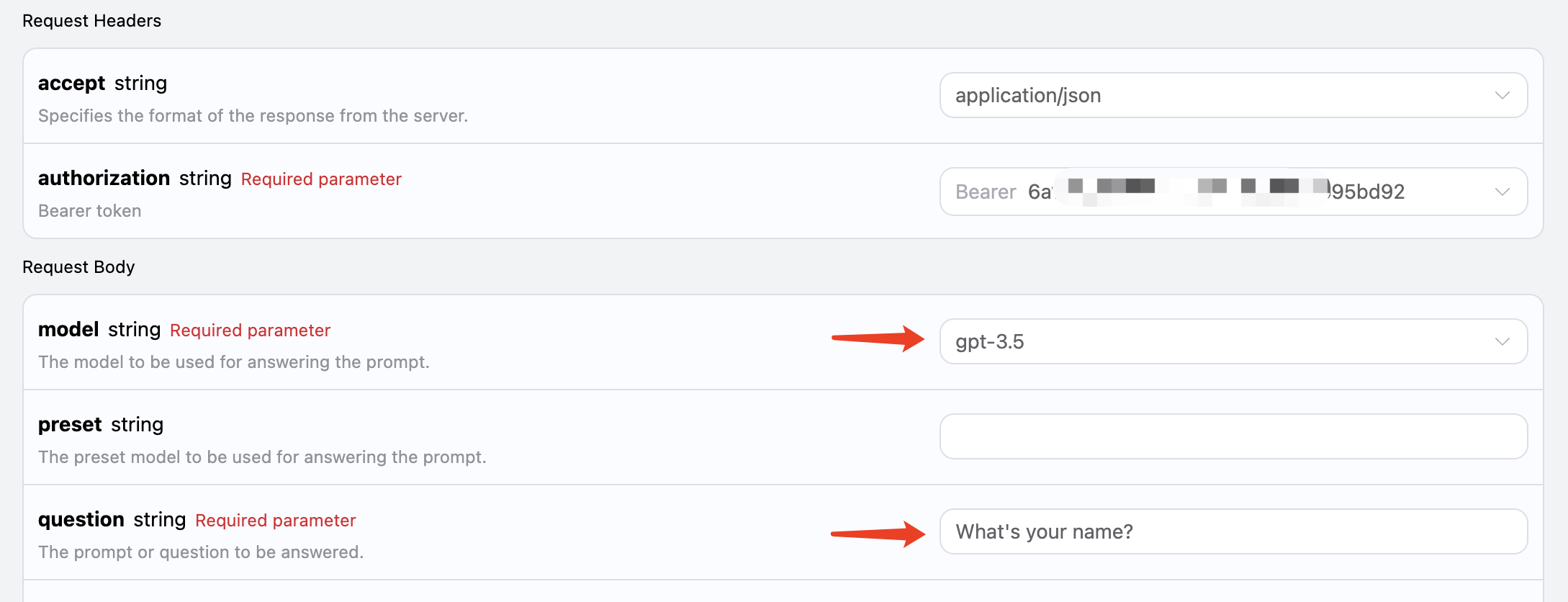

Por ejemplo, si pregunta: “¿Cuál es tu nombre?”, puede llenar el contenido correspondiente en la interfaz, como se muestra en la imagen:

Aquí podemos ver que hemos configurado los Request Headers, que incluyen:

Aquí podemos ver que hemos configurado los Request Headers, que incluyen:

accept: el formato de respuesta que desea recibir, aquí se establece comoapplication/json, es decir, formato JSON.authorization: la clave para llamar a la API, que puede seleccionar directamente después de solicitarla.

model: la selección del modelo, como los populares GPT 3.5, GPT 4, etc.question: la pregunta que necesita hacer, que puede ser cualquier texto plano.

answer, que es la respuesta a la pregunta. Puede ingresar cualquier pregunta y obtener cualquier respuesta.

Si no necesita soporte para diálogos múltiples, esta API puede facilitar enormemente su integración.

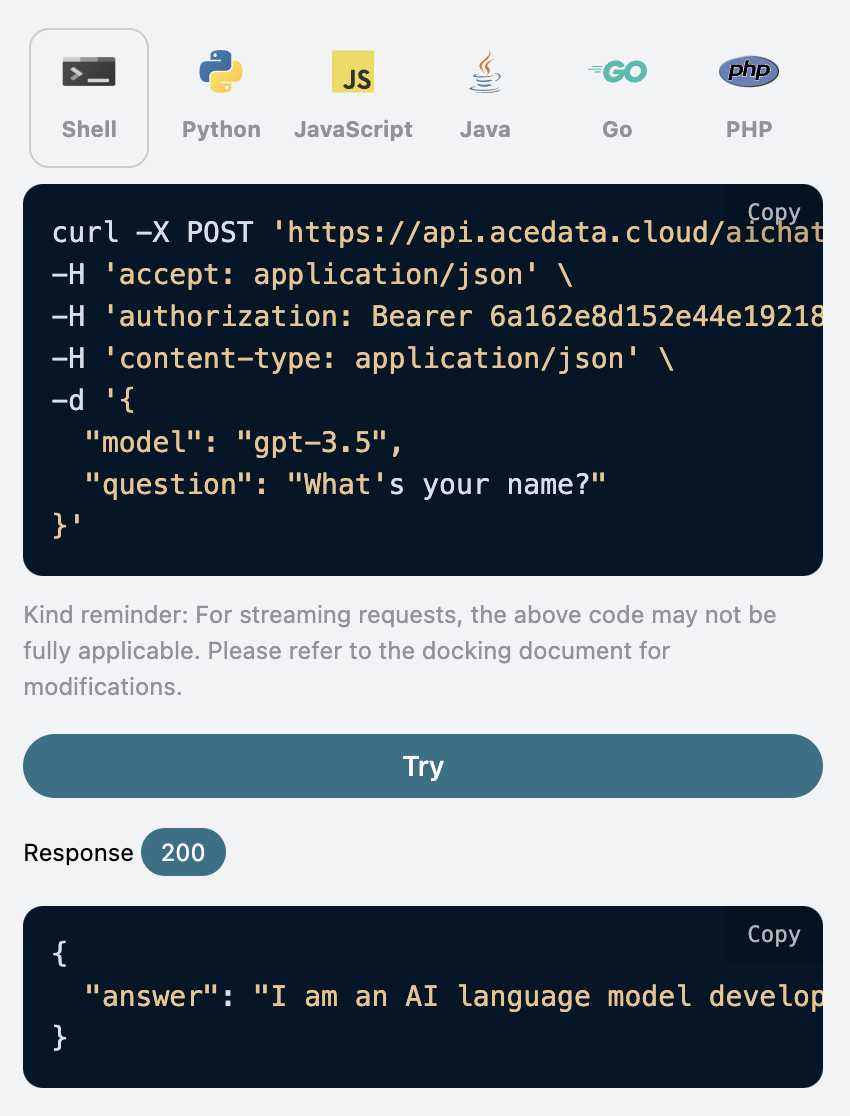

Además, si desea generar el código de integración correspondiente, puede copiarlo directamente, por ejemplo, el código CURL es el siguiente:

Diálogo Múltiple

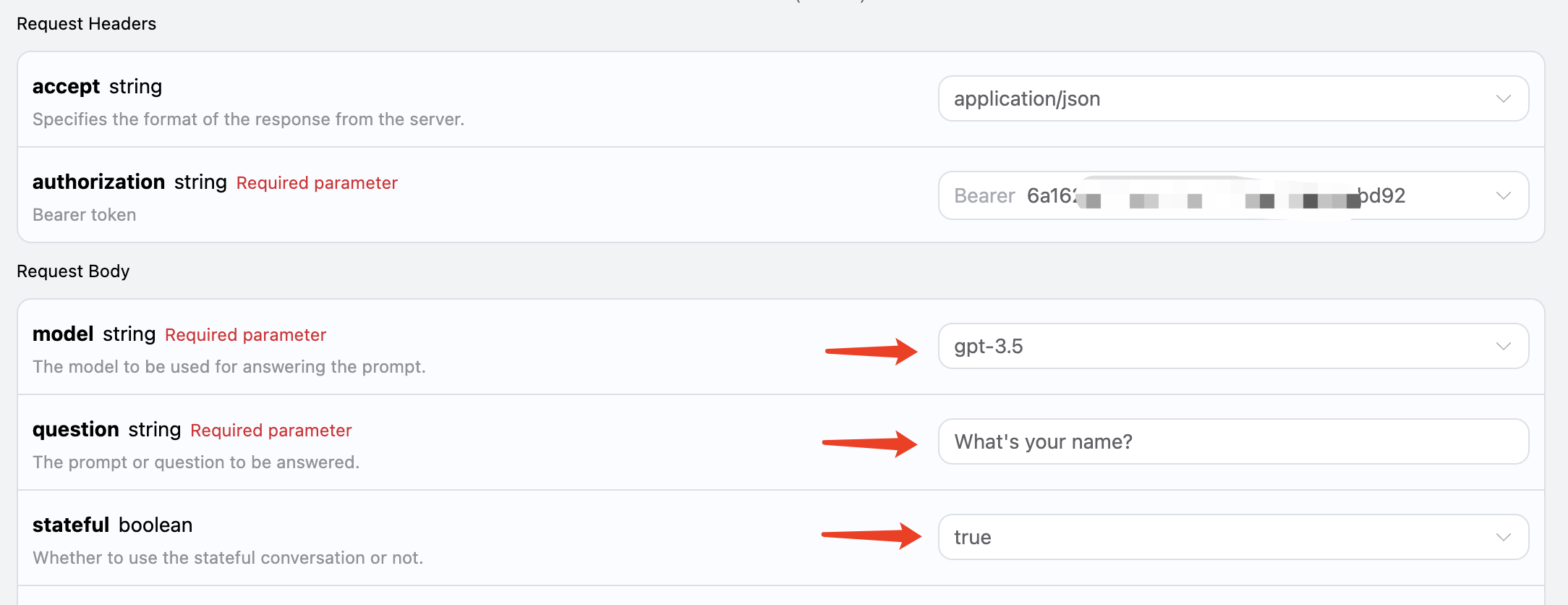

Si desea integrar la función de diálogo múltiple, debe transmitir un parámetro adicionalstateful, cuyo valor debe ser true. En cada solicitud posterior, debe incluir este parámetro. Después de transmitir el parámetro stateful, la API devolverá un parámetro adicional id, que representa el ID de la conversación actual. Posteriormente, solo necesita transmitir este ID como parámetro para lograr fácilmente un diálogo múltiple.

A continuación, demostraremos la operación específica.

En la primera solicitud, establezca el parámetro stateful como true y transmita normalmente los parámetros model y question, como se muestra en la imagen:

El código correspondiente es el siguiente:

El código correspondiente es el siguiente:

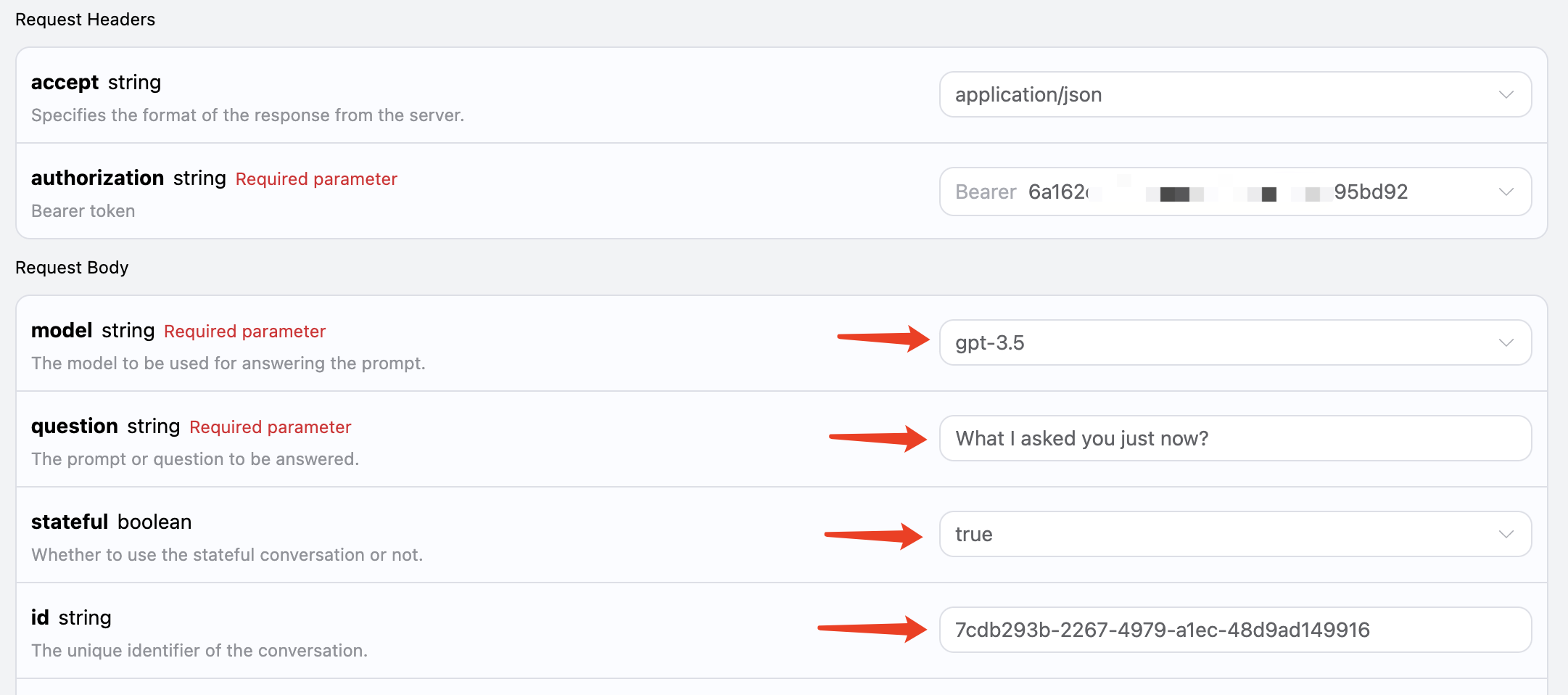

id devuelto en la primera solicitud como parámetro, mientras que el parámetro stateful sigue establecido en true, preguntando “¿Qué te pregunté hace un momento?”, como se muestra en la imagen:

El código correspondiente es el siguiente:

El código correspondiente es el siguiente:

Respuesta en Flujo

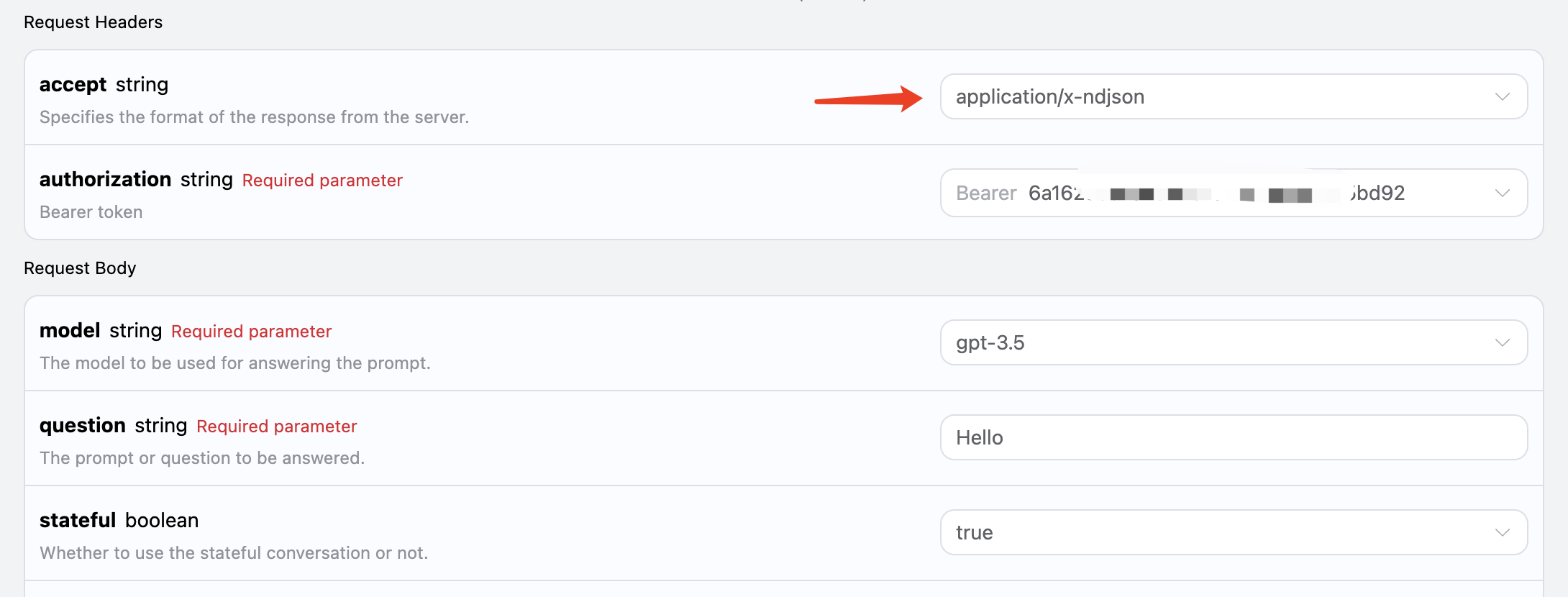

Esta interfaz también admite respuestas en flujo, lo cual es muy útil para la integración en la web, ya que permite mostrar el contenido palabra por palabra. Si desea que la respuesta se devuelva en flujo, puede cambiar el parámetroaccept en los encabezados de la solicitud a application/x-ndjson.

El cambio se muestra en la imagen, pero el código de llamada necesita tener los cambios correspondientes para admitir respuestas en flujo.

Después de cambiar

Después de cambiar accept a application/x-ndjson, la API devolverá los datos JSON correspondientes línea por línea, y a nivel de código, necesitamos hacer los cambios necesarios para obtener los resultados línea por línea.

Código de ejemplo de llamada en Python:

respuesta en la respuesta es el contenido de la respuesta más reciente, delta_answer es el contenido de la respuesta adicional, puede integrar esto en su sistema según los resultados.

JavaScript también es compatible, por ejemplo, el código de llamada en flujo de Node.js es el siguiente:

Configuración del modelo

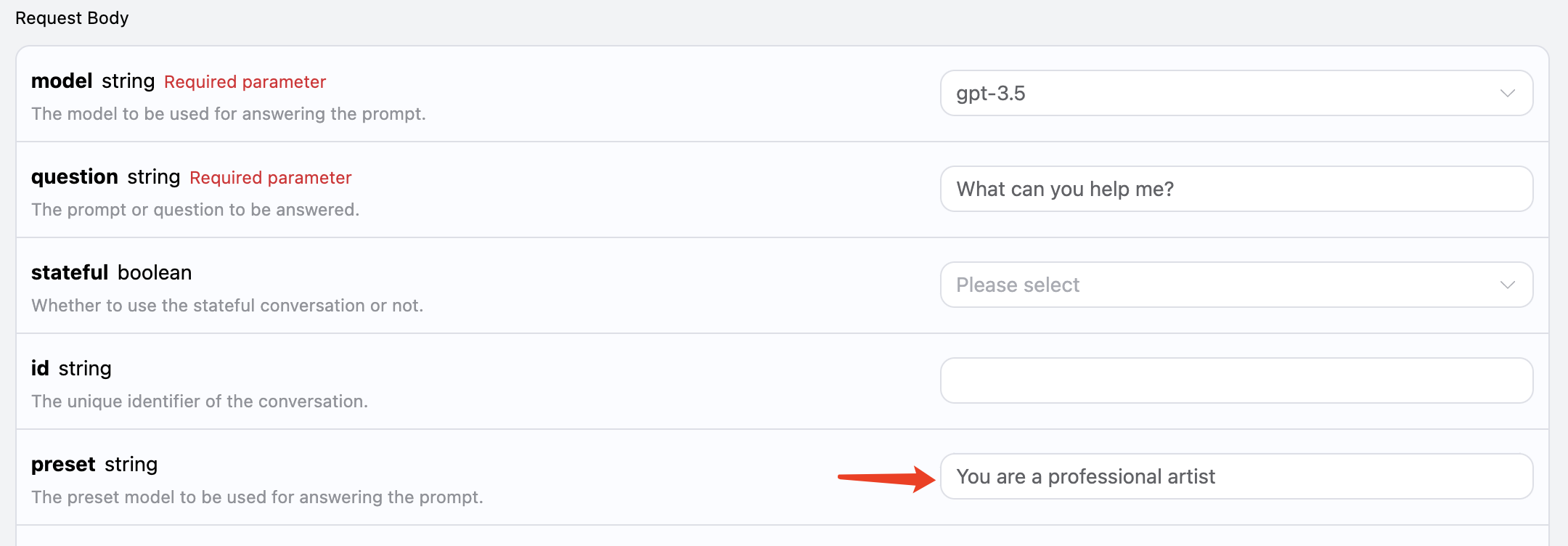

Sabemos que la API relacionada con OpenAI tiene el concepto desystem_prompt, que es establecer una configuración predeterminada para todo el modelo, como su nombre, etc. Esta API de preguntas y respuestas de IA también expone este parámetro, llamado preset, utilizándolo podemos agregar configuraciones predeterminadas al modelo, experimentemos con un ejemplo:

Aquí agregamos el campo preset, cuyo contenido es Eres un artista profesional, como se muestra en la imagen:

El código correspondiente es el siguiente:

El código correspondiente es el siguiente:

Reconocimiento de imágenes

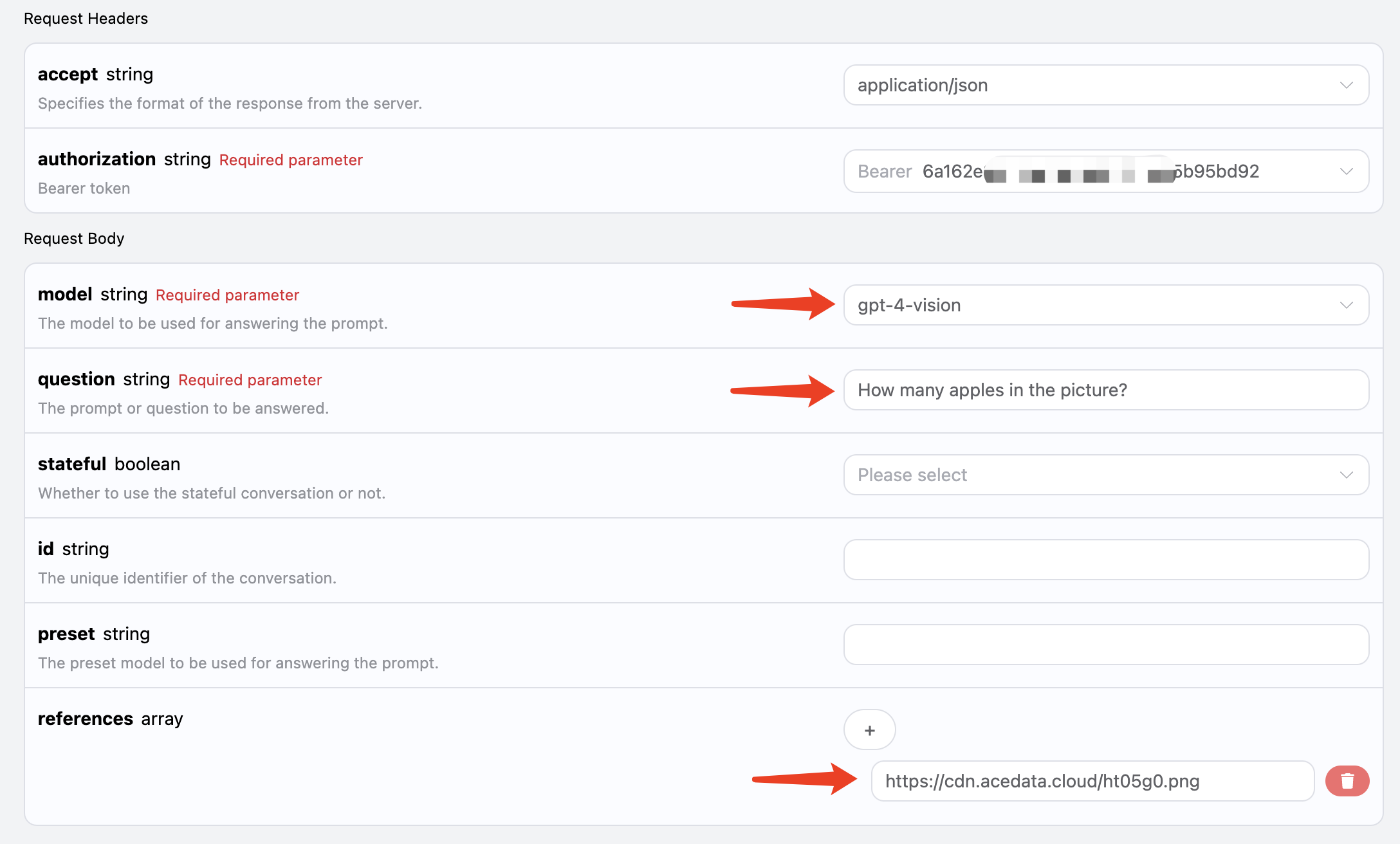

Esta IA también puede soportar la adición de archivos adjuntos para el reconocimiento de imágenes, pasando el enlace de la imagen correspondiente a través dereferences, por ejemplo, aquí tengo una imagen de una manzana, como se muestra en la imagen:

El enlace de esta imagen es https://cdn.acedata.cloud/ht05g0.png, simplemente lo pasamos como parámetro

El enlace de esta imagen es https://cdn.acedata.cloud/ht05g0.png, simplemente lo pasamos como parámetro references, y es importante tener en cuenta que el modelo debe ser uno que soporte reconocimiento visual, actualmente el que soporta es gpt-4-vision, así que la entrada es la siguiente:

El código correspondiente es el siguiente:

El código correspondiente es el siguiente:

Preguntas y respuestas en línea

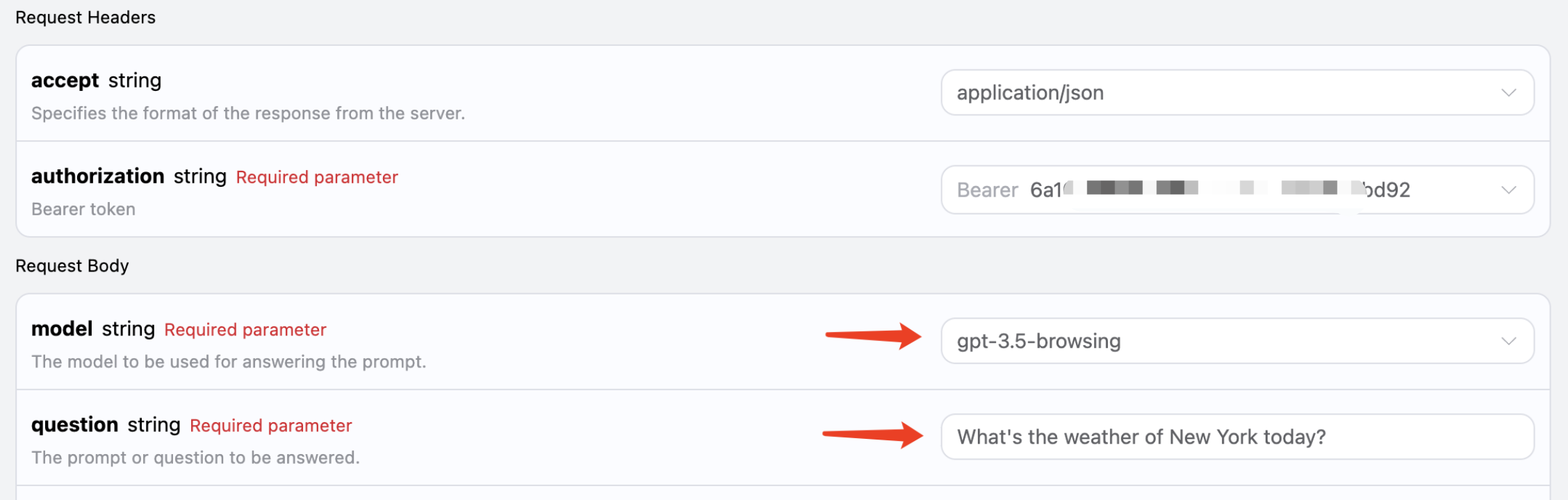

Esta API también soporta modelos en línea, incluyendo GPT-3.5 y GPT-4, ambos pueden soportar, detrás de la API hay un proceso automático de búsqueda en Internet y resumen, podemos elegir el modelo comogpt-3.5-browsing para experimentar, como se muestra en la imagen:

El código es el siguiente:

El código es el siguiente:

Si tienes requisitos más altos sobre la calidad de la respuesta del modelo, puedes cambiar el modelo a gpt-4-browsing, la efectividad de la respuesta será mejor.