Antragsprozess

Um die OpenAI Chat Completion API zu nutzen, können Sie zunächst auf die Seite OpenAI Chat Completion API gehen und auf die Schaltfläche „Acquire“ klicken, um die benötigten Anmeldeinformationen zu erhalten: Wenn Sie noch nicht angemeldet oder registriert sind, werden Sie automatisch zur Anmeldeseite weitergeleitet, um sich zu registrieren und anzumelden. Nach der Anmeldung werden Sie automatisch zur aktuellen Seite zurückgeleitet.

Bei der ersten Antragstellung gibt es ein kostenloses Kontingent, mit dem Sie die API kostenlos nutzen können.

Wenn Sie noch nicht angemeldet oder registriert sind, werden Sie automatisch zur Anmeldeseite weitergeleitet, um sich zu registrieren und anzumelden. Nach der Anmeldung werden Sie automatisch zur aktuellen Seite zurückgeleitet.

Bei der ersten Antragstellung gibt es ein kostenloses Kontingent, mit dem Sie die API kostenlos nutzen können.

Grundlegende Nutzung

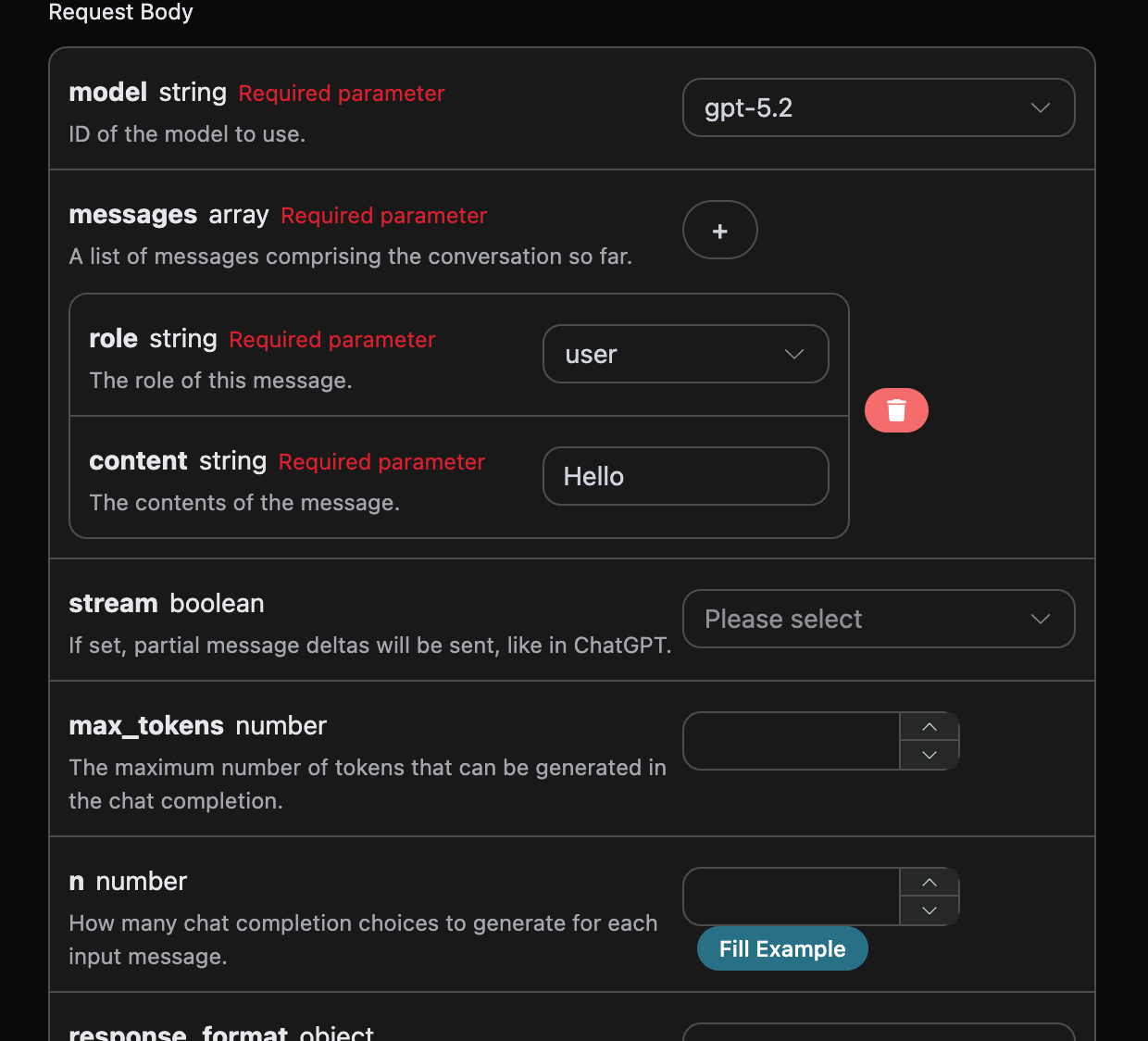

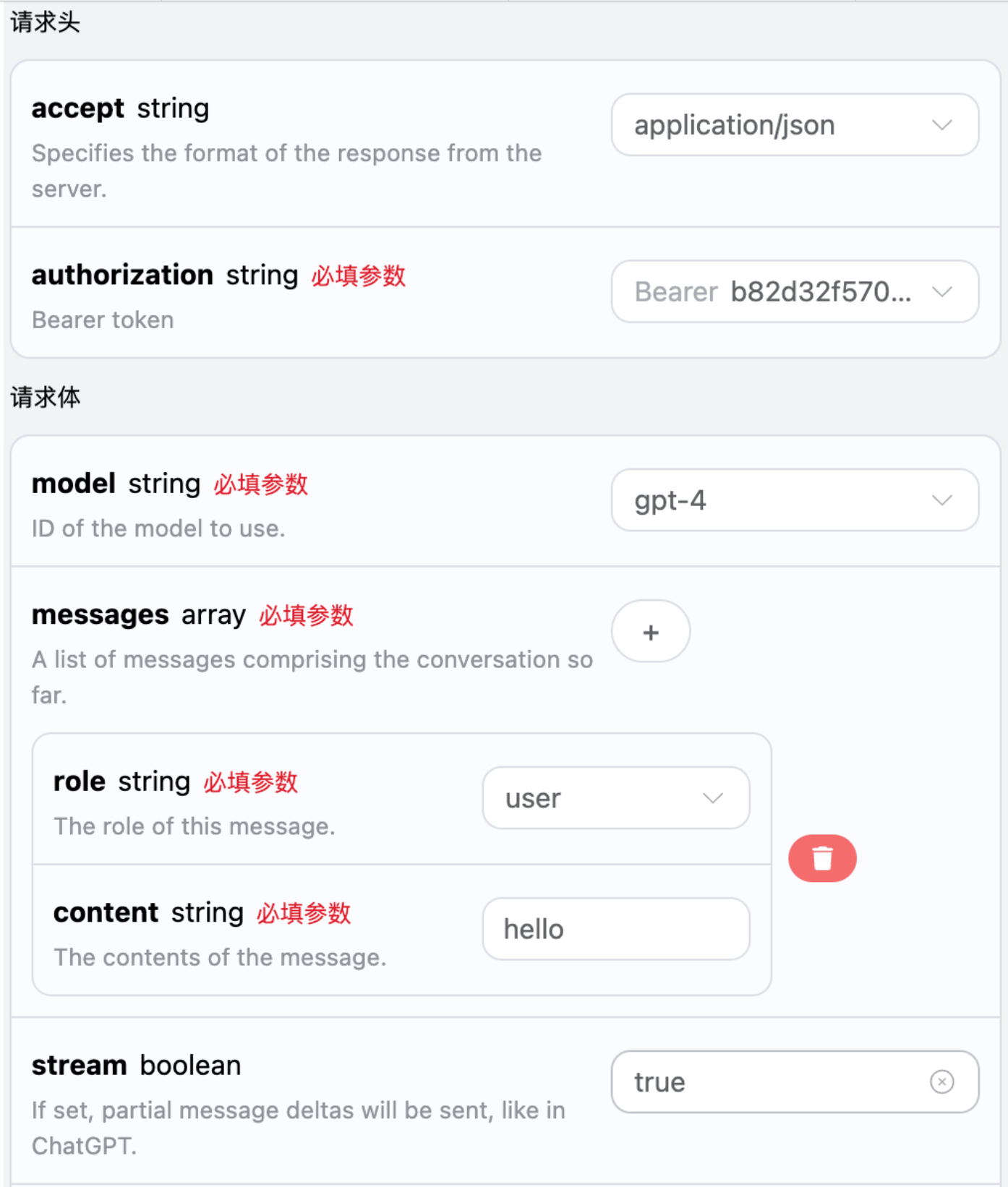

Als Nächstes können Sie die entsprechenden Inhalte im Interface ausfüllen, wie im Bild gezeigt:

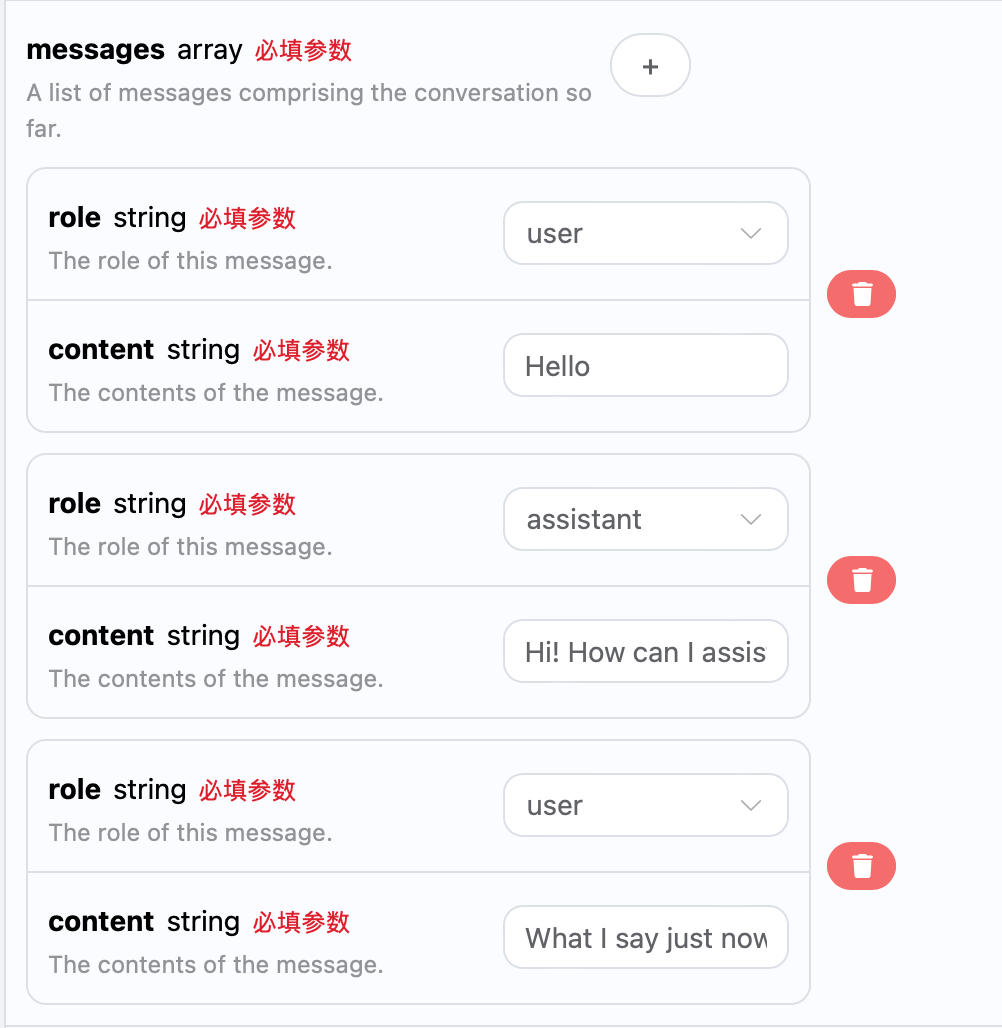

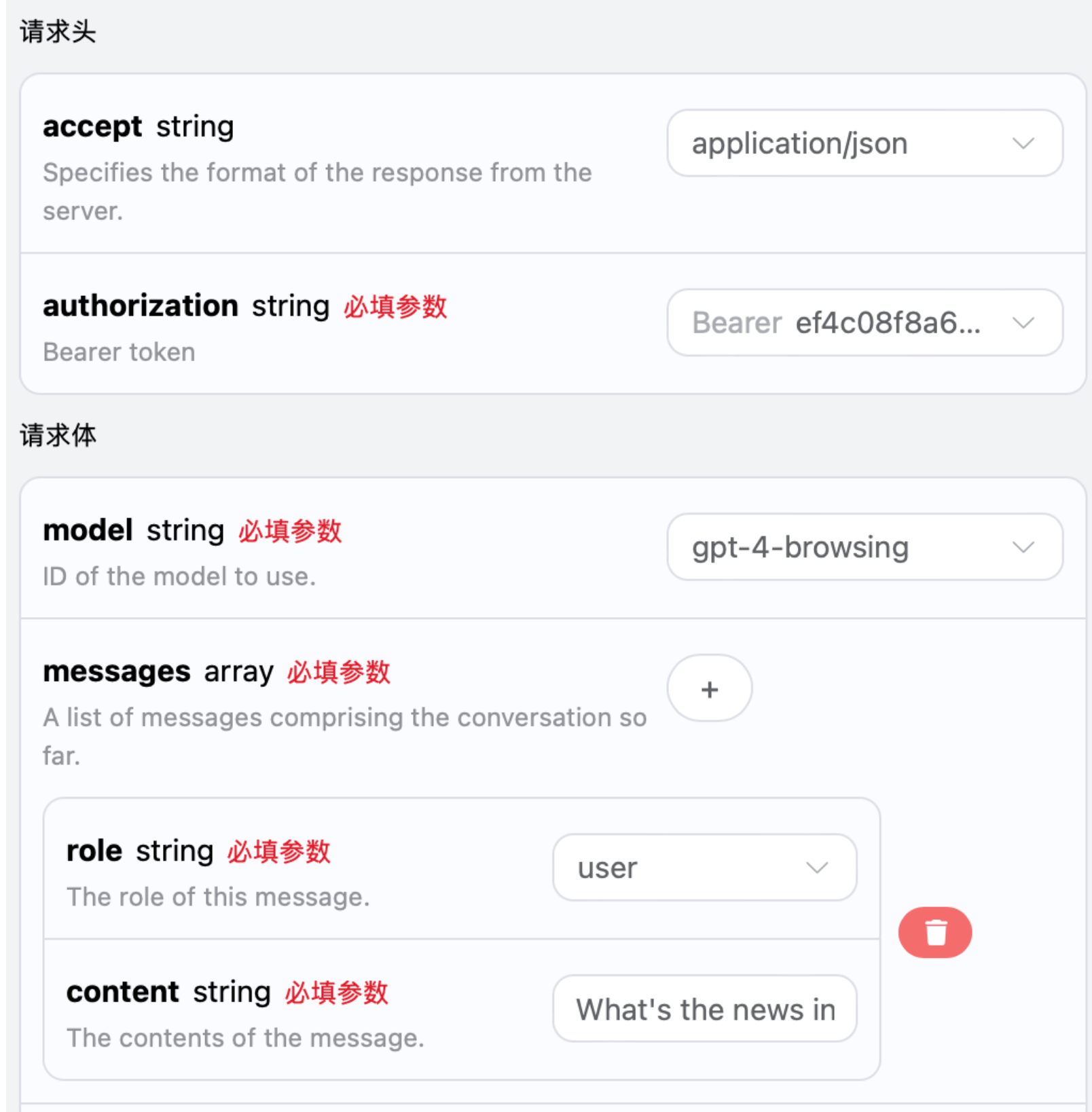

authorization, den Sie einfach aus der Dropdown-Liste auswählen können. Ein weiterer Parameter ist model, model ist die Modellkategorie, die wir für die Nutzung des OpenAI ChatGPT auf der offiziellen Website auswählen. Hier haben wir hauptsächlich 20 Modelle zur Auswahl, die Details können Sie in den bereitgestellten Modellen einsehen. Der letzte Parameter ist messages, messages ist das Array der von uns eingegebenen Fragen, es handelt sich um ein Array, das mehrere Fragen gleichzeitig hochladen kann, wobei jede Frage role und content enthält, wobei role die Rolle des Fragestellers angibt. Wir bieten drei Identitäten an: user, assistant, system. Das andere content ist der spezifische Inhalt unserer Frage.

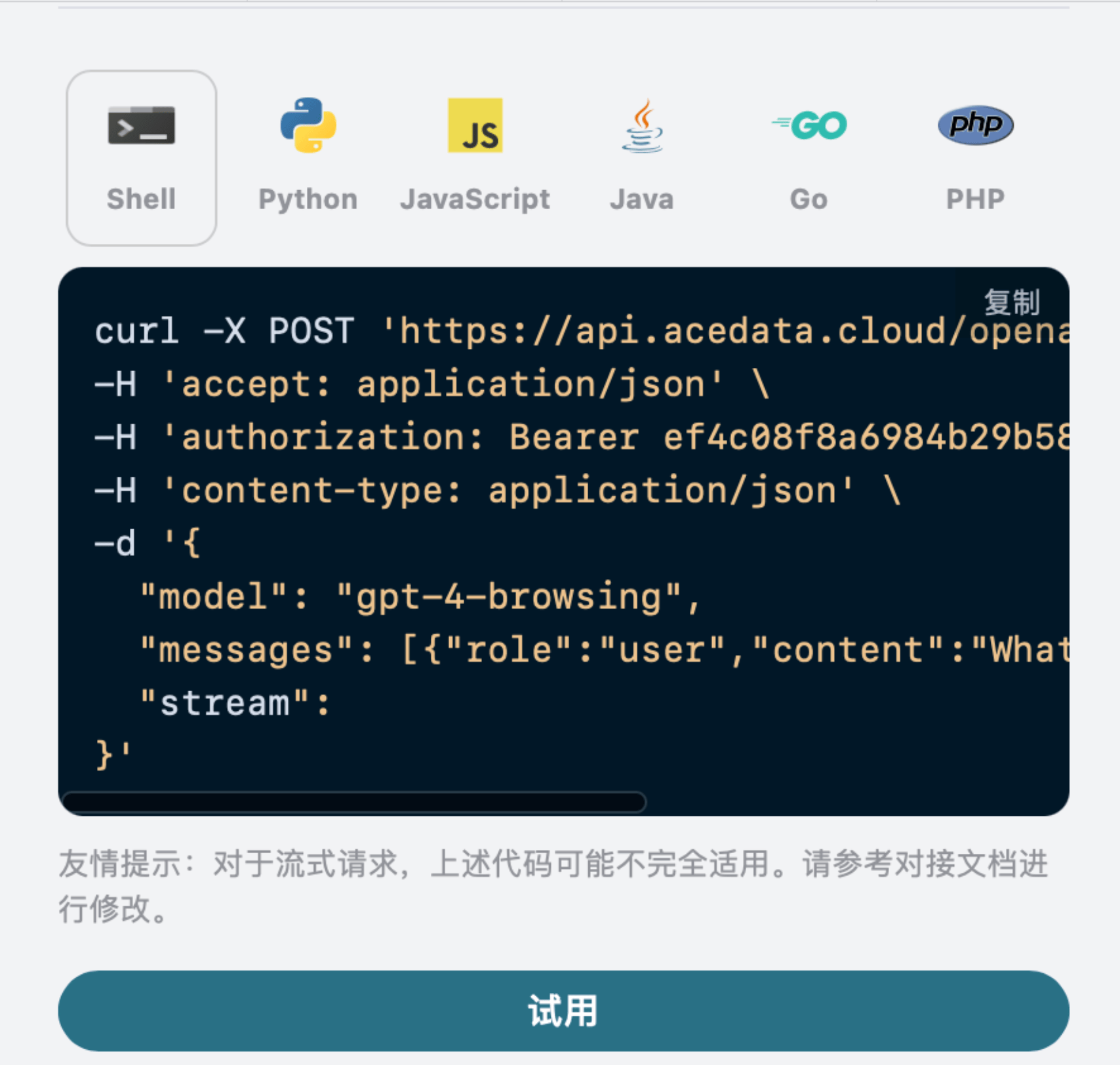

Gleichzeitig können Sie auf der rechten Seite den entsprechenden Code zur Aufrufgenerierung sehen, den Sie kopieren und direkt ausführen oder einfach auf die Schaltfläche „Try“ klicken können, um einen Test durchzuführen.

Häufig verwendete optionale Parameter:

max_tokens: Begrenzung der maximalen Token-Anzahl pro Antwort.temperature: Generierungsrandomisierung, zwischen 0-2, je höher der Wert, desto divergenter.n: Anzahl der zu generierenden Antwortvorschläge auf einmal.response_format: Einstellung des Rückgabeformats.

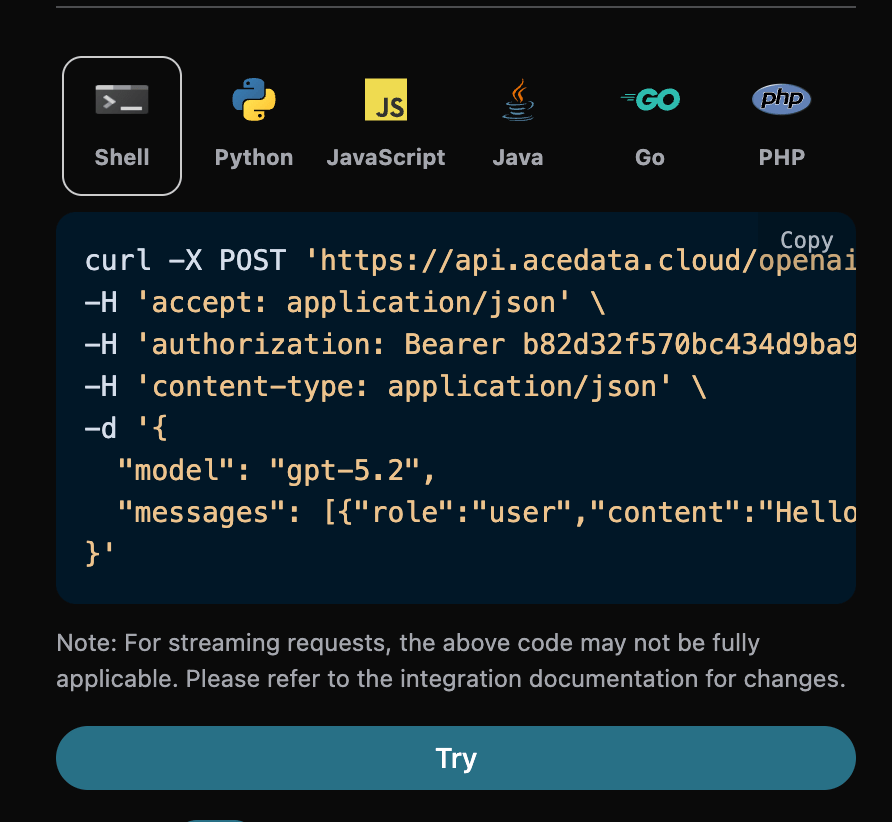

id, die ID der generierten Dialogaufgabe, die zur eindeutigen Identifizierung dieser Dialogaufgabe dient.model, das gewählte OpenAI ChatGPT-Modell.choices, die Antwortinformationen von ChatGPT auf die Fragen.usage: Statistische Informationen zu den Tokens für diese Frage-Antwort-Interaktion.

choices das, was die Antwortinformationen von ChatGPT enthält, und innerhalb von choices können wir sehen, wie im Bild gezeigt.

content innerhalb von choices den spezifischen Inhalt der Antwort von ChatGPT.

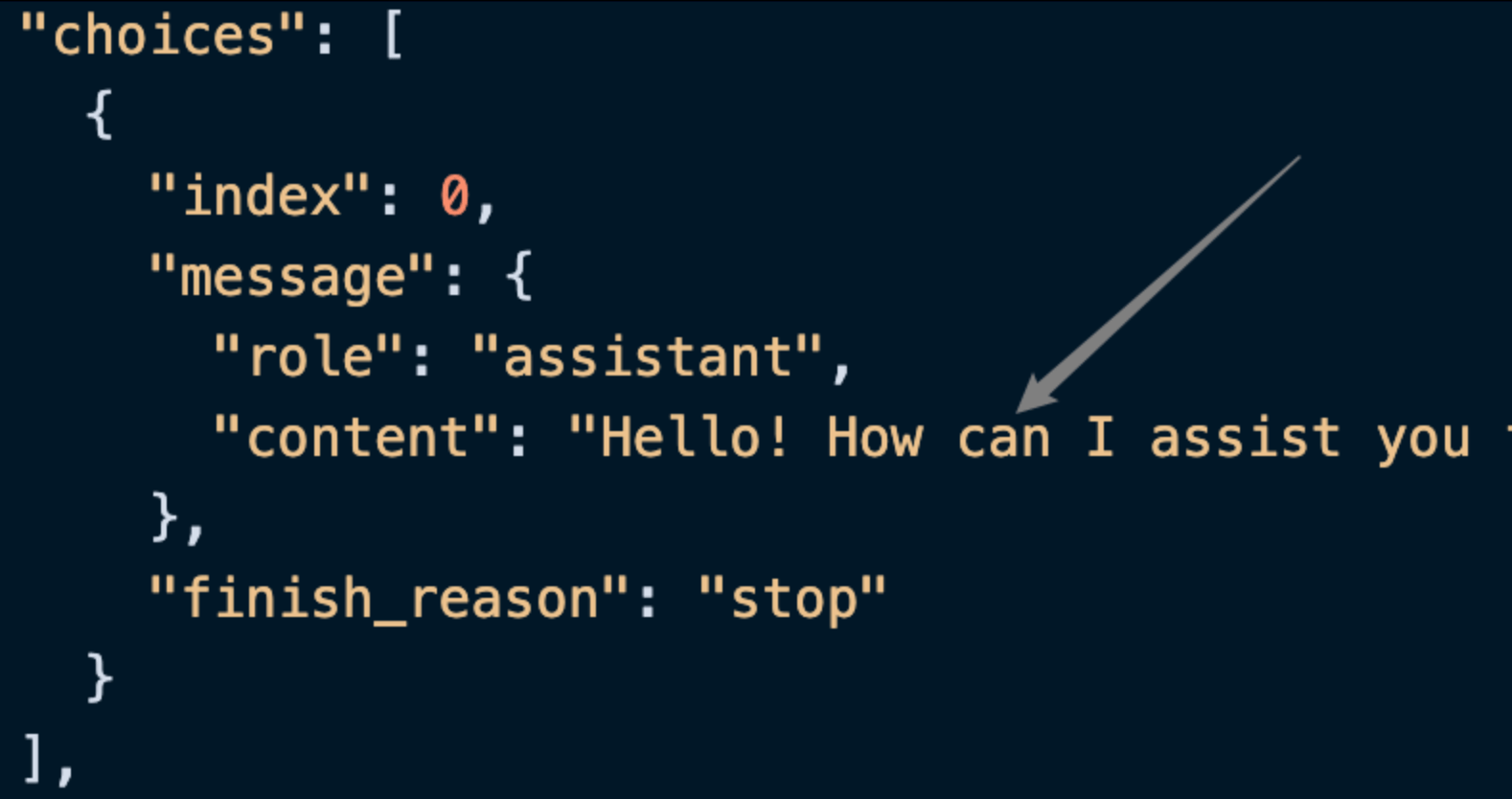

Stream-Antwort

Diese Schnittstelle unterstützt auch Stream-Antworten, was für die Integration in Webseiten sehr nützlich ist, da es ermöglicht, die Ausgabe zeilenweise anzuzeigen. Wenn Sie eine Stream-Antwort zurückgeben möchten, können Sie denstream-Parameter im Header der Anfrage auf true ändern.

Die Änderung ist wie im Bild gezeigt, jedoch muss der Aufrufcode entsprechend geändert werden, um Stream-Antworten zu unterstützen.

stream auf true geändert haben, gibt die API die entsprechenden JSON-Daten zeilenweise zurück. Auf der Code-Ebene müssen wir entsprechende Änderungen vornehmen, um die zeilenweisen Ergebnisse zu erhalten.

Beispielaufrufcode in Python:

data enthält, wobei data die neuesten Antwortinhalte in choices sind, die mit dem oben beschriebenen Inhalt übereinstimmen. choices sind die neuen Antwortinhalte, die Sie in Ihr System integrieren können. Das Ende der Streaming-Antwort wird anhand des Inhalts von data bestimmt; wenn der Inhalt [DONE] ist, bedeutet dies, dass die Streaming-Antwort vollständig beendet ist. Die zurückgegebenen data-Ergebnisse haben mehrere Felder, die wie folgt beschrieben werden:

id, die ID der generierten Dialogaufgabe, um diese eindeutig zu kennzeichnen.model, das gewählte OpenAI ChatGPT-Modell.choices, die Antwortinformationen von ChatGPT auf die Fragen.

Mehrere Runden im Dialog

Wenn Sie die Funktion für mehrere Runden im Dialog integrieren möchten, müssen Sie mehrere Fragen im Feldmessages hochladen. Ein konkretes Beispiel für mehrere Fragen ist im folgenden Bild dargestellt:

choices mit dem grundlegenden Inhalt übereinstimmen, der die spezifischen Antworten von ChatGPT auf mehrere Gespräche enthält, sodass man basierend auf mehreren Gesprächsinhalten die entsprechenden Fragen beantworten kann.

Anbindung an OpenAI-Python

Der OpenAI Chat Completion API-Dienst wird von dem offiziellen OpenAI-Dienst bereitgestellt, weitere Informationen finden Sie in der offiziellen OpenAI-Python. In diesem Artikel wird kurz erläutert, wie man den bereitgestellten Dienst nutzen kann.- Zuerst müssen Sie eine lokale

Python-Umgebung einrichten, dieser Prozess kann durch eine Google-Suche gefunden werden. - Installieren Sie eine Entwicklungsumgebung, z. B. den VSCode-Editor.

- Konfigurieren Sie die

OpenAI-Umgebungsvariablen.

- Erstellen Sie im Projektordner eine Datei mit dem Namen

.envund speichern Sie sie. - Inhalt der

.env-Datei:

sk-xxx durch Ihren eigenen Key. OPENAI_BASE_URL ist die Proxy-Schnittstelle zum Zugriff auf OpenAI.

- Installieren Sie die Abhängigkeiten des Projekts

- Erstellen Sie eine Beispiel-Quellcodedatei

index.py erstellt, deren Inhalt wie folgt aussieht:

Online-Modell

Die Modelle gpt-3.5-browsing und gpt-4-browsing unterscheiden sich von anderen Modellen, da sie basierend auf den Fragen eine Online-Suche durchführen können und die Ergebnisse der Online-Suche entsprechend anpassen und zurückgeben. In diesem Artikel wird ein konkretes Beispiel zur Demonstration der Online-Funktionalität gegeben, und Sie können die entsprechenden Inhalte im OpenAI Chat Completion API-Bereich ausfüllen, wie im Bild gezeigt:

choices basierend auf der Online-Abfrage erhalten wurden und auch die entsprechenden Links bereitgestellt wurden. Die Antwortinformationen in choices müssen mit Markdown-Syntax gerendert werden, um die beste Erfahrung zu erzielen, und letztendlich zeigt dies auch die starke Vorteilhaftigkeit der Online-Funktionalität unseres Modells.

Visuelles Modell

gpt-4o ist ein multimodales großes Sprachmodell, das von OpenAI entwickelt wurde und auf GPT-4 basiert, wobei die visuelle Verständnisfähigkeit hinzugefügt wurde. Dieses Modell kann gleichzeitig Text- und Bild-Eingaben verarbeiten und ermöglicht ein übergreifendes Verständnis und Generierung. Die Textverarbeitung mit dem gpt-4o-Modell ist mit dem grundlegenden Inhalt der vorherigen Verwendung identisch. Im Folgenden wird kurz erläutert, wie man die Bildverarbeitungsfähigkeiten des Modells nutzen kann. Die Bildverarbeitungsfähigkeiten des gpt-4o-Modells werden hauptsächlich durch das Hinzufügen einestype-Feldes zu den ursprünglichen content-Inhalten aktiviert, durch das man erkennen kann, ob Text oder Bild hochgeladen wurde, um die Bildverarbeitungsfähigkeiten des gpt-4o-Modells zu nutzen. Im Folgenden werden hauptsächlich zwei Methoden zur Nutzung dieser Funktion beschrieben: Curl und Python.

- Curl-Skript-Methode

- Python-Skript-Methode

GPT-4o Zeichnungsmodell

Beispielanfrage:Fehlerbehandlung

Bei der API-Anfrage, wenn ein Fehler auftritt, gibt die API den entsprechenden Fehlercode und die Informationen zurück. Zum Beispiel:400 token_mismatched: Ungültige Anfrage, möglicherweise aufgrund fehlender oder ungültiger Parameter.400 api_not_implemented: Ungültige Anfrage, möglicherweise aufgrund fehlender oder ungültiger Parameter.401 invalid_token: Unbefugt, ungültiger oder fehlender Autorisierungstoken.429 too_many_requests: Zu viele Anfragen, Sie haben das Rate-Limit überschritten.500 api_error: Interner Serverfehler, etwas ist auf dem Server schiefgelaufen.