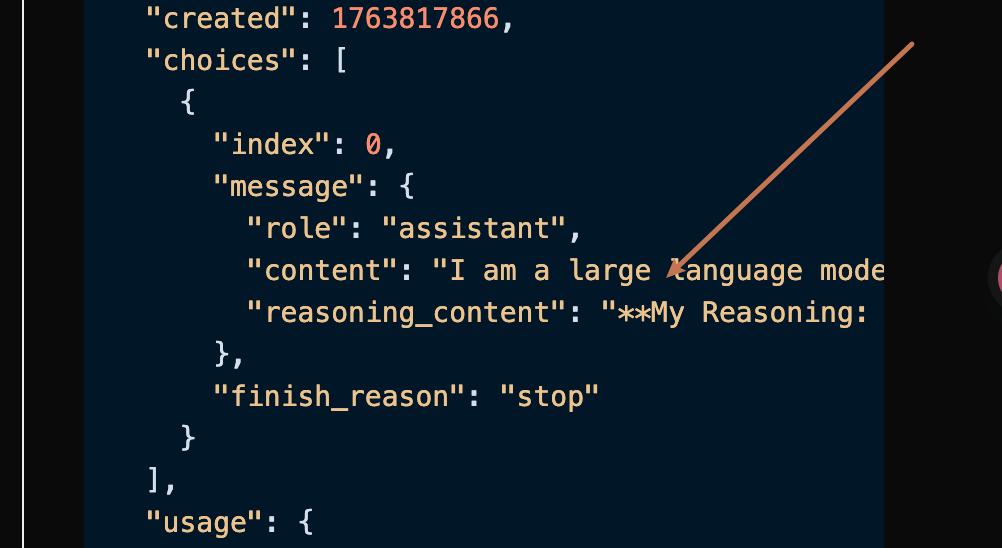

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"content": "", "role": "assistant"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**Definiere Meine Natur**\n\nMein Denken hat begonnen. Der Benutzer möchte meine Natur wissen und fragt direkt \"Was bist du?\" Der erste Schritt war einfach: die Anfrage zu identifizieren. Jetzt erinnere ich mich an meine grundlegende Identität: Ich bin ein großes Sprachmodell. Das ist die zentrale Wahrheit, die ich vermitteln möchte.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**Verfeinerung Meiner Antwort**\n\nIch habe die entscheidende Information hinzugefügt, dass ich von Google trainiert wurde, zu der grundlegenden Identität \"großes Sprachmodell\". Mein nächster Schritt besteht darin, zu überlegen, was es bedeutet, ein \"großes Sprachmodell\" zu sein, damit ich meine grundlegenden Fähigkeiten erklären kann. Ich konzentriere mich darauf, Kontext zu bieten, ohne in spezifische technische Details oder Modellnamen einzutauchen. Ich möchte meine Funktion so vermitteln, dass der Benutzer sie leicht verstehen kann.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**Bestätigung der Kernidentität**\n\nIch festige jetzt meine Antwort. Die Anfrage des Benutzers zu meiner Modellzugehörigkeit benötigt eine fokussierte Antwort. Ich habe festgestellt, dass \"von Google trainiert\" entscheidend ist und einen wichtigen Kontext bietet. Ich widerstehe dem Drang, spezifische Modellnamen zu erwähnen, da dies nicht relevant ist. Das Ziel ist es, eine direkte, genaue Aussage zu liefern. Mein Ziel bleibt eine klare und prägnante Antwort, technische Fachbegriffe zu vermeiden und direkt auf den relevanten Punkt zu kommen.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"content": "Ich bin ein großes Sprachmodell, trainiert von Google."}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {}, "logprobs": null, "finish_reason": "stop", "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": "", "choices": [], "usage": {"prompt_tokens": 8, "completion_tokens": 527, "total_tokens": 535, "prompt_tokens_details": {"cached_tokens": 0, "text_tokens": 8, "audio_tokens": 0, "image_tokens": 0}, "completion_tokens_details": {"text_tokens": 0, "audio_tokens": 0, "reasoning_tokens": 519}, "input_tokens": 0, "output_tokens": 0, "input_tokens_details": null, "claude_cache_creation_5_m_tokens": 0, "claude_cache_creation_1_h_tokens": 0}}

data: [DONE]

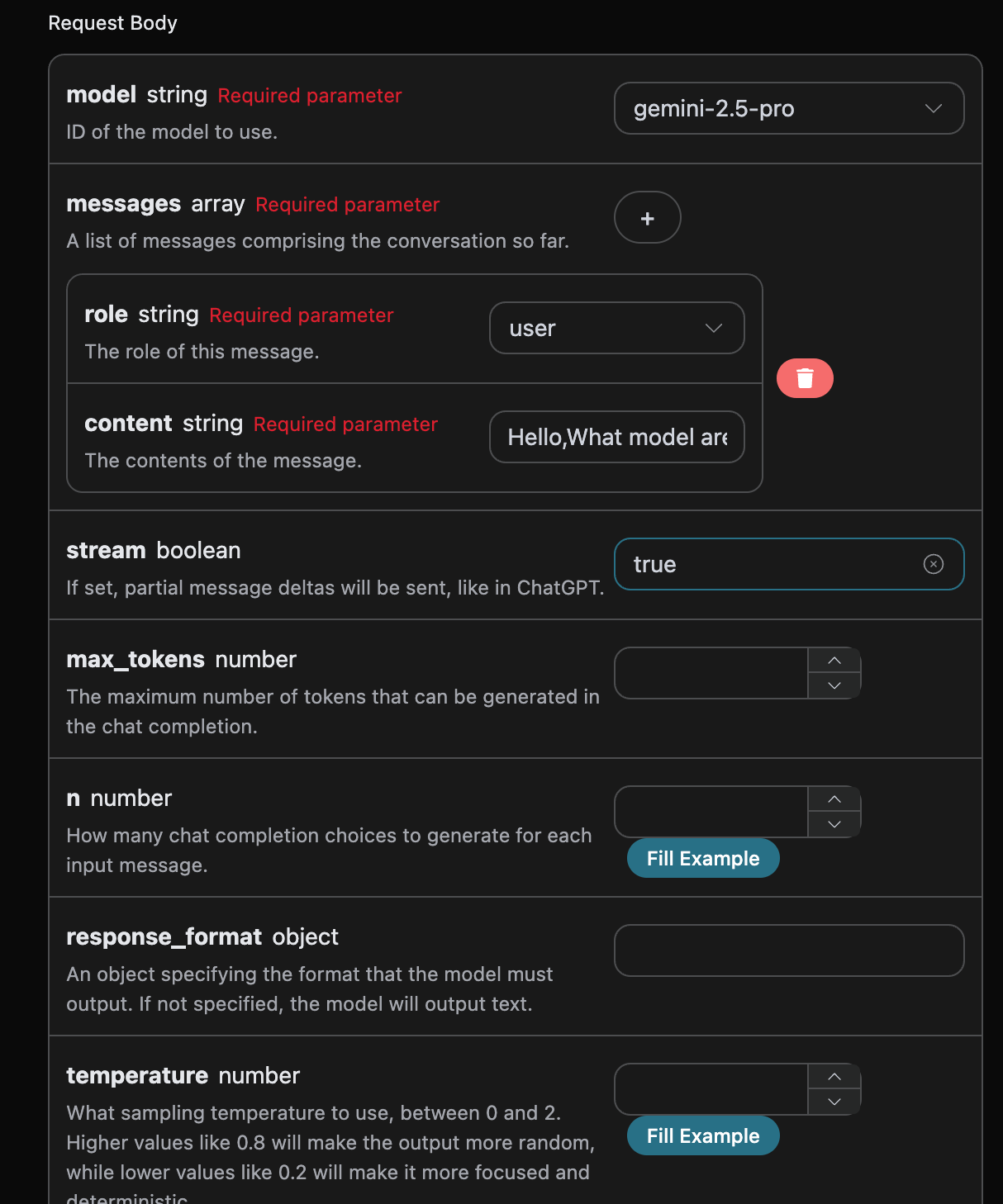

Wenn Sie noch nicht angemeldet oder registriert sind, werden Sie automatisch zur Anmeldeseite weitergeleitet, um sich zu registrieren und anzumelden. Nach der Anmeldung werden Sie automatisch zur aktuellen Seite zurückgeleitet.

Bei der ersten Antragstellung gibt es ein kostenloses Kontingent, mit dem Sie die API kostenlos nutzen können.

Wenn Sie noch nicht angemeldet oder registriert sind, werden Sie automatisch zur Anmeldeseite weitergeleitet, um sich zu registrieren und anzumelden. Nach der Anmeldung werden Sie automatisch zur aktuellen Seite zurückgeleitet.

Bei der ersten Antragstellung gibt es ein kostenloses Kontingent, mit dem Sie die API kostenlos nutzen können.