Ansökningsprocess

För att använda OpenAI Chat Completion API kan du först gå till OpenAI Chat Completion API sidan och klicka på “Acquire” knappen för att få de nödvändiga autentiseringsuppgifterna: Om du inte har loggat in eller registrerat dig kommer du automatiskt att omdirigeras till inloggningssidan där du uppmanas att registrera dig och logga in. Efter att du har loggat in eller registrerat dig kommer du automatiskt att återvända till den aktuella sidan.

Vid första ansökan kommer det att finnas en gratis kvot som ges, så att du kan använda API:et gratis.

Om du inte har loggat in eller registrerat dig kommer du automatiskt att omdirigeras till inloggningssidan där du uppmanas att registrera dig och logga in. Efter att du har loggat in eller registrerat dig kommer du automatiskt att återvända till den aktuella sidan.

Vid första ansökan kommer det att finnas en gratis kvot som ges, så att du kan använda API:et gratis.

Grundläggande Användning

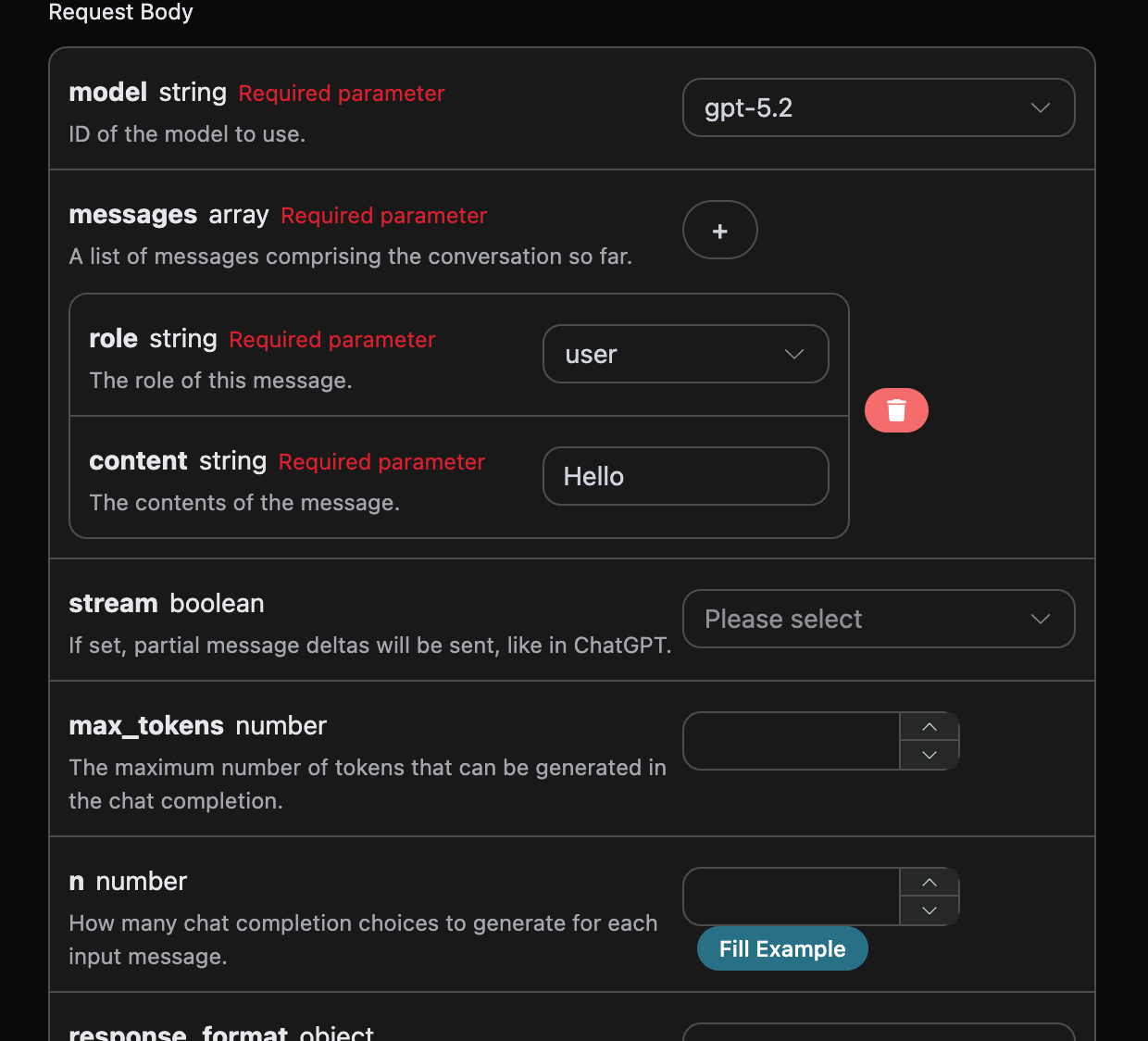

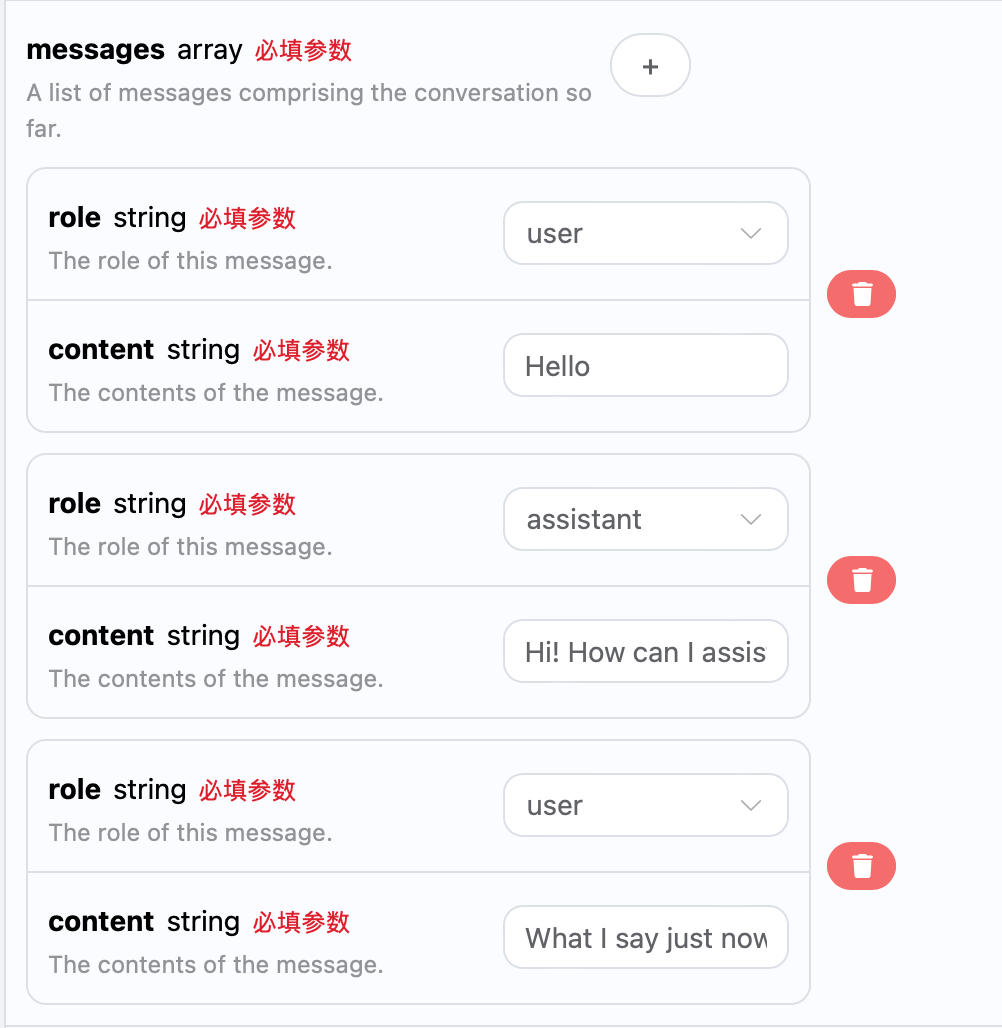

Därefter kan du fylla i motsvarande innehåll på gränssnittet, som visas i bilden:

authorization, som du enkelt kan välja från rullgardinsmenyn. Den andra parametern är model, model är den kategori av OpenAI ChatGPT-modeller som vi väljer att använda, här har vi huvudsakligen 20 olika modeller, detaljer kan ses i de modeller vi tillhandahåller. Den sista parametern är messages, messages är en array av våra inmatade frågor, den är en array som gör det möjligt att ladda upp flera frågor samtidigt, varje fråga innehåller role och content, där role representerar frågeställarens roll, vi har tre olika roller: user, assistant, system. Den andra content är det specifika innehållet i vår fråga.

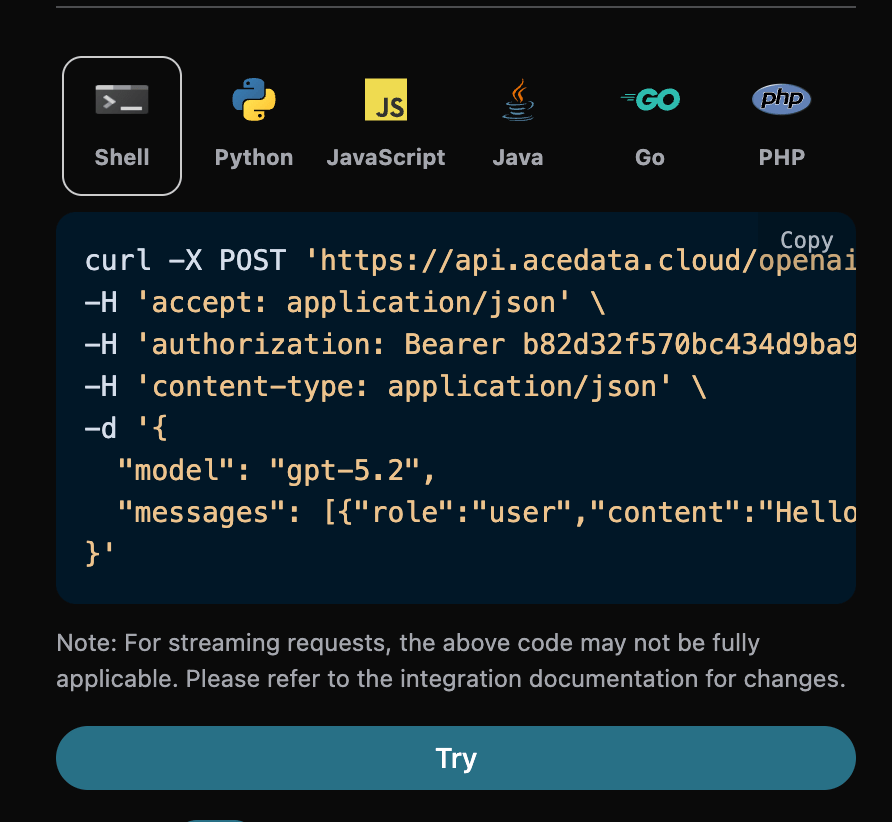

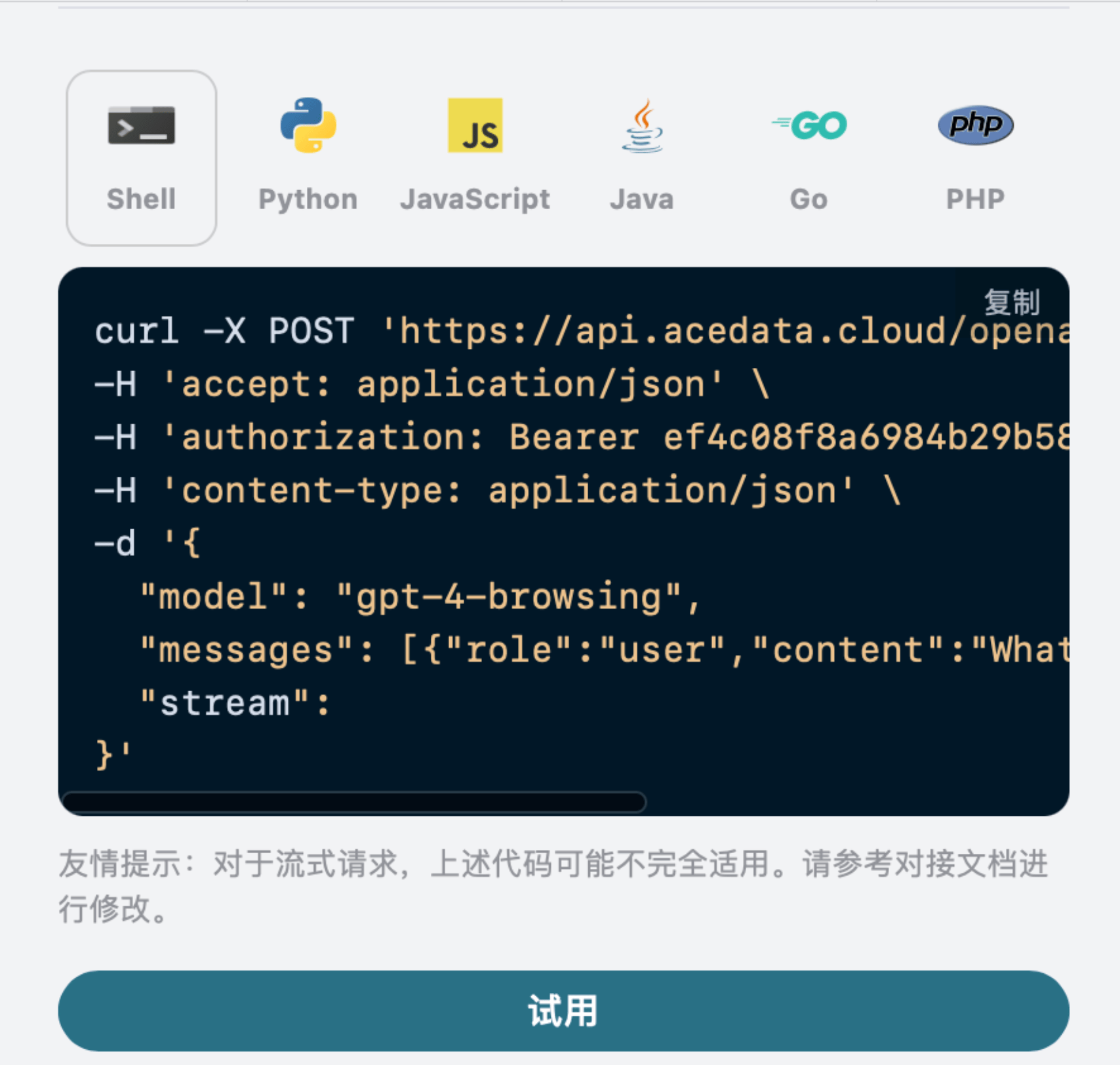

Samtidigt kan du notera att det finns motsvarande kod för anrop på höger sida, du kan kopiera koden och köra den direkt, eller så kan du klicka på “Try” knappen för att testa.

Vanliga valfria parametrar:

max_tokens: Begränsar det maximala antalet tokens för ett enstaka svar.temperature: Genererar slumpmässighet, mellan 0-2, ju högre värde desto mer spritt.n: Hur många kandidatsvar som ska genereras åt gången.response_format: Inställningar för returformat.

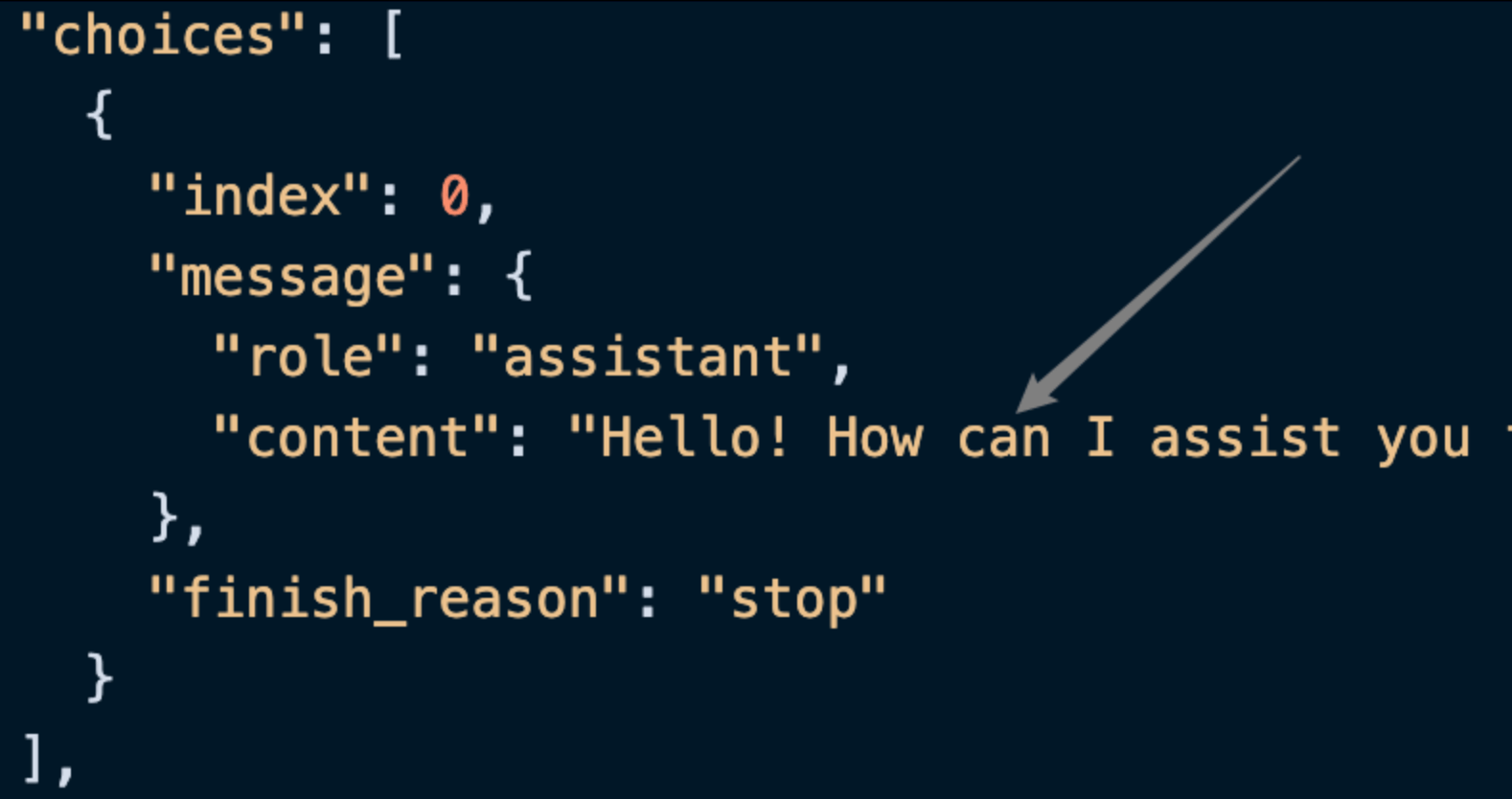

id, ID för den genererade dialoguppgiften, används för att unikt identifiera denna dialoguppgift.model, den valda OpenAI ChatGPT-modellen.choices, ChatGPT:s svarsinformation på frågorna.usage: Statistik över tokens för denna fråge- och svarsinteraktion.

choices innehåller ChatGPT:s svarsinformation, och i den finns choices från ChatGPT, som kan ses i bilden.

content fältet i choices innehåller det specifika innehållet i ChatGPT:s svar.

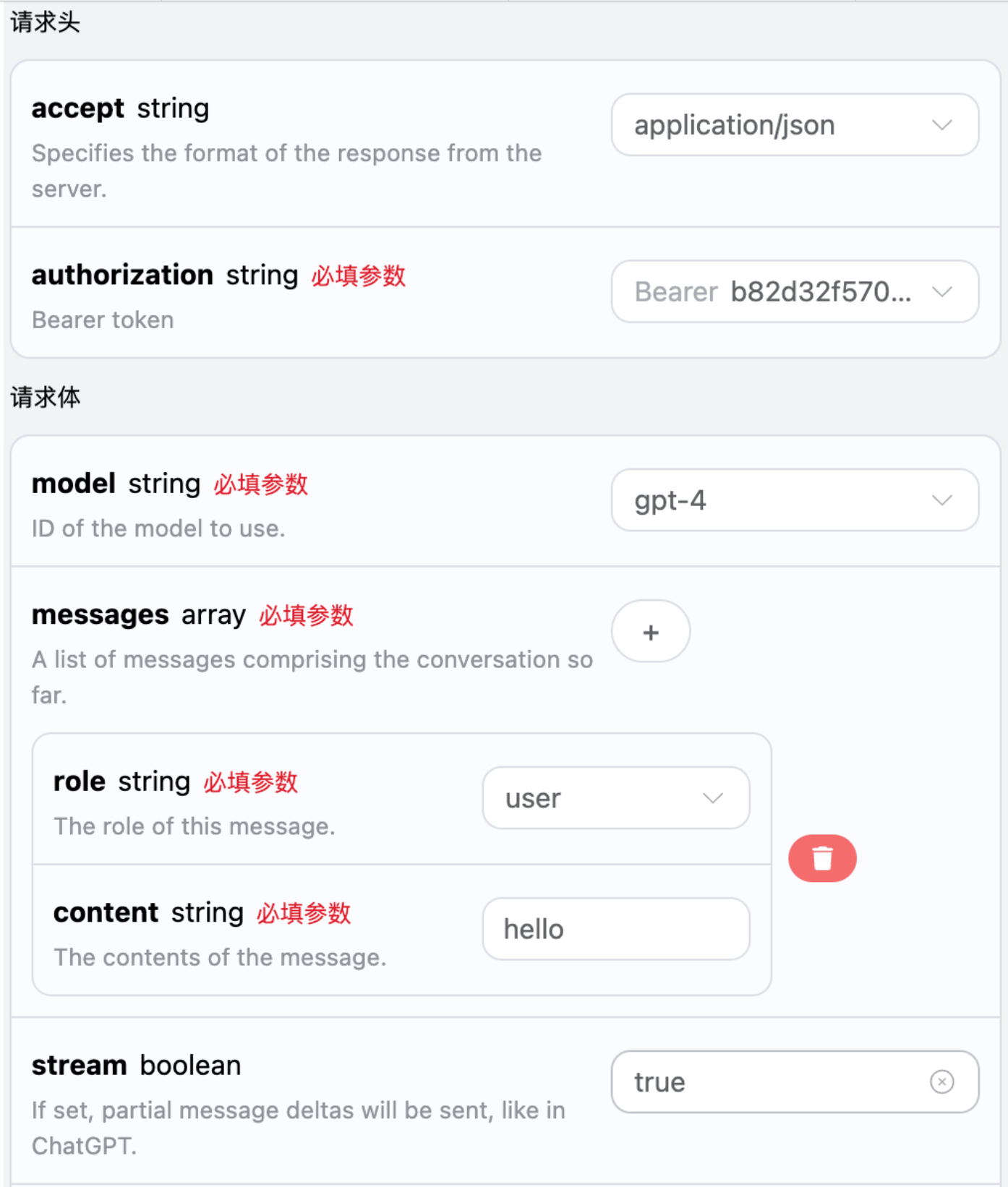

Strömmande Svar

Detta gränssnitt stöder också strömmande svar, vilket är mycket användbart för webbgränssnitt, eftersom det kan göra att webbsidan visar texten ord för ord. Om du vill ha strömmande svar kan du ändrastream parametern i begärningshuvudet till true.

Ändringen visas i bilden, men anropskoden behöver göras motsvarande ändringar för att stödja strömmande svar.

stream ändras till true kommer API:et att returnera motsvarande JSON-data rad för rad, och på kodnivå behöver vi göra nödvändiga ändringar för att få radresultaten.

Python exempel på anropskod:

data, data innehåller choices som är det senaste svaret, vilket är i linje med den tidigare beskrivningen. choices är det nya svaret, och du kan koppla det till ditt system baserat på resultatet. Samtidigt är slutet av den strömmande svaret baserat på innehållet i data, om innehållet är [DONE], indikerar det att det strömmande svaret har avslutats helt. De returnerade data resultaten har flera fält, som beskrivs nedan:

id, ID för att generera denna dialoguppgift, används för att unikt identifiera denna dialoguppgift.model, den valda OpenAI ChatGPT-modellen.choices, ChatGPT:s svarsinformation på frågorna.

Flera rundor av dialog

Om du vill koppla fler rundor av dialogfunktionalitet, behöver du ladda upp flera frågor imessages-fältet, specifika exempel på flera frågor visas nedan:

choices är i linje med det grundläggande användningsinnehållet, vilket innehåller ChatGPT:s specifika svar på flera samtal, så att man kan svara på motsvarande frågor baserat på flera samtalsinnehåll.

Integrera OpenAI-Python

OpenAI Chat Completion API-tjänstens upstream är den officiella OpenAI-tjänsten, mer information kan hittas på den officiella OpenAI-Python, denna artikel kommer kort att introducera hur man använder den officiellt tillhandahållna tjänsten.- Först behöver du sätta upp en lokal

Python-miljö, denna process kan du söka på Google. - Ladda ner och installera utvecklingsmiljön, till exempel installera VSCode-redigeraren.

- Konfigurera

OpenAI-miljövariabler.

- I projektmappen, skapa en fil som heter

.envoch spara - Innehållet i

.env-filen:

sk-xxx med din egen nyckel. OPENAI_BASE_URL är proxygränssnittet för att få tillgång till OpenAI.

- Installera projektets beroendepaket

- Skapa en exempel källkodfil

index.py, med följande innehåll:

Nätverksmodell

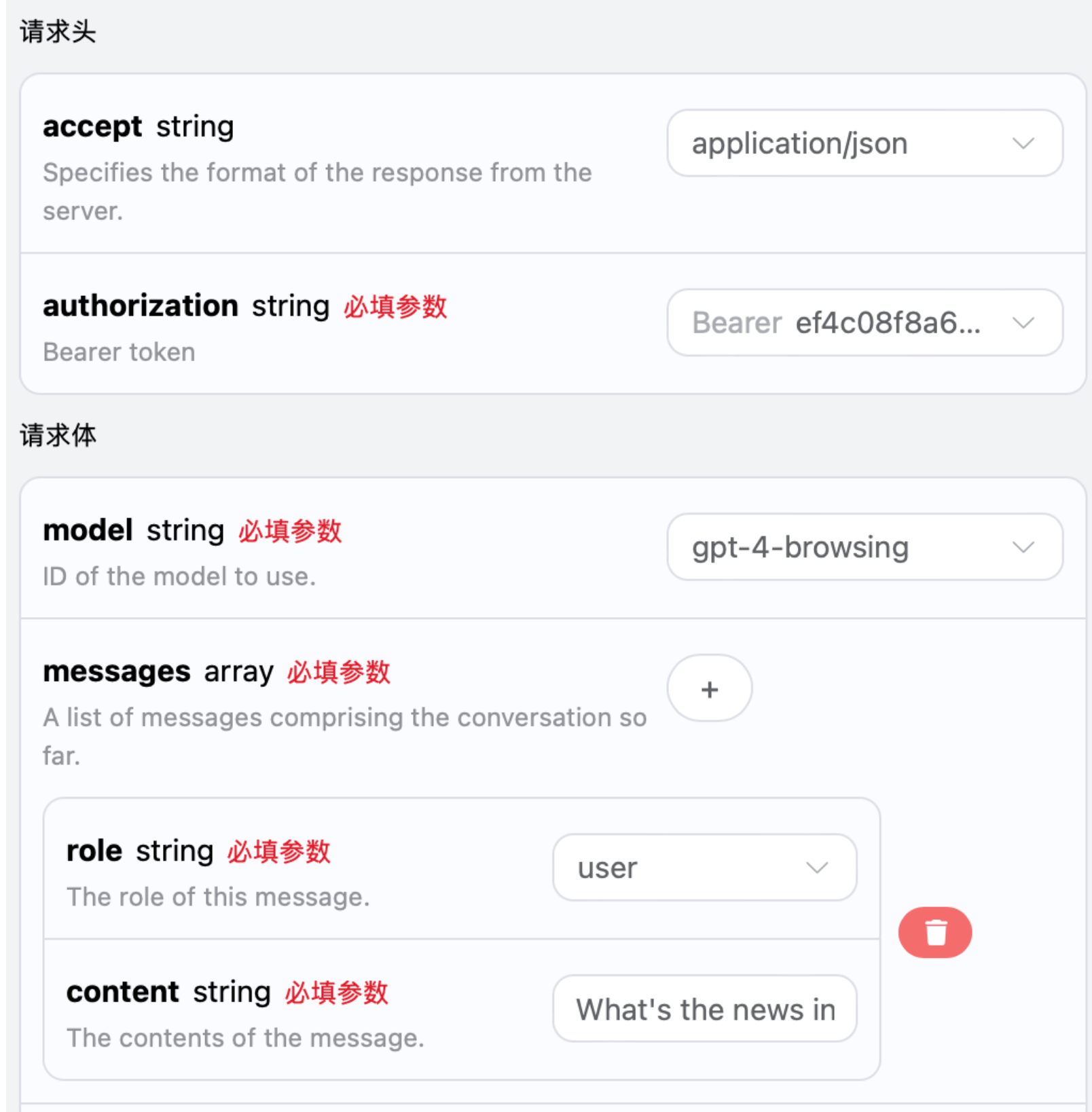

gpt-3.5-browsing och gpt-4-browsing modellerna skiljer sig från andra modeller, de kan utföra nätverkssökningar baserat på frågorna och justera resultaten av nätverkssökningen för att returnera dem till dig. Denna artikel kommer att demonstrera nätverksfunktionen genom ett konkret exempel, och du kan fylla i motsvarande innehåll på OpenAI Chat Completion API-gränssnittet, som visas i bilden:

choices är baserat på nätverksfrågan och ger också relevanta länkar. Informationen i choices måste renderas med markdown-syntax för att få den bästa upplevelsen, vilket också visar den kraftfulla fördelen med vår modells nätverksfunktion.

Visuell modell

gpt-4o är en multimodal stor språkmodell utvecklad av OpenAI, som har ökat den visuella förståelseförmågan baserat på GPT-4. Denna modell kan hantera både text- och bildinmatningar samtidigt, vilket möjliggör korsmodal förståelse och generering. Användningen av gpt-4o-modellens textbehandling är densamma som det grundläggande användningsinnehållet ovan, nedan kommer jag kort att introducera hur man använder modellens bildbehandlingskapacitet. Användningen av gpt-4o-modellens bildbehandlingskapacitet sker huvudsakligen genom att lägga till etttype-fält i det ursprungliga content-innehållet, vilket gör att man kan veta om det som laddas upp är text eller bild, och därmed använda gpt-4o-modellens bildbehandlingskapacitet. Nedan kommer jag att beskriva hur man anropar denna funktion med både Curl och Python.

- Curl-skriptmetod

- Python-skriptmetod

GPT-4o ritmodell

Exempel på begäran:Felhantering

Vid anrop av API:et, om ett fel uppstår, kommer API:et att returnera motsvarande felkod och information. Till exempel:400 token_mismatched: Felaktig begäran, möjligtvis på grund av saknade eller ogiltiga parametrar.400 api_not_implemented: Felaktig begäran, möjligtvis på grund av saknade eller ogiltiga parametrar.401 invalid_token: Obefogad, ogiltig eller saknad auktoriseringstoken.429 too_many_requests: För många begärningar, du har överskridit hastighetsgränsen.500 api_error: Intern serverfel, något gick fel på servern.