Processus de demande

Pour utiliser l’API Claude Chat Completion, vous pouvez d’abord vous rendre sur la page Claude Chat Completion API et cliquer sur le bouton « Acquire » pour obtenir les informations d’identification nécessaires à la demande : Si vous n’êtes pas encore connecté ou inscrit, vous serez automatiquement redirigé vers la page de connexion pour vous inviter à vous inscrire et à vous connecter. Après vous être connecté ou inscrit, vous serez automatiquement renvoyé à la page actuelle.

Lors de la première demande, un quota gratuit sera offert, vous permettant d’utiliser cette API gratuitement.

Si vous n’êtes pas encore connecté ou inscrit, vous serez automatiquement redirigé vers la page de connexion pour vous inviter à vous inscrire et à vous connecter. Après vous être connecté ou inscrit, vous serez automatiquement renvoyé à la page actuelle.

Lors de la première demande, un quota gratuit sera offert, vous permettant d’utiliser cette API gratuitement.

Utilisation de base

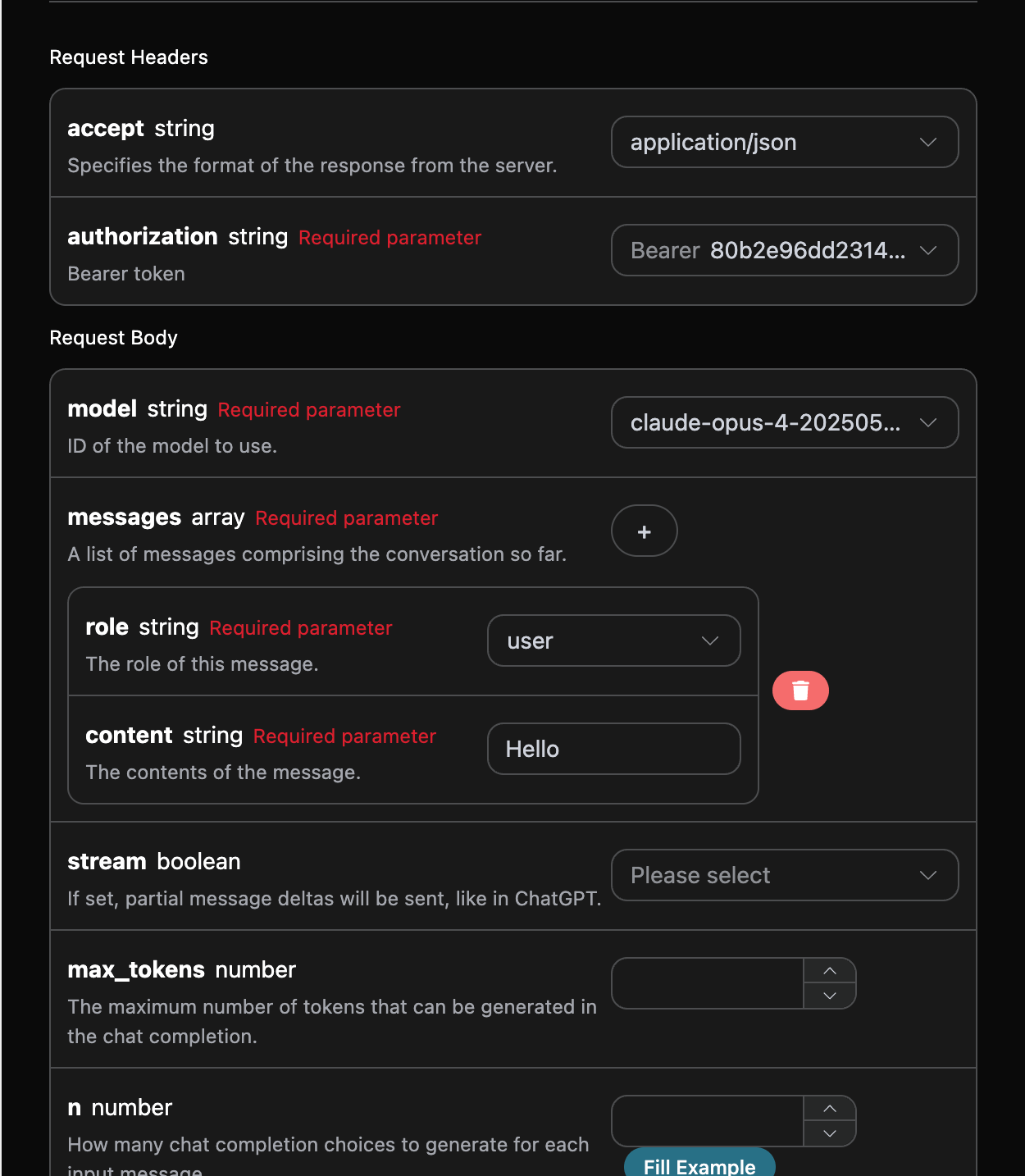

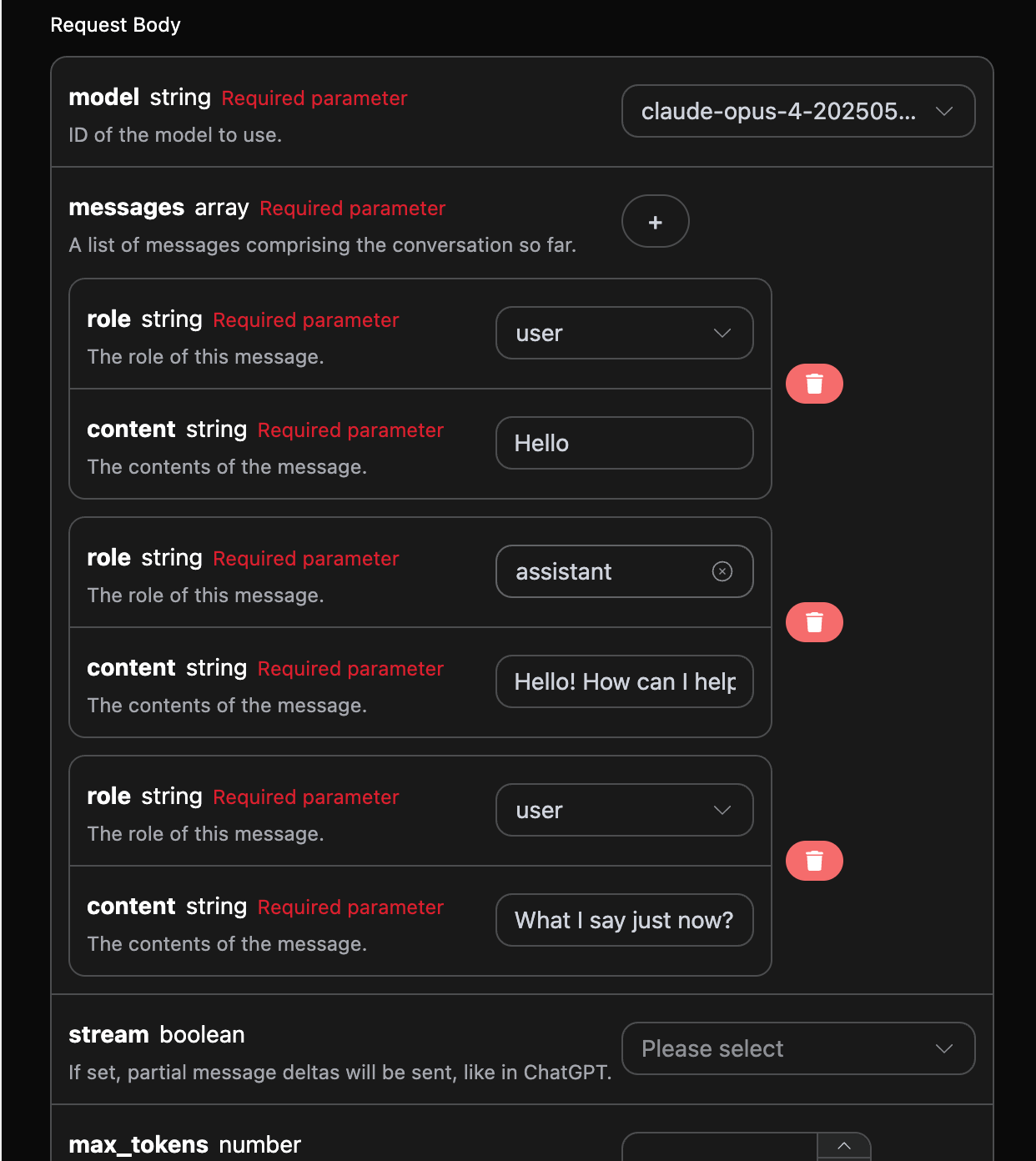

Ensuite, vous pouvez remplir le contenu correspondant sur l’interface, comme indiqué sur l’image :

authorization, que vous pouvez sélectionner directement dans la liste déroulante. L’autre paramètre est model, qui correspond à la catégorie de modèle que nous choisissons d’utiliser sur le site officiel de Claude. Ici, nous avons principalement 20 modèles, pour plus de détails, vous pouvez consulter les modèles que nous fournissons. Le dernier paramètre est messages, qui est un tableau de nos questions, représentant plusieurs questions pouvant être téléchargées simultanément, chaque question contenant role et content, où role indique le rôle du questionneur, nous avons trois identités : user, assistant, system. L’autre content est le contenu spécifique de notre question.

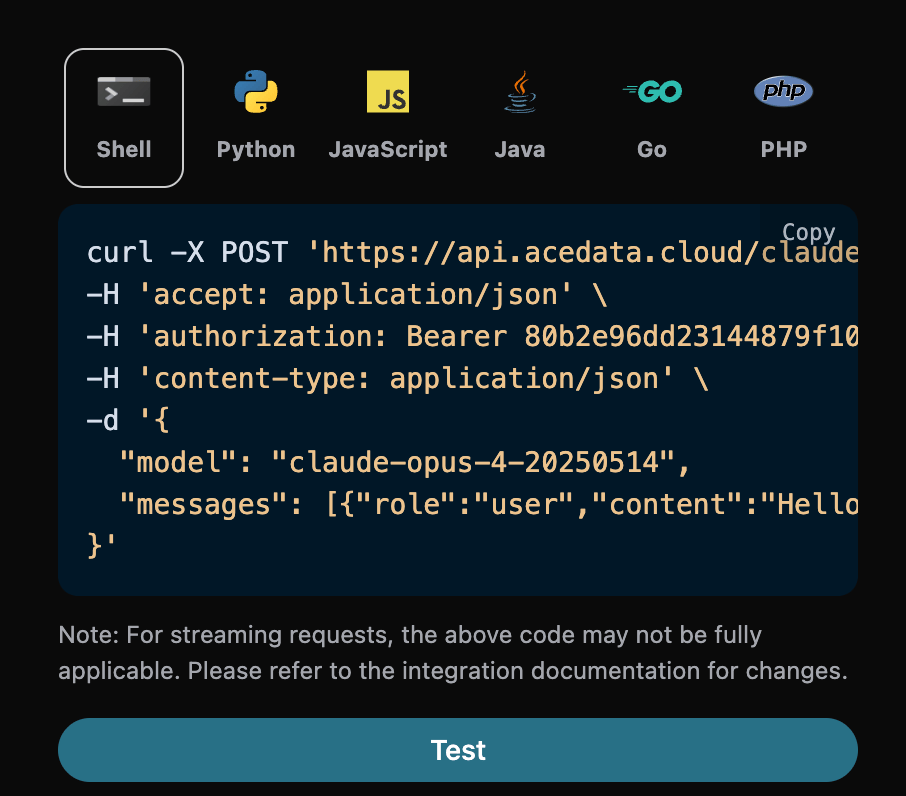

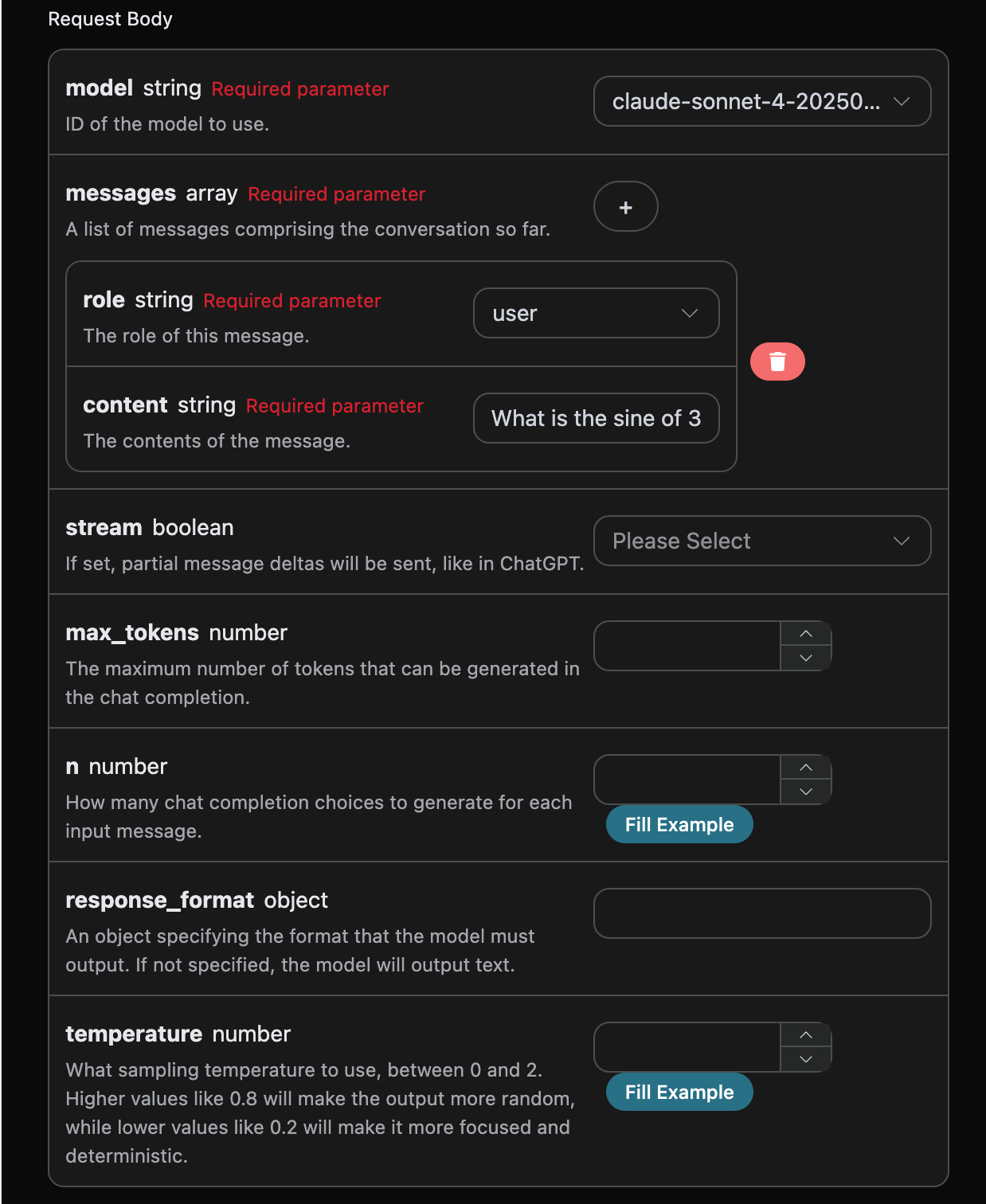

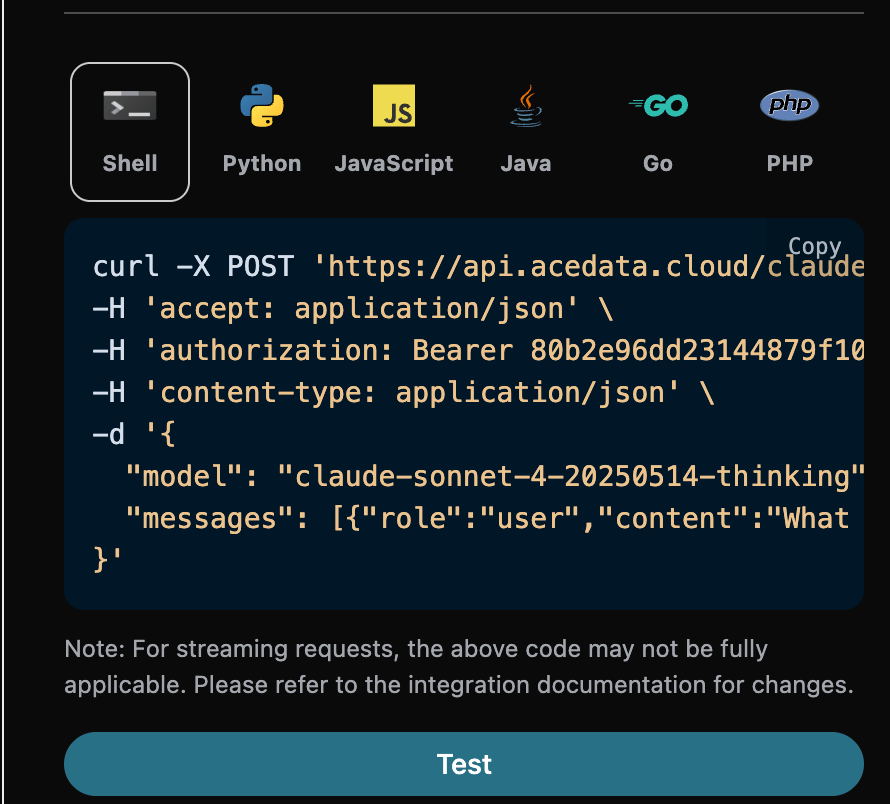

Vous pouvez également remarquer qu’il y a un code d’appel correspondant généré à droite, que vous pouvez copier et exécuter directement, ou cliquer sur le bouton « Try » pour effectuer un test.

Paramètres optionnels courants :

max_tokens: limite le nombre maximum de tokens pour une réponse unique.temperature: génère de l’aléatoire, entre 0 et 2, plus la valeur est élevée, plus c’est dispersé.n: combien de réponses candidates générer en une seule fois.response_format: paramètres de format de retour.

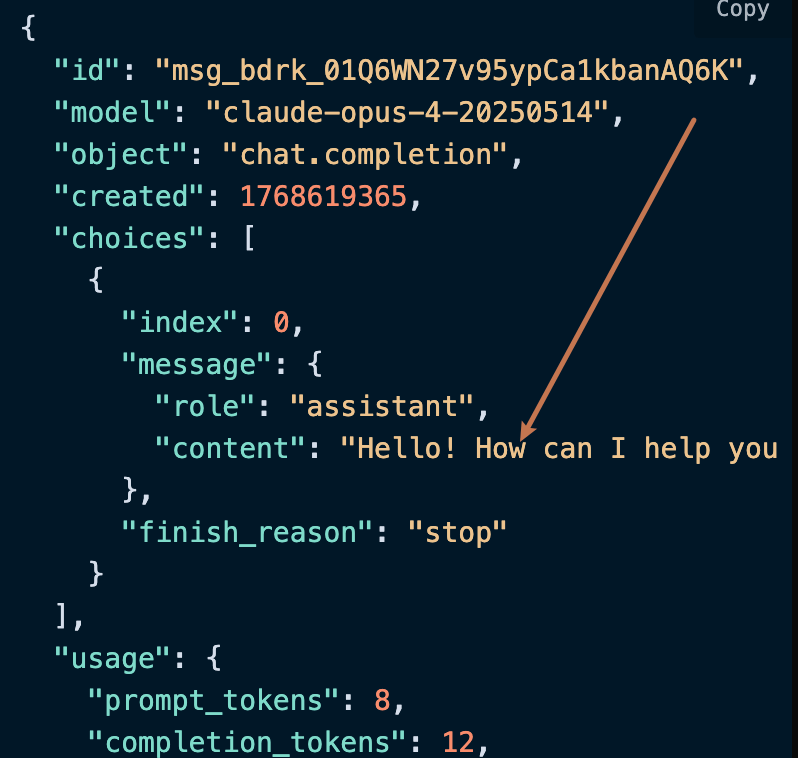

id, l’ID de la tâche de dialogue générée, utilisé pour identifier de manière unique cette tâche de dialogue.model, le modèle choisi sur le site officiel de Claude.choices, les informations de réponse fournies par Claude pour la question posée.usage: les informations statistiques sur les tokens pour cette question-réponse.

choices, on trouve les informations de réponse de Claude, où choices contient les informations spécifiques de la réponse de Claude, comme le montre l’image ci-dessous.

content dans choices contient le contenu spécifique de la réponse de Claude.

Réponse en flux

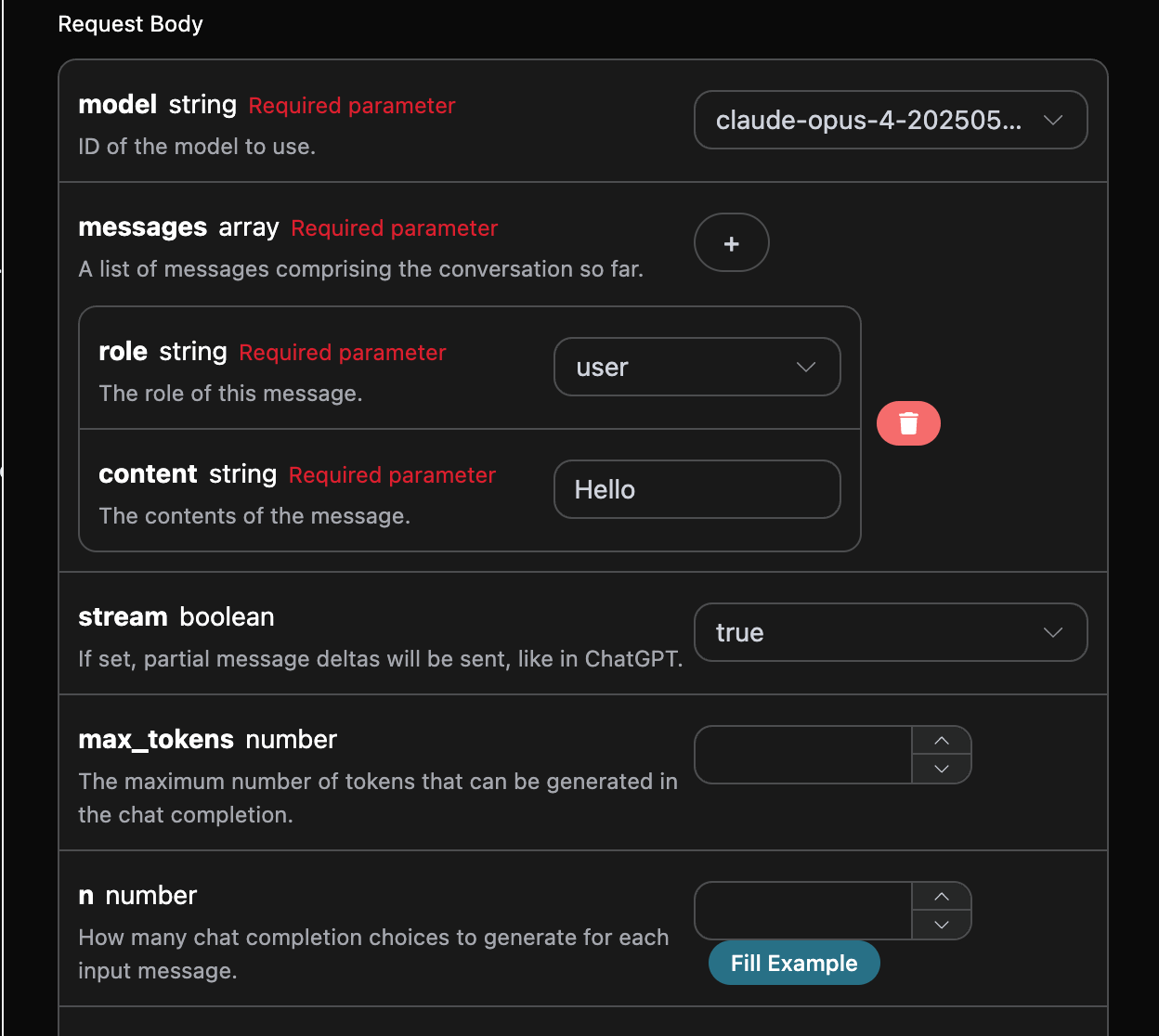

Cette interface prend également en charge les réponses en flux, ce qui est très utile pour l’intégration web, permettant d’afficher les résultats caractère par caractère. Si vous souhaitez retourner une réponse en flux, vous pouvez modifier le paramètrestream dans l’en-tête de la demande, en le changeant en true.

La modification est illustrée sur l’image ci-dessous, mais le code d’appel doit également être modifié pour prendre en charge les réponses en flux.

stream en true, l’API renverra les données JSON ligne par ligne, et au niveau du code, nous devons apporter les modifications nécessaires pour obtenir les résultats ligne par ligne.

Exemple de code d’appel en Python :

data, où data contient les choices, qui sont le contenu de la réponse la plus récente, conforme à ce qui a été décrit ci-dessus. choices est le contenu de réponse nouvellement ajouté, que vous pouvez intégrer dans votre système. De plus, la fin de la réponse en streaming est déterminée par le contenu de data; si le contenu est [DONE], cela signifie que la réponse en streaming est entièrement terminée. Le résultat data retourné contient plusieurs champs, décrits comme suit :

id, l’ID généré pour cette tâche de conversation, utilisé pour identifier de manière unique cette tâche de conversation.model, le modèle choisi sur le site officiel de Claude.choices, les informations de réponse fournies par Claude en réponse aux questions posées.

Dialogue multi-tours

Si vous souhaitez intégrer une fonctionnalité de dialogue multi-tours, vous devez télécharger plusieurs questions dans le champmessages, des exemples spécifiques de plusieurs questions sont illustrés ci-dessous :

choices sont cohérentes avec le contenu de l’utilisation de base, cela inclut le contenu spécifique des réponses de Claude à plusieurs dialogues, ce qui permet de répondre aux questions correspondantes en fonction de plusieurs contenus de dialogue.

Modèle de réflexion approfondie

Les modèles claude-opus-4-20250514-thinking et claude-sonnet-4-20250514-thinking sont différents des autres modèles, car ils peuvent réfléchir en profondeur en fonction des mots de la question et renvoyer les résultats du processus de réflexion. Cet article démontrera la fonctionnalité de réflexion approfondie à travers un exemple concret. Ensuite, vous pourrez remplir le contenu correspondant sur l’interface de l’API Claude Chat Completion, comme illustré ci-dessous :

choices sont obtenues après une réflexion approfondie, et le contenu du processus de réflexion est également fourni. Dans content, reasoning_content représente le processus de réflexion du modèle. Les informations de réponse dans choices doivent être rendues à l’aide de la syntaxe markdown pour obtenir la meilleure expérience, ce qui met également en évidence la puissance de la fonctionnalité de mise en réseau de notre modèle.

Modèle visuel

claude-sonnet-4-20250514 est un modèle de langage multimodal de grande taille développé par Claude, qui a ajouté des capacités de compréhension visuelle à claude-4. Ce modèle peut traiter simultanément des entrées textuelles et des images, réalisant ainsi une compréhension et une génération intermodales. L’utilisation des capacités de traitement d’images du modèle claude-sonnet-4-20250514 est cohérente avec le contenu d’utilisation de base mentionné ci-dessus. Voici une brève introduction sur la façon d’utiliser les capacités de traitement d’images du modèle. L’utilisation des capacités de traitement d’images du modèle claude-sonnet-4-20250514 se fait principalement en ajoutant un champtype à la base du contenu content existant. Ce champ permet de savoir si le contenu téléchargé est du texte ou une image, permettant ainsi d’utiliser les capacités de traitement d’images du modèle claude-sonnet-4-20250514. Ci-dessous, nous allons principalement aborder deux méthodes pour appeler cette fonctionnalité : Curl et Python.

- Méthode de script Curl

- Méthode de script Python

Gestion des erreurs

Lors de l’appel de l’API, si une erreur se produit, l’API renverra le code d’erreur et les informations correspondantes. Par exemple :400 token_mismatched: Mauvaise requête, probablement en raison de paramètres manquants ou invalides.400 api_not_implemented: Mauvaise requête, probablement en raison de paramètres manquants ou invalides.401 invalid_token: Non autorisé, jeton d’autorisation invalide ou manquant.429 too_many_requests: Trop de requêtes, vous avez dépassé la limite de taux.500 api_error: Erreur interne du serveur, quelque chose s’est mal passé sur le serveur.