messages. Pour compléter une conversation continue, nous devons transmettre tout l’historique du contexte et gérer le problème de dépassement de limite de Token.

L’API de questions-réponses AI fournie par AceDataCloud a été optimisée pour cette situation. Tout en garantissant que l’efficacité des questions-réponses reste inchangée, l’implémentation des conversations continues a été encapsulée. Lors de l’intégration, il n’est plus nécessaire de se soucier de la transmission des messages, ni de la gestion des problèmes de dépassement de limite de Token (traitement automatique en interne par l’API). De plus, elle offre des fonctionnalités de requête et de modification de conversation, simplifiant ainsi considérablement l’intégration globale.

Ce document présentera les instructions d’intégration de l’API de questions-réponses AI.

Processus de demande

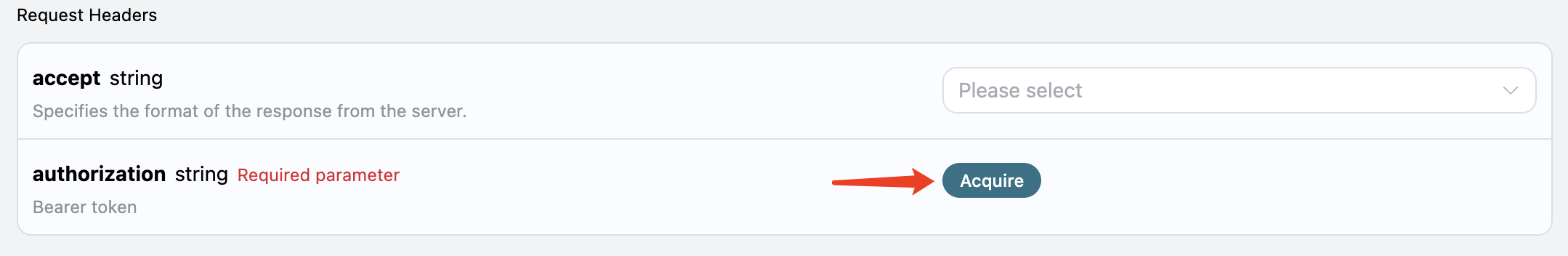

Pour utiliser l’API, vous devez d’abord vous rendre sur la page correspondante de l’API de questions-réponses AI pour demander le service correspondant. Une fois sur la page, cliquez sur le bouton « Acquire », comme illustré ci-dessous : Si vous n’êtes pas encore connecté ou inscrit, vous serez automatiquement redirigé vers la page de connexion pour vous inviter à vous inscrire et à vous connecter. Après vous être connecté ou inscrit, vous serez automatiquement renvoyé à la page actuelle.

Lors de la première demande, un quota gratuit sera offert, vous permettant d’utiliser cette API gratuitement.

Si vous n’êtes pas encore connecté ou inscrit, vous serez automatiquement redirigé vers la page de connexion pour vous inviter à vous inscrire et à vous connecter. Après vous être connecté ou inscrit, vous serez automatiquement renvoyé à la page actuelle.

Lors de la première demande, un quota gratuit sera offert, vous permettant d’utiliser cette API gratuitement.

Utilisation de base

Tout d’abord, comprenons la méthode d’utilisation de base, qui consiste à poser une question et à obtenir une réponse. Il suffit de transmettre un champquestion et de spécifier le modèle correspondant.

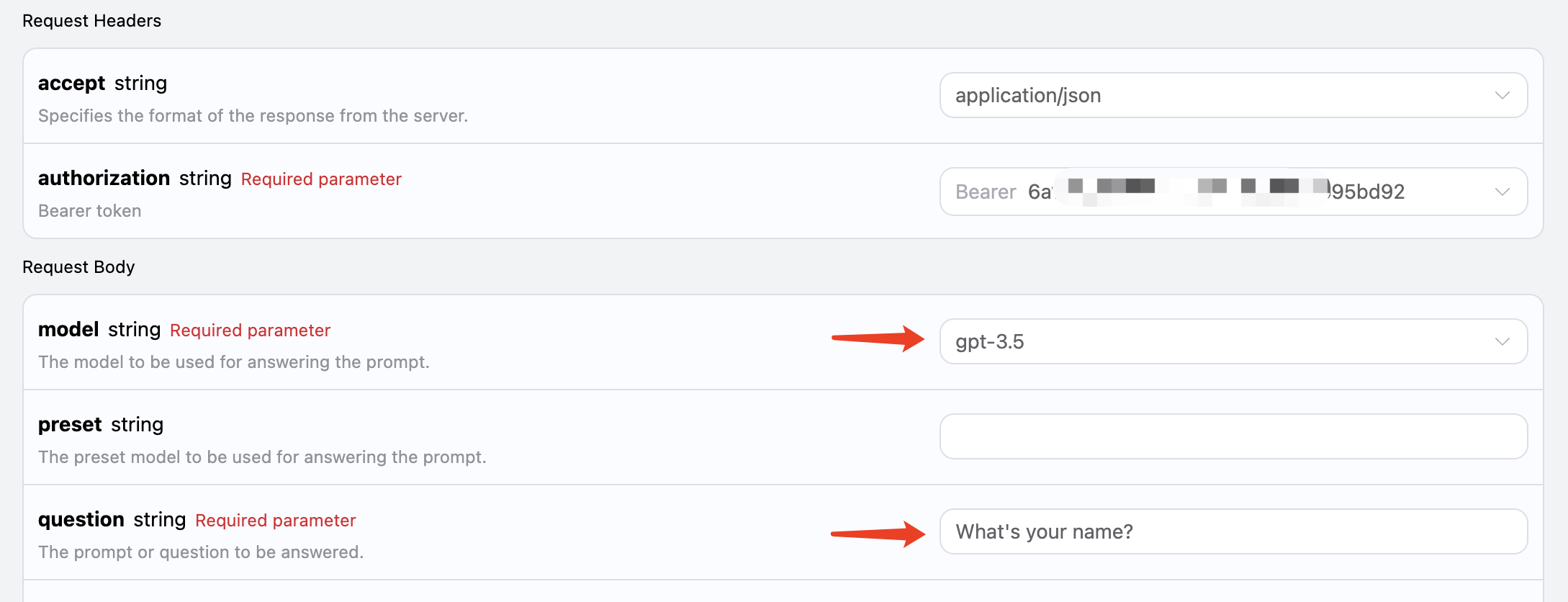

Par exemple, en demandant : « What’s your name ? », nous pouvons ensuite remplir le contenu correspondant sur l’interface, comme illustré ci-dessous :

Nous pouvons voir ici que nous avons défini les en-têtes de requête, y compris :

Nous pouvons voir ici que nous avons défini les en-têtes de requête, y compris :

accept: le format de réponse souhaité, ici rempli avecapplication/json, c’est-à-dire au format JSON.authorization: la clé d’API, que vous pouvez sélectionner directement après la demande.

model: le choix du modèle, comme les modèles populaires GPT 3.5, GPT 4, etc.question: la question à poser, qui peut être n’importe quel texte brut.

answer, qui est la réponse à la question. Nous pouvons poser n’importe quelle question et obtenir n’importe quelle réponse.

Si vous n’avez pas besoin de support pour des conversations multi-tours, cette API peut grandement faciliter votre intégration.

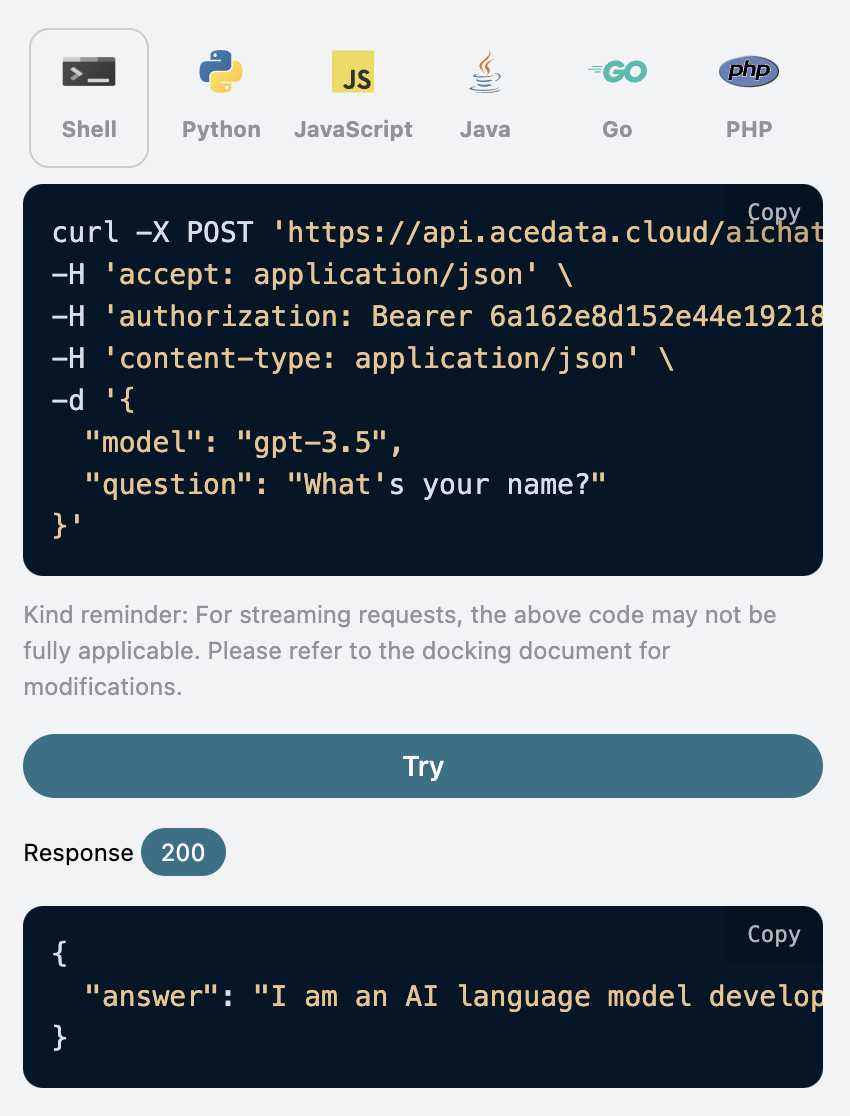

De plus, si vous souhaitez générer le code d’intégration correspondant, vous pouvez le copier directement, par exemple, le code CURL est le suivant :

Conversations multi-tours

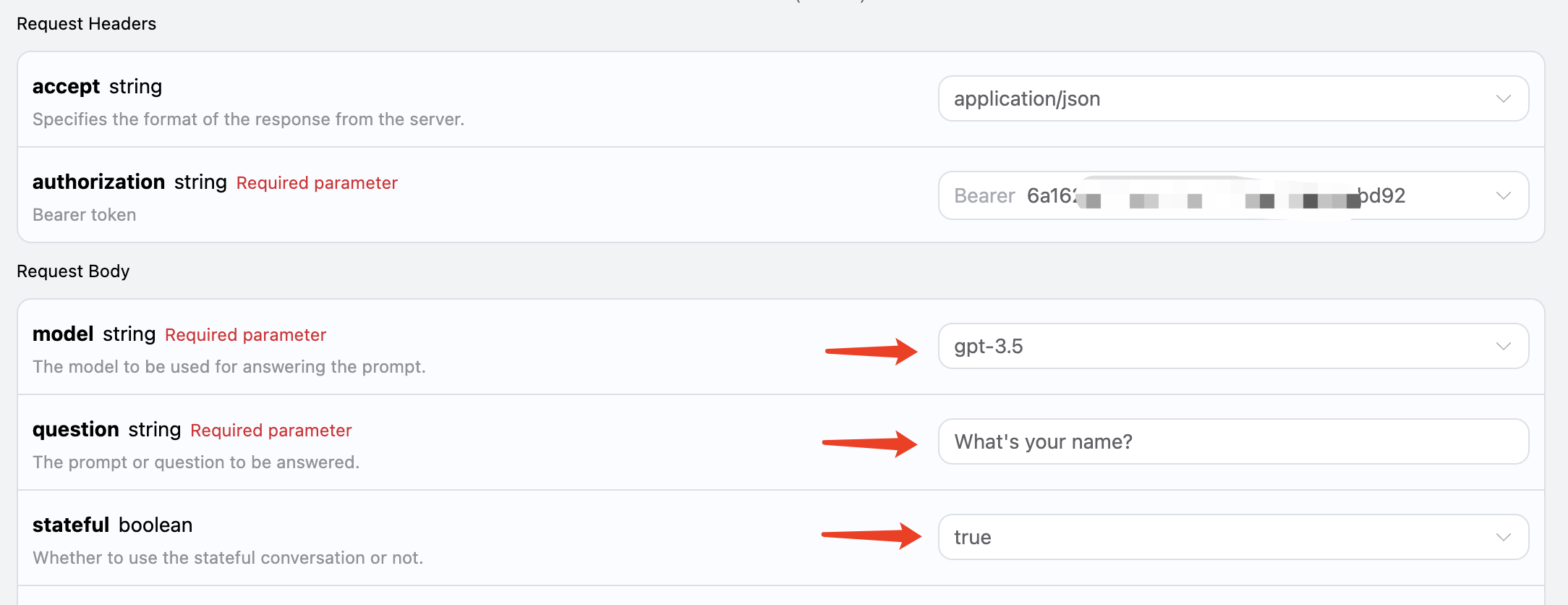

Si vous souhaitez intégrer la fonctionnalité de conversation multi-tours, vous devez transmettre un paramètre supplémentairestateful, dont la valeur doit être true. Pour chaque requête ultérieure, ce paramètre doit être inclus. Après avoir transmis le paramètre stateful, l’API renverra également un paramètre id, représentant l’ID de la conversation actuelle. Par la suite, il vous suffira de transmettre cet ID comme paramètre pour réaliser facilement des conversations multi-tours.

Voyons maintenant une démonstration des opérations spécifiques.

Pour la première requête, définissez le paramètre stateful sur true, et transmettez normalement les paramètres model et question, comme illustré ci-dessous :

Le code correspondant est le suivant :

Le code correspondant est le suivant :

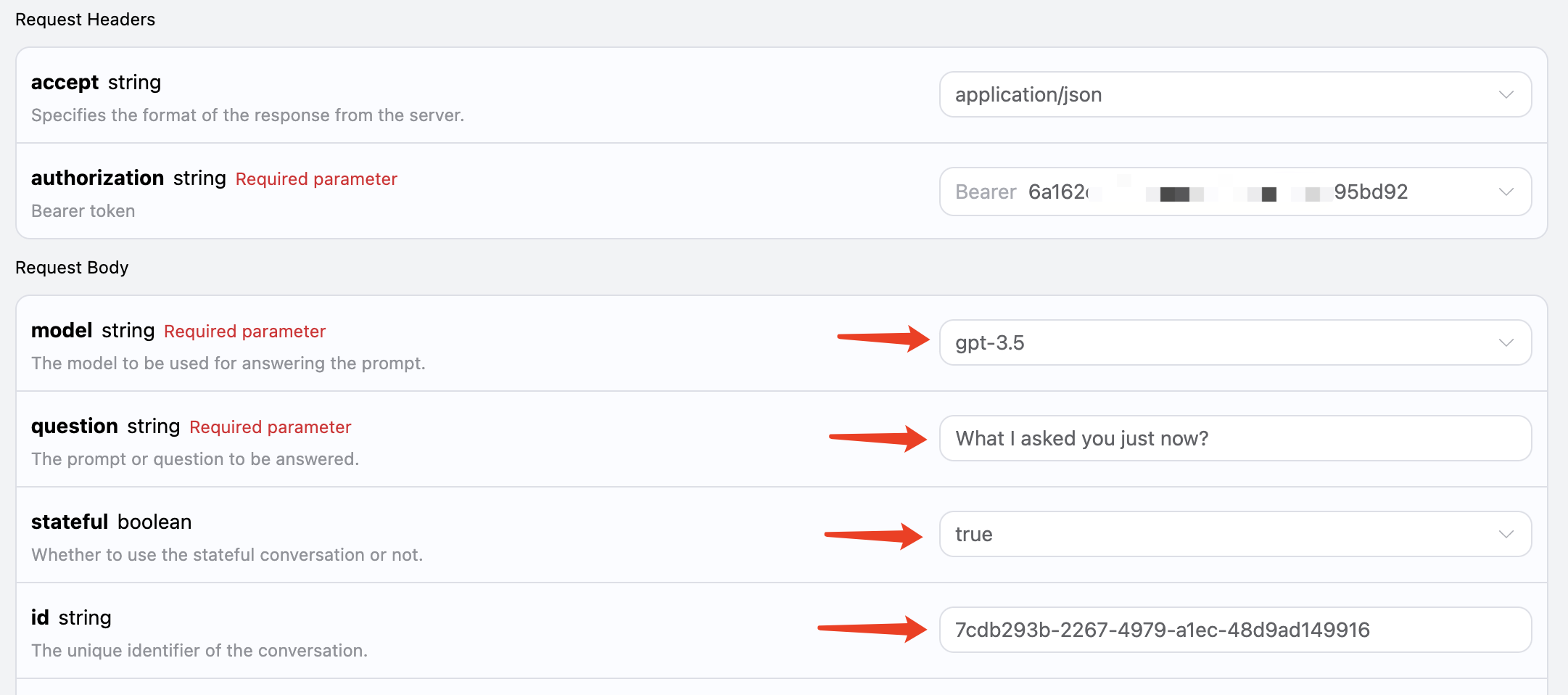

id retourné par la première requête comme paramètre, tout en maintenant le paramètre stateful sur true, en demandant « What I asked you just now ? », comme illustré ci-dessous :

Le code correspondant est le suivant :

Le code correspondant est le suivant :

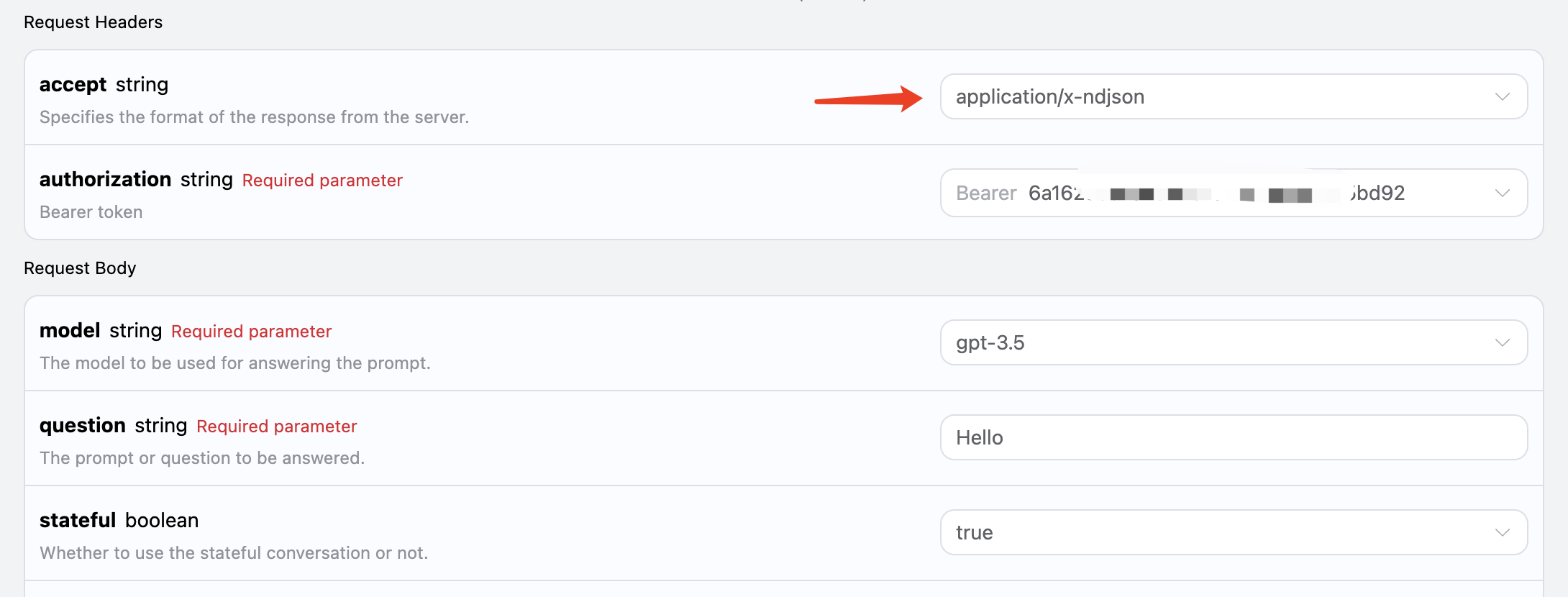

Réponse en continu

Cette interface prend également en charge les réponses en continu, ce qui est très utile pour l’intégration sur le web, permettant d’afficher les résultats caractère par caractère. Si vous souhaitez obtenir une réponse en continu, vous pouvez modifier le paramètreaccept dans les en-têtes de requête, en le changeant en application/x-ndjson.

La modification est illustrée ci-dessous, mais le code d’appel doit également être modifié pour prendre en charge les réponses en continu.

Après avoir changé

Après avoir changé accept en application/x-ndjson, l’API renverra les données JSON correspondantes ligne par ligne. Au niveau du code, nous devons faire les modifications nécessaires pour obtenir les résultats ligne par ligne.

Exemple de code d’appel en Python :

answer qui est le contenu de la dernière réponse, et delta_answer qui est le contenu de la réponse ajoutée, vous pouvez vous baser sur les résultats pour les intégrer dans votre système.

JavaScript est également pris en charge, par exemple, le code d’appel en flux pour Node.js est comme suit :

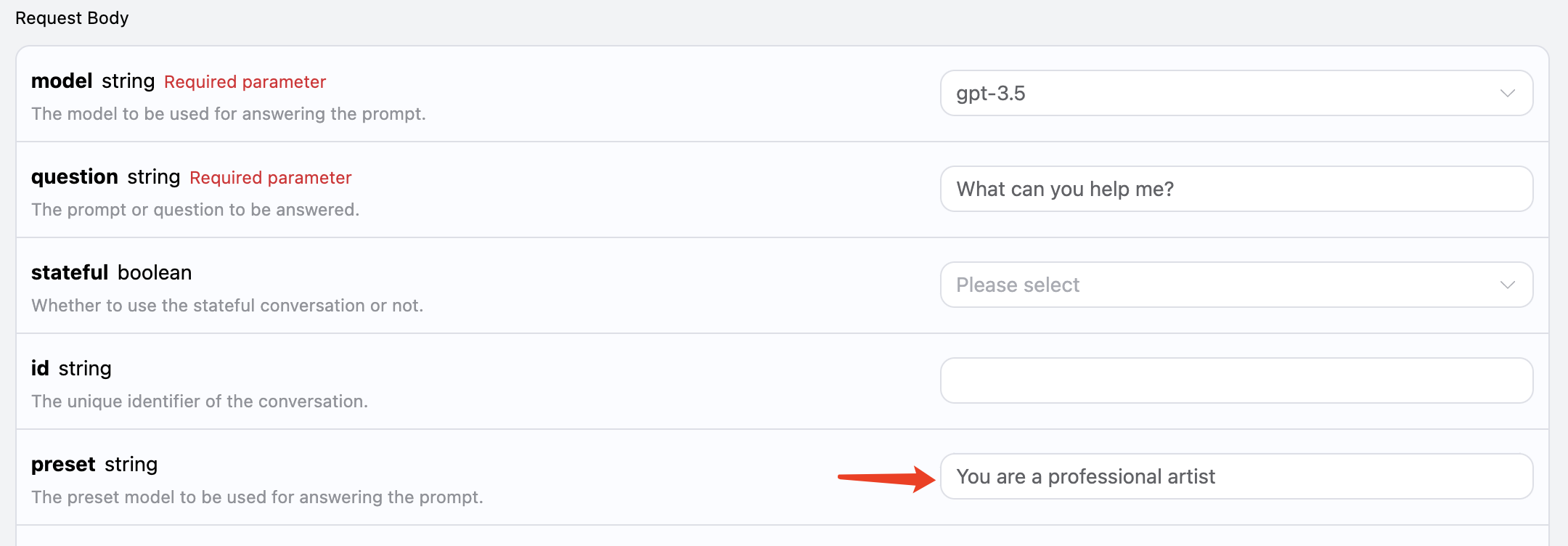

Modèle de présélection

Nous savons que les API liées à OpenAI ont un concept desystem_prompt, qui consiste à définir une présélection pour l’ensemble du modèle, par exemple, quel est son nom, etc. Cette API de questions-réponses AI expose également ce paramètre, appelé preset, en l’utilisant nous pouvons ajouter une présélection au modèle, prenons un exemple pour l’expérimenter :

Ici, nous ajoutons un champ preset, dont le contenu est Vous êtes un artiste professionnel, comme illustré :

Le code correspondant est comme suit :

Le code correspondant est comme suit :

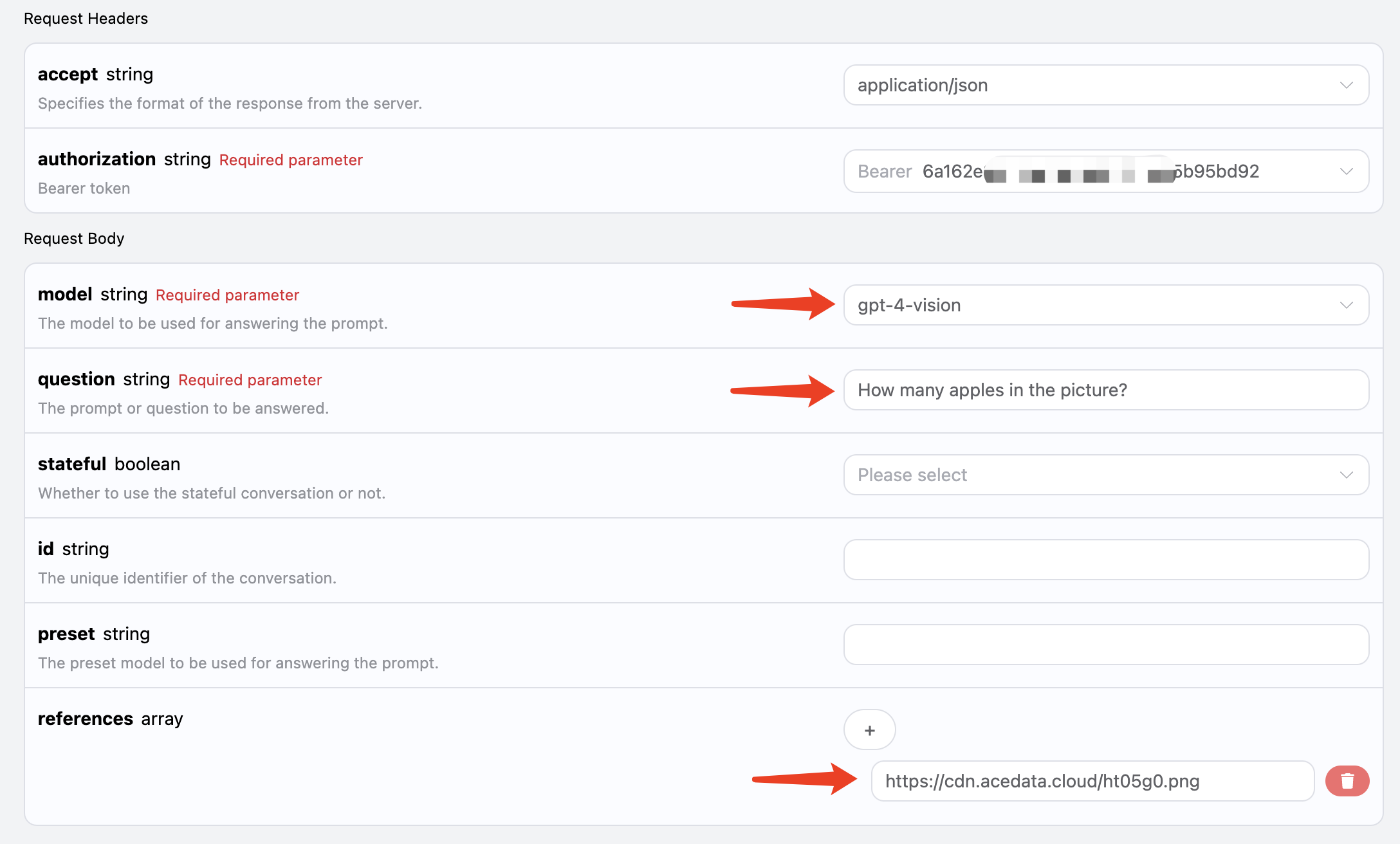

Reconnaissance d’images

Cette AI peut également prendre en charge l’ajout de pièces jointes pour la reconnaissance d’images, en transmettant le lien de l’image correspondante viareferences, par exemple, j’ai ici une image de pomme, comme illustré :

Le lien de cette image est https://cdn.acedata.cloud/ht05g0.png, nous le transmettons directement comme paramètre

Le lien de cette image est https://cdn.acedata.cloud/ht05g0.png, nous le transmettons directement comme paramètre references, tout en notant que le modèle doit être choisi parmi ceux qui prennent en charge la reconnaissance visuelle, actuellement le modèle pris en charge est gpt-4-vision, donc l’entrée est comme suit :

Le code correspondant est comme suit :

Le code correspondant est comme suit :

Questions-réponses en ligne

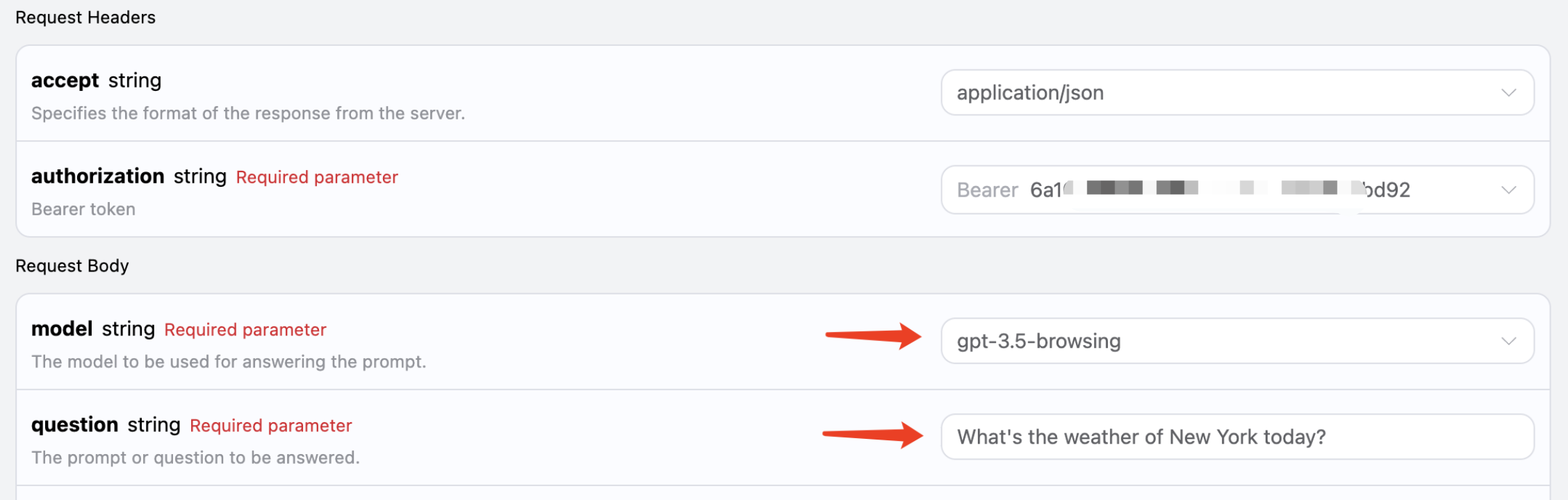

Cette API prend également en charge les modèles en ligne, y compris GPT-3.5 et GPT-4, qui peuvent tous deux être pris en charge, derrière l’API il y a un processus de recherche automatique sur Internet et de résumé, nous pouvons choisir le modèlegpt-3.5-browsing pour l’expérimenter, comme illustré :

Le code est comme suit :

Le code est comme suit :

Si vous avez des exigences plus élevées concernant la qualité des réponses du modèle, vous pouvez changer le modèle en gpt-4-browsing, la qualité des réponses sera meilleure.