申請流程

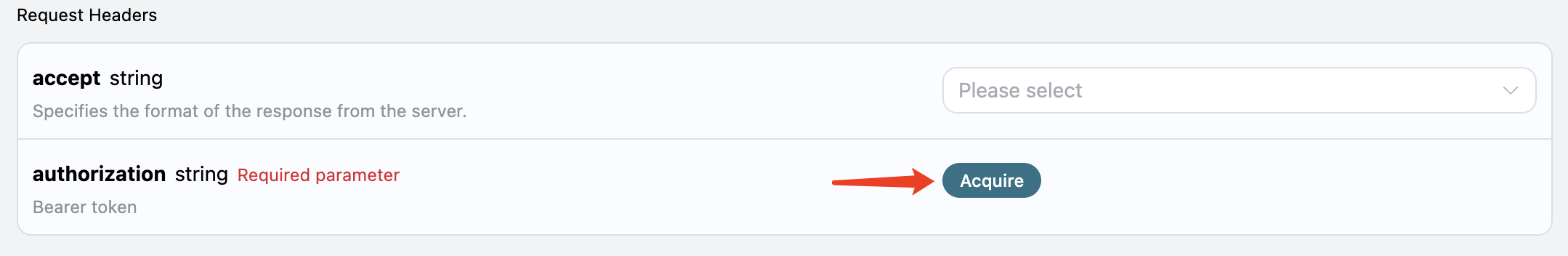

要使用 API,需要先到 Wan Videos Generation API 對應頁面申請對應的服務,進入頁面之後,點擊「Acquire」按鈕,如圖所示: 如果你尚未登錄或註冊,會自動跳轉到登錄頁面邀請您來註冊和登錄,登錄註冊之後會自動返回當前頁面。

在首次申請時會有免費額度贈送,可以免費使用該 API。

如果你尚未登錄或註冊,會自動跳轉到登錄頁面邀請您來註冊和登錄,登錄註冊之後會自動返回當前頁面。

在首次申請時會有免費額度贈送,可以免費使用該 API。

基本使用

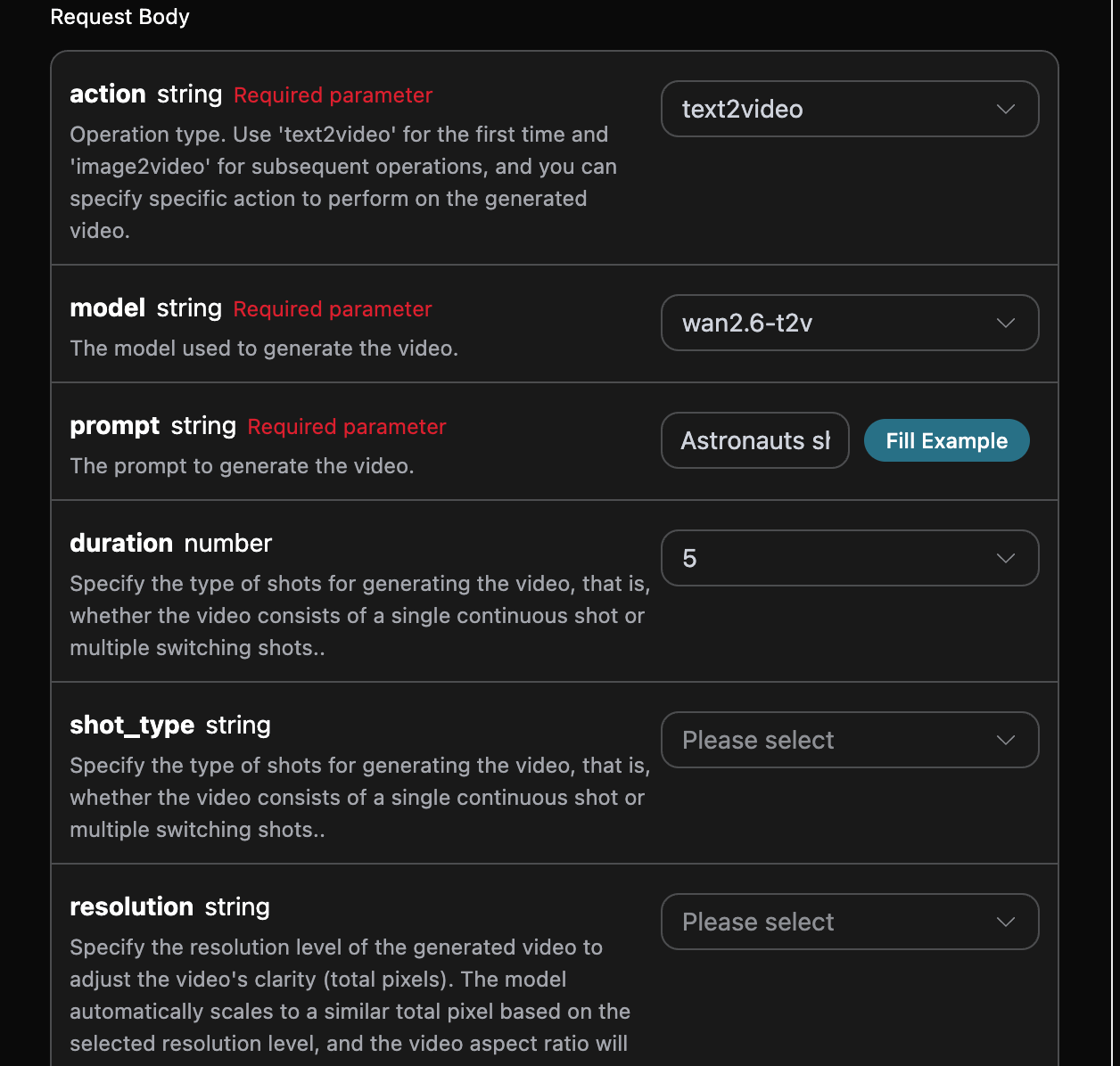

首先先了解下基本的使用方式,就是輸入提示詞prompt、 生成行為 action、首幀參考圖片 image_url 以及模型 model,便可獲得處理後的結果,首先需要簡單地傳遞一個 action 字段,它的值為 text2video,它主要包含兩種行為:文生視頻(text2video)、圖生視頻(image2video),然後我們還需要輸入模型 model,目前主要有 wan2.6-i2v, wan2.6-r2v, wan2.6-i2v-flash, wan2.6-t2v 模型,具體的內容如下:

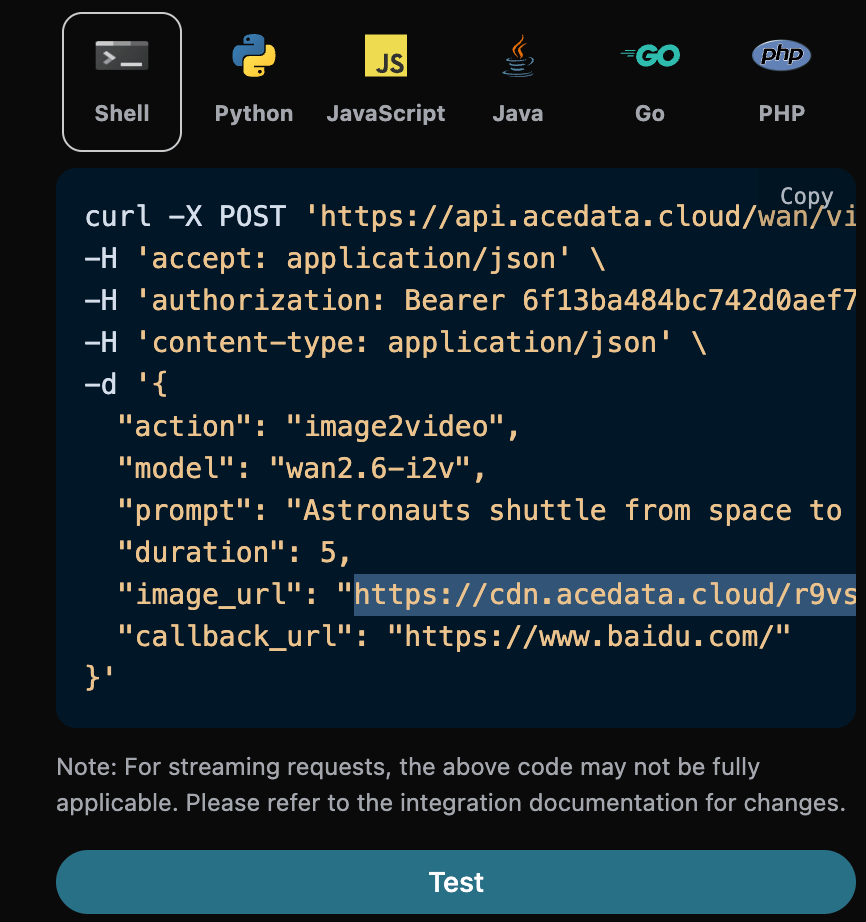

accept:想要接收怎樣格式的響應結果,這裡填寫為application/json,即 JSON 格式。authorization:調用 API 的密鑰,申請之後可以直接下拉選擇。

model:生成視頻的模型,主要有wan2.6-i2v,wan2.6-r2v,wan2.6-i2v-flash,wan2.6-t2v模型。action:此次視頻生成任務的行為,主要包含三種行為,分別為:文生視頻(text2video)、圖生視頻(image2video),當是文生視頻時,目前只支持模型wan2.6-t2v,當是圖生視頻時,目前只支持模型wan2.6-i2v,wan2.6-r2v,wan2.6-i2v-flash。image_url:當選擇圖生視頻行為image2video就必須需要上傳的首幀參考圖片鏈接,目前只支持模型wan2.6-i2v、wan2.6-i2v-flash。reference_video_urls:圖生視頻時可選,指定參考的視頻鏈接進行生成,目前只支持模型wan2.6-r2v。size:指定生成的視頻分辨率,格式為寬*高。該參數的默認值和可用枚舉值依賴於 model 參數,具體的規則可參考官網文檔:。duration:視頻生成的時長,主要支持5、10、15。shot_type:可選,指定生成視頻的鏡頭類型,即視頻是由一個連續鏡頭還是多個切換鏡頭組成。生效條件:僅當”prompt_extend”: true 時生效。參數優先級:shot_type > prompt。例如,若 shot_type設置為”single”,即使 prompt 中包含“生成多鏡頭視頻”,模型仍會輸出單鏡頭視頻,具體的規則可參考官網文檔。negative_prompt:可選,反向提示詞,用來描述不希望在視頻畫面中看到的內容,可以對視頻畫面進行限制。支持中英文,長度不超過500個字符,超過部分會自動截斷。示例值:低分辨率、錯誤、最差質量、低質量、殘缺、多餘的手指、比例不良等。resolution:指定生成的視頻分辨率檔位,用於調整視頻的清晰度(總像素)。模型根據選擇的分辨率檔位,自動縮放至相近總像素,視頻寬高比將儘量與輸入圖像 img_url 的寬高比保持一致,更多說明詳見參考官網文檔。audio_url:音頻文件的 URL,模型將使用該音頻生成視頻。使用方式參考官網文檔。audio:是否生成有聲視頻。參數優先級:audio > audio_url。當 audio=false時,即使傳入 audio_url,輸出仍為無聲視頻,且計費按無聲視頻計算,默認值是true。prompt_extend:是否開啟prompt智能改寫。開啟後使用大模型對輸入prompt進行智能改寫。對於較短的prompt生成效果提升明顯,但會增加耗時,默認值是true。prompt:提示詞。callback_url:需要回調結果的URL。

success,此時視頻生成任務的狀態情況。task_id,此時視頻生成任務ID。video_url,此時視頻生成任務的視頻鏈接。state,此時視頻生成任務的狀態。

video_url 的視頻鏈接地址獲取生成的通義萬相視頻即可。

另外如果想生成對應的對接代碼,可以直接複製生成,例如 CURL 的代碼如下:

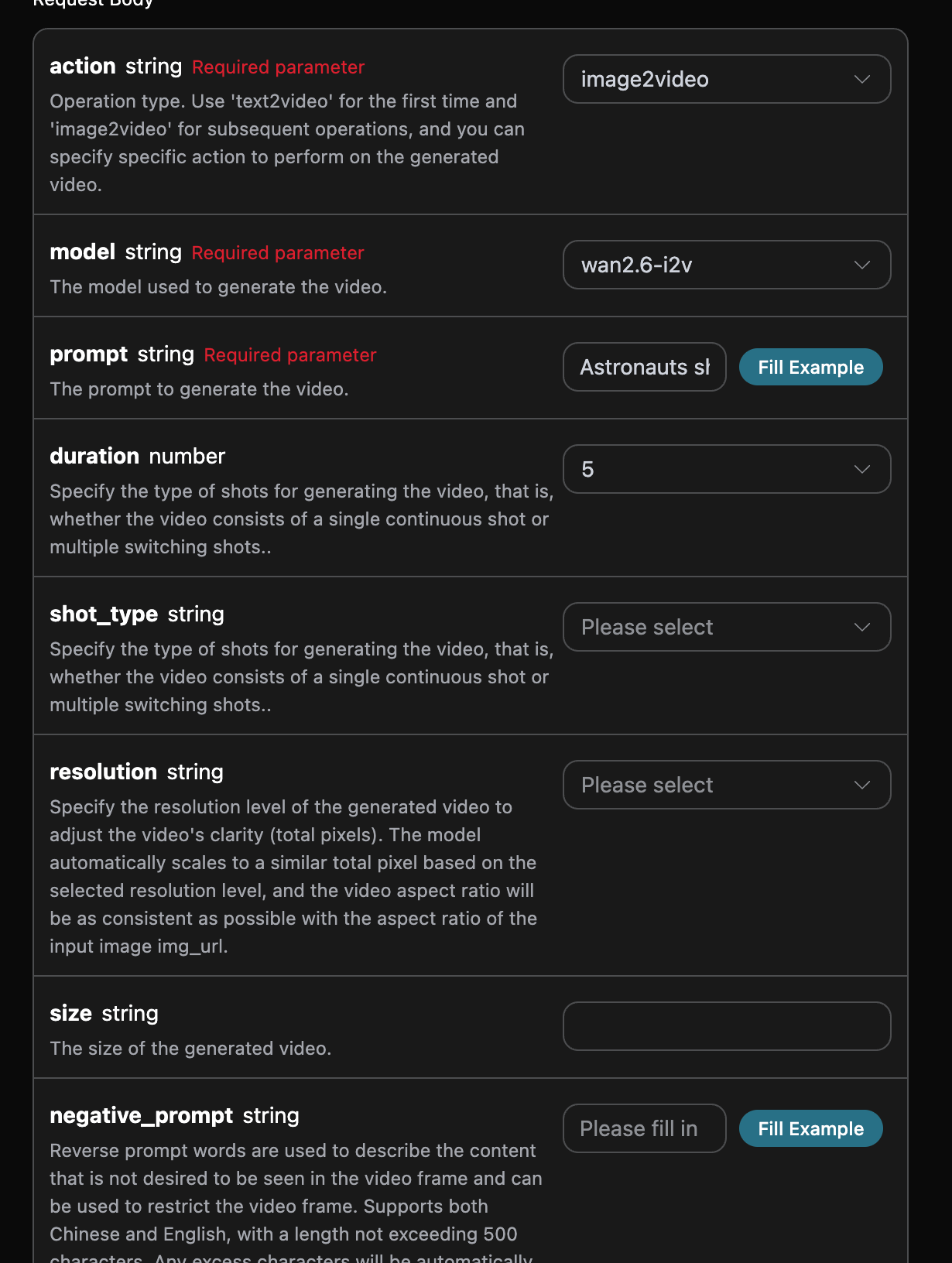

圖生視頻功能

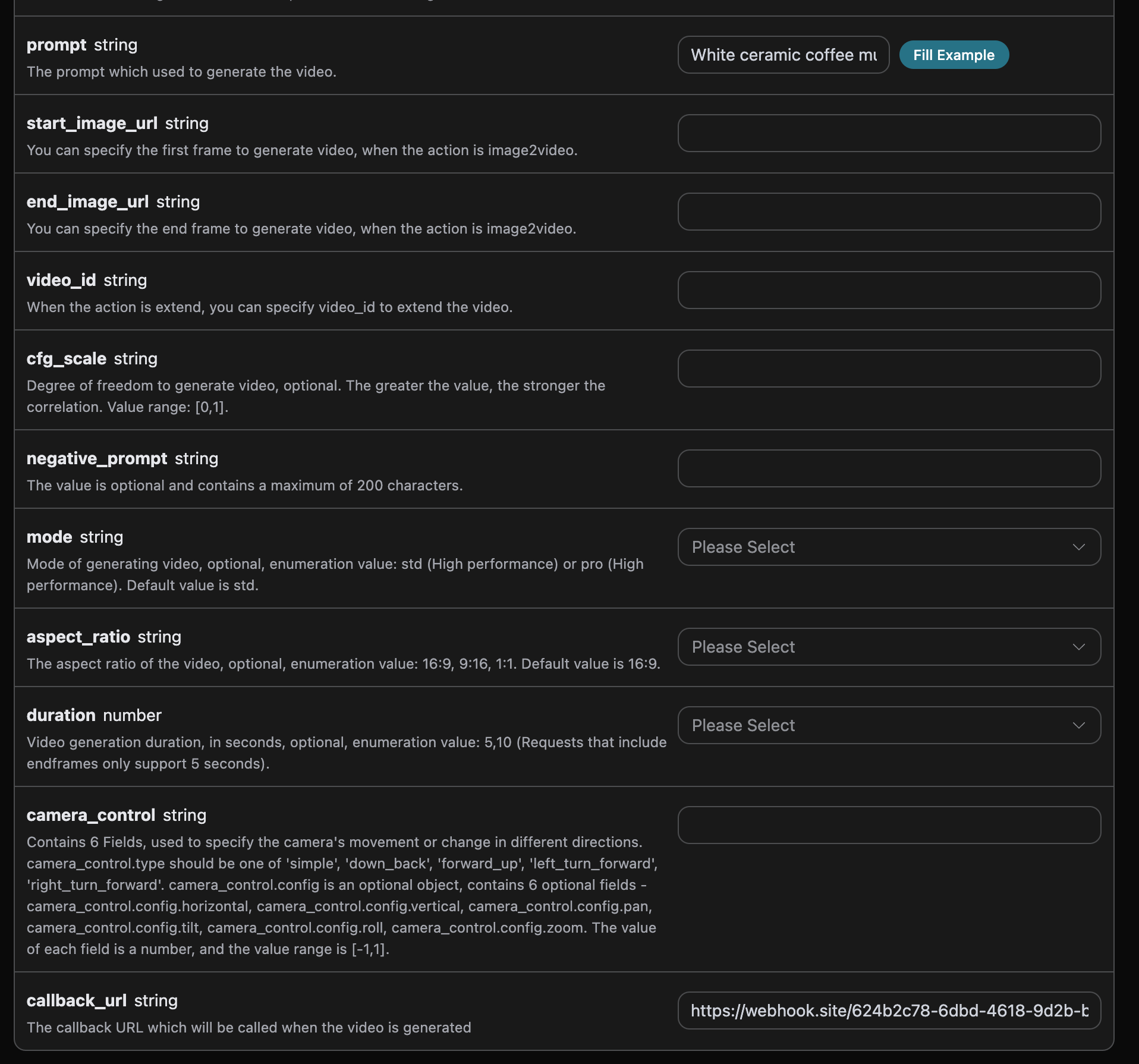

如果想對參考圖或者參考視頻來生成視頻的話,可以將參數action 設置為 image2video,並且輸入需要參考圖鏈接或者參考視頻鏈接,接下來我們必須填寫下一步需要擴展的提示詞來自定義生成視頻,就可以指定如下內容:

model:生成視頻的模型,主要有wan2.6-i2v、wan2.6-r2v、wan2.6-i2v-flash、wan2.6-t2v模型。image_url:當選擇圖生視頻行為image2video就必須需要上傳的首幀參考圖片鏈接,目前只支持模型wan2.6-i2v、wan2.6-i2v-flash。reference_video_urls:圖生視頻時可選,指定參考的視頻鏈接進行生成,目前只支持模型wan2.6-r2v。prompt:提示詞。

異步回調

由於 Wan Videos Generation API生成的時間相對較長,大約需要 1-2 分鐘,如果 API 長時間無響應,HTTP 請求會一直保持連接,導致額外的系統資源消耗,所以本 API 也提供了異步回調的支持。 整體流程是:客戶端發起請求的時候,額外指定一個callback_url 字段,客戶端發起 API 請求之後,API 會立馬返回一個結果,包含一個 task_id 的字段信息,代表當前的任務 ID。當任務完成之後,生成視頻的結果會通過 POST JSON 的形式發送到客戶端指定的 callback_url,其中也包括了 task_id 字段,這樣任務結果就可以通過 ID 關聯起來了。

下面我們通過示例來了解具體怎樣操作。

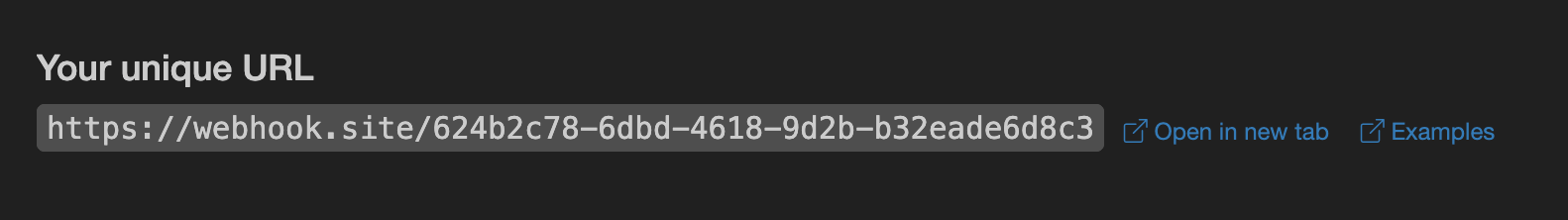

首先,Webhook 回調是一個可以接收 HTTP 請求的服務,開發者應該替換為自己搭建的 HTTP 伺服器的 URL。此處為了方便演示,使用一個公開的 Webhook 樣例網站 https://webhook.site/,打開該網站即可得到一個 Webhook URL,如圖所示:

將此 URL 複製下來,就可以作為 Webhook 來使用,此處的樣例為

將此 URL 複製下來,就可以作為 Webhook 來使用,此處的樣例為 https://webhook.site/624b2c78-6dbd-4618-9d2b-b32eade6d8c3。

接下來,我們可以設置字段 callback_url 為上述 Webhook URL,同時填入相應的參數,具體的內容如圖所示:

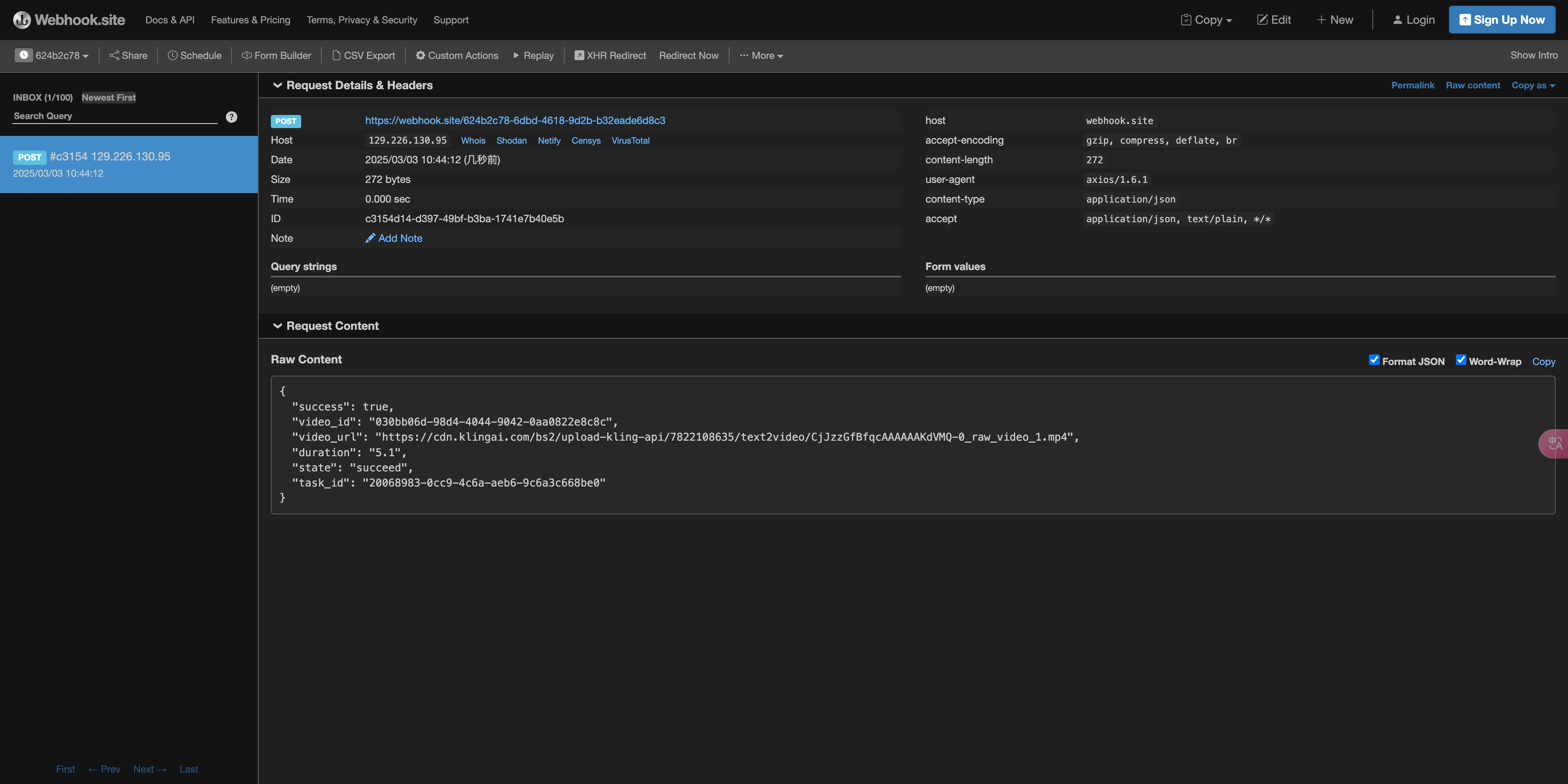

https://webhook.site/624b2c78-6dbd-4618-9d2b-b32eade6d8c3 上觀察到生成視頻的結果,如圖所示:

內容如下:

內容如下:

task_id 字段,其他的字段都和上文類似,通過該字段即可實現任務的關聯。

錯誤處理

在調用 API 時,如果遇到錯誤,API 會返回相應的錯誤代碼和信息。例如:400 token_mismatched:Bad request, possibly due to missing or invalid parameters.400 api_not_implemented:Bad request, possibly due to missing or invalid parameters.401 invalid_token:Unauthorized, invalid or missing authorization token.429 too_many_requests:Too many requests, you have exceeded the rate limit.500 api_error:Internal server error, something went wrong on the server.