Fluxo de Solicitação

Para usar a API OpenAI Chat Completion, primeiro você pode acessar a página OpenAI Chat Completion API e clicar no botão “Acquire” para obter as credenciais necessárias para a solicitação: Se você ainda não estiver logado ou registrado, será redirecionado automaticamente para a página de login, convidando-o a se registrar e fazer login. Após o registro e login, você será redirecionado de volta para a página atual.

Na primeira solicitação, haverá um crédito gratuito disponível, permitindo o uso gratuito dessa API.

Se você ainda não estiver logado ou registrado, será redirecionado automaticamente para a página de login, convidando-o a se registrar e fazer login. Após o registro e login, você será redirecionado de volta para a página atual.

Na primeira solicitação, haverá um crédito gratuito disponível, permitindo o uso gratuito dessa API.

Uso Básico

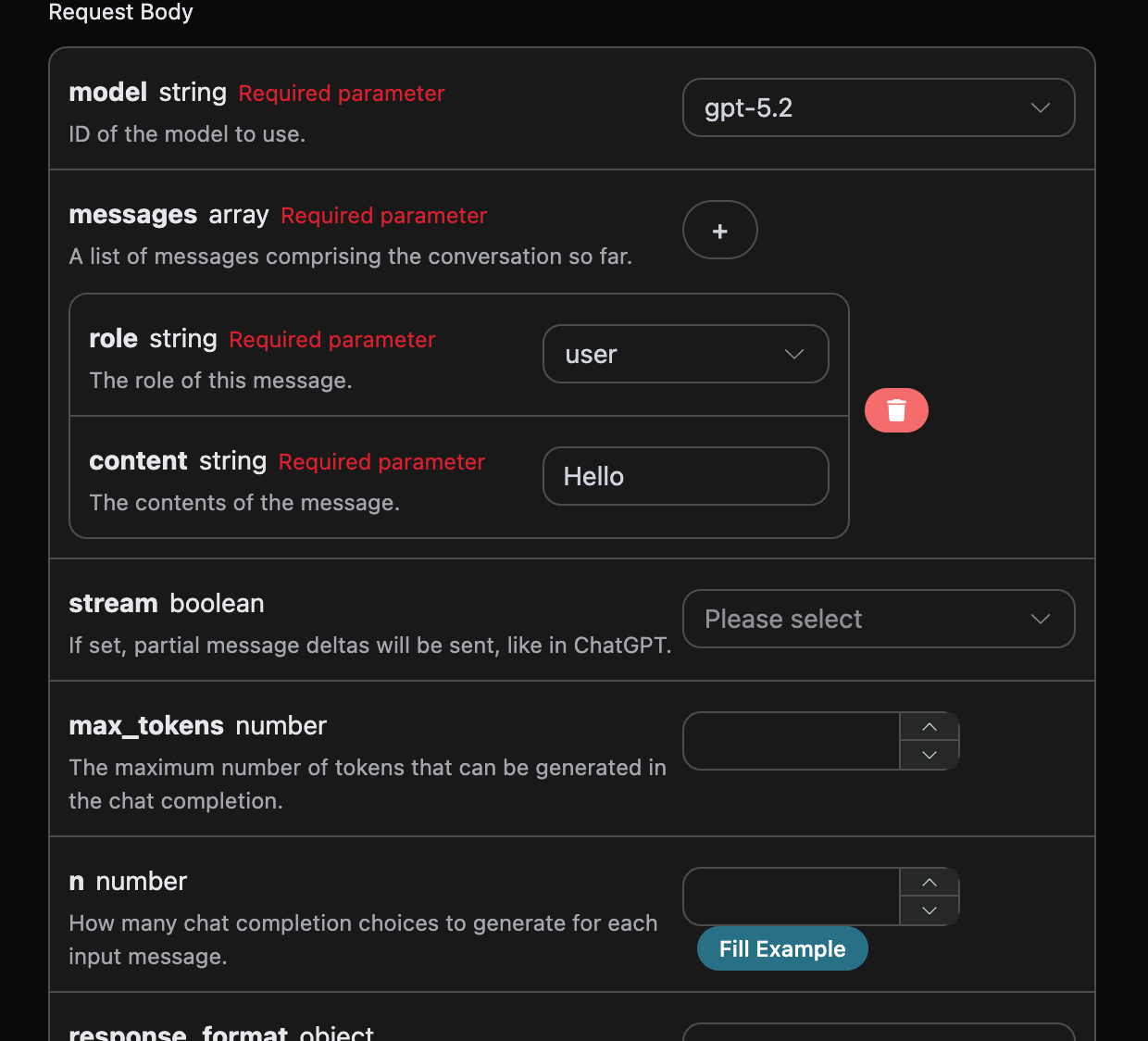

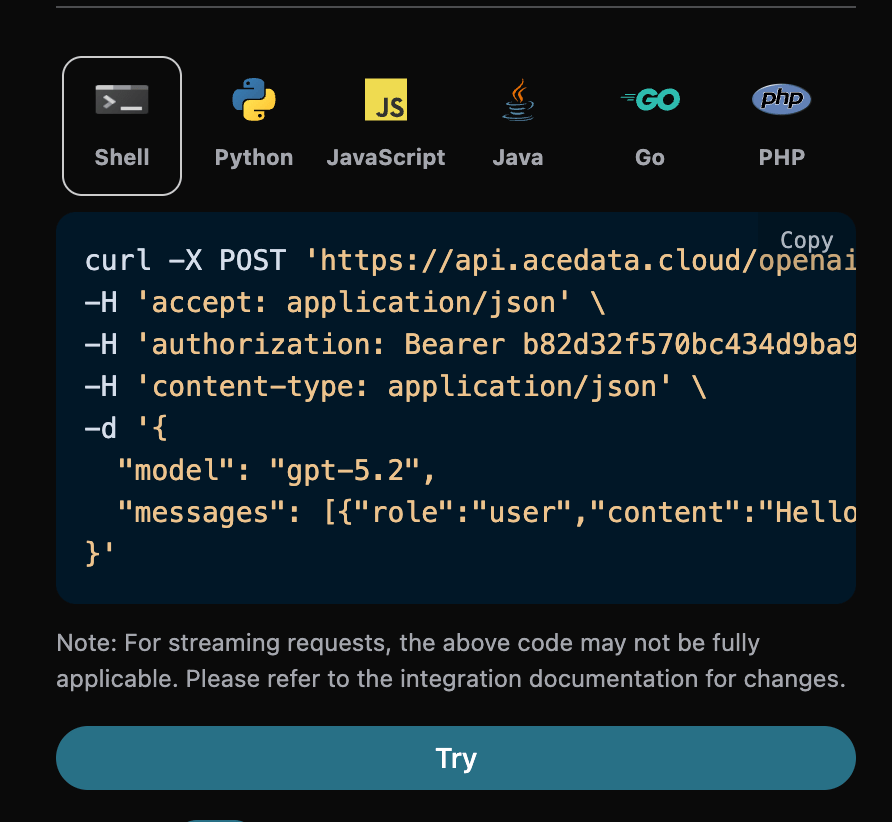

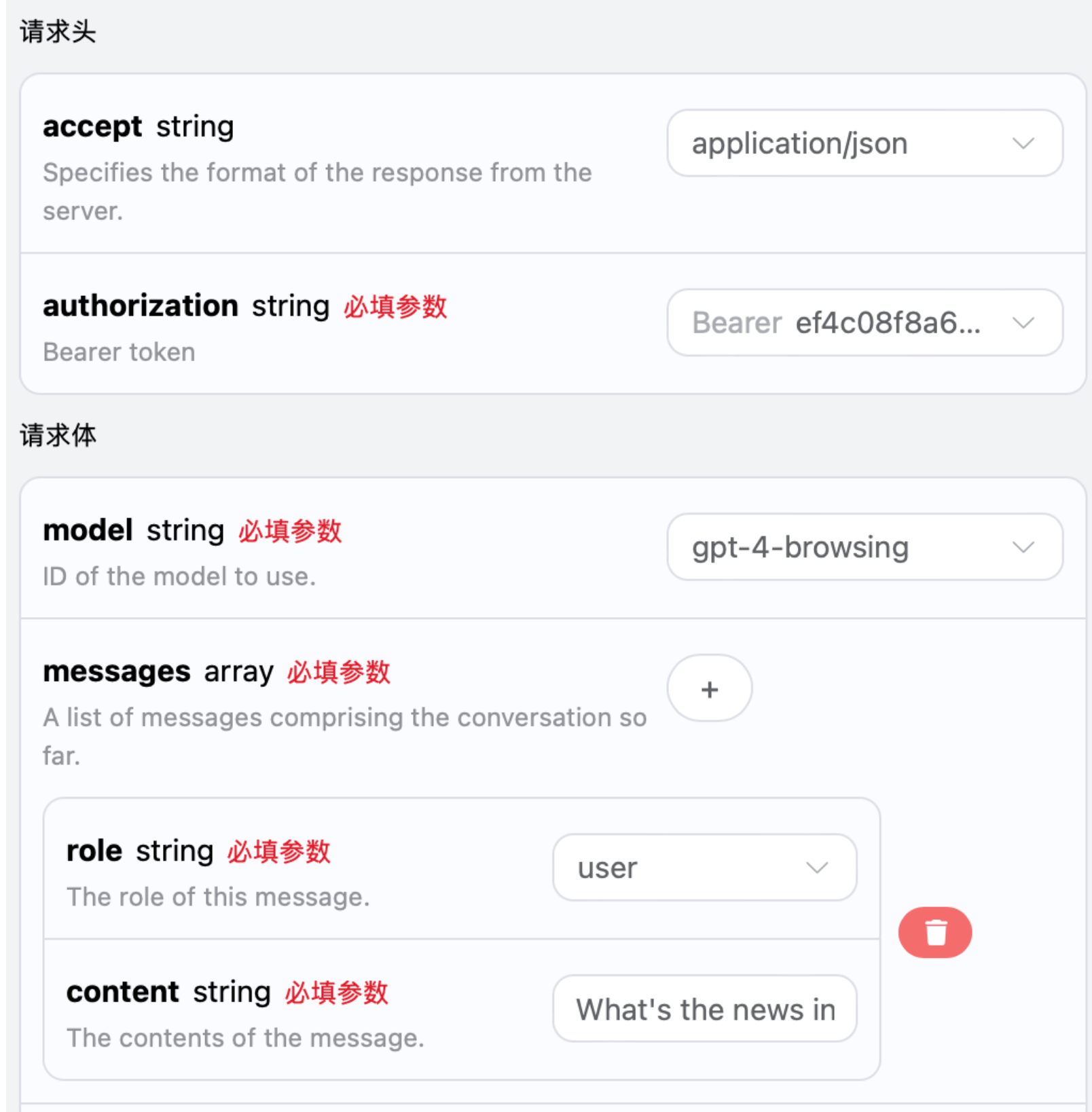

Em seguida, você pode preencher o conteúdo correspondente na interface, como mostrado na imagem:

authorization, que pode ser selecionado diretamente na lista suspensa. O outro parâmetro é model, que é a categoria do modelo do OpenAI ChatGPT que escolhemos usar; aqui temos principalmente 20 modelos, e os detalhes podem ser vistos nos modelos que fornecemos. O último parâmetro é messages, que é um array de palavras-chave que inserimos, representando a possibilidade de enviar várias palavras-chave ao mesmo tempo, onde cada palavra-chave contém role e content, sendo que role representa o papel do questionador, e oferecemos três identidades: user, assistant, system. O outro content é o conteúdo específico da nossa pergunta.

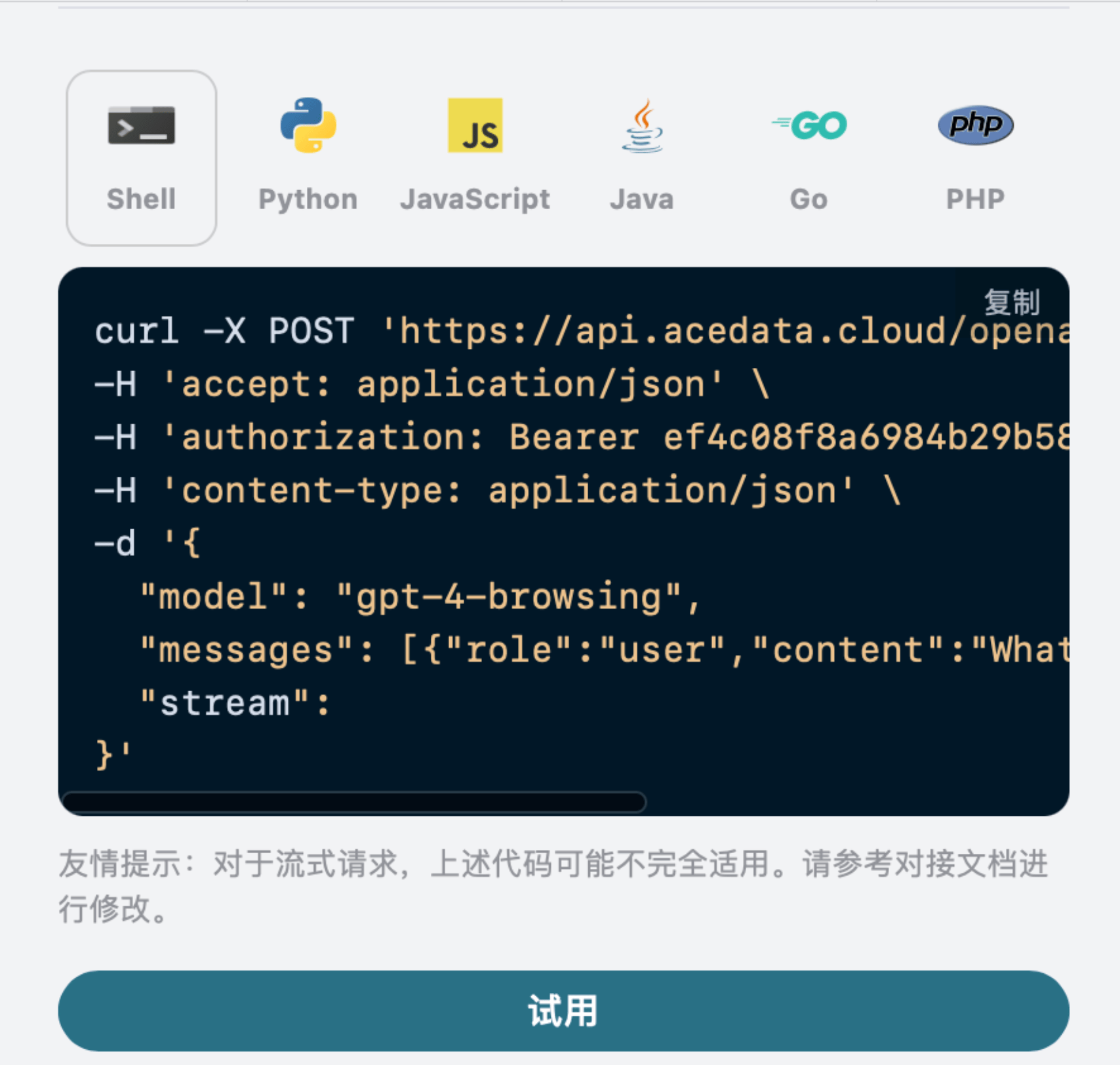

Você também pode notar que há um código de chamada correspondente gerado à direita, que você pode copiar e executar diretamente, ou pode clicar no botão “Try” para testar.

Parâmetros opcionais comuns:

max_tokens: limita o número máximo de tokens na resposta única.temperature: gera aleatoriedade, entre 0-2, quanto maior o valor, mais disperso.n: quantas respostas candidatas gerar de uma vez.response_format: configuração do formato de retorno.

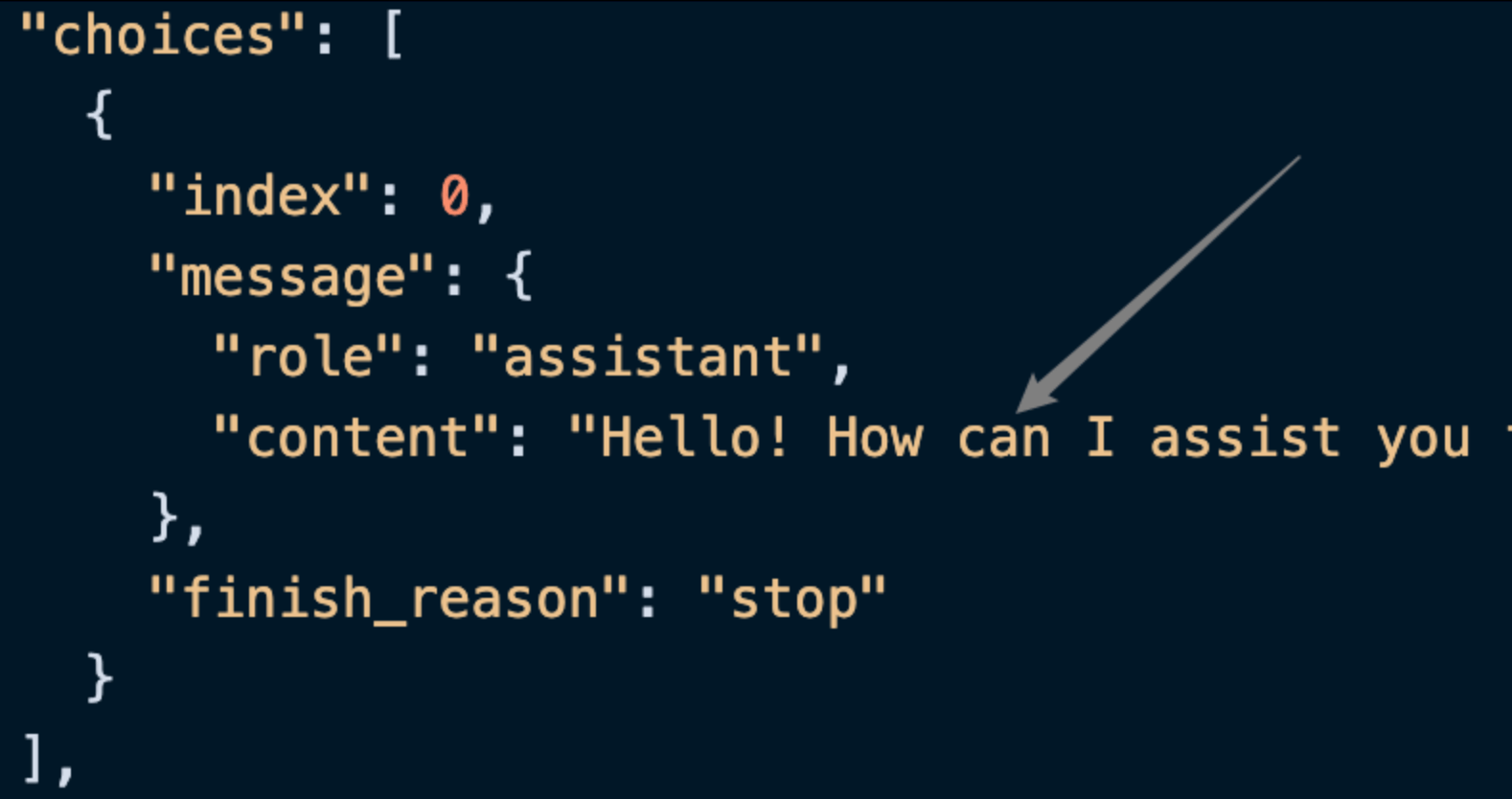

id, o ID da tarefa de diálogo gerada, usado para identificar exclusivamente essa tarefa de diálogo.model, o modelo do OpenAI ChatGPT escolhido.choices, as informações de resposta que o ChatGPT fornece para as palavras-chave.usage: informações estatísticas sobre os tokens para esta pergunta e resposta.

choices contém as informações de resposta do ChatGPT, onde podemos ver como mostrado na imagem.

content dentro de choices contém o conteúdo específico da resposta do ChatGPT.

Resposta em Fluxo

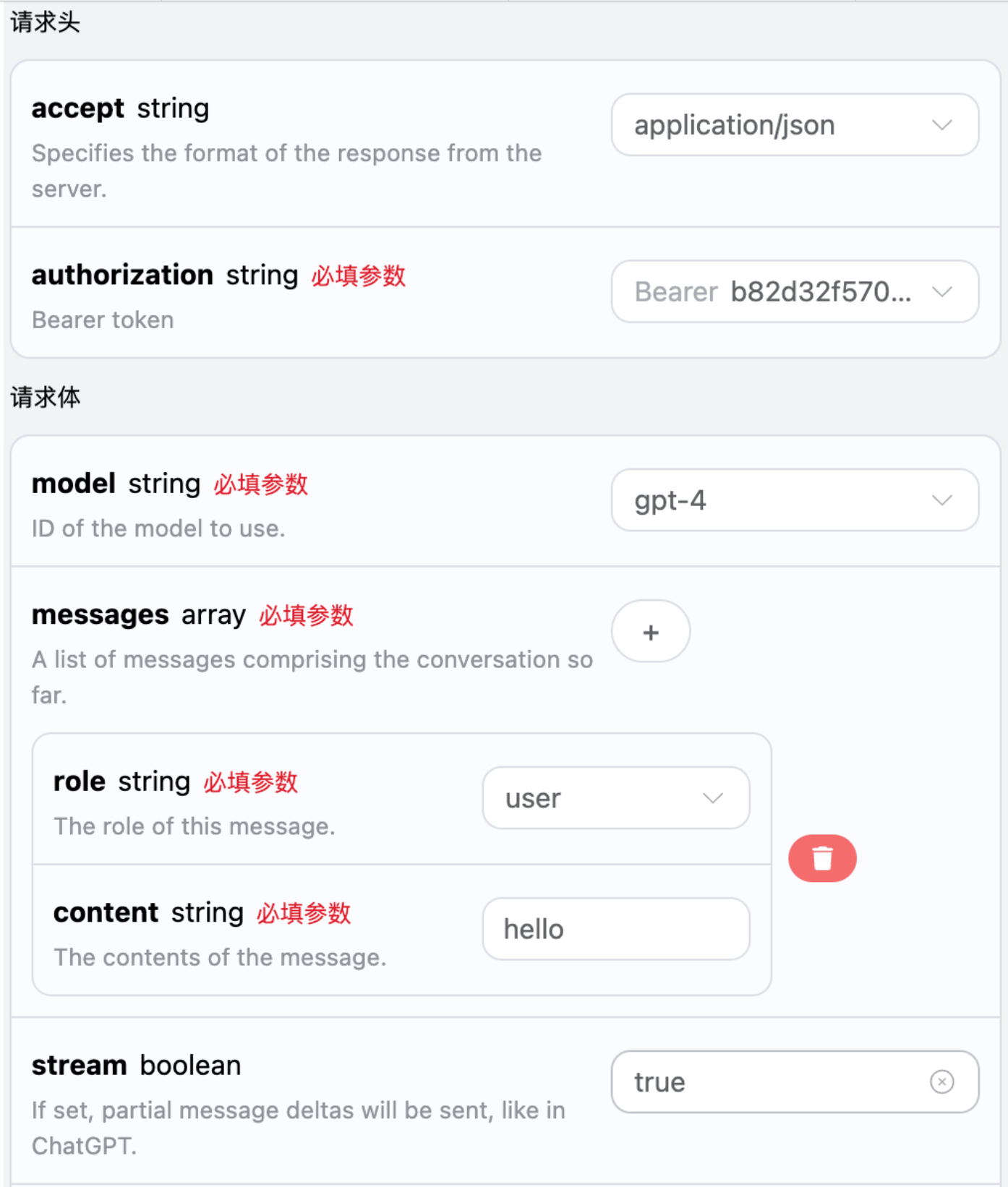

Essa interface também suporta resposta em fluxo, o que é muito útil para integração com páginas da web, permitindo que a página exiba o efeito de exibição palavra por palavra. Se você deseja retornar a resposta em fluxo, pode alterar o parâmetrostream no cabeçalho da solicitação para true.

A modificação é mostrada na imagem, mas o código de chamada precisa ter as alterações correspondentes para suportar a resposta em fluxo.

stream para true, a API retornará os dados JSON correspondentes linha por linha, e no nível do código, precisamos fazer as modificações necessárias para obter os resultados linha por linha.

Exemplo de código de chamada em Python:

data, onde data contém as choices, que são o conteúdo da resposta mais recente, consistente com o conteúdo apresentado anteriormente. choices é o novo conteúdo da resposta, que você pode integrar ao seu sistema. Além disso, o término da resposta em fluxo é determinado pelo conteúdo de data; se o conteúdo for [DONE], isso indica que a resposta em fluxo foi completamente finalizada. O resultado retornado em data possui vários campos, conforme descrito a seguir:

id, o ID gerado para esta tarefa de diálogo, usado para identificar exclusivamente esta tarefa de diálogo.model, o modelo escolhido do site oficial do OpenAI ChatGPT.choices, as informações de resposta que o ChatGPT forneceu em resposta à pergunta.

Diálogo em várias rodadas

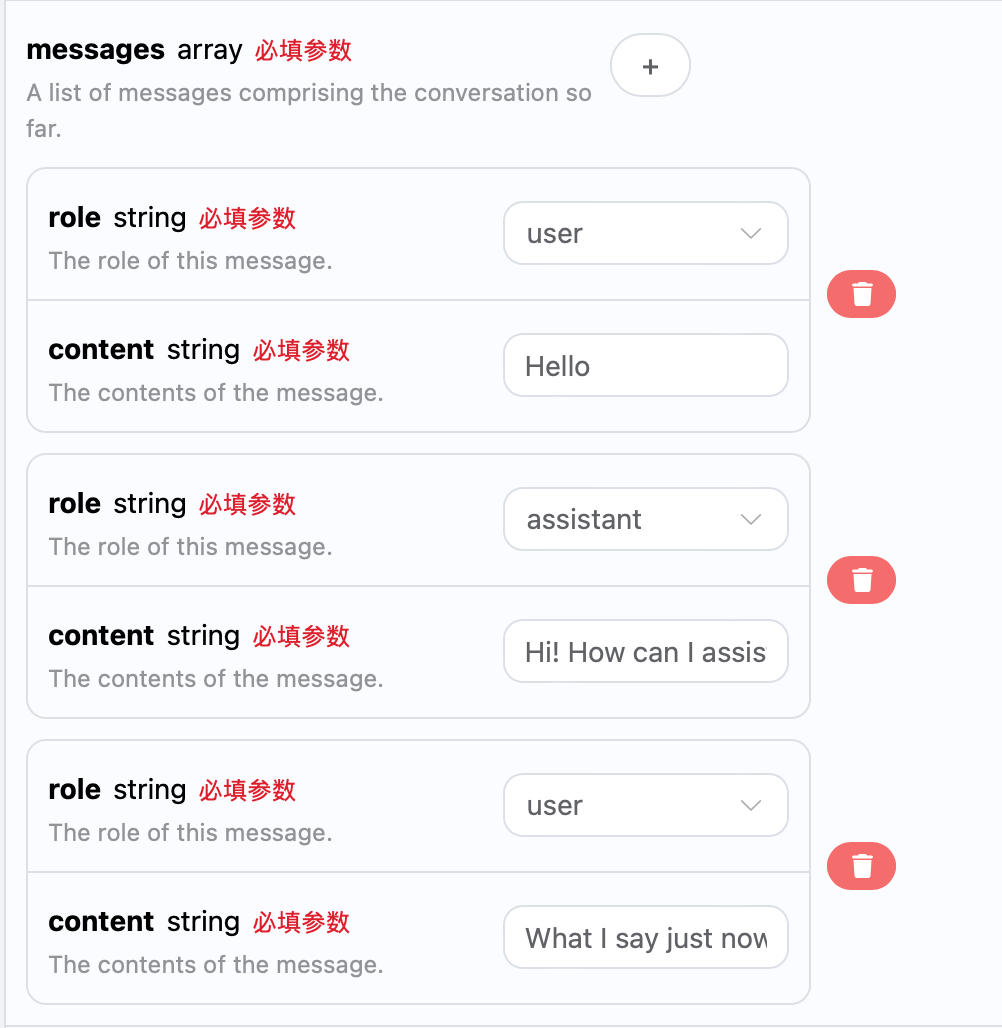

Se você deseja integrar a funcionalidade de diálogo em várias rodadas, precisa enviar vários termos de pergunta no campomessages, exemplos específicos de vários termos de pergunta são mostrados na imagem abaixo:

choices são consistentes com o conteúdo de uso básico, incluindo o conteúdo específico da resposta do ChatGPT a múltiplos diálogos, permitindo assim responder a perguntas correspondentes com base em múltiplos conteúdos de diálogo.

Integração com OpenAI-Python

O serviço da API de conclusão de chat do OpenAI é alimentado pelo serviço oficial do OpenAI, que pode ser consultado no OpenAI-Python. Este artigo irá apresentar brevemente como usar o serviço fornecido oficialmente.- Primeiro, é necessário configurar um ambiente local de

Python, este processo pode ser pesquisado no Google. - Baixe e instale um ambiente de desenvolvimento, como o editor VSCode.

- Configure a variável de ambiente

OpenAI.

- No diretório do projeto, crie um arquivo chamado

.enve salve. - Conteúdo do arquivo

.env:

sk-xxx pela sua própria chave. OPENAI_BASE_URL é a interface proxy para acessar o OpenAI.

- Instale os pacotes de dependência do projeto.

- Crie um arquivo de código de exemplo.

index.py, com o seguinte conteúdo:

Modelo de Navegação

Os modelos gpt-3.5-browsing e gpt-4-browsing diferem de outros modelos, pois podem realizar buscas na internet com base nas perguntas e retornar os resultados ajustados para você. Este artigo irá demonstrar a funcionalidade de navegação com um exemplo específico, e você pode preencher o conteúdo correspondente na interface da API de conclusão de chat do OpenAI, como mostrado na imagem:

choices são obtidas com base na consulta à internet e também fornecem links relevantes. As informações de resposta dentro de choices devem ser renderizadas usando a sintaxe markdown para obter a melhor experiência, refletindo assim a poderosa vantagem da funcionalidade de navegação do nosso modelo.

Modelo Visual

gpt-4o é um modelo de linguagem de grande porte multimodal desenvolvido pela OpenAI, que adiciona capacidade de compreensão visual ao GPT-4. Este modelo pode processar simultaneamente entradas de texto e imagem, realizando compreensão e geração multimodal. O processamento de texto usando o modelo gpt-4o é consistente com o conteúdo de uso básico mencionado anteriormente. Abaixo, será apresentada uma breve introdução sobre como usar a capacidade de processamento de imagem do modelo. A capacidade de processamento de imagem do modelo gpt-4o é principalmente ativada adicionando um campotype ao conteúdo original de content, permitindo saber se o que está sendo enviado é texto ou imagem, e assim utilizar a capacidade de processamento de imagem do modelo gpt-4o. A seguir, serão abordadas duas maneiras de chamar essa funcionalidade: usando Curl e Python.

- Método de script Curl

- Método de script Python

Modelo de Desenho GPT-4o

Exemplo de solicitação:Tratamento de Erros

Ao chamar a API, se ocorrer um erro, a API retornará o código de erro e a informação correspondente. Por exemplo:400 token_mismatched: Solicitação inválida, possivelmente devido a parâmetros ausentes ou inválidos.400 api_not_implemented: Solicitação inválida, possivelmente devido a parâmetros ausentes ou inválidos.401 invalid_token: Não autorizado, token de autorização inválido ou ausente.429 too_many_requests: Muitas solicitações, você excedeu o limite de taxa.500 api_error: Erro interno do servidor, algo deu errado no servidor.