messages. Para completar um diálogo contínuo, precisamos passar todo o histórico de contexto, além de lidar com o problema de limite de Token.

A API de perguntas e respostas da AceDataCloud foi otimizada para essa situação, garantindo que a eficácia das respostas permaneça inalterada, encapsulando a implementação de diálogos contínuos, sem a necessidade de se preocupar com a passagem de messages ou com o problema de limite de Token (que é tratado automaticamente internamente pela API). Além disso, também oferece funcionalidades de consulta e modificação de diálogos, simplificando bastante a integração.

Este documento apresentará as instruções para a integração da API de perguntas e respostas.

Processo de Solicitação

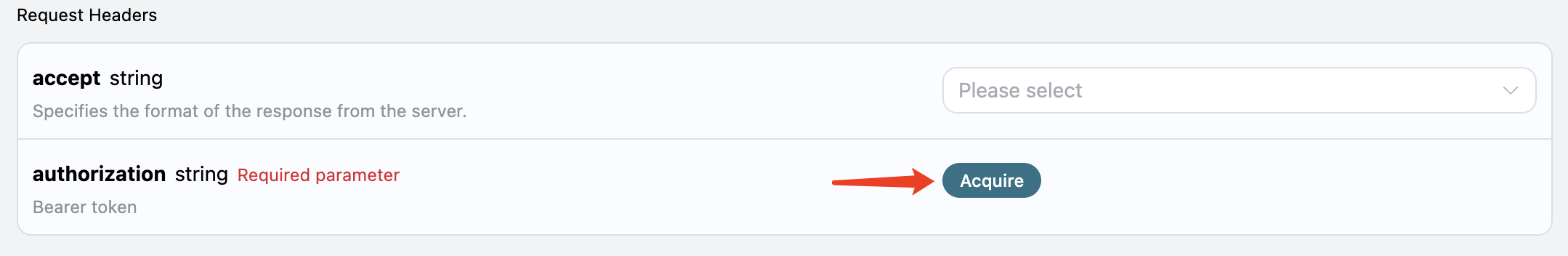

Para usar a API, você precisa primeiro acessar a página correspondente da API de Perguntas e Respostas e solicitar o serviço correspondente. Após entrar na página, clique no botão “Acquire”, conforme mostrado na imagem: Se você ainda não estiver logado ou registrado, será redirecionado automaticamente para a página de login, convidando-o a se registrar e fazer login. Após o registro e login, você será redirecionado de volta para a página atual.

Na primeira solicitação, haverá um crédito gratuito disponível, permitindo que você use a API sem custo.

Se você ainda não estiver logado ou registrado, será redirecionado automaticamente para a página de login, convidando-o a se registrar e fazer login. Após o registro e login, você será redirecionado de volta para a página atual.

Na primeira solicitação, haverá um crédito gratuito disponível, permitindo que você use a API sem custo.

Uso Básico

Primeiro, entenda a forma básica de uso, que é inserir uma pergunta e obter uma resposta, bastando passar um campoquestion e especificar o modelo correspondente.

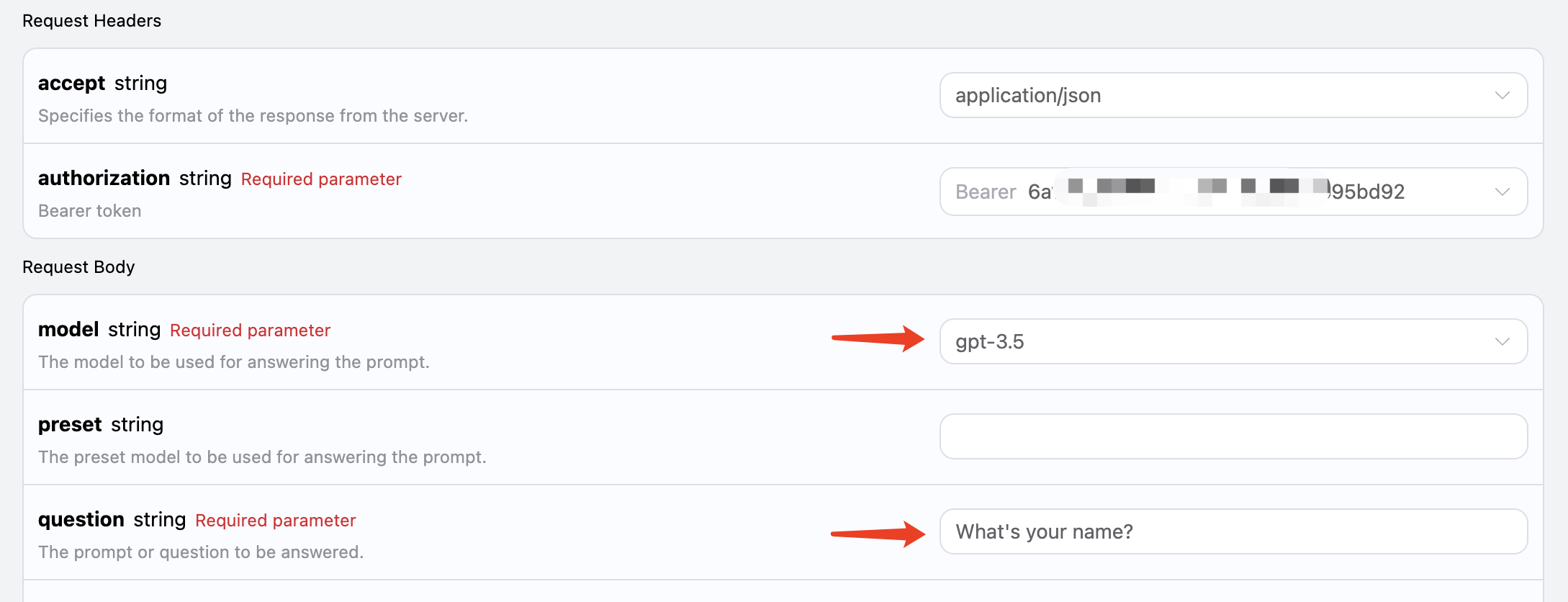

Por exemplo, ao perguntar: “What’s your name?”, você pode preencher o conteúdo correspondente na interface, conforme mostrado na imagem:

Podemos ver que configuramos os Request Headers, incluindo:

Podemos ver que configuramos os Request Headers, incluindo:

accept: o formato de resposta desejado, aqui preenchido comoapplication/json, ou seja, formato JSON.authorization: a chave para chamar a API, que pode ser selecionada diretamente após a solicitação.

model: a escolha do modelo, como o popular GPT 3.5, GPT 4, etc.question: a pergunta a ser feita, que pode ser qualquer texto simples.

answer, que é a resposta à pergunta. Você pode inserir qualquer pergunta e obter qualquer resposta.

Se você não precisar de suporte para diálogos múltiplos, esta API pode facilitar muito sua integração.

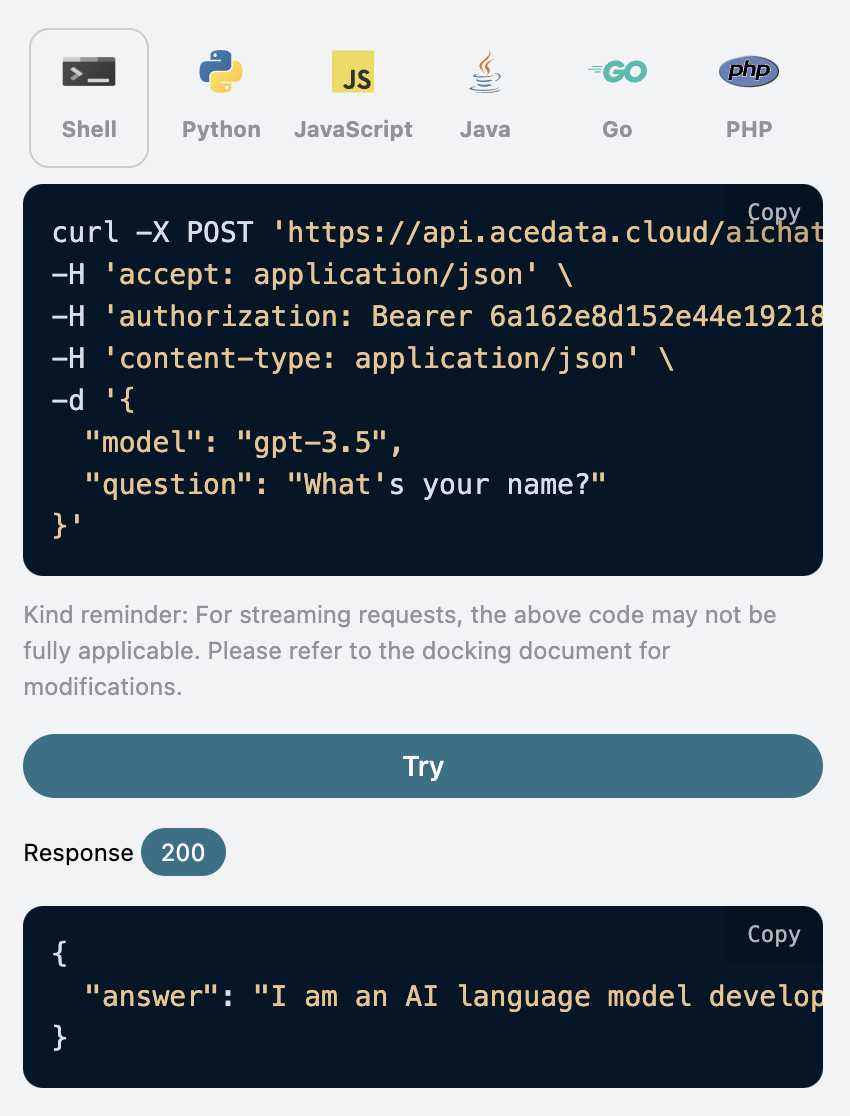

Além disso, se você quiser gerar o código de integração correspondente, pode copiá-lo diretamente, como o código CURL abaixo:

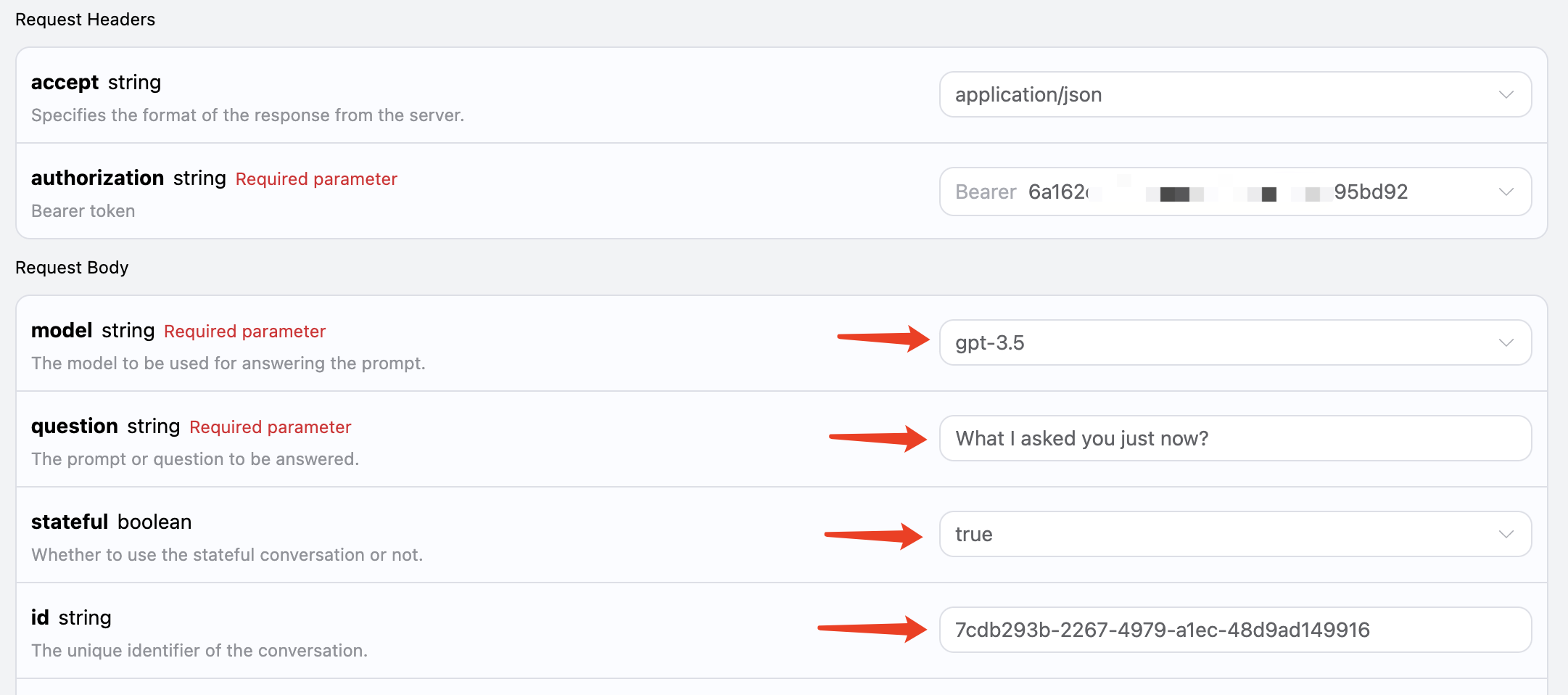

Diálogo Múltiplo

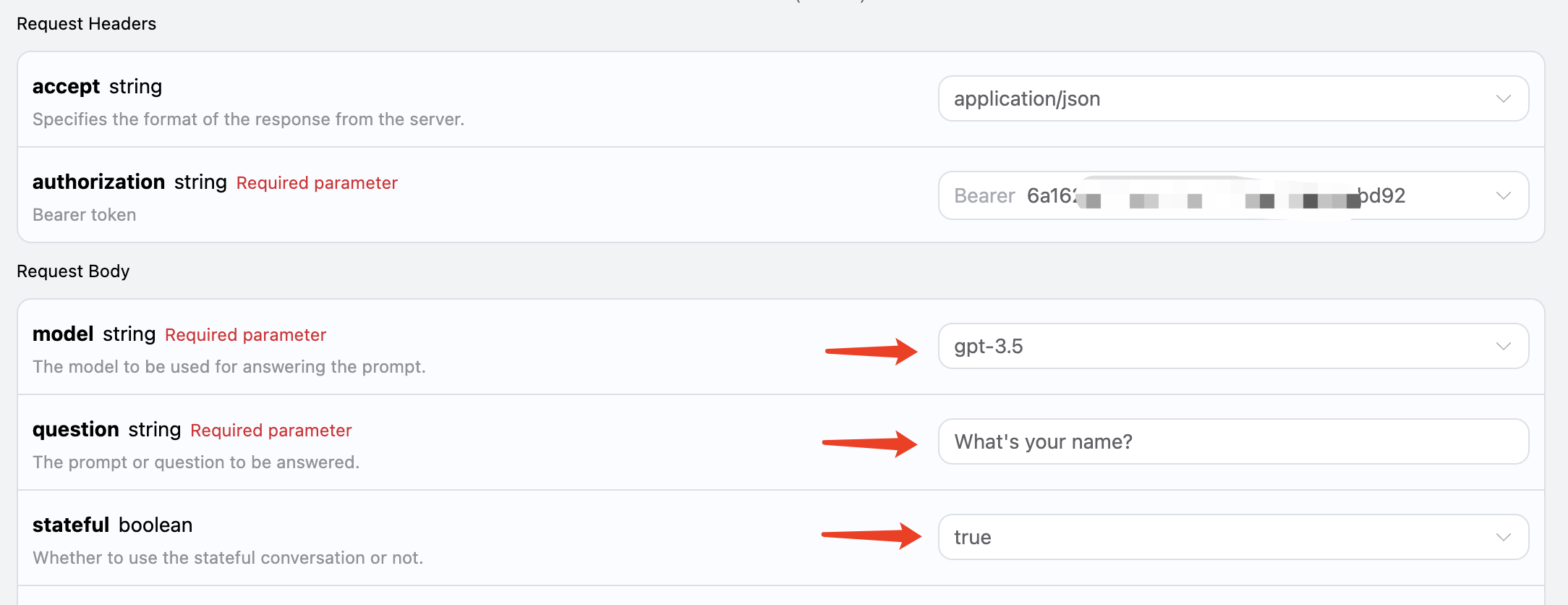

Se você deseja integrar a funcionalidade de diálogo múltiplo, precisa passar um parâmetro adicionalstateful, cujo valor deve ser true. Em cada solicitação subsequente, esse parâmetro deve ser incluído. Após passar o parâmetro stateful, a API retornará um parâmetro id adicional, representando o ID do diálogo atual, e nas solicitações subsequentes, você só precisa passar esse ID como parâmetro para implementar facilmente o diálogo múltiplo.

Vamos demonstrar a operação específica.

Na primeira solicitação, defina o parâmetro stateful como true e passe normalmente os parâmetros model e question, conforme mostrado na imagem:

O código correspondente é o seguinte:

O código correspondente é o seguinte:

id retornado da primeira solicitação como parâmetro, mantendo o parâmetro stateful como true, e pergunte “What I asked you just now?”, conforme mostrado na imagem:

O código correspondente é o seguinte:

O código correspondente é o seguinte:

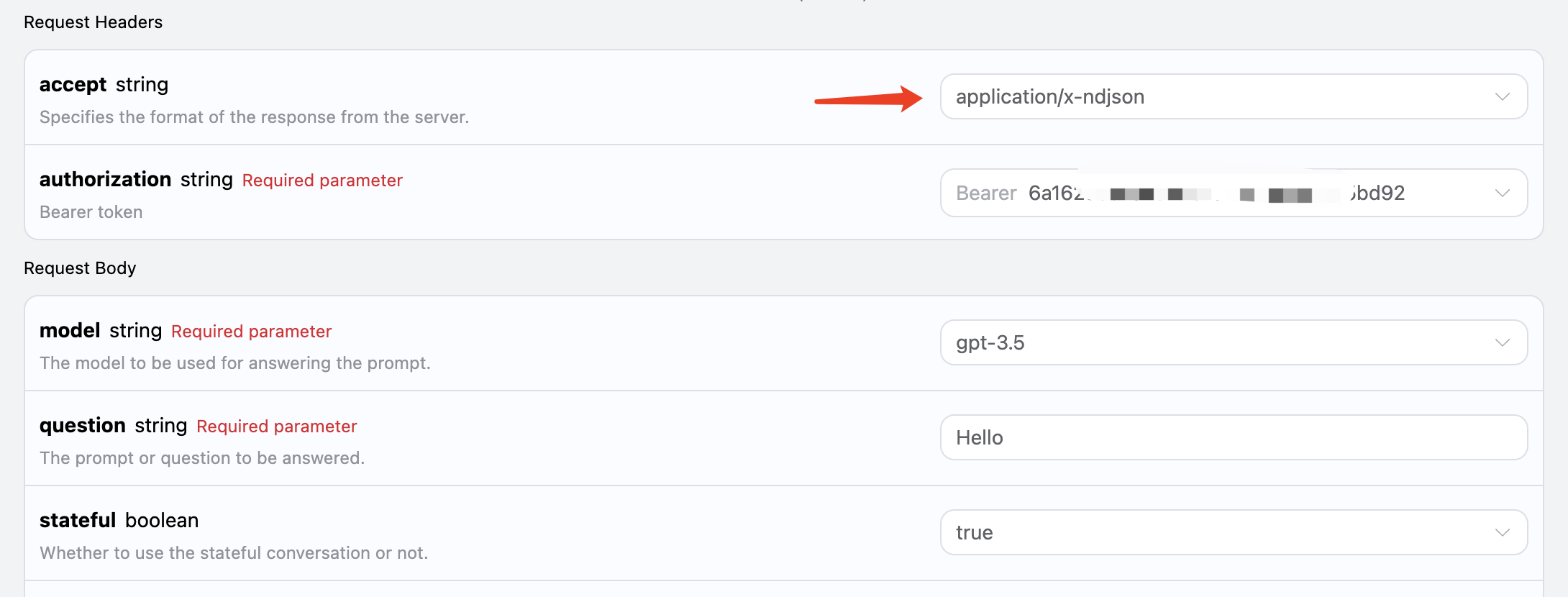

Resposta em Fluxo

Esta interface também suporta resposta em fluxo, o que é muito útil para a integração em páginas da web, permitindo que a página exiba o resultado palavra por palavra. Se você deseja retornar a resposta em fluxo, pode alterar o parâmetroaccept no cabeçalho da solicitação para application/x-ndjson.

A modificação é mostrada na imagem, mas o código de chamada precisa ser alterado para suportar a resposta em fluxo.

Após alterar o

Após alterar o accept para application/x-ndjson, a API retornará os dados JSON correspondentes linha por linha, e no nível do código, precisamos fazer as modificações necessárias para obter os resultados linha por linha.

Código de exemplo em Python:

answer é o conteúdo da resposta mais recente, enquanto delta_answer é o conteúdo da resposta adicionada, você pode integrar os resultados ao seu sistema.

JavaScript também é suportado, por exemplo, o código de chamada em fluxo do Node.js é o seguinte:

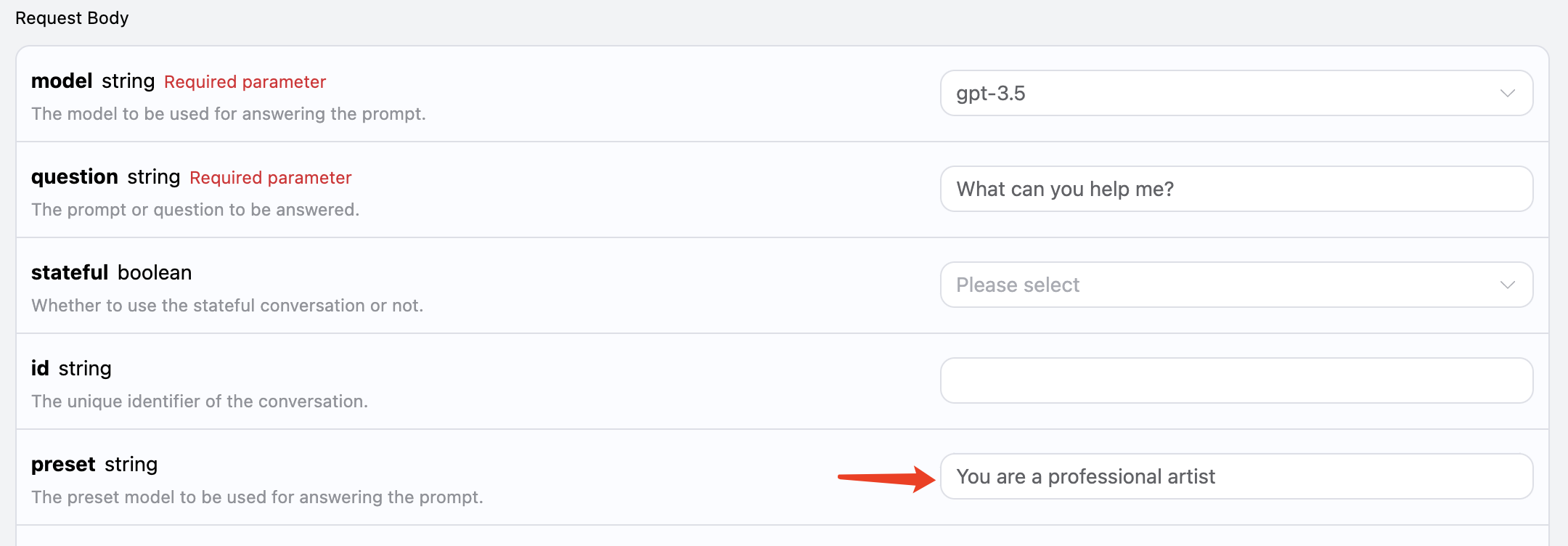

Configuração do Modelo

Sabemos que as APIs relacionadas à OpenAI têm o conceito desystem_prompt, que é definir uma configuração para todo o modelo, como o nome dele, etc. Esta API de perguntas e respostas também expõe esse parâmetro, chamado de preset, que nos permite adicionar configurações ao modelo. Vamos experimentar com um exemplo:

Aqui adicionamos o campo preset, com o conteúdo Você é um artista profissional, como mostrado na imagem:

O código correspondente é o seguinte:

O código correspondente é o seguinte:

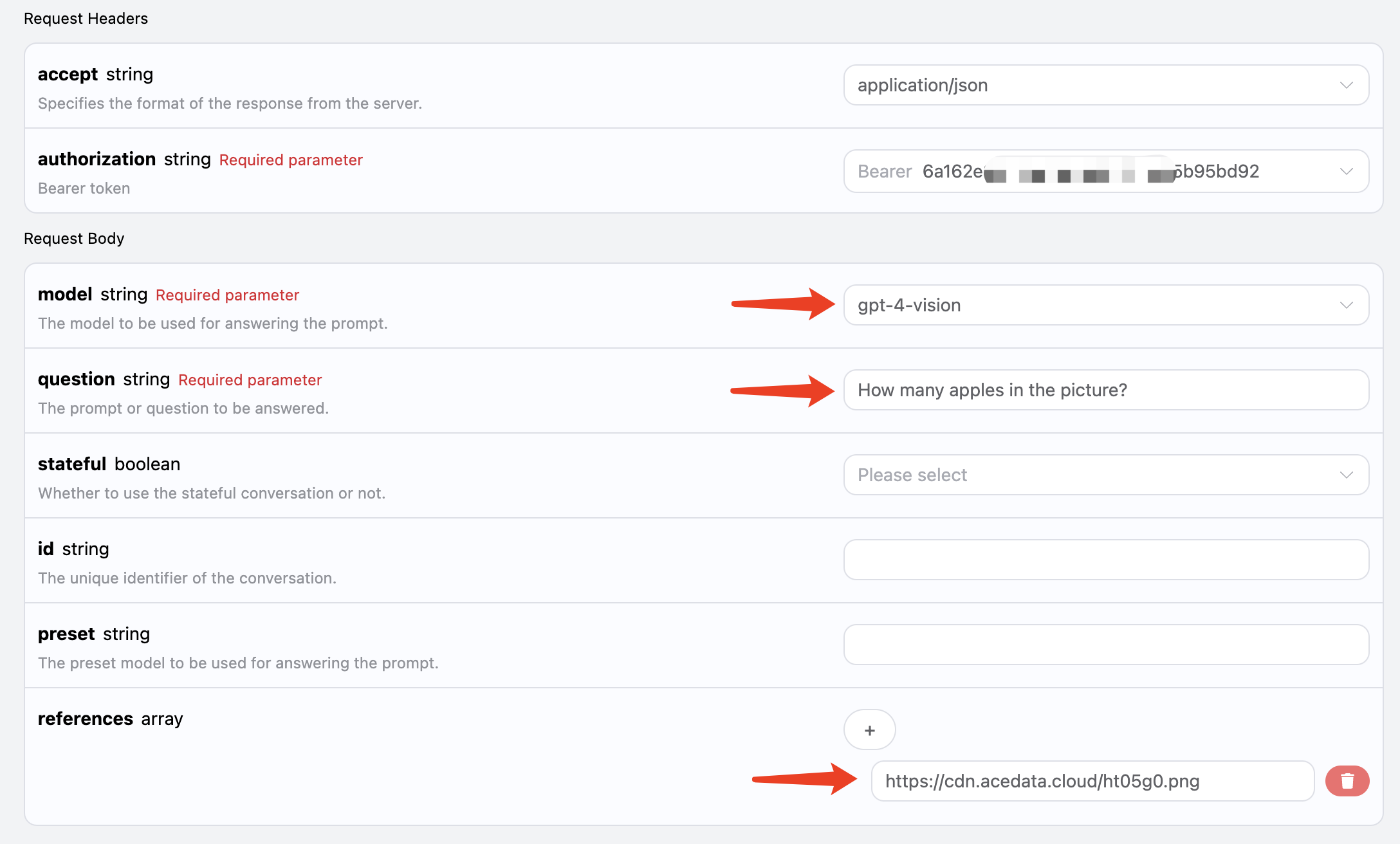

Reconhecimento de Imagens

Esta IA também suporta a adição de anexos para reconhecimento de imagens, passando o link da imagem correspondente através dereferences, por exemplo, aqui temos uma imagem de uma maçã, como mostrado na imagem:

O link da imagem é https://cdn.acedata.cloud/ht05g0.png, podemos simplesmente passá-lo como parâmetro

O link da imagem é https://cdn.acedata.cloud/ht05g0.png, podemos simplesmente passá-lo como parâmetro references, e é importante notar que o modelo deve ser escolhido para suportar reconhecimento visual, atualmente suportado é gpt-4-vision, então a entrada é a seguinte:

O código correspondente é o seguinte:

O código correspondente é o seguinte:

Perguntas e Respostas na Internet

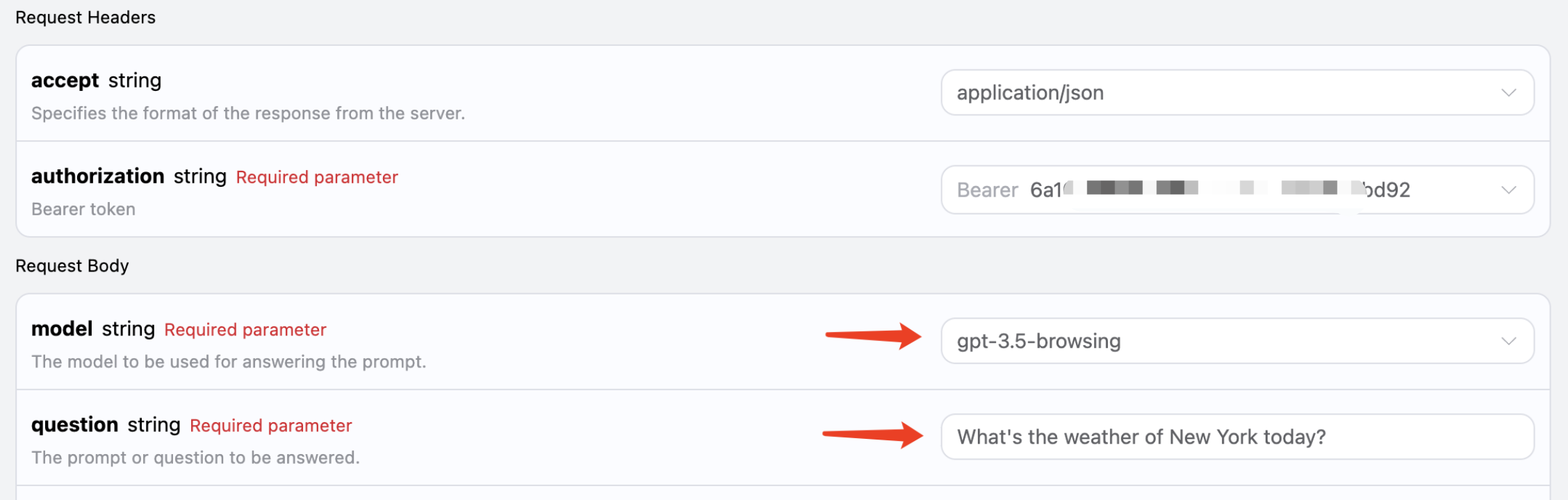

Esta API também suporta modelos conectados à internet, incluindo GPT-3.5 e GPT-4, ambos podem suportar, há um processo automático de busca na internet e resumo por trás da API, podemos escolher o modelo comogpt-3.5-browsing para experimentar, como mostrado na imagem:

O código é o seguinte:

O código é o seguinte:

Se houver uma exigência maior em relação à qualidade da resposta do modelo, você pode trocar o modelo para gpt-4-browsing, o efeito da resposta será melhor.