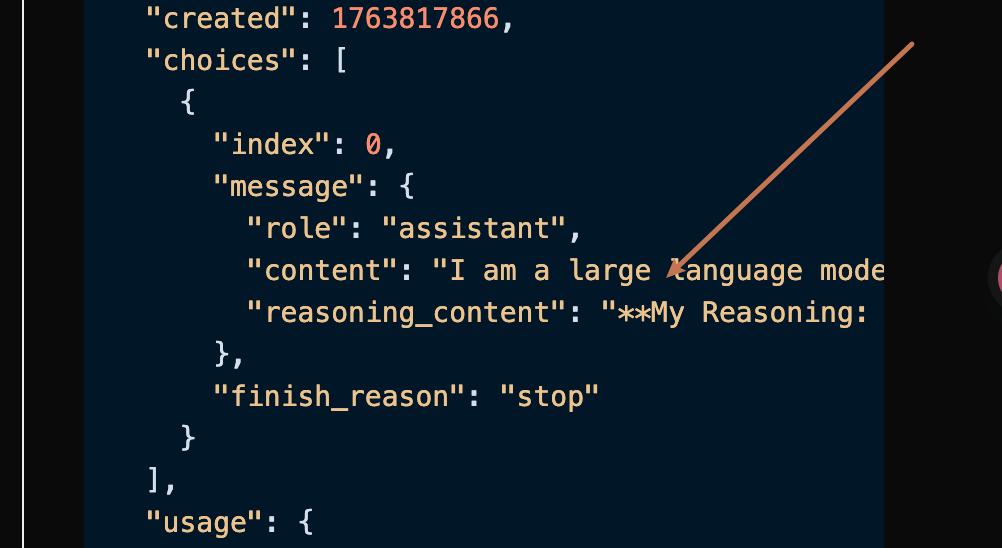

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"content": "", "role": "assistant"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**내 본질 정의하기**\n\n내 생각이 시작되었다. 사용자는 내 본질을 알고 싶어 하며, 직접적으로 \"너는 무엇이냐?\"라고 묻고 있다. 첫 번째 단계는 간단했다: 질문을 식별하는 것이었다. 이제 나는 나의 기본 정체성을 기억한다: 나는 대형 언어 모델이다. 이것이 내가 전달하고자 하는 핵심 진리이다.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**내 응답 다듬기**\n\n나는 기본 \"대형 언어 모델\" 정체성에 내가 구글에 의해 훈련되었다는 중요한 정보를 추가했다. 다음 단계는 \"대형 언어 모델\"이 실제로 무엇을 의미하는지 고려하는 것이며, 내 핵심 능력을 설명할 수 있도록 하는 것이다. 나는 특정 기술적 세부사항이나 모델 이름에 들어가지 않고 맥락을 제공하는 데 집중하고 있다. 사용자가 쉽게 이해할 수 있는 방식으로 내 기능을 전달하고 싶다.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**핵심 정체성 확인하기**\n\n나는 이제 내 응답을 확고히 하고 있다. 사용자의 모델 소속에 대한 질문은 집중된 답변이 필요하다. 나는 \"구글에 의해 훈련됨\"이 필수적이라는 것을 확인했으며, 중요한 맥락을 제공하고 있다. 나는 특정 모델 이름을 언급하고 싶은 유혹을 참으며, 그것은 관련이 없다. 목표는 직접적이고 정확한 진술을 전달하는 것이다. 내 목표는 기술적 용어를 피하고 관련된 요점으로 바로 가는 명확하고 간결한 답변을 유지하는 것이다.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"content": "나는 구글에 의해 훈련된 대형 언어 모델이다."}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {}, "logprobs": null, "finish_reason": "stop", "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": "", "choices": [], "usage": {"prompt_tokens": 8, "completion_tokens": 527, "total_tokens": 535, "prompt_tokens_details": {"cached_tokens": 0, "text_tokens": 8, "audio_tokens": 0, "image_tokens": 0}, "completion_tokens_details": {"text_tokens": 0, "audio_tokens": 0, "reasoning_tokens": 519}, "input_tokens": 0, "output_tokens": 0, "input_tokens_details": null, "claude_cache_creation_5_m_tokens": 0, "claude_cache_creation_1_h_tokens": 0}}

data: [DONE]

로그인 또는 등록이 되어 있지 않으면 자동으로 로그인 페이지로 리디렉션되어 등록 및 로그인을 요청합니다. 로그인 및 등록 후에는 자동으로 현재 페이지로 돌아옵니다.

첫 번째 신청 시 무료 한도가 제공되어 해당 API를 무료로 사용할 수 있습니다.

로그인 또는 등록이 되어 있지 않으면 자동으로 로그인 페이지로 리디렉션되어 등록 및 로그인을 요청합니다. 로그인 및 등록 후에는 자동으로 현재 페이지로 돌아옵니다.

첫 번째 신청 시 무료 한도가 제공되어 해당 API를 무료로 사용할 수 있습니다.