Processo di richiesta

Per utilizzare l’API di completamento chat di Claude, è possibile visitare la pagina API di completamento chat di Claude e fare clic sul pulsante “Acquire” per ottenere le credenziali necessarie per la richiesta: Se non si è ancora registrati o loggati, si verrà automaticamente reindirizzati alla pagina di accesso per registrarsi e accedere. Dopo aver effettuato la registrazione e l’accesso, si verrà riportati automaticamente alla pagina corrente.

Alla prima richiesta, verrà fornito un credito gratuito, che consente di utilizzare gratuitamente questa API.

Se non si è ancora registrati o loggati, si verrà automaticamente reindirizzati alla pagina di accesso per registrarsi e accedere. Dopo aver effettuato la registrazione e l’accesso, si verrà riportati automaticamente alla pagina corrente.

Alla prima richiesta, verrà fornito un credito gratuito, che consente di utilizzare gratuitamente questa API.

Utilizzo di base

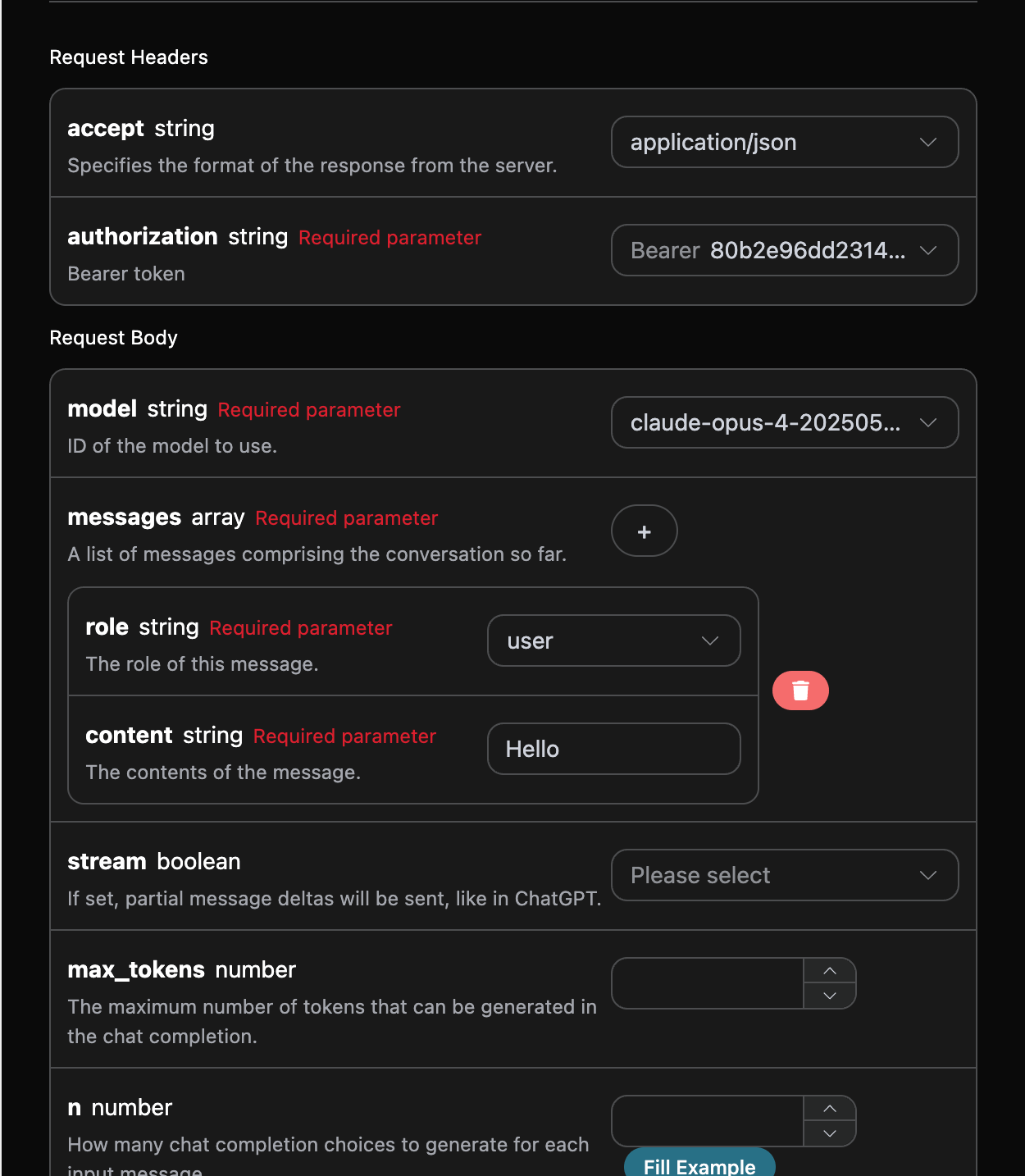

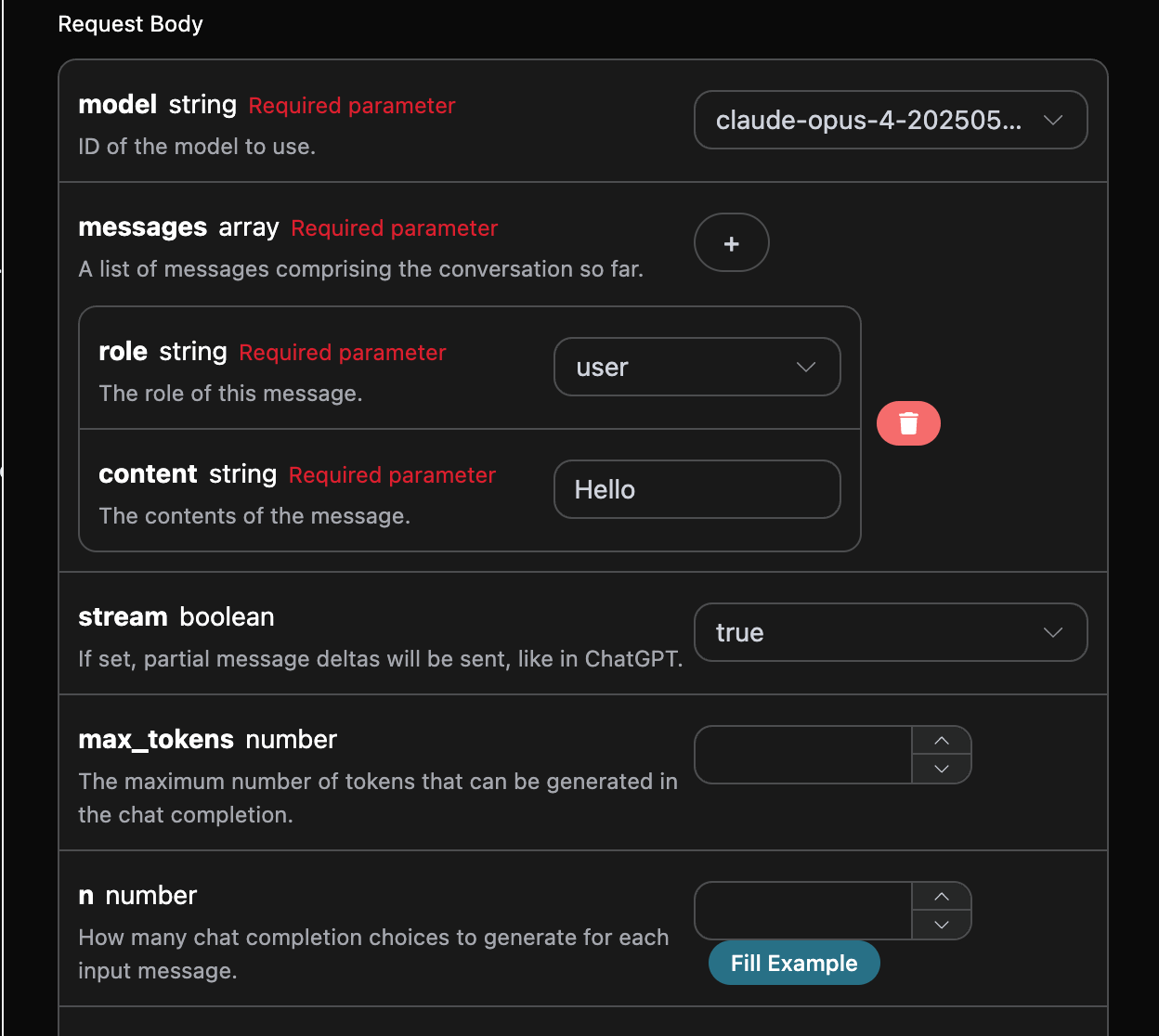

Successivamente, è possibile compilare i contenuti corrispondenti nell’interfaccia, come mostrato nell’immagine:

authorization, che può essere selezionato direttamente dal menu a discesa. Un altro parametro è model, che rappresenta la categoria del modello di Claude che si desidera utilizzare; qui abbiamo principalmente 20 modelli, i dettagli possono essere consultati nei modelli forniti. L’ultimo parametro è messages, che è un array di domande che inseriamo, rappresenta un array che consente di caricare più domande contemporaneamente, ogni domanda contiene role e content, dove role indica il ruolo del richiedente; abbiamo fornito tre identità: user, assistant, system. L’altro content è il contenuto specifico della nostra domanda.

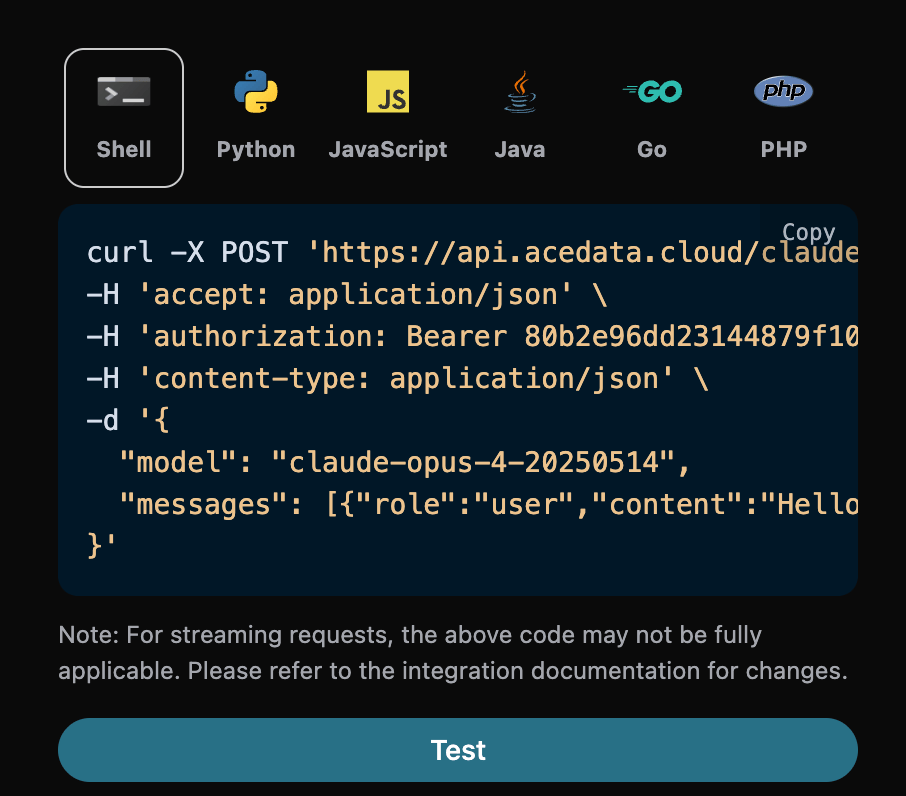

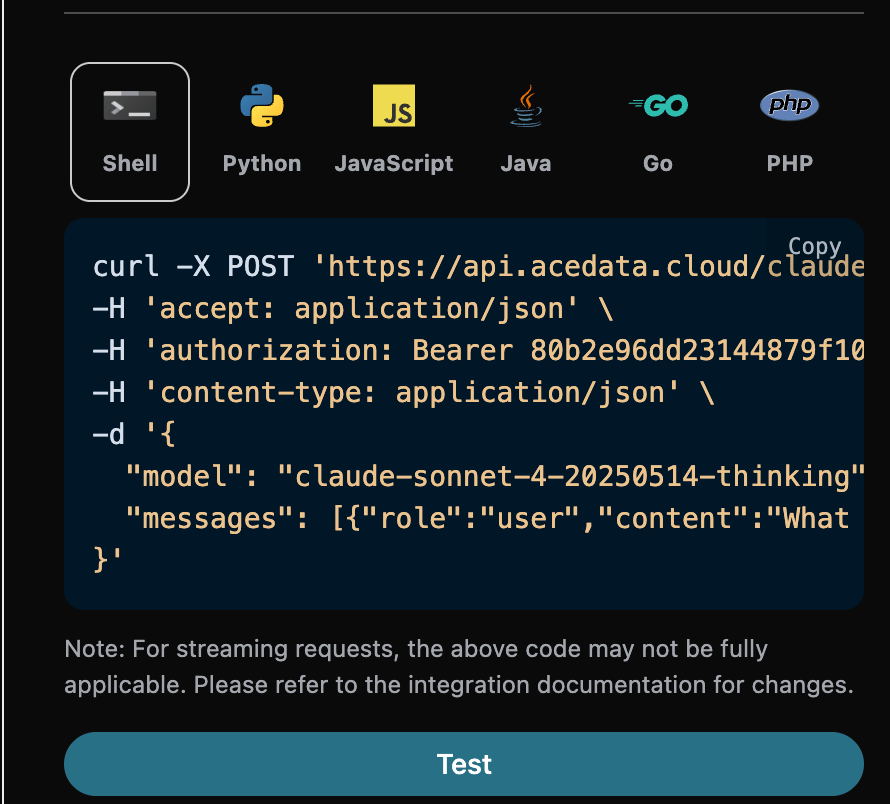

Inoltre, si può notare che a destra c’è un codice di chiamata corrispondente generato, che può essere copiato e eseguito direttamente, oppure si può semplicemente fare clic sul pulsante “Try” per testare.

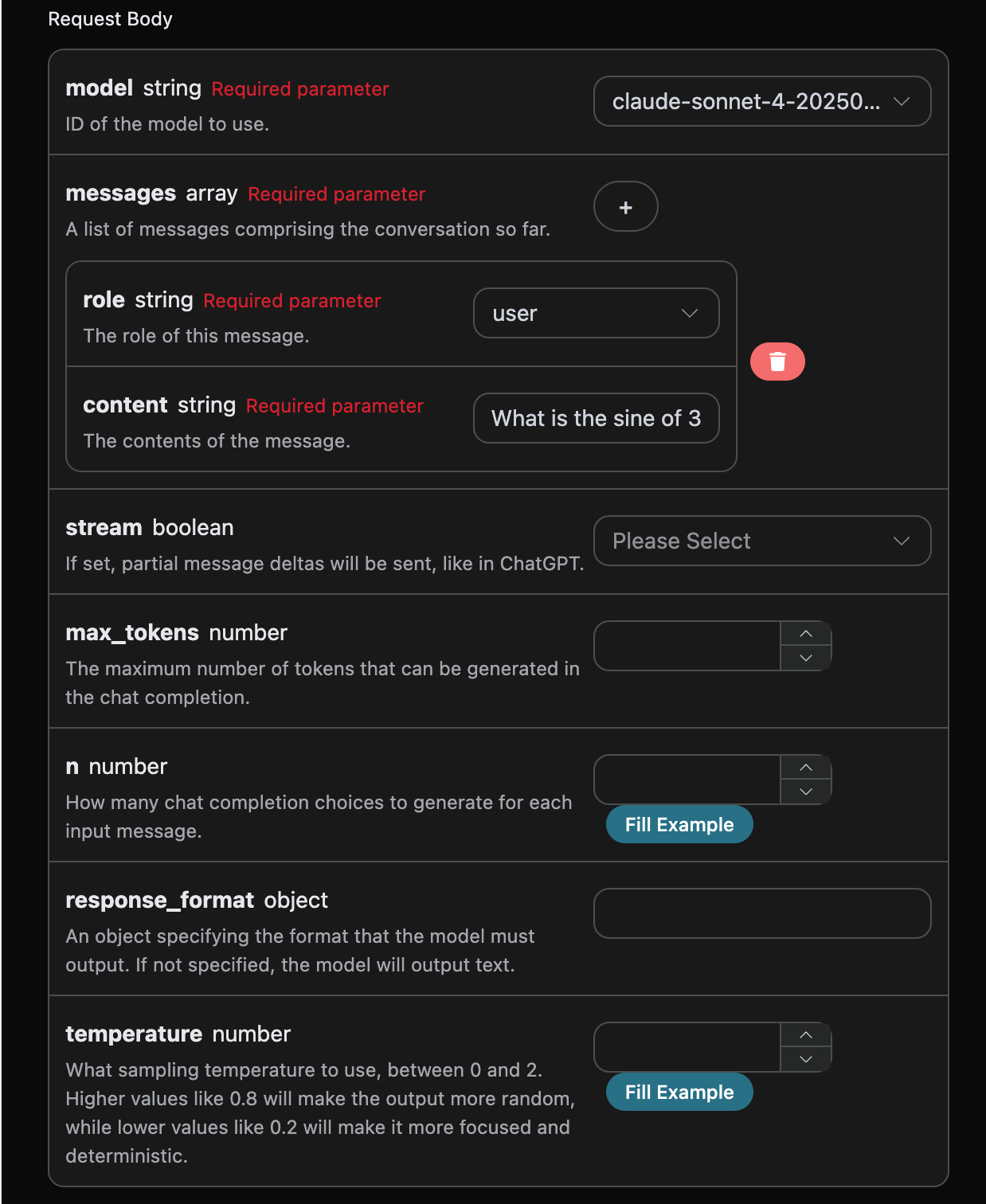

Parametri opzionali comuni:

max_tokens: limita il numero massimo di token per una singola risposta.temperature: genera casualità, tra 0 e 2, valori più alti producono risultati più vari.n: quante risposte candidate generare in una volta.response_format: impostazione del formato di ritorno.

id, l’ID generato per questo compito di dialogo, utilizzato per identificare univocamente questo compito di dialogo.model, il modello scelto dal sito ufficiale di Claude.choices, le informazioni di risposta fornite da Claude in base alla domanda.usage: informazioni statistiche sui token per questo scambio di domande e risposte.

choices contiene le informazioni di risposta di Claude, all’interno di choices ci sono i dettagli specifici della risposta di Claude, come mostrato nell’immagine.

content all’interno di choices contiene il contenuto specifico della risposta di Claude.

Risposta in streaming

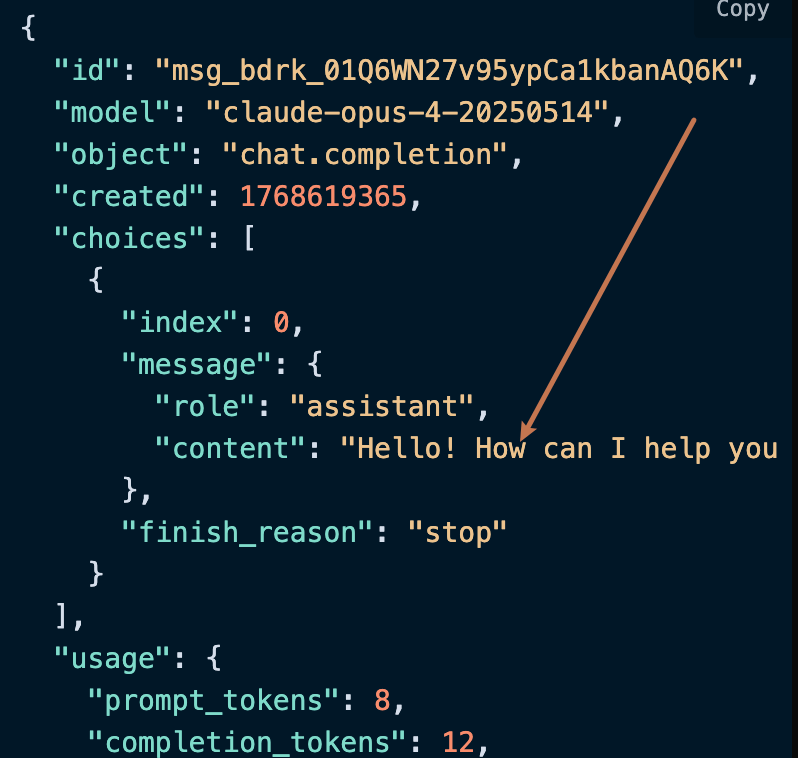

Questa interfaccia supporta anche le risposte in streaming, il che è molto utile per l’integrazione web, consentendo di visualizzare il contenuto parola per parola. Se si desidera restituire una risposta in streaming, è possibile modificare il parametrostream nell’intestazione della richiesta, impostandolo su true.

La modifica è mostrata nell’immagine, ma il codice di chiamata deve essere adeguatamente modificato per supportare la risposta in streaming.

stream in true, l’API restituirà i dati JSON riga per riga; a livello di codice, è necessario apportare le modifiche necessarie per ottenere i risultati riga per riga.

Esempio di codice di chiamata in Python:

data, data contiene le choices che sono il contenuto della risposta più recente, coerente con quanto descritto in precedenza. Le choices sono il contenuto della risposta aggiuntiva, che puoi integrare nel tuo sistema. Inoltre, la fine della risposta in streaming è determinata dal contenuto di data, se il contenuto è [DONE], significa che la risposta in streaming è completamente terminata. I risultati restituiti da data hanno diversi campi, descritti come segue:

id, l’ID generato per questa attività di dialogo, utilizzato per identificare univocamente questa attività di dialogo.model, il modello scelto dal sito ufficiale di Claude.choices, le informazioni di risposta fornite da Claude in base alla domanda.

Dialogo a più turni

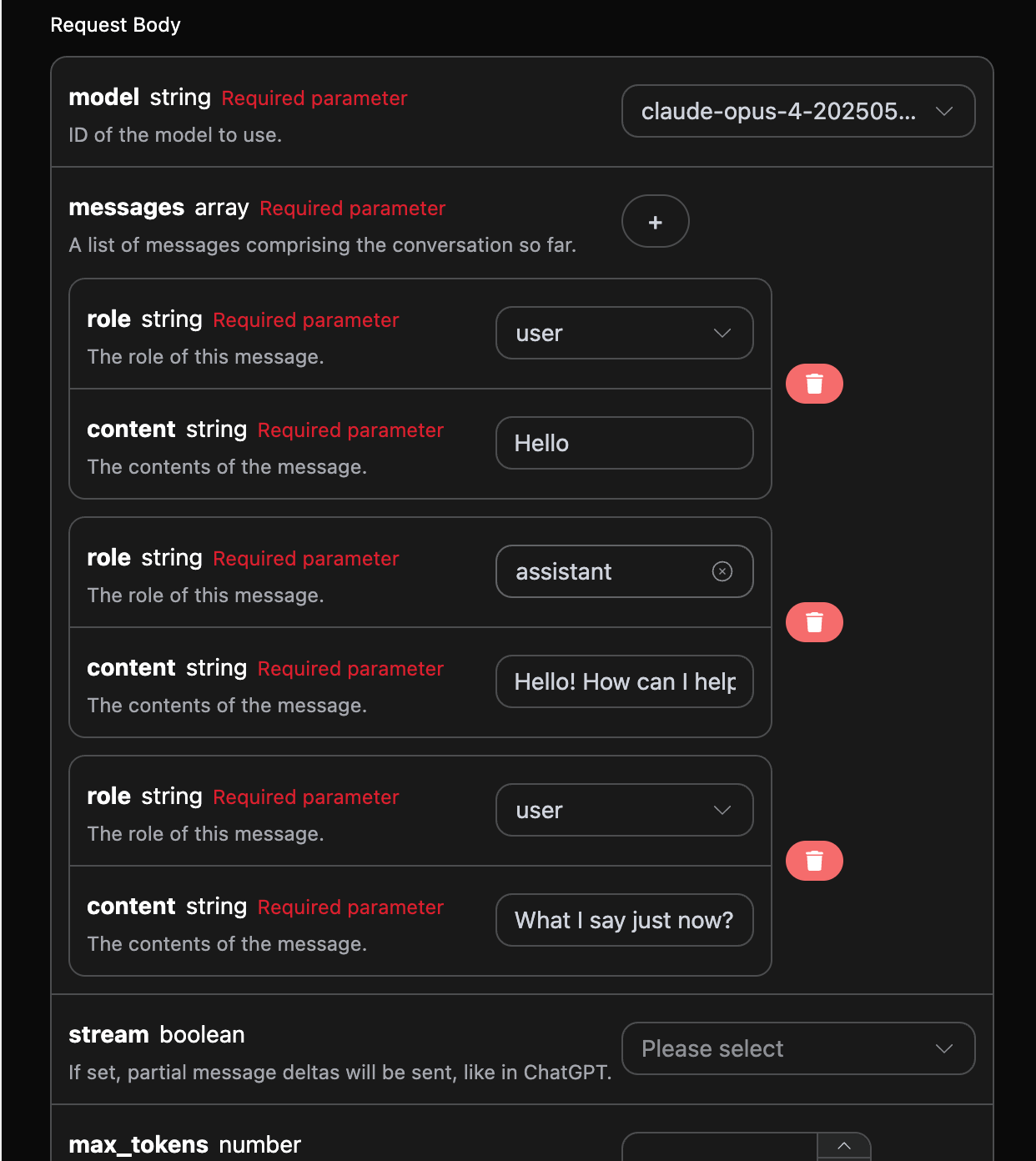

Se desideri integrare la funzionalità di dialogo a più turni, devi caricare più domande nel campomessages, un esempio specifico di più domande è mostrato nell’immagine sottostante:

choices sono coerenti con i contenuti di base utilizzati, includendo il contenuto specifico delle risposte di Claude a più conversazioni, in modo da poter rispondere a domande corrispondenti basate su più contenuti di conversazione.

Modello di Pensiero Profondo

I modelli claude-opus-4-20250514-thinking e claude-sonnet-4-20250514-thinking sono diversi dagli altri modelli, in quanto possono rispondere a domande attraverso un pensiero profondo e restituire il risultato del processo di pensiero. Questo articolo dimostrerà la funzionalità di pensiero profondo attraverso un esempio concreto, e successivamente si possono compilare i contenuti corrispondenti nell’interfaccia API di Claude Chat Completion, come mostrato nell’immagine:

choices sono state ottenute dopo un pensiero profondo e viene fornito anche il contenuto del processo di pensiero correlato, dove in content reasoning_content indica il processo di pensiero del modello. Le informazioni di risposta all’interno di choices devono essere renderizzate utilizzando la sintassi markdown, in modo da ottenere la migliore esperienza, e infine questo riflette anche il potente vantaggio della funzionalità di rete del nostro modello.

Modello Visivo

claude-sonnet-4-20250514 è un modello di linguaggio multimodale di grandi dimensioni sviluppato da Claude, che ha aggiunto capacità di comprensione visiva rispetto a claude-4. Questo modello può gestire simultaneamente input di testo e immagini, realizzando una comprensione e generazione cross-modale. L’elaborazione del testo utilizzando il modello claude-sonnet-4-20250514 è coerente con i contenuti di base utilizzati in precedenza, di seguito verrà fornita una breve introduzione su come utilizzare la capacità di elaborazione delle immagini del modello. L’uso della capacità di elaborazione delle immagini del modello claude-sonnet-4-20250514 avviene principalmente aggiungendo un campotype al contenuto originale di content, attraverso il quale si può sapere se ciò che viene caricato è testo o immagine, permettendo così di utilizzare la capacità di elaborazione delle immagini del modello claude-sonnet-4-20250514. Di seguito si parlerà principalmente di come chiamare questa funzionalità utilizzando due modalità: Curl e Python.

- Metodo Curl

- Metodo Python

Gestione degli errori

Quando si chiama l’API, se si verifica un errore, l’API restituirà il relativo codice di errore e informazioni. Ad esempio:400 token_mismatched: Richiesta non valida, probabilmente a causa di parametri mancanti o non validi.400 api_not_implemented: Richiesta non valida, probabilmente a causa di parametri mancanti o non validi.401 invalid_token: Non autorizzato, token di autorizzazione non valido o mancante.429 too_many_requests: Troppe richieste, hai superato il limite di frequenza.500 api_error: Errore interno del server, qualcosa è andato storto sul server.