Fluxo de Solicitação

Para usar a API de Conclusão de Chat do Claude, primeiro você pode acessar a página API de Conclusão de Chat do Claude e clicar no botão “Adquirir” para obter as credenciais necessárias para a solicitação: Se você ainda não estiver logado ou registrado, será redirecionado automaticamente para a página de login, convidando-o a se registrar e fazer login. Após o registro e login, você será redirecionado de volta para a página atual.

Na primeira solicitação, haverá um crédito gratuito disponível, permitindo o uso gratuito da API.

Se você ainda não estiver logado ou registrado, será redirecionado automaticamente para a página de login, convidando-o a se registrar e fazer login. Após o registro e login, você será redirecionado de volta para a página atual.

Na primeira solicitação, haverá um crédito gratuito disponível, permitindo o uso gratuito da API.

Uso Básico

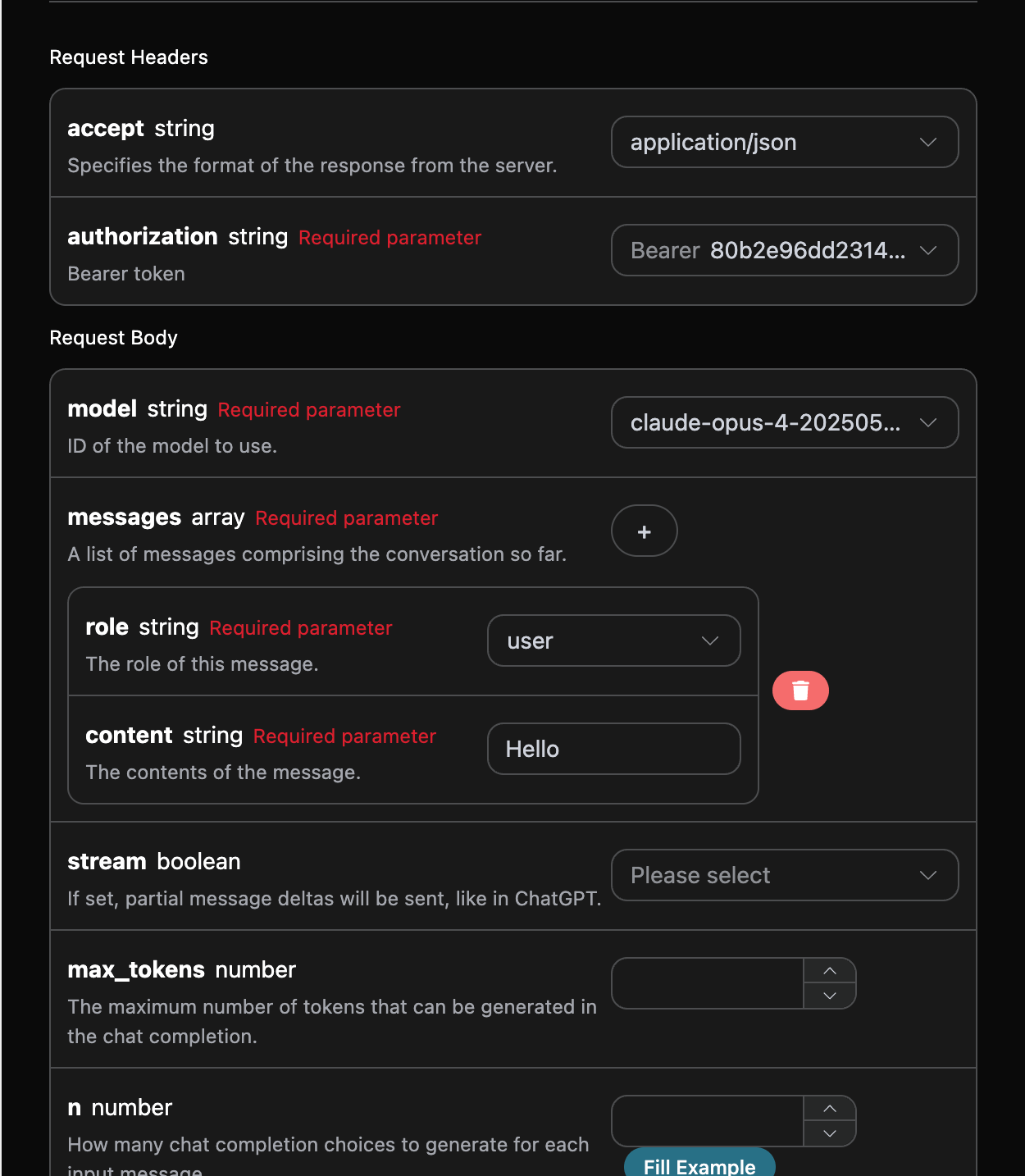

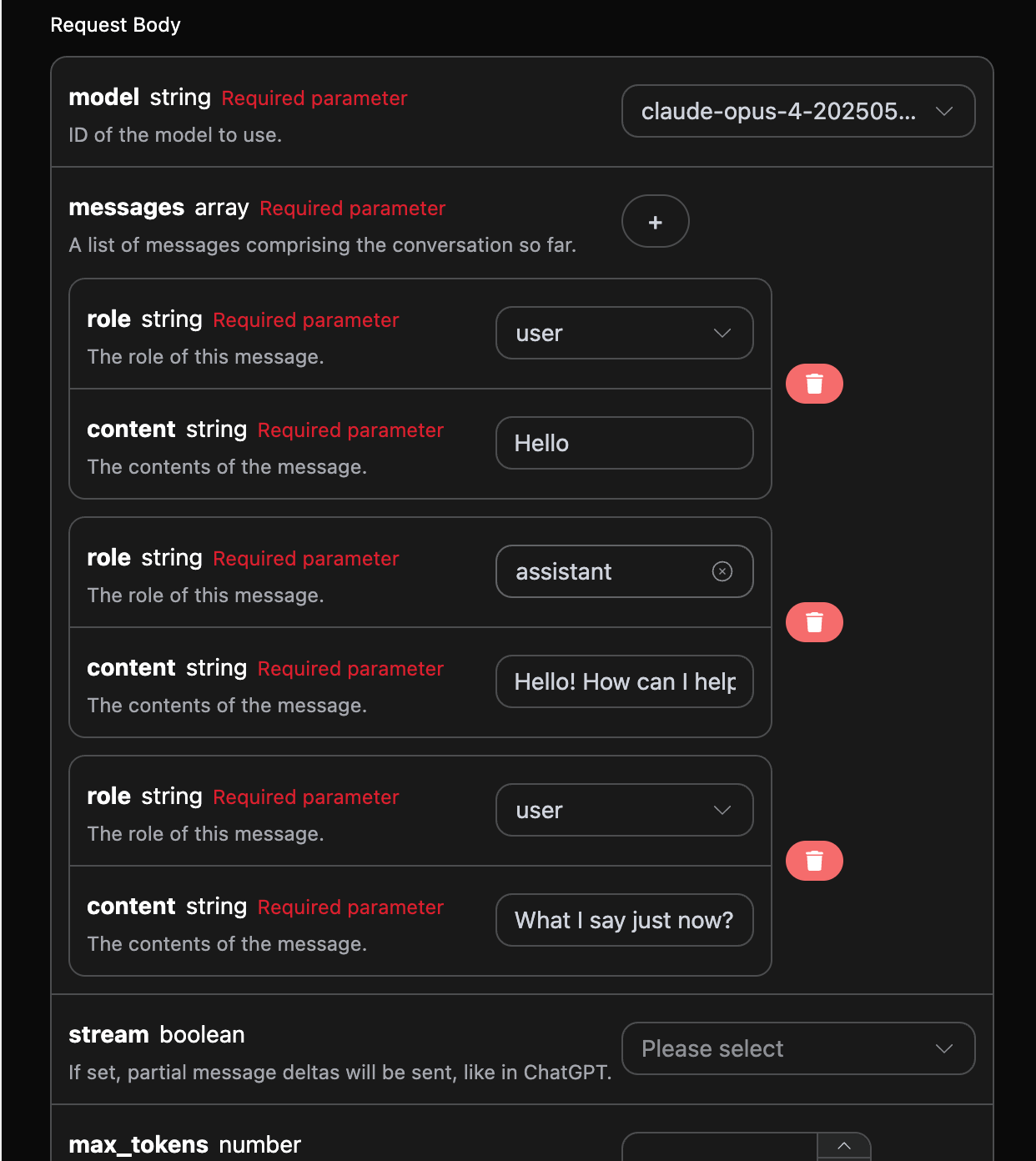

Em seguida, você pode preencher os conteúdos correspondentes na interface, como mostrado na imagem:

authorization, que pode ser selecionado diretamente na lista suspensa. O outro parâmetro é model, que é a categoria do modelo que escolhemos usar no site do Claude; aqui temos principalmente 20 modelos, e os detalhes podem ser vistos nos modelos que fornecemos. O último parâmetro é messages, que é um array de palavras-chave que inserimos, representando a possibilidade de enviar várias palavras-chave ao mesmo tempo, onde cada palavra-chave contém role e content, sendo que role representa o papel do questionador, e oferecemos três identidades: user, assistant, system. O outro content é o conteúdo específico da nossa pergunta.

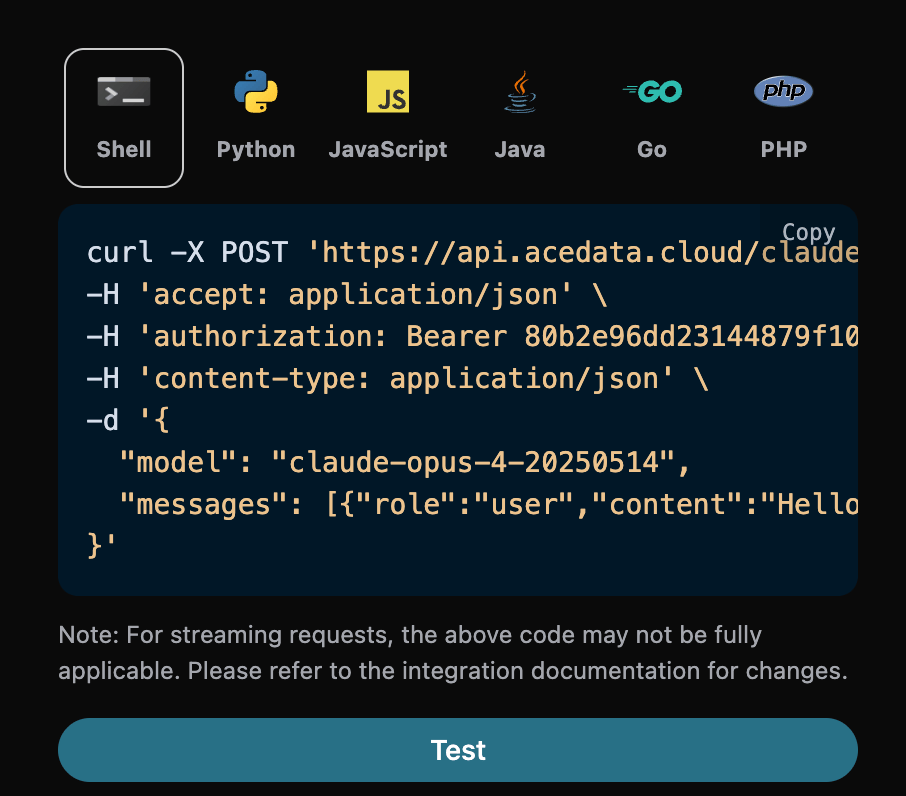

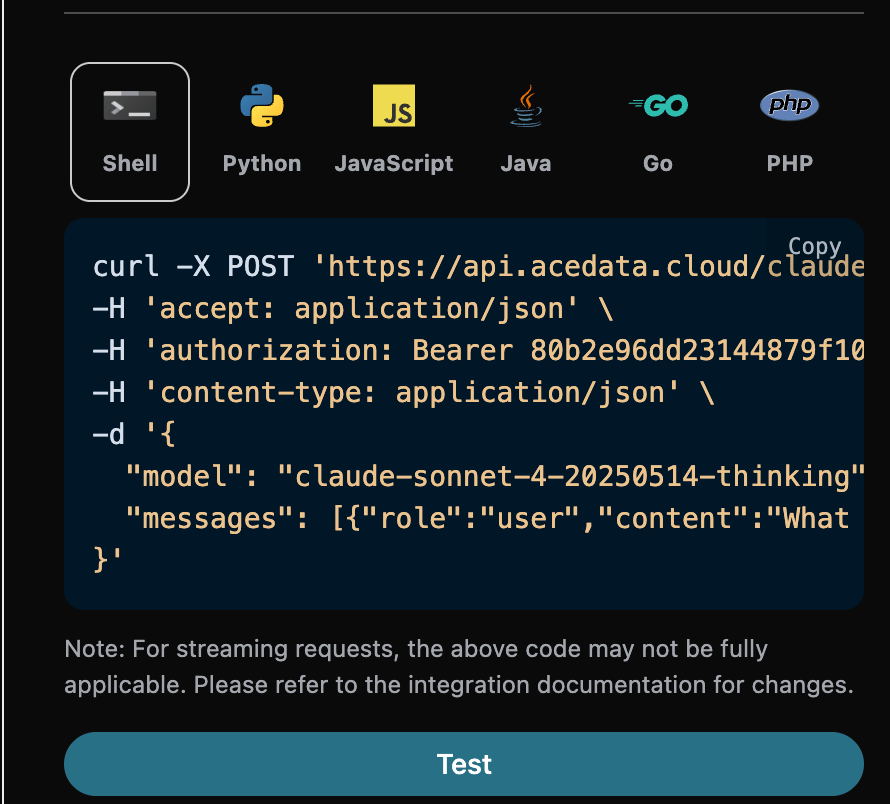

Você também pode notar que há um código de chamada correspondente gerado à direita, que você pode copiar e executar diretamente, ou pode clicar no botão “Tentar” para testar.

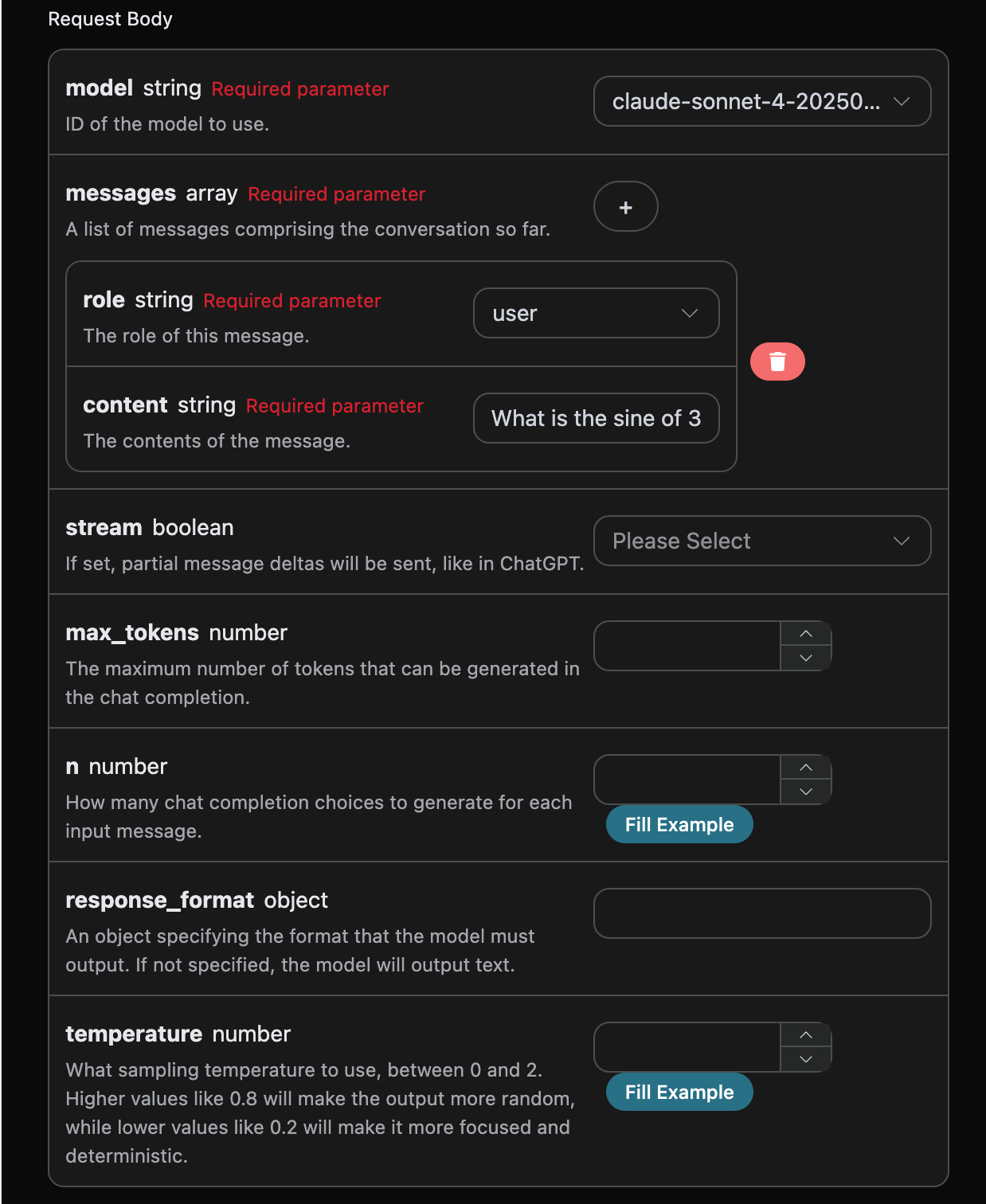

Parâmetros opcionais comuns:

max_tokens: limita o número máximo de tokens na resposta única.temperature: gera aleatoriedade, entre 0-2, quanto maior o valor, mais disperso.n: quantas respostas candidatas gerar de uma vez.response_format: configurações do formato de retorno.

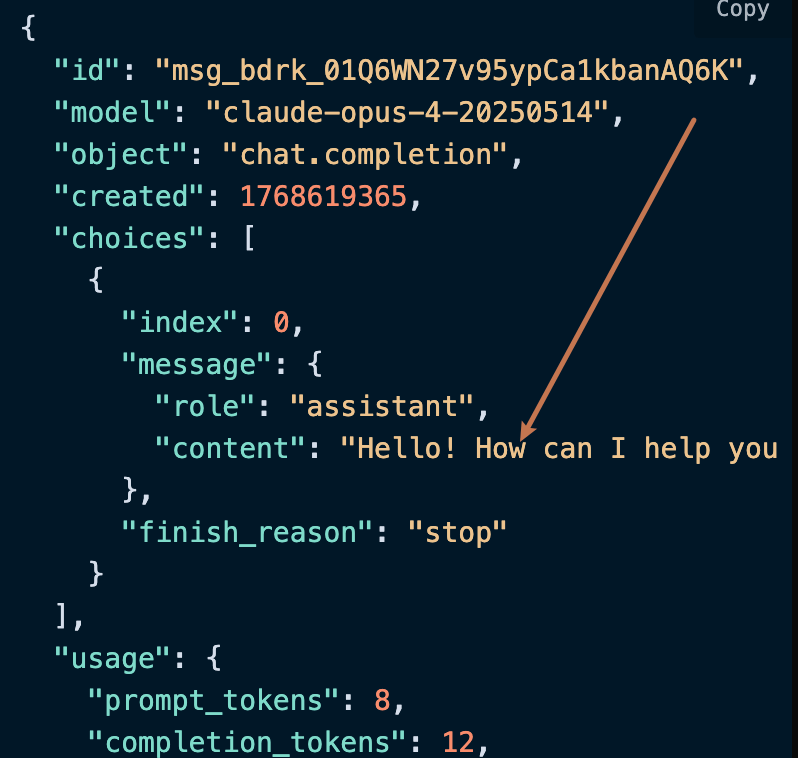

id, o ID da tarefa de diálogo gerada, usado para identificar exclusivamente esta tarefa de diálogo.model, o modelo do site do Claude escolhido.choices, as informações de resposta que Claude forneceu para as palavras-chave.usage: informações estatísticas sobre os tokens para esta pergunta e resposta.

choices contém as informações de resposta do Claude, onde choices é a informação específica da resposta do Claude, como mostrado na imagem.

content dentro de choices contém o conteúdo específico da resposta do Claude.

Resposta em Fluxo

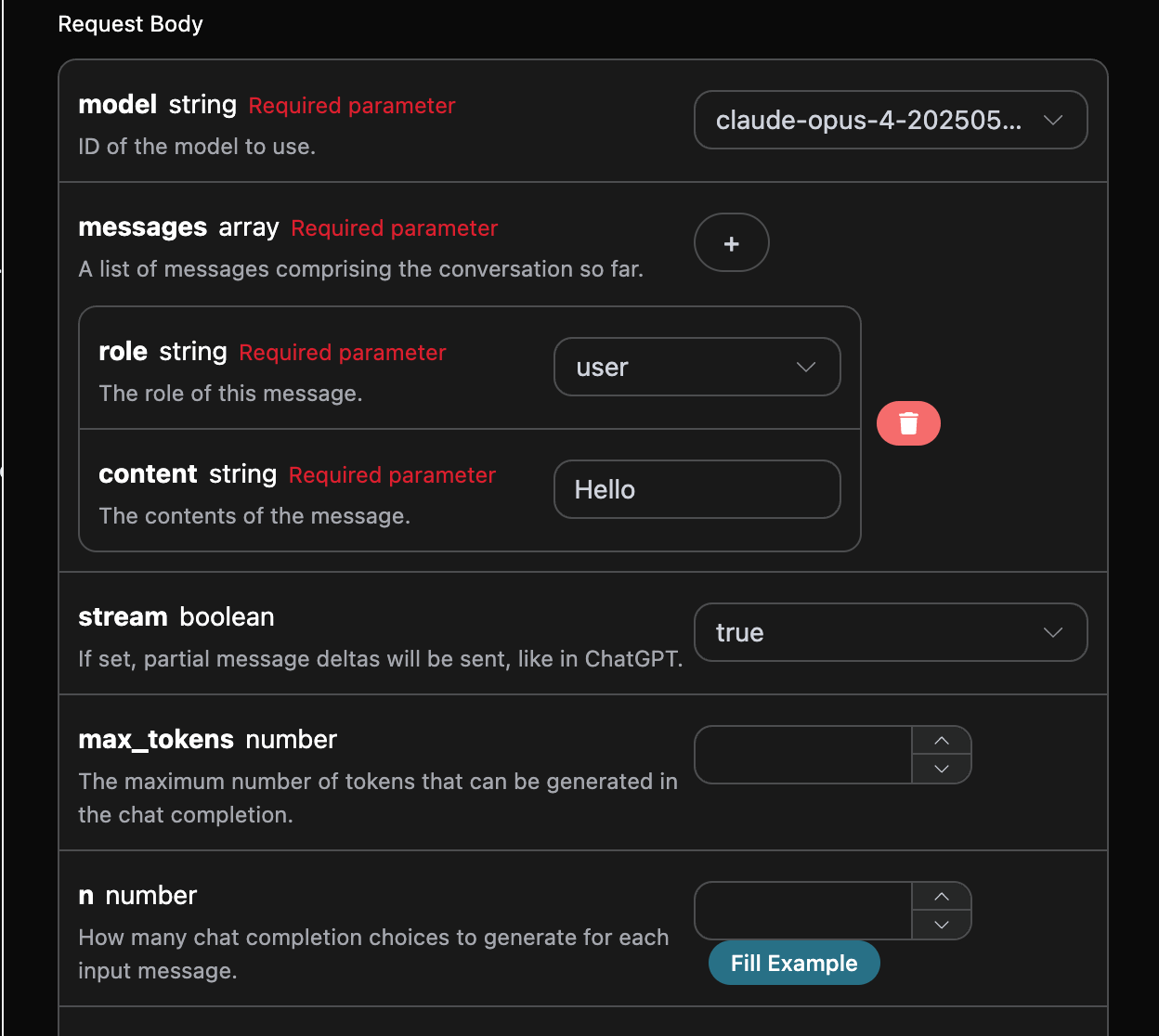

Esta interface também suporta resposta em fluxo, o que é muito útil para integração com páginas da web, permitindo que a página exiba o efeito de exibição letra por letra. Se você deseja retornar a resposta em fluxo, pode alterar o parâmetrostream no cabeçalho da solicitação para true.

A modificação é mostrada na imagem, mas o código de chamada precisa ter as alterações correspondentes para suportar a resposta em fluxo.

stream para true, a API retornará os dados JSON linha por linha, e no nível do código, precisamos fazer as modificações necessárias para obter os resultados linha por linha.

Código de exemplo de chamada em Python:

data, onde data contém as choices, que são o conteúdo da resposta mais recente, consistente com o conteúdo apresentado anteriormente. choices é o novo conteúdo da resposta, que você pode integrar ao seu sistema. Além disso, o término da resposta em fluxo é determinado pelo conteúdo de data; se o conteúdo for [DONE], isso indica que a resposta em fluxo foi completamente finalizada. O resultado retornado em data possui vários campos, conforme descrito a seguir:

id, que gera a ID da tarefa de diálogo, usada para identificar exclusivamente esta tarefa de diálogo.model, o modelo escolhido no site da Claude.choices, as informações de resposta fornecidas pela Claude em relação às palavras de pergunta.

Diálogo em várias rodadas

Se você deseja integrar a funcionalidade de diálogo em várias rodadas, precisa enviar várias palavras de pergunta no campomessages, com exemplos específicos mostrados na imagem abaixo:

choices 包含的信息与基本使用的内容是一致的,这个包含了 Claude 针对多个对话进行回复的具体内容,这样就可以根据多个对话内容来回答对应的问题了。

深度思考模型

claude-opus-4-20250514-thinking 和 claude-sonnet-4-20250514-thinking 模型与其它模型不同,它可以根据提问词来进行深度思考来回答,并且将思考过程的结果返回给你,本文将通过一个具体示例来演示深度思考功能,接下来就可以在 Claude Chat Completion API 界面上填写对应的内容,如图所示:

choices 里面的回答信息是经过深度思考后得到的,并且也给出了相关的思考过程内容,其中在content中reasoning_content表示模型的思考过程。choices 里面的回答信息是要通过 markdown 语法进行渲染,这样才能获得最佳的体验,最后这也体现出我们模型的联网功能的强大优势。

视觉模型

claude-sonnet-4-20250514 是 Claude 开发的多模态大型语言模型,它在 claude-4 的基础上增加了视觉理解能力。这个模型可以同时处理文本和图像输入,实现了跨模态的理解和生成。 使用 claude-sonnet-4-20250514 模型的文本处理是与上文的基本使用内容一致的,下面将简要介绍一下如果使用模型的图像处理能力。 使用 claude-sonnet-4-20250514 模型的图像处理能力主要是通过在原有的content 内容基础上添加一个 type 字段,通过该字段可以知道上传的是文本还是图片,从而使用 claude-sonnet-4-20250514 模型的图像处理能力,下面主要讲述采用 Curl 和 Python 俩种方式来调用该功能。

- Curl 脚本方式

- Python 脚本方式

Tratamento de Erros

Ao chamar a API, se ocorrer um erro, a API retornará o código de erro e as informações correspondentes. Por exemplo:400 token_mismatched: Solicitação inválida, possivelmente devido a parâmetros ausentes ou inválidos.400 api_not_implemented: Solicitação inválida, possivelmente devido a parâmetros ausentes ou inválidos.401 invalid_token: Não autorizado, token de autorização inválido ou ausente.429 too_many_requests: Muitas solicitações, você excedeu o limite de taxa.500 api_error: Erro interno do servidor, algo deu errado no servidor.