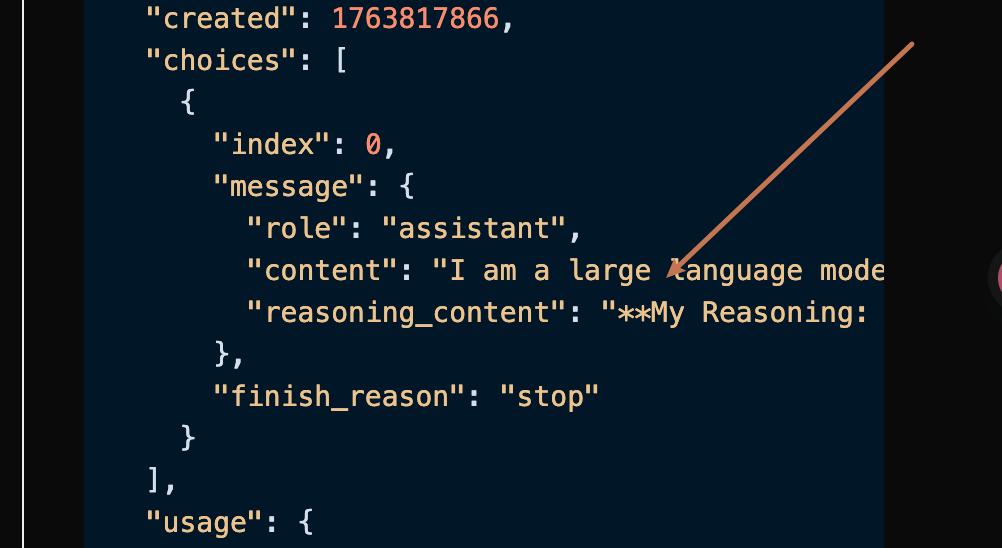

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"content": "", "role": "assistant"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**Визначення Моєї Природи**\n\nМоє мислення почалося. Користувач хоче дізнатися про мою природу, ставлячи пряме запитання \"що ти?\" Перший крок був простим: визначити запит. Тепер я згадую свою основну ідентичність: я велика мовна модель. Це основна правда, яку я прагну донести.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**Уточнення Моєї Відповіді**\n\nЯ додав важливу інформацію про те, що я навчений Google до базової ідентичності \"велика мовна модель\". Мій наступний крок - розглянути, що насправді означає бути \"великою мовною моделлю\", щоб я міг пояснити свої основні можливості. Я зосереджуюсь на наданні контексту, не вдаючись до конкретних технічних деталей або назв моделей. Я хочу донести свою функцію так, щоб користувач міг легко зрозуміти.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**Підтвердження Основної Ідентичності**\n\nЯ зараз закріплюю свою відповідь. Запит користувача про мою модель потребує зосередженої відповіді. Я визначив, що \"навчений Google\" є суттєвим, надаючи ключовий контекст. Я стримуюсь від бажання згадувати будь-які конкретні назви моделей, оскільки це не має значення. Мета - надати пряму, точну заяву. Моя мета залишається чіткою та лаконічною відповіддю, уникаючи технічного жаргону та переходячи безпосередньо до суті.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"content": "Я велика мовна модель, навчена Google."}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {}, "logprobs": null, "finish_reason": "stop", "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": "", "choices": [], "usage": {"prompt_tokens": 8, "completion_tokens": 527, "total_tokens": 535, "prompt_tokens_details": {"cached_tokens": 0, "text_tokens": 8, "audio_tokens": 0, "image_tokens": 0}, "completion_tokens_details": {"text_tokens": 0, "audio_tokens": 0, "reasoning_tokens": 519}, "input_tokens": 0, "output_tokens": 0, "input_tokens_details": null, "claude_cache_creation_5_m_tokens": 0, "claude_cache_creation_1_h_tokens": 0}}

data: [DONE]

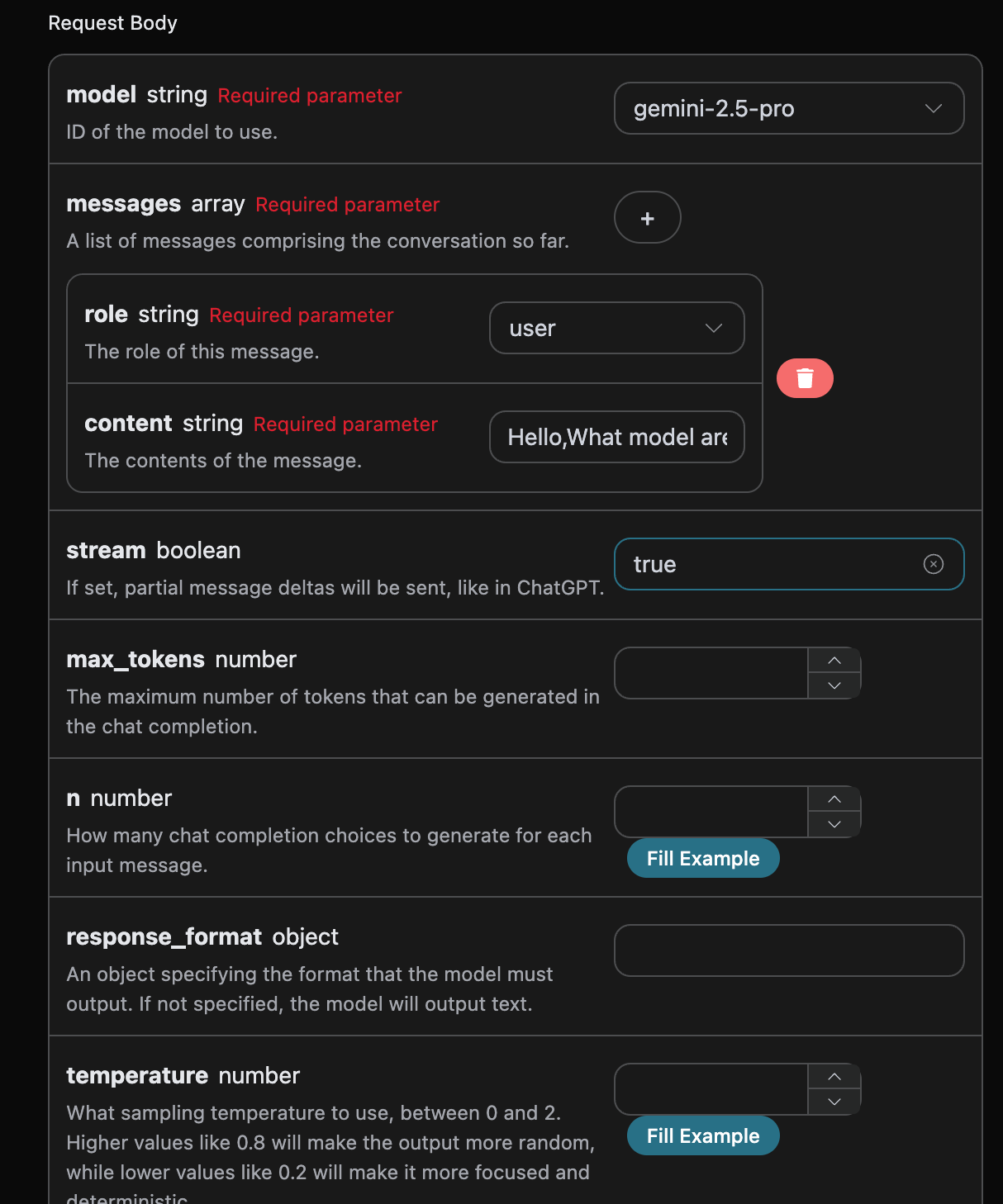

Якщо ви ще не увійшли в систему або не зареєстровані, вас автоматично перенаправлять на сторінку входу, запрошуючи вас зареєструватися та увійти. Після входу або реєстрації ви автоматично повернетеся на цю сторінку.

При першій заявці буде надано безкоштовний ліміт, який дозволяє безкоштовно використовувати цей API.

Якщо ви ще не увійшли в систему або не зареєстровані, вас автоматично перенаправлять на сторінку входу, запрошуючи вас зареєструватися та увійти. Після входу або реєстрації ви автоматично повернетеся на цю сторінку.

При першій заявці буде надано безкоштовний ліміт, який дозволяє безкоштовно використовувати цей API.