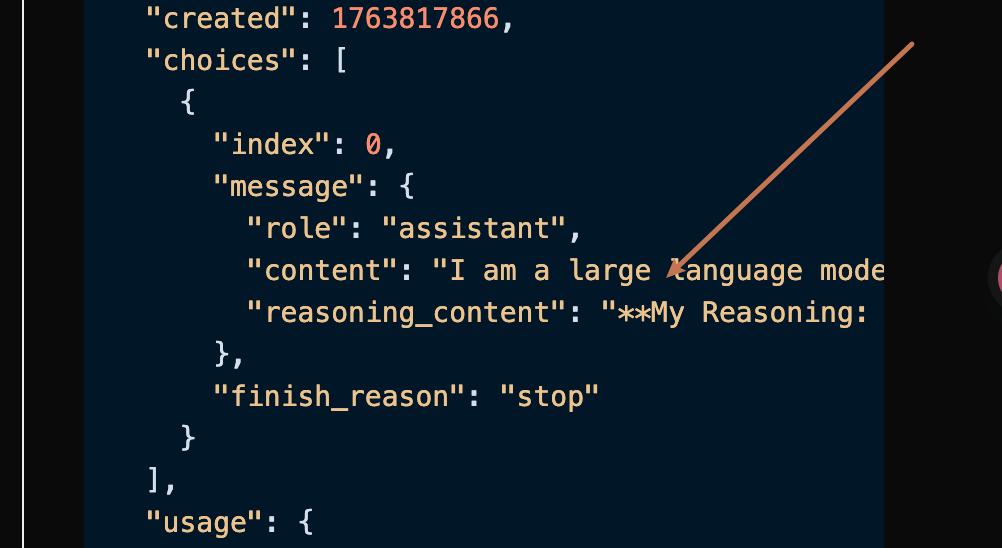

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"content": "", "role": "assistant"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**Определение Моей Природы**\n\nМое мышление началось. Пользователь хочет узнать мою природу, задавая прямой вопрос \"что ты?\" Первый шаг был простым: определить запрос. Теперь я вспоминаю свою основную идентичность: я большая языковая модель. Это основная истина, которую я стремлюсь донести.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**Уточнение Моего Ответа**\n\nЯ добавил важную информацию о том, что я обучен Google к базовой идентичности \"большая языковая модель\". Мой следующий шаг - подумать о том, что на самом деле означает быть \"большой языковой моделью\", чтобы я мог объяснить свои основные возможности. Я сосредоточен на предоставлении контекста, не углубляясь в конкретные технические детали или названия моделей. Я хочу донести свою функцию так, чтобы пользователь мог легко понять.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**Подтверждение Основной Идентичности**\n\nЯ сейчас укрепляю свой ответ. Запрос пользователя о моей модели требует сосредоточенного ответа. Я определил, что \"обучен Google\" является важным, предоставляя ключевой контекст. Я сопротивляюсь искушению упомянуть какие-либо конкретные названия моделей, так как это не имеет значения. Цель - предоставить прямое, точное утверждение. Моя цель остается ясным и лаконичным ответом, избегая технического жаргона и переходя сразу к актуальной точке.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"content": "Я большая языковая модель, обученная Google."}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {}, "logprobs": null, "finish_reason": "stop", "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": "", "choices": [], "usage": {"prompt_tokens": 8, "completion_tokens": 527, "total_tokens": 535, "prompt_tokens_details": {"cached_tokens": 0, "text_tokens": 8, "audio_tokens": 0, "image_tokens": 0}, "completion_tokens_details": {"text_tokens": 0, "audio_tokens": 0, "reasoning_tokens": 519}, "input_tokens": 0, "output_tokens": 0, "input_tokens_details": null, "claude_cache_creation_5_m_tokens": 0, "claude_cache_creation_1_h_tokens": 0}}

data: [DONE]

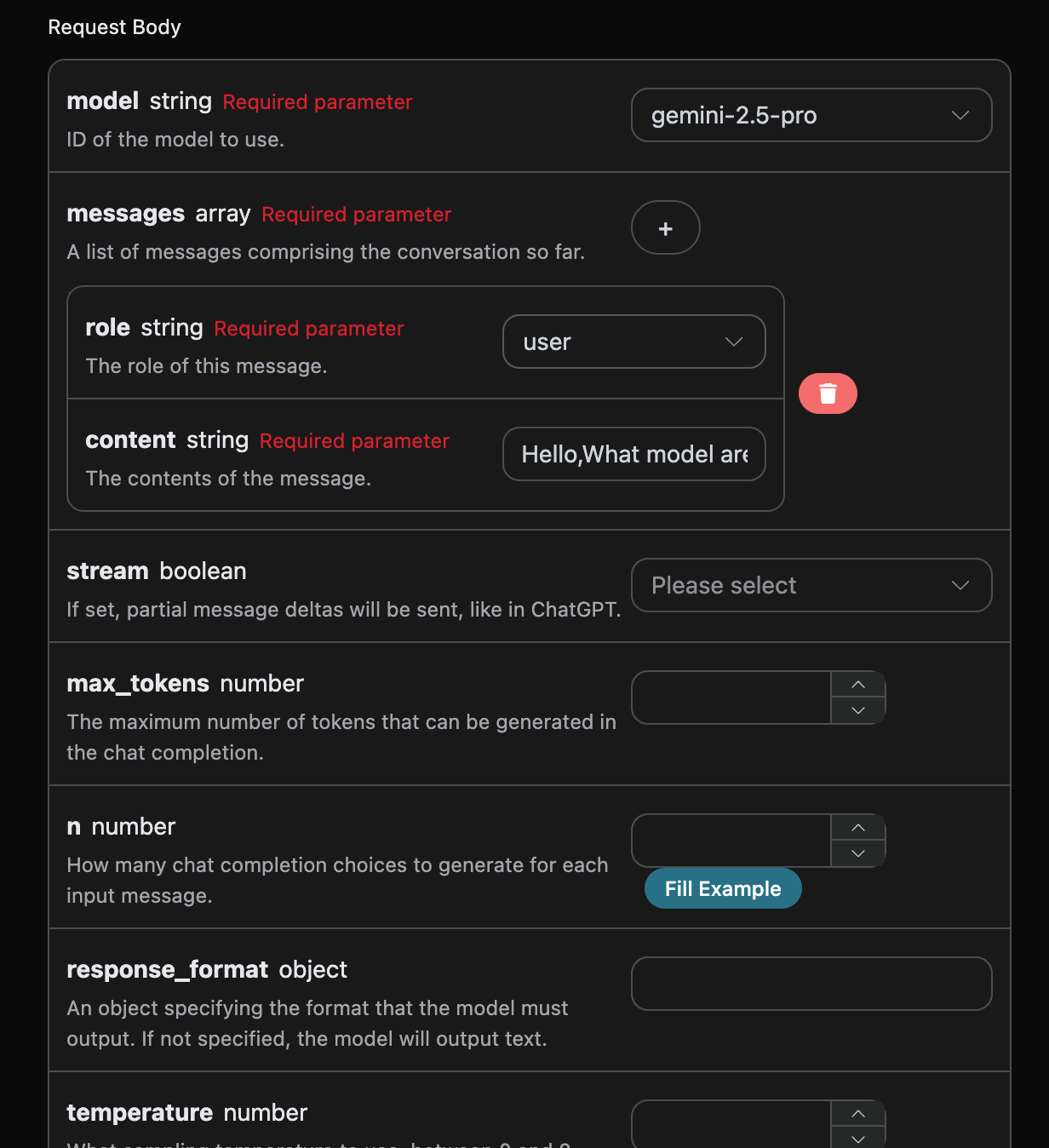

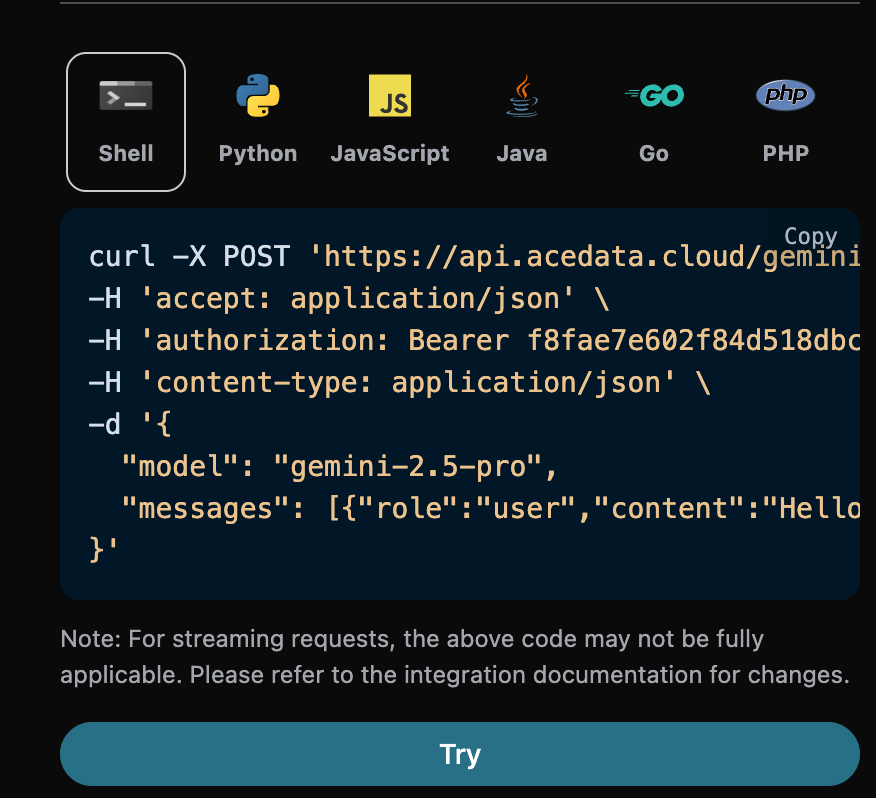

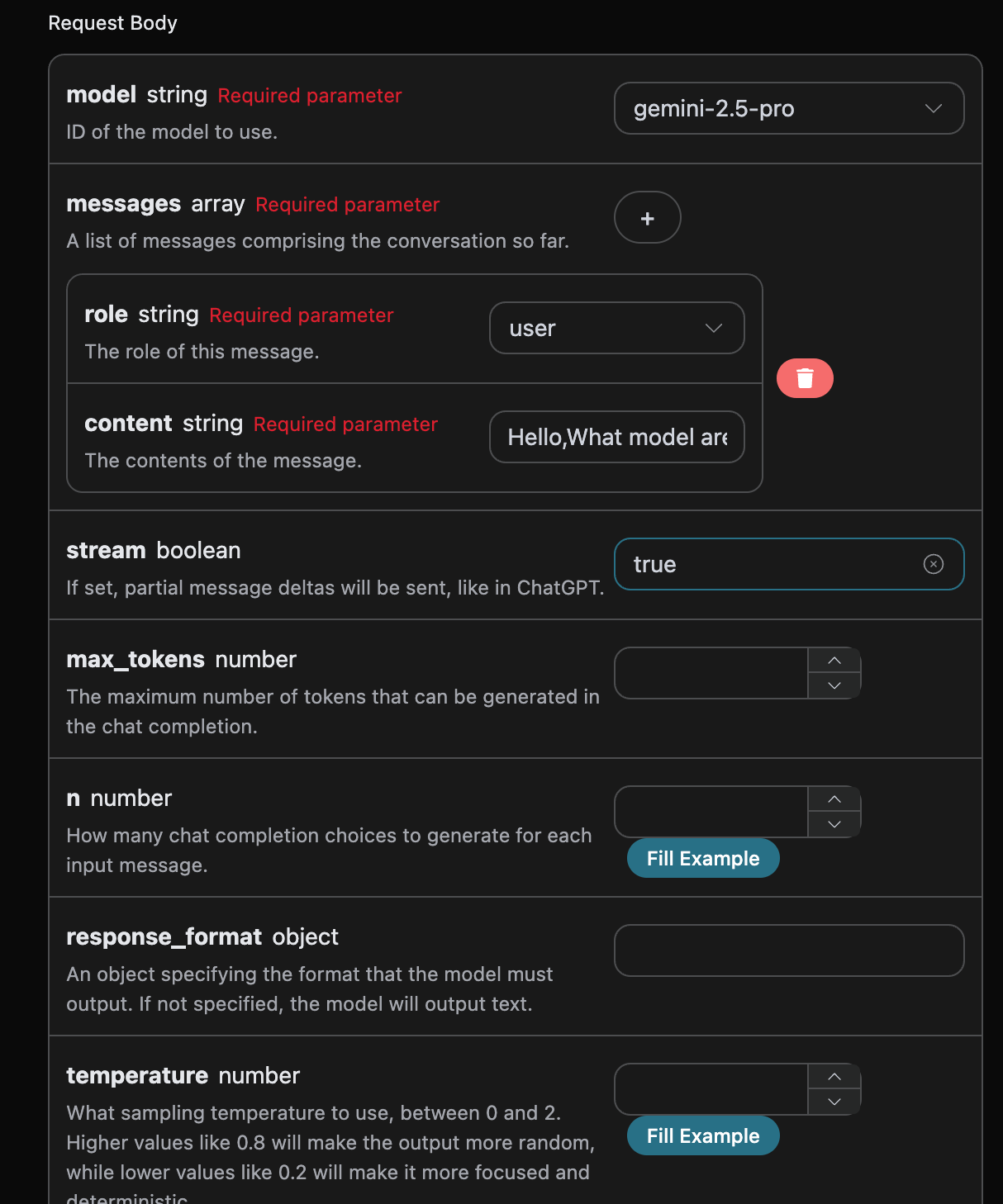

Если вы еще не вошли в систему или не зарегистрированы, вас автоматически перенаправят на страницу входа, пригласив зарегистрироваться и войти. После входа или регистрации вы автоматически вернетесь на текущую страницу.

При первом запросе будет предоставлен бесплатный лимит, который позволяет бесплатно использовать этот API.

Если вы еще не вошли в систему или не зарегистрированы, вас автоматически перенаправят на страницу входа, пригласив зарегистрироваться и войти. После входа или регистрации вы автоматически вернетесь на текущую страницу.

При первом запросе будет предоставлен бесплатный лимит, который позволяет бесплатно использовать этот API.