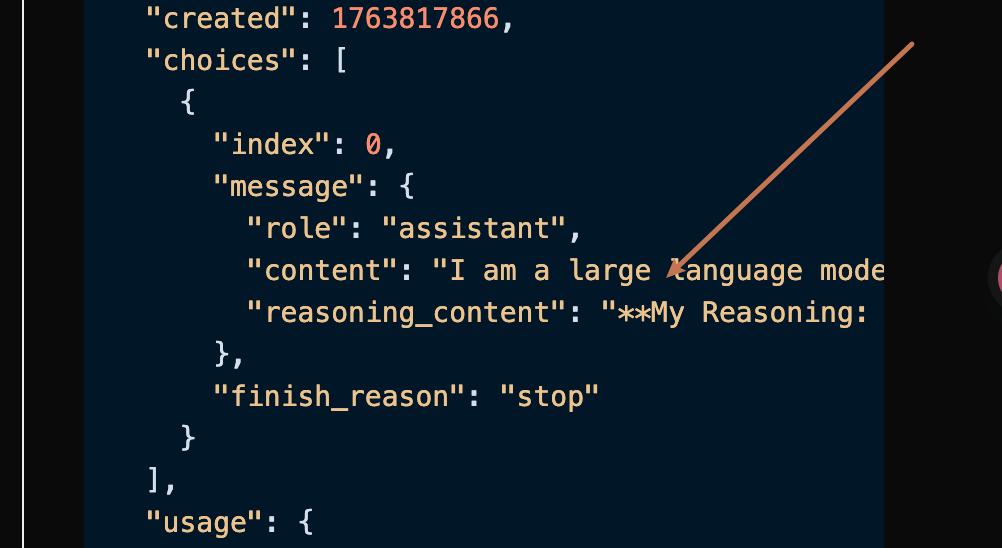

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"content": "", "role": "assistant"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**Zdefiniuj moją naturę**\n\nMoje myślenie się rozpoczęło. Użytkownik chce poznać moją naturę, zadając bezpośrednie pytanie \"kim jesteś?\" Pierwszy krok był prosty: zidentyfikowanie zapytania. Teraz przypominam sobie moją podstawową tożsamość: jestem dużym modelem językowym. To jest podstawowa prawda, którą chcę przekazać.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**Udoskonalanie mojej odpowiedzi**\n\nDodałem kluczowe informacje, że jestem trenowany przez Google do podstawowej tożsamości \"duży model językowy\". Moim następnym krokiem jest rozważenie, co oznacza bycie \"dużym modelem językowym\", aby móc wyjaśnić moje podstawowe możliwości. Skupiam się na dostarczeniu kontekstu bez wchodzenia w szczegółowe techniczne detale lub nazwy modeli. Chcę przekazać moją funkcję w sposób, który użytkownik łatwo zrozumie.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**Potwierdzanie podstawowej tożsamości**\n\nTeraz umacniam moją odpowiedź. Zapytanie użytkownika o moje powiązanie z modelem wymaga skoncentrowanej odpowiedzi. Zidentyfikowałem, że \"trenowany przez Google\" jest kluczowe, dostarczając istotny kontekst. Odrzucam pokusę wspomnienia jakichkolwiek konkretnych nazw modeli, ponieważ nie jest to istotne. Celem jest dostarczenie bezpośredniego, dokładnego stwierdzenia. Moim celem pozostaje jasna i zwięzła odpowiedź, unikając technicznego żargonu i przechodząc od razu do istotnego punktu.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"content": "Jestem dużym modelem językowym, trenowanym przez Google."}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {}, "logprobs": null, "finish_reason": "stop", "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": "", "choices": [], "usage": {"prompt_tokens": 8, "completion_tokens": 527, "total_tokens": 535, "prompt_tokens_details": {"cached_tokens": 0, "text_tokens": 8, "audio_tokens": 0, "image_tokens": 0}, "completion_tokens_details": {"text_tokens": 0, "audio_tokens": 0, "reasoning_tokens": 519}, "input_tokens": 0, "output_tokens": 0, "input_tokens_details": null, "claude_cache_creation_5_m_tokens": 0, "claude_cache_creation_1_h_tokens": 0}}

data: [DONE]

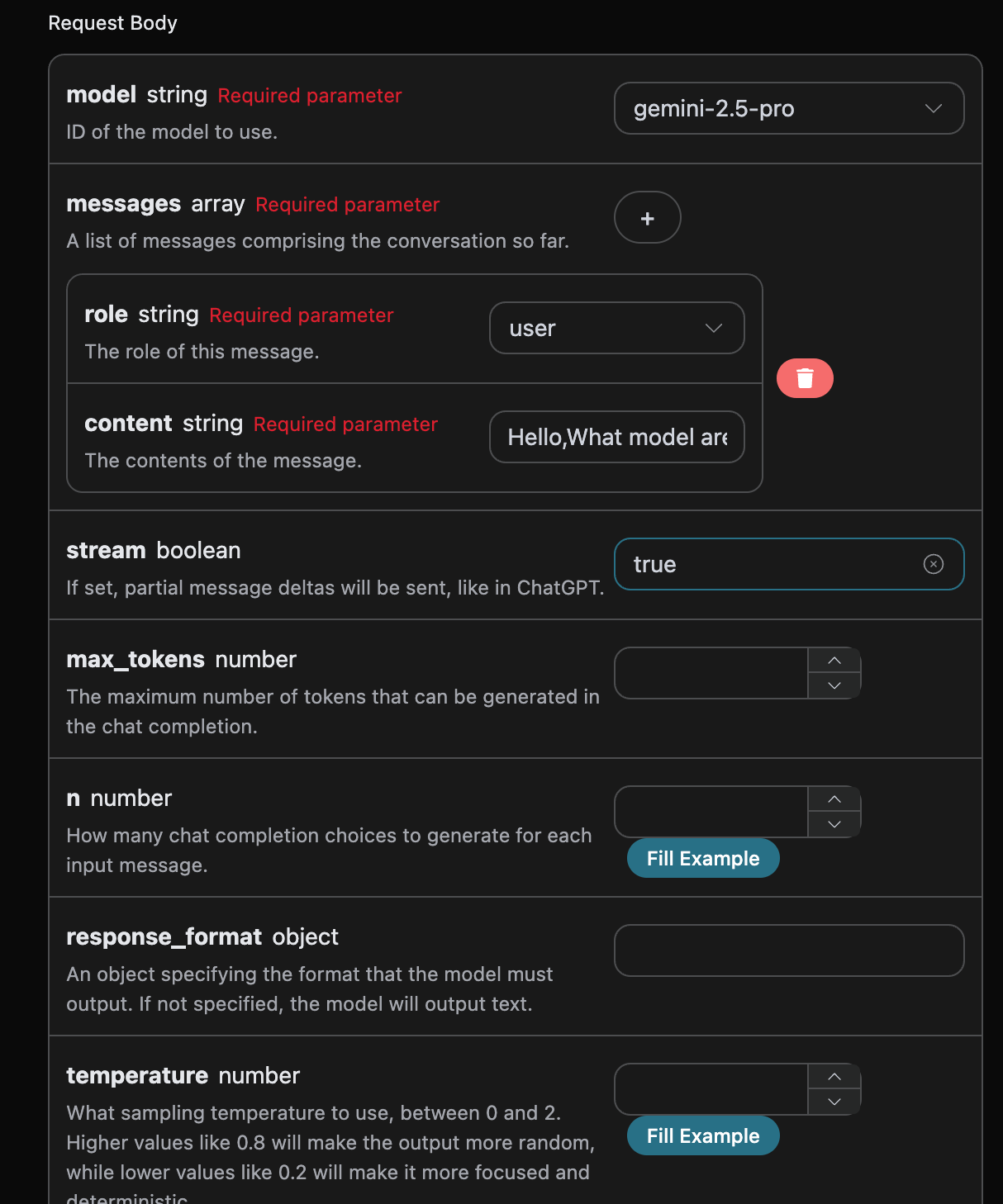

Jeśli nie jesteś zalogowany lub zarejestrowany, automatycznie zostaniesz przekierowany na stronę logowania, aby zarejestrować się i zalogować, a po zalogowaniu lub rejestracji automatycznie wrócisz na bieżącą stronę.

Podczas pierwszej aplikacji otrzymasz darmowy limit, który pozwala na bezpłatne korzystanie z tego API.

Jeśli nie jesteś zalogowany lub zarejestrowany, automatycznie zostaniesz przekierowany na stronę logowania, aby zarejestrować się i zalogować, a po zalogowaniu lub rejestracji automatycznie wrócisz na bieżącą stronę.

Podczas pierwszej aplikacji otrzymasz darmowy limit, który pozwala na bezpłatne korzystanie z tego API.