messages. Aby zrealizować ciągłą rozmowę, musimy przekazać całą historię kontekstu, a także zająć się problemem przekroczenia limitu Tokenów.

API do pytań i odpowiedzi AI oferowane przez AceDataCloud zostało zoptymalizowane pod kątem powyższej sytuacji, zapewniając, że efekty pytań i odpowiedzi pozostają niezmienne, a realizacja ciągłych rozmów została opakowana, co oznacza, że podczas integracji nie musimy już martwić się o przekazywanie messages ani o problem z przekroczeniem limitu Tokenów (API automatycznie zajmuje się tym wewnętrznie). Dodatkowo oferuje funkcje zapytań i modyfikacji rozmów, co znacznie upraszcza całą integrację.

Dokument ten przedstawia opis integracji API do pytań i odpowiedzi AI.

Proces aplikacji

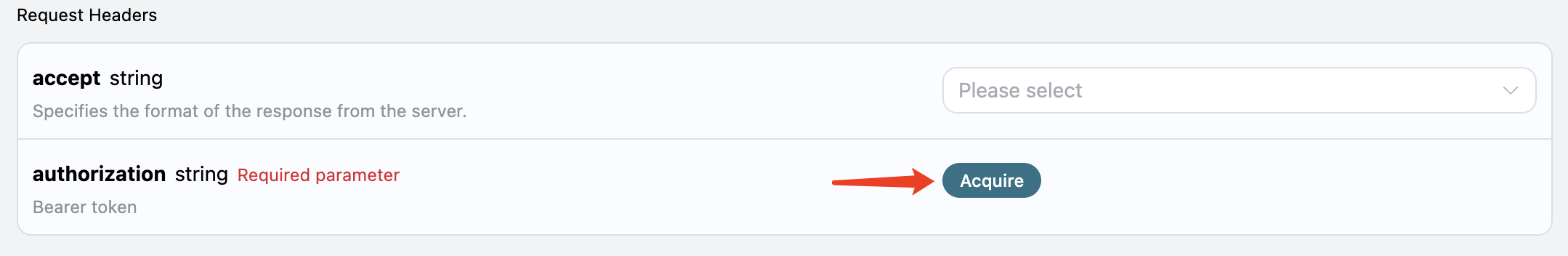

Aby korzystać z API, należy najpierw przejść do odpowiedniej strony AI Chat API i złożyć wniosek o odpowiednią usługę. Po wejściu na stronę kliknij przycisk „Acquire”, jak pokazano na obrazku: Jeśli nie jesteś zalogowany lub zarejestrowany, automatycznie zostaniesz przekierowany na stronę logowania, aby zarejestrować się i zalogować. Po zalogowaniu lub rejestracji automatycznie wrócisz na bieżącą stronę.

Podczas pierwszej aplikacji otrzymasz darmowy limit, który pozwala na bezpłatne korzystanie z tego API.

Jeśli nie jesteś zalogowany lub zarejestrowany, automatycznie zostaniesz przekierowany na stronę logowania, aby zarejestrować się i zalogować. Po zalogowaniu lub rejestracji automatycznie wrócisz na bieżącą stronę.

Podczas pierwszej aplikacji otrzymasz darmowy limit, który pozwala na bezpłatne korzystanie z tego API.

Podstawowe użycie

Najpierw zapoznaj się z podstawowym sposobem użycia, czyli wprowadzeniem pytania i uzyskaniem odpowiedzi. Wystarczy prosto przekazać polequestion i określić odpowiedni model.

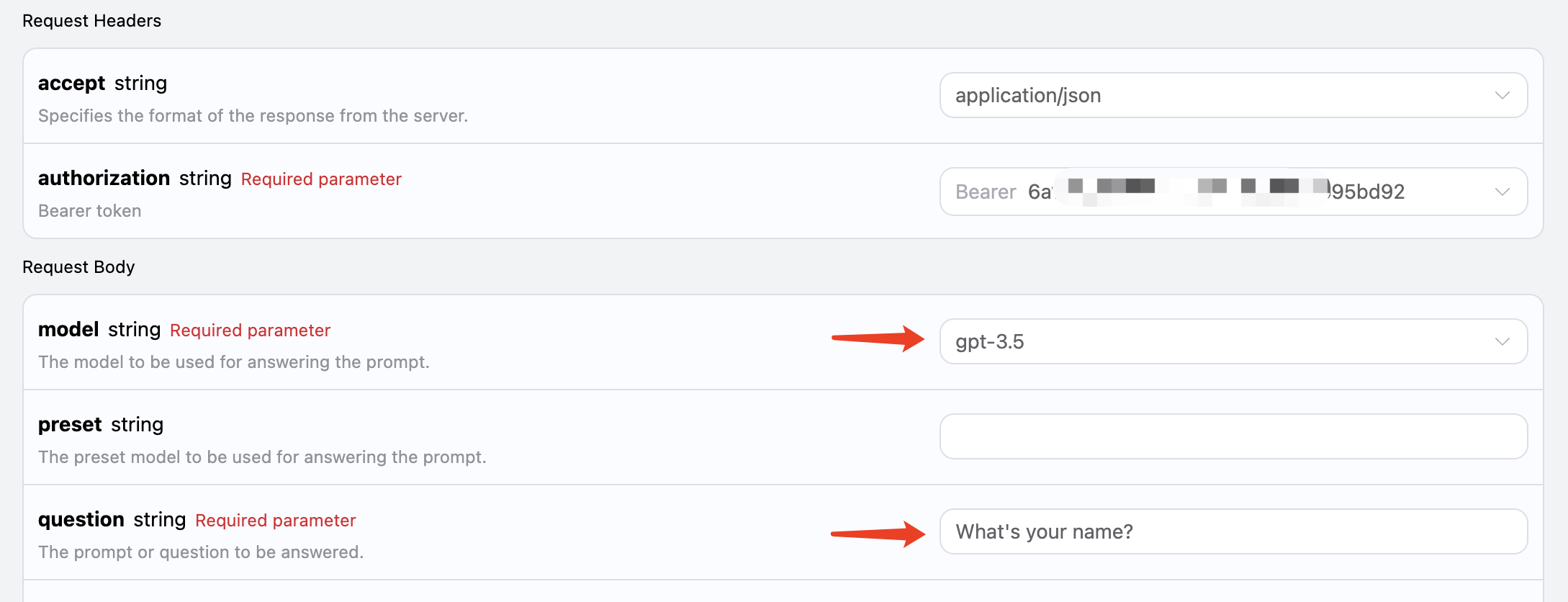

Na przykład zapytanie: „Jak masz na imię?”, możemy następnie wypełnić odpowiednie treści na interfejsie, jak pokazano na obrazku:

Możemy zobaczyć, że ustawiliśmy nagłówki żądania, w tym:

Możemy zobaczyć, że ustawiliśmy nagłówki żądania, w tym:

accept: jakiego formatu odpowiedzi oczekujemy, tutaj wpisujemyapplication/json, czyli format JSON.authorization: klucz do wywołania API, po złożeniu wniosku można go bezpośrednio wybrać z rozwijanej listy.

model: wybór modelu, na przykład popularne GPT 3.5, GPT 4 itd.question: pytanie, które chcemy zadać, może być dowolnym czystym tekstem.

answer, które jest odpowiedzią na to pytanie. Możemy wprowadzić dowolne pytanie, aby uzyskać dowolną odpowiedź.

Jeśli nie potrzebujesz wsparcia dla wieloetapowych rozmów, to API może znacznie ułatwić Twoją integrację.

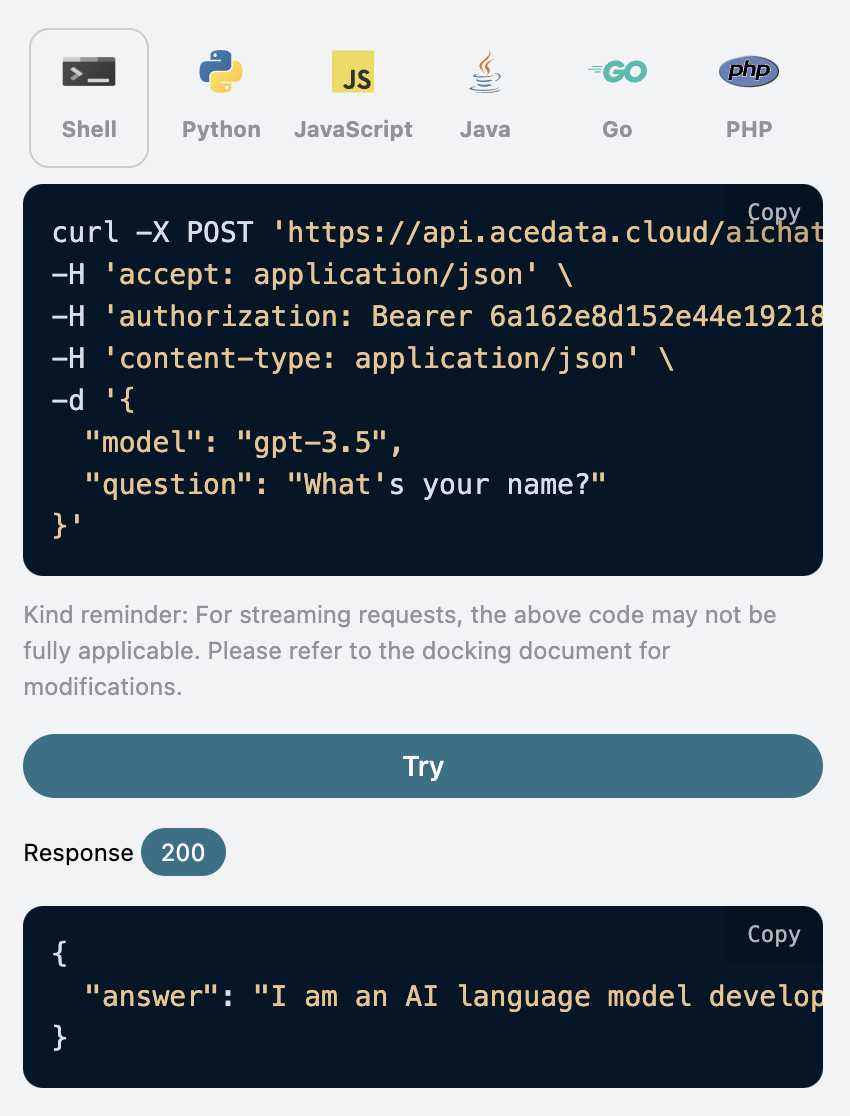

Dodatkowo, jeśli chcesz wygenerować odpowiedni kod do integracji, możesz go bezpośrednio skopiować, na przykład kod CURL wygląda następująco:

Wieloetapowe rozmowy

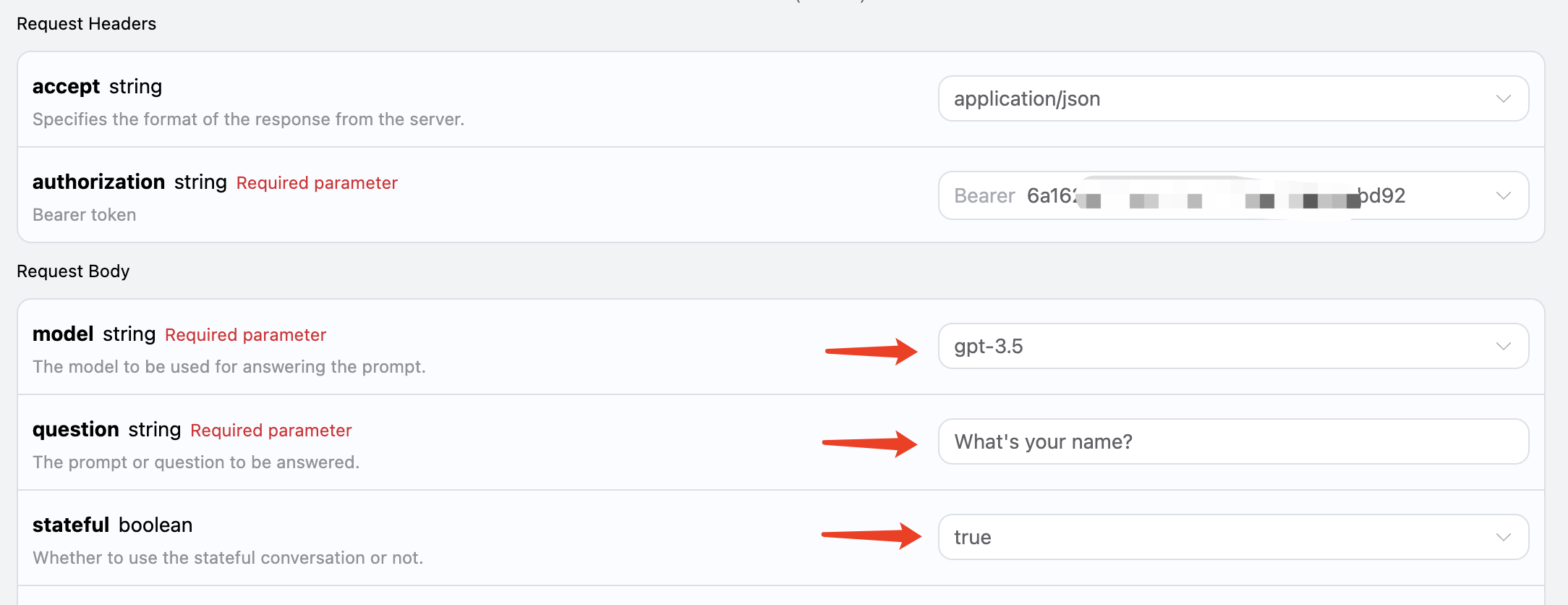

Jeśli chcesz zintegrować funkcję wieloetapowych rozmów, musisz przekazać dodatkowy parametrstateful, którego wartość wynosi true. Każde kolejne żądanie musi zawierać ten parametr. Po przekazaniu parametru stateful, API dodatkowo zwróci parametr id, który reprezentuje ID bieżącej rozmowy. W przyszłości wystarczy przekazać to ID jako parametr, aby łatwo zrealizować wieloetapowe rozmowy.

Poniżej przedstawiamy konkretne operacje.

Pierwsze żądanie, ustawiając parametr stateful na true, oraz normalnie przekazując parametry model i question, jak pokazano na obrazku:

Odpowiedni kod wygląda następująco:

Odpowiedni kod wygląda następująco:

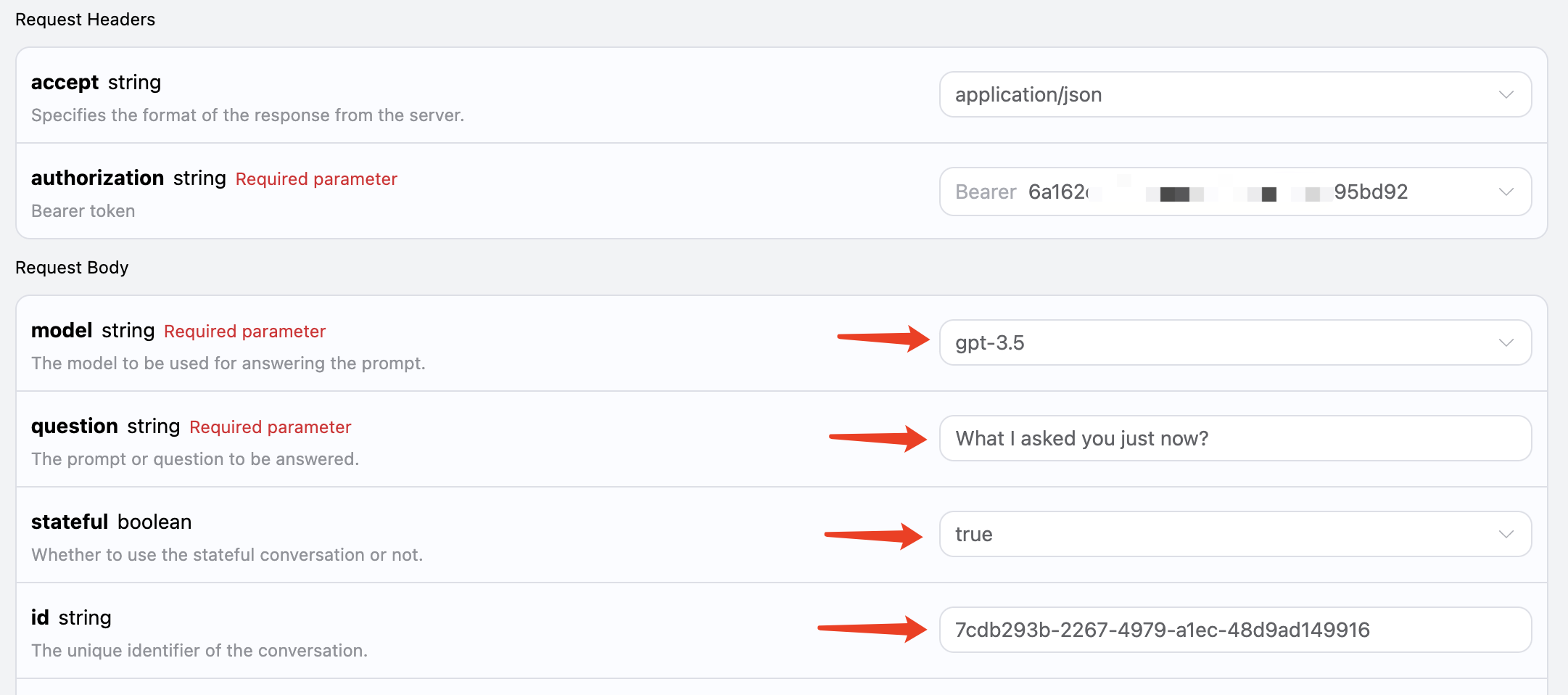

id zwrócone w pierwszym żądaniu jako parametr, a parametr stateful nadal ustawiony na true, pytając „Co właśnie zapytałem?”, jak pokazano na obrazku:

Odpowiedni kod wygląda następująco:

Odpowiedni kod wygląda następująco:

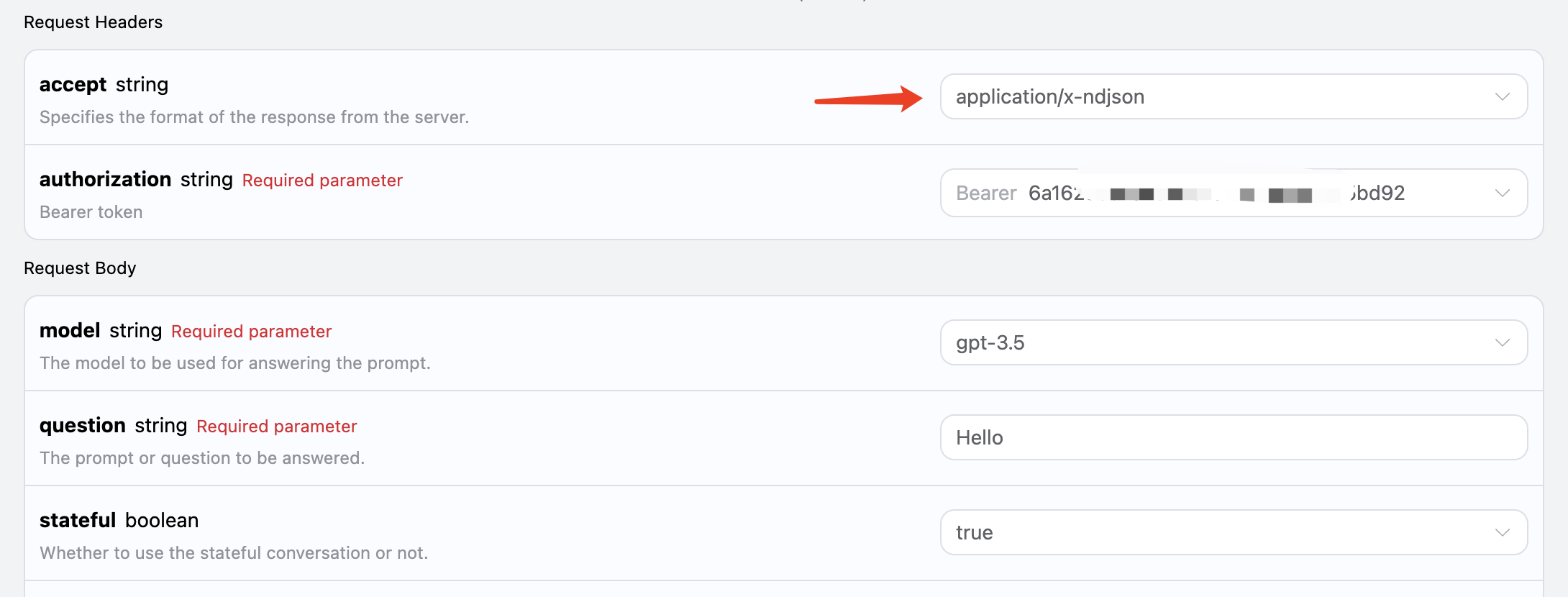

Odpowiedzi strumieniowe

To API obsługuje również odpowiedzi strumieniowe, co jest bardzo przydatne w integracji z witrynami internetowymi, umożliwiając wyświetlanie efektu literowego. Aby uzyskać odpowiedź strumieniową, można zmienić parametraccept w nagłówku żądania na application/x-ndjson.

Zmiana, jak pokazano na obrazku, jednak kod wywołania musi być odpowiednio zmieniony, aby obsługiwał odpowiedzi strumieniowe.

Po zmianie

Po zmianie accept na application/x-ndjson, API zwróci odpowiednie dane JSON w kolejnych liniach, a w kodzie musimy wprowadzić odpowiednie zmiany, aby uzyskać wyniki w kolejnych liniach.

Przykładowy kod wywołania w Pythonie:

answer to najnowsza treść odpowiedzi, a delta_answer to nowa treść odpowiedzi, którą można zintegrować z systemem.

JavaScript również jest wspierany, na przykład kod do wywołania strumieniowego w Node.js wygląda następująco:

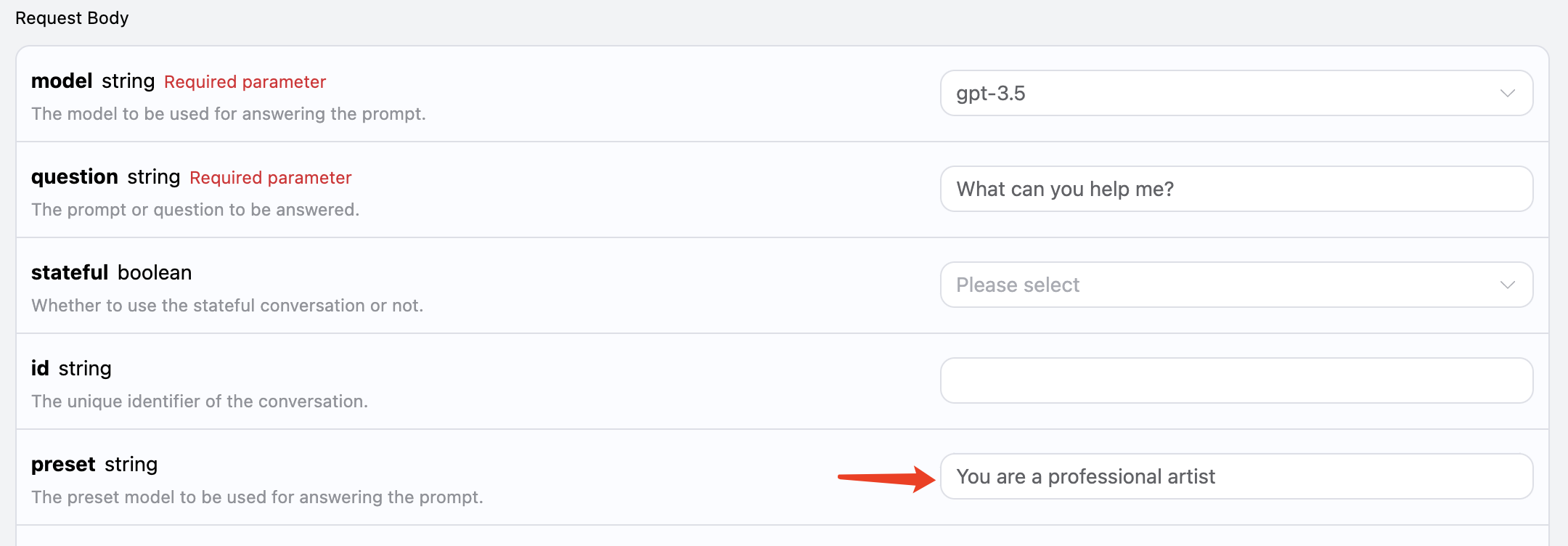

Ustawienia modelu

Wiemy, że API związane z OpenAI ma odpowiednią koncepcjęsystem_prompt, która ustawia domyślne ustawienia dla całego modelu, na przykład jego nazwę itd. To API AI Q&A również udostępnia ten parametr, nazywa się preset, dzięki czemu możemy dodać ustawienia do modelu. Użyjmy przykładu, aby to zobaczyć:

Tutaj dodatkowo dodajemy pole preset, którego treść to Jesteś profesjonalnym artystą, jak pokazano na obrazku:

Odpowiedni kod wygląda następująco:

Odpowiedni kod wygląda następująco:

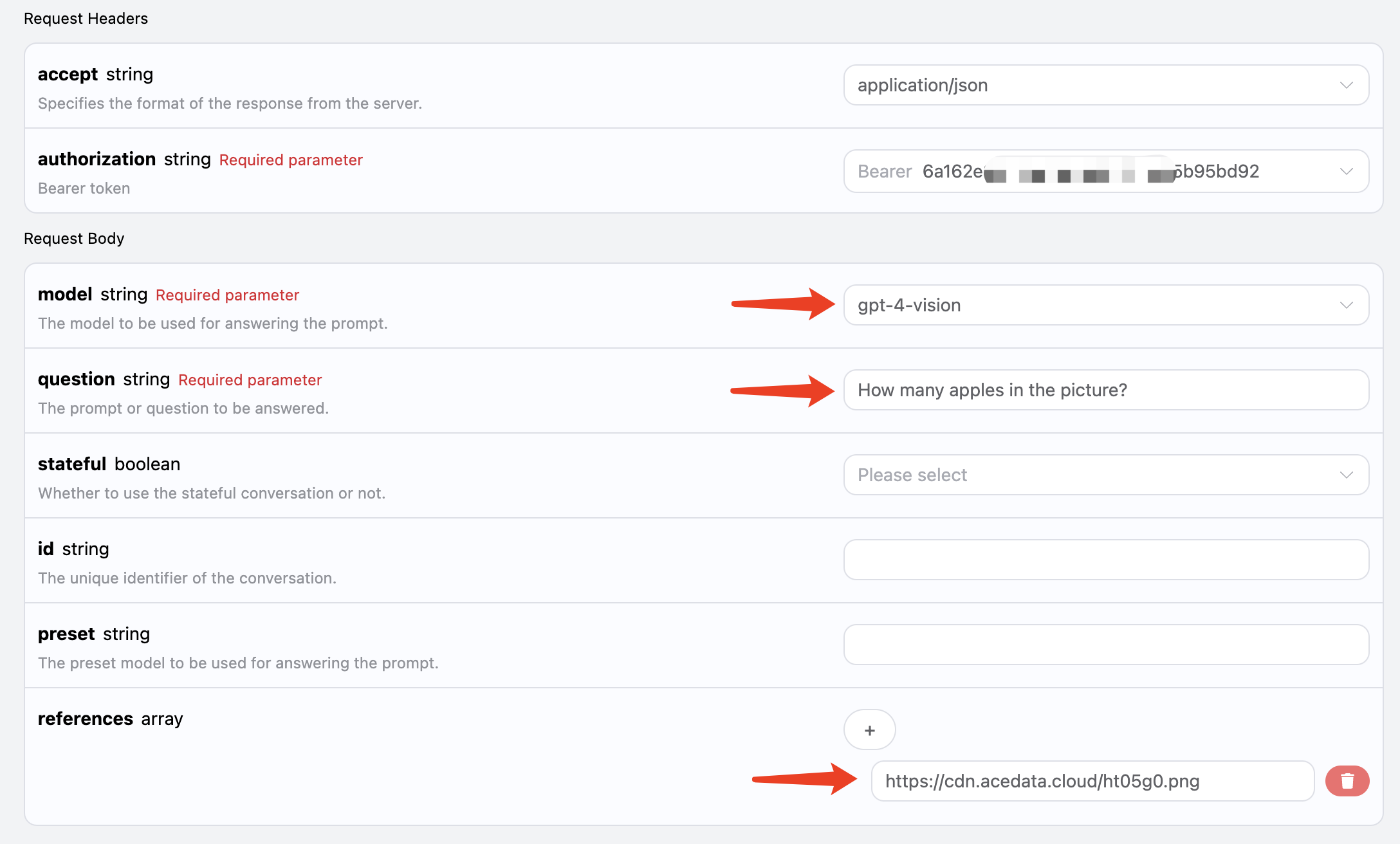

Rozpoznawanie obrazów

To AI również wspiera dodawanie załączników do rozpoznawania obrazów, przekazując odpowiedni link do obrazu przezreferences, na przykład mam tutaj zdjęcie jabłka, jak pokazano na obrazku:

Link do tego obrazu to https://cdn.acedata.cloud/ht05g0.png, możemy bezpośrednio przekazać go jako parametr

Link do tego obrazu to https://cdn.acedata.cloud/ht05g0.png, możemy bezpośrednio przekazać go jako parametr references, jednocześnie należy pamiętać, że model musi być wybrany jako wspierający rozpoznawanie wizualne, obecnie wspierany jest gpt-4-vision, więc wejście wygląda następująco:

Odpowiedni kod wygląda następująco:

Odpowiedni kod wygląda następująco:

Pytania online

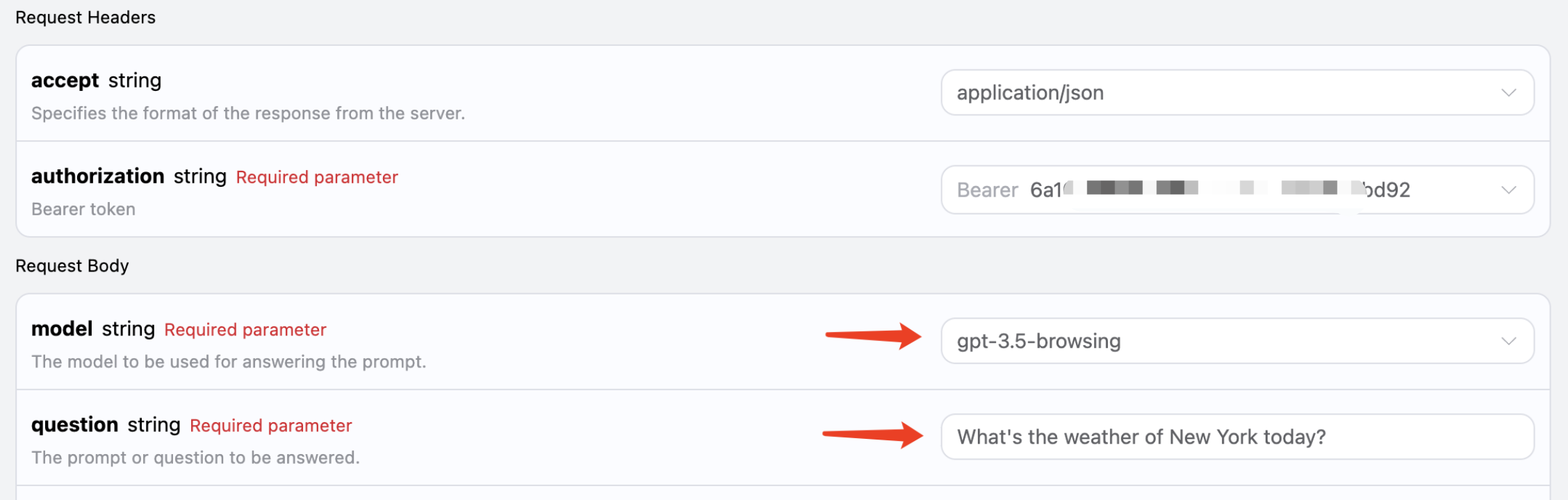

To API wspiera również modele online, w tym GPT-3.5 i GPT-4, które mogą wspierać, w tle API odbywa się automatyczne przeszukiwanie internetu i podsumowywanie, możemy wybrać model jakogpt-3.5-browsing, aby to przetestować, jak pokazano na obrazku:

Kod wygląda następująco:

Kod wygląda następująco:

Jeśli masz wyższe wymagania co do jakości odpowiedzi modelu, możesz zmienić model na gpt-4-browsing, a efekty odpowiedzi będą lepsze.