申请流程

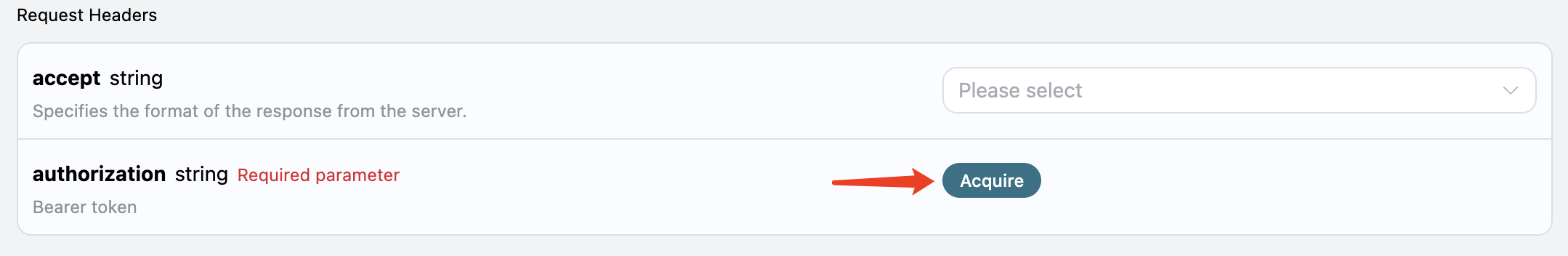

要使用 API,需要先到 Wan Videos Generation API 对应页面申请对应的服务,进入页面之后,点击「Acquire」按钮,如图所示: 如果你尚未登录或注册,会自动跳转到登录页面邀请您来注册和登录,登录注册之后会自动返回当前页面。

在首次申请时会有免费额度赠送,可以免费使用该 API。

如果你尚未登录或注册,会自动跳转到登录页面邀请您来注册和登录,登录注册之后会自动返回当前页面。

在首次申请时会有免费额度赠送,可以免费使用该 API。

基本使用

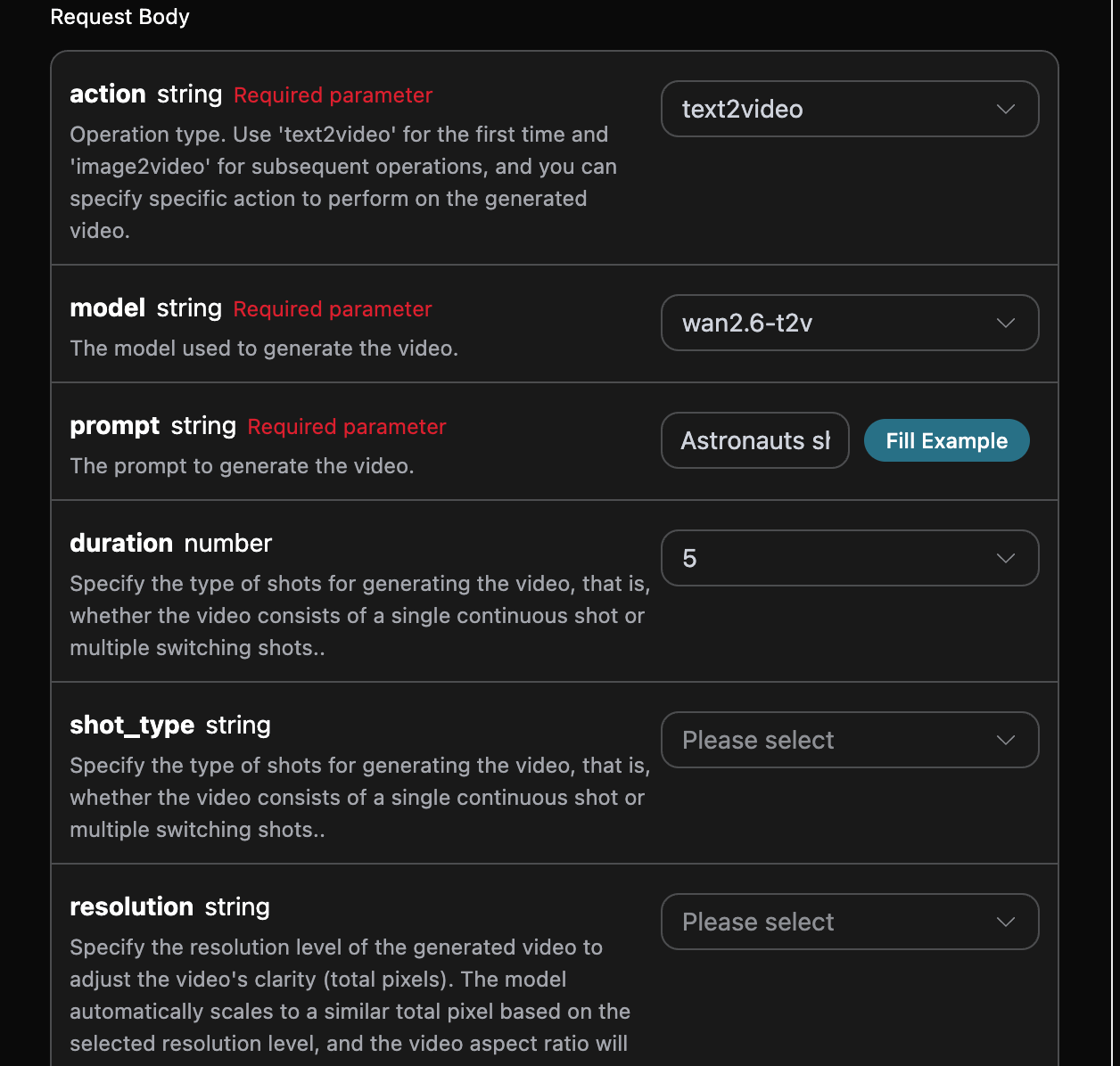

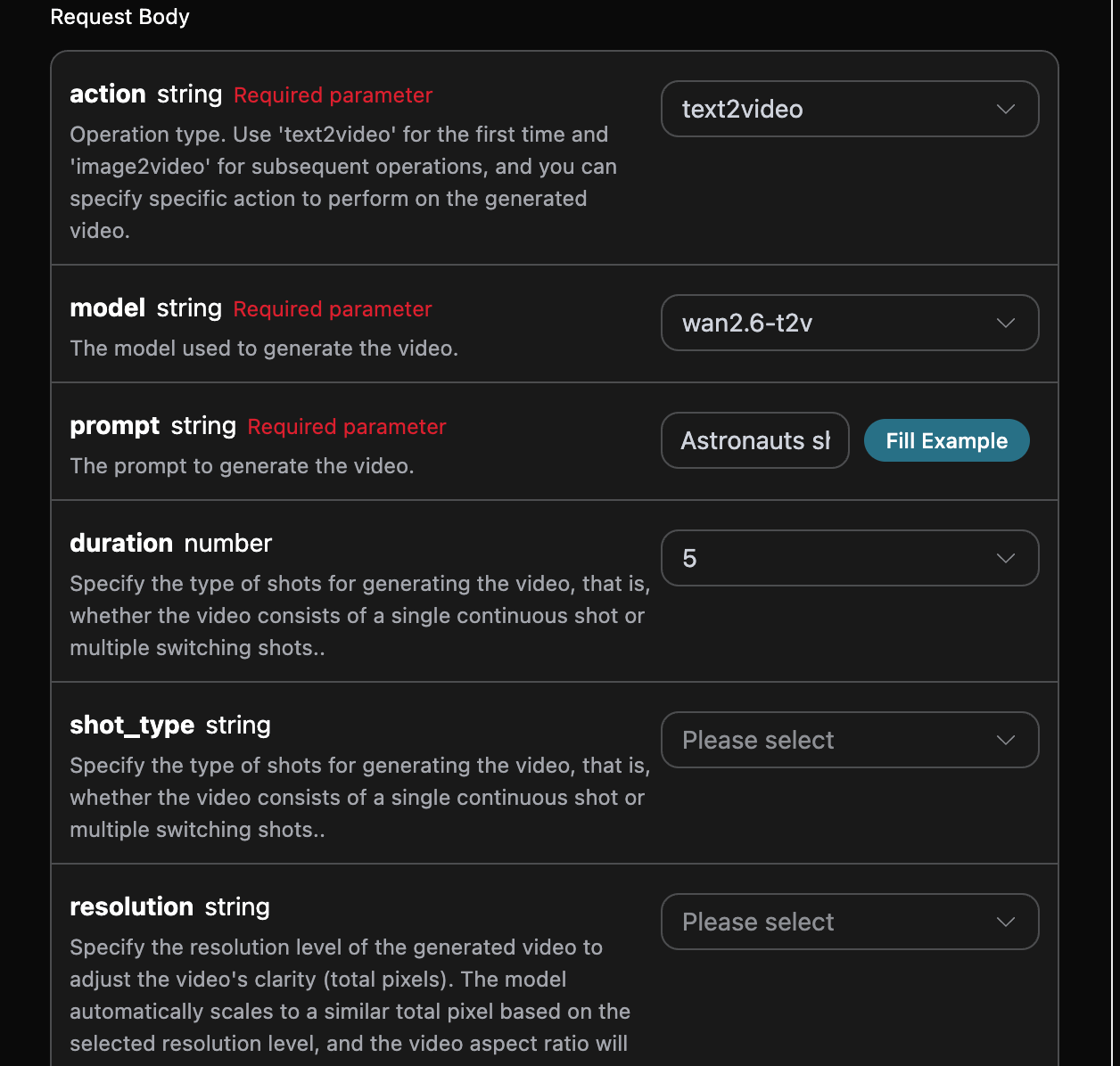

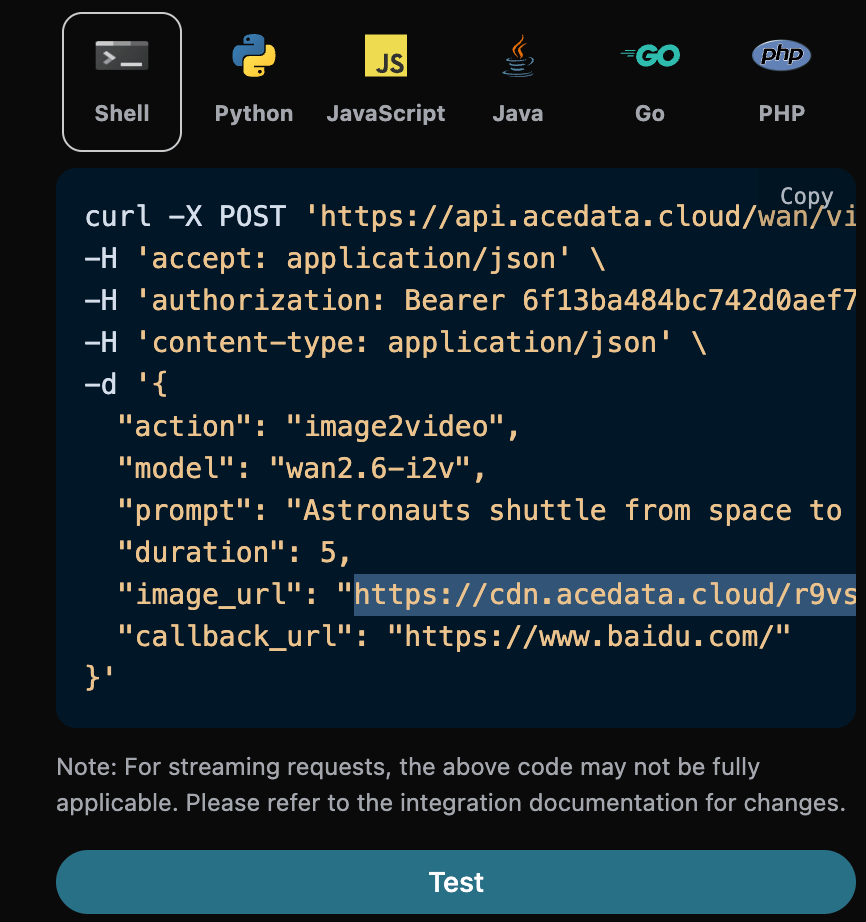

首先先了解下基本的使用方式,就是输入提示词prompt、 生成行为 action、首帧参考图片 image_url 以及模型 model,便可获得处理后的结果,首先需要简单地传递一个 action 字段,它的值为 text2video,它主要包含俩种行为:文生视频(text2video)、图生视频(image2video),然后我们还需要输入模型 model,目前主要有 wan2.6-i2v, wan2.6-r2v, wan2.6-i2v-flash, wan2.6-t2v 模型,具体的内容如下:

accept:想要接收怎样格式的响应结果,这里填写为application/json,即 JSON 格式。authorization:调用 API 的密钥,申请之后可以直接下拉选择。

model:生成视频的模型,主要有wan2.6-i2v,wan2.6-r2v,wan2.6-i2v-flash,wan2.6-t2v模型。action:此次视频生成任务的行为,主要包含三种行为,分别为:文生视频(text2video)、图生视频(image2video),当是文生视频时,目前只支持模型wan2.6-t2v,当是图生视频时,目前只支持模型wan2.6-i2v,wan2.6-r2v,wan2.6-i2v-flash。image_url:当选择图生视频行为image2video就必须需要上传的首帧参考图片链接,目前只支持模型wan2.6-i2v、wan2.6-i2v-flash。reference_video_urls:图生视频时可选,指定参考的视频链接进行生成,目前只支持模型wan2.6-r2v。size:指定生成的视频分辨率,格式为宽*高。该参数的默认值和可用枚举值依赖于 model 参数,具体的规则可参考官网文档:。duration:视频生成的时长,主要支持5、10、15。shot_type:可选,指定生成视频的镜头类型,即视频是由一个连续镜头还是多个切换镜头组成。生效条件:仅当”prompt_extend”: true 时生效。参数优先级:shot_type > prompt。例如,若 shot_type设置为”single”,即使 prompt 中包含“生成多镜头视频”,模型仍会输出单镜头视频,具体的规则可参考官网文档。negative_prompt:可选,反向提示词,用来描述不希望在视频画面中看到的内容,可以对视频画面进行限制。支持中英文,长度不超过500个字符,超过部分会自动截断。示例值:低分辨率、错误、最差质量、低质量、残缺、多余的手指、比例不良等。resolution:指定生成的视频分辨率档位,用于调整视频的清晰度(总像素)。模型根据选择的分辨率档位,自动缩放至相近总像素,视频宽高比将尽量与输入图像 img_url 的宽高比保持一致,更多说明详见参考官网文档。audio_url:音频文件的 URL,模型将使用该音频生成视频。使用方式参考官网文档。audio:是否生成有声视频。参数优先级:audio > audio_url。当 audio=false时,即使传入 audio_url,输出仍为无声视频,且计费按无声视频计算,默认值是true。prompt_extend:是否开启prompt智能改写。开启后使用大模型对输入prompt进行智能改写。对于较短的prompt生成效果提升明显,但会增加耗时,默认值是true。prompt:提示词。callback_url:需要回调结果的URL。

success,此时视频生成任务的状态情况。task_id,此时视频生成任务ID。video_url,此时视频生成任务的视频链接。state,此时视频生成任务的状态。

video_url 的视频链接地址获取生成的通义万相视频即可。

另外如果想生成对应的对接代码,可以直接复制生成,例如 CURL 的代码如下:

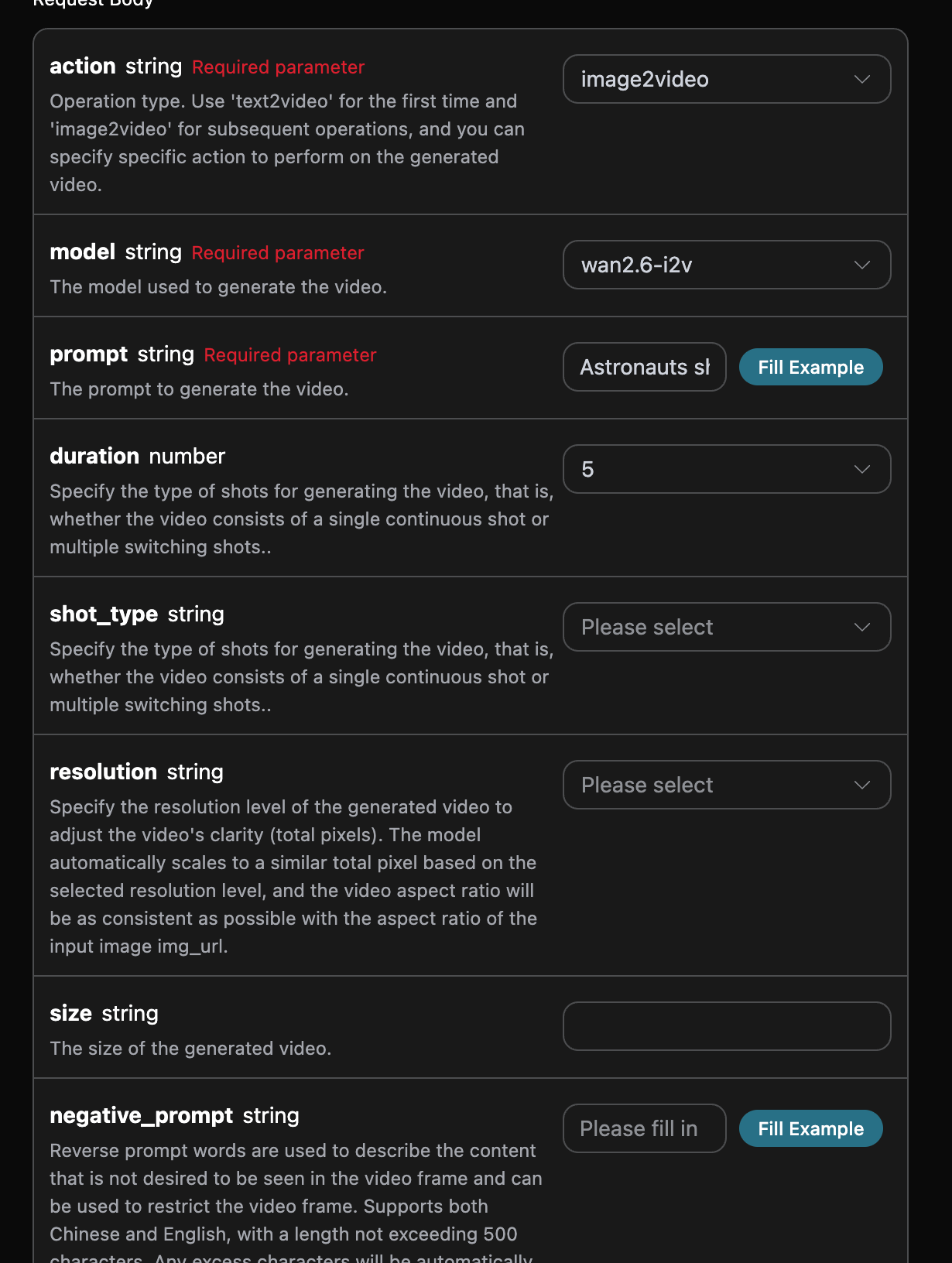

图生视频功能

如果想对参考图或者参考视频来生成视频的话,可以将参数action 设置为 image2video ,并且输入需要参考图链接或者参考视频链接,接下来我们要必须填下一步需要扩展的提示词来自定义生成视频,就可以指定如下内容:

model:生成视频的模型,主要有wan2.6-i2v,wan2.6-r2v,wan2.6-i2v-flash,wan2.6-t2v模型。image_url:当选择图生视频行为image2video就必须需要上传的首帧参考图片链接,目前只支持模型wan2.6-i2v、wan2.6-i2v-flash。reference_video_urls:图生视频时可选,指定参考的视频链接进行生成,目前只支持模型wan2.6-r2v。prompt:提示词。

异步回调

由于 Wan Videos Generation API生成的时间相对较长,大约需要 1-2 分钟,如果 API 长时间无响应,HTTP 请求会一直保持连接,导致额外的系统资源消耗,所以本 API 也提供了异步回调的支持。 整体流程是:客户端发起请求的时候,额外指定一个callback_url 字段,客户端发起 API 请求之后,API 会立马返回一个结果,包含一个 task_id 的字段信息,代表当前的任务 ID。当任务完成之后,生成视频的结果会通过 POST JSON 的形式发送到客户端指定的 callback_url,其中也包括了 task_id 字段,这样任务结果就可以通过 ID 关联起来了。

下面我们通过示例来了解下具体怎样操作。

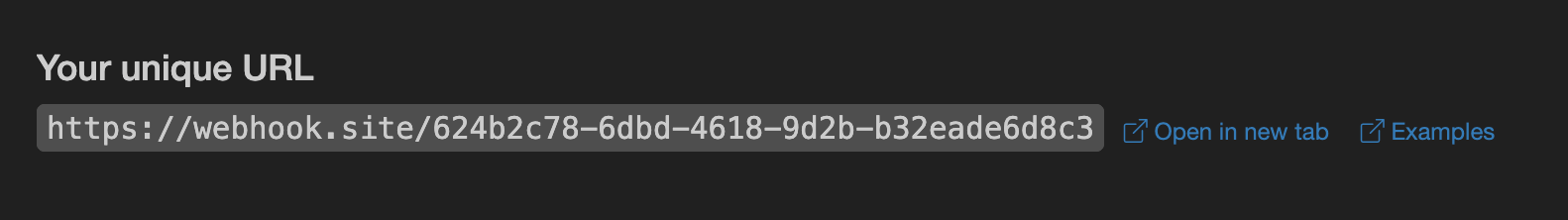

首先,Webhook 回调是一个可以接收 HTTP 请求的服务,开发者应该替换为自己搭建的 HTTP 服务器的 URL。此处为了方便演示,使用一个公开的 Webhook 样例网站 https://webhook.site/,打开该网站即可得到一个 Webhook URL,如图所示:

将此 URL 复制下来,就可以作为 Webhook 来使用,此处的样例为

将此 URL 复制下来,就可以作为 Webhook 来使用,此处的样例为 https://webhook.site/624b2c78-6dbd-4618-9d2b-b32eade6d8c3。

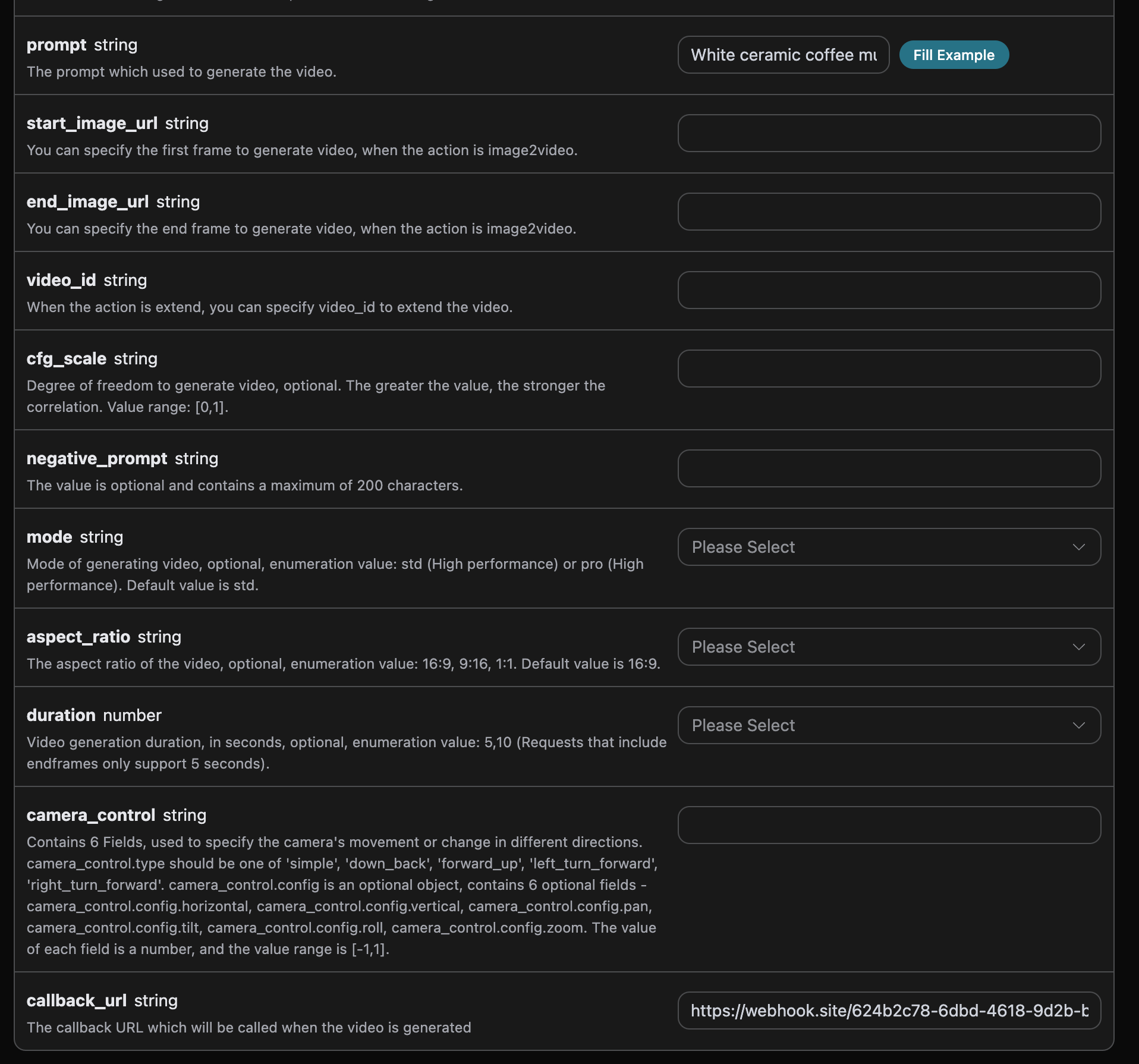

接下来,我们可以设置字段 callback_url 为上述 Webhook URL,同时填入相应的参数,具体的内容如图所示:

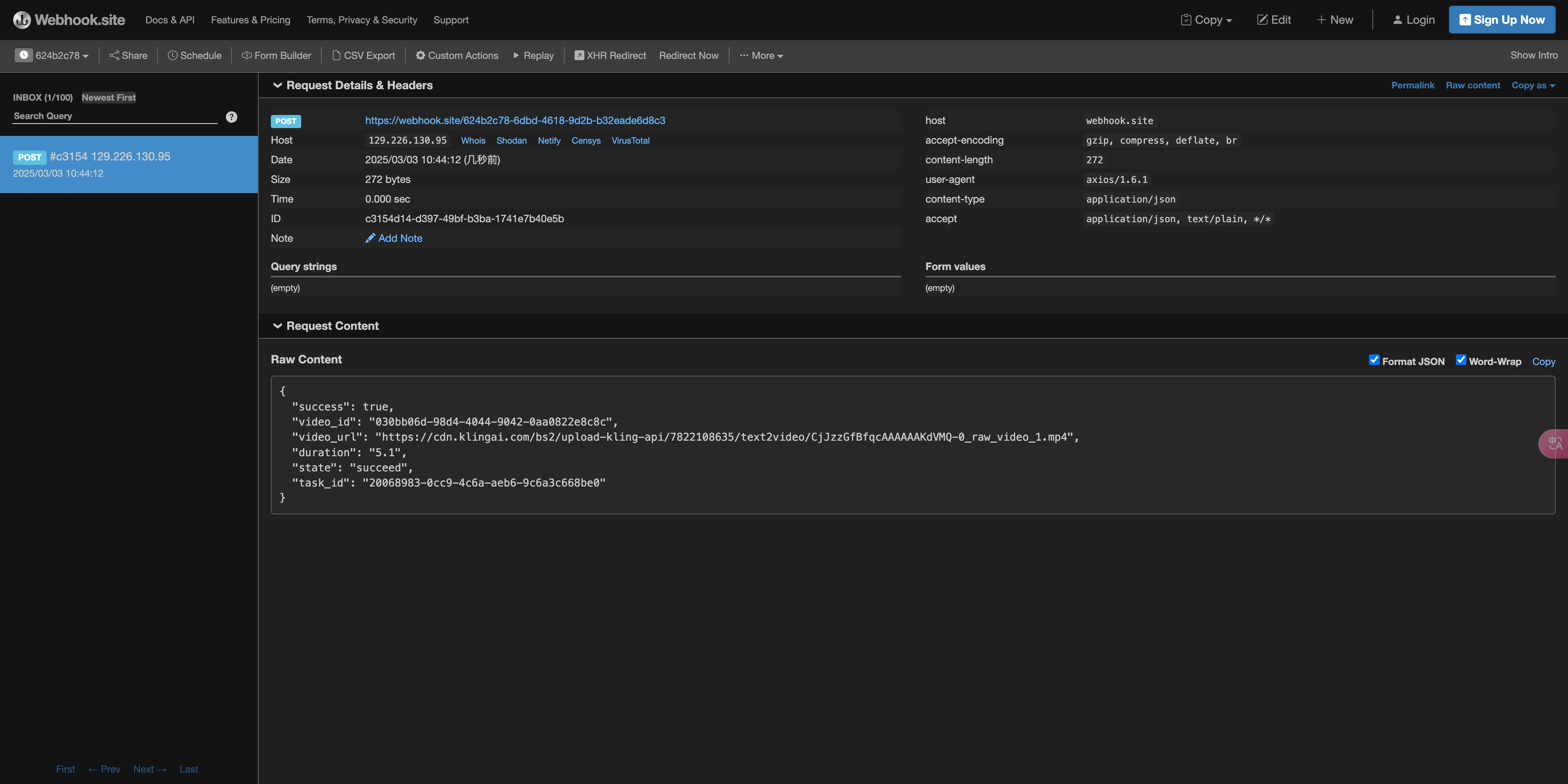

https://webhook.site/624b2c78-6dbd-4618-9d2b-b32eade6d8c3 上观察到生成视频的结果,如图所示:

内容如下:

内容如下:

task_id 字段,其他的字段都和上文类似,通过该字段即可实现任务的关联。

错误处理

在调用 API 时,如果遇到错误,API 会返回相应的错误代码和信息。例如:400 token_mismatched:Bad request, possibly due to missing or invalid parameters.400 api_not_implemented:Bad request, possibly due to missing or invalid parameters.401 invalid_token:Unauthorized, invalid or missing authorization token.429 too_many_requests:Too many requests, you have exceeded the rate limit.500 api_error:Internal server error, something went wrong on the server.