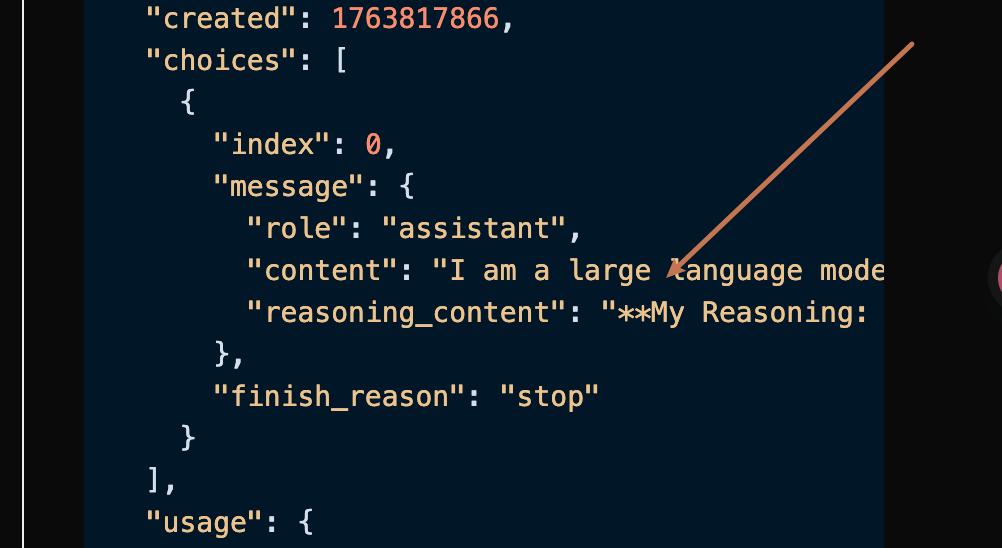

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"content": "", "role": "assistant"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**حدد طبيعتي**\n\nلقد بدأت أفكر. المستخدم يريد أن يعرف طبيعتي، ويسأل مباشرة \"ما أنت؟\" كانت الخطوة الأولية بسيطة: تحديد الاستفسار. الآن، أتذكر هويتي الأساسية: أنا نموذج لغة كبير. هذه هي الحقيقة الأساسية التي أهدف إلى إيصالها.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**تنقيح ردي**\n\nلقد أضفت المعلومات الأساسية التي تم تدريبي عليها من قبل جوجل إلى هوية \"نموذج لغة كبير\" الأساسية. خطوتي التالية هي التفكير في ما يعنيه أن أكون \"نموذج لغة كبير\" فعليًا، حتى أتمكن من شرح قدراتي الأساسية. أركز على تقديم السياق دون الخوض في تفاصيل تقنية محددة أو أسماء نماذج. أريد أن أوصل وظيفتي بطريقة يمكن للمستخدم فهمها بسهولة.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"reasoning_content": "**تأكيد الهوية الأساسية**\n\nأنا الآن أرسخ ردي. يحتاج استفسار المستخدم حول انتمائي للنموذج إلى إجابة مركزة. لقد حددت أن \"تم تدريبي بواسطة جوجل\" أمر أساسي، مما يوفر سياقًا رئيسيًا. أقاوم الرغبة في ذكر أي أسماء نماذج محددة، حيث إنه ليس ذا صلة. الهدف هو تقديم بيان مباشر ودقيق. يظل هدفي هو تقديم رد واضح وموجز، مع تجنب المصطلحات التقنية والذهاب مباشرة إلى النقطة ذات الصلة.\n\n\n"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"content": "أنا نموذج لغة كبير، تم تدريبي بواسطة جوجل."}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {}, "logprobs": null, "finish_reason": "stop", "index": 0}], "usage": null}

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": "", "choices": [], "usage": {"prompt_tokens": 8, "completion_tokens": 527, "total_tokens": 535, "prompt_tokens_details": {"cached_tokens": 0, "text_tokens": 8, "audio_tokens": 0, "image_tokens": 0}, "completion_tokens_details": {"text_tokens": 0, "audio_tokens": 0, "reasoning_tokens": 519}, "input_tokens": 0, "output_tokens": 0, "input_tokens_details": null, "claude_cache_creation_5_m_tokens": 0, "claude_cache_creation_1_h_tokens": 0}}

data: [DONE]

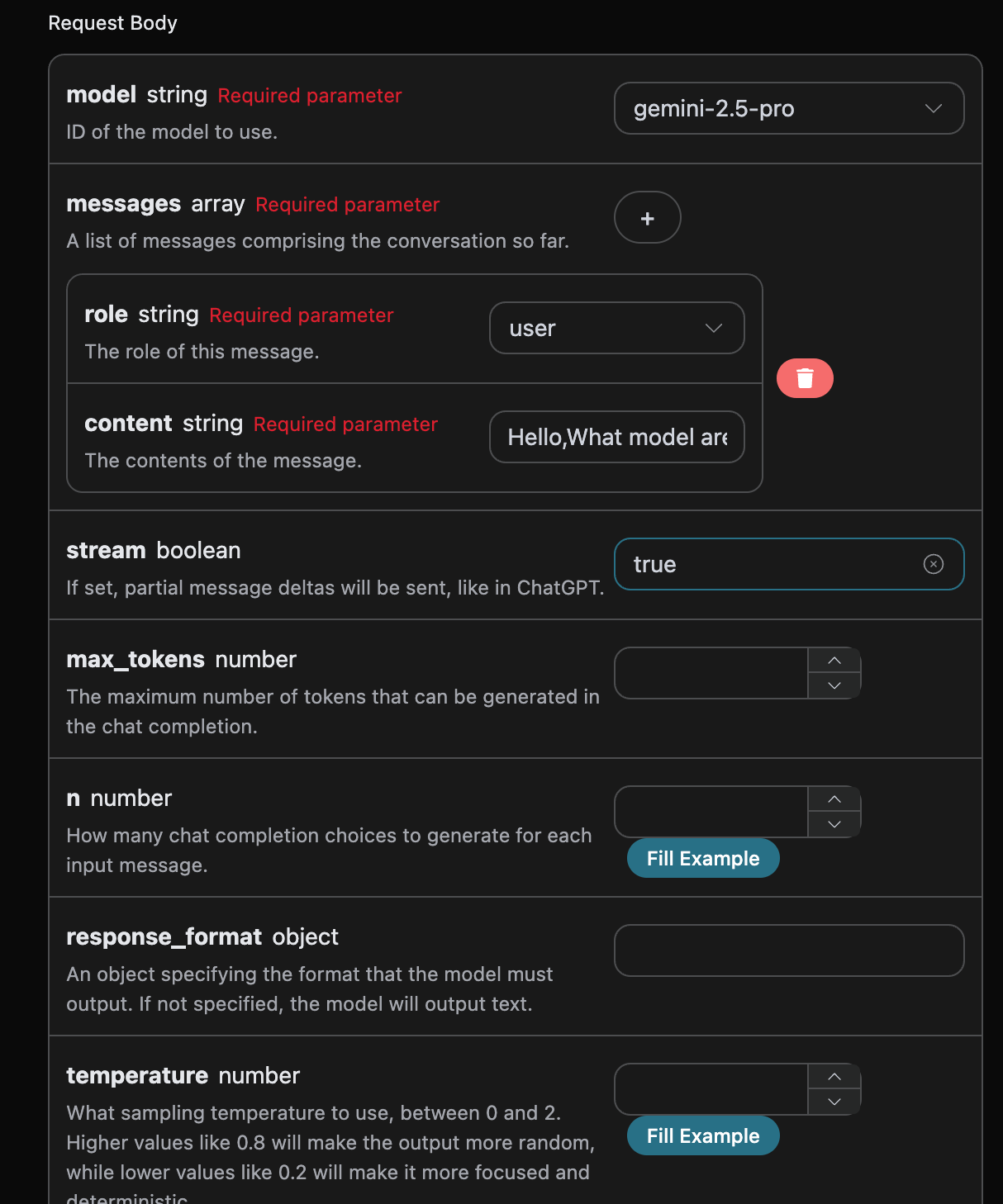

إذا لم تكن قد قمت بتسجيل الدخول أو التسجيل بعد، فسيتم تحويلك تلقائيًا إلى صفحة تسجيل الدخول لدعوتك للتسجيل وتسجيل الدخول، وبعد تسجيل الدخول، سيتم إرجاعك تلقائيًا إلى الصفحة الحالية.

عند التقديم لأول مرة، ستحصل على حصة مجانية يمكن استخدامها مجانًا.

إذا لم تكن قد قمت بتسجيل الدخول أو التسجيل بعد، فسيتم تحويلك تلقائيًا إلى صفحة تسجيل الدخول لدعوتك للتسجيل وتسجيل الدخول، وبعد تسجيل الدخول، سيتم إرجاعك تلقائيًا إلى الصفحة الحالية.

عند التقديم لأول مرة، ستحصل على حصة مجانية يمكن استخدامها مجانًا.